Tool Learning with Large Language Models: A Survey

作者: Changle Qu, Sunhao Dai, Xiaochi Wei, Hengyi Cai, Shuaiqiang Wang, Dawei Yin, Jun Xu, Ji-Rong Wen

分类: cs.CL, cs.AI

发布日期: 2024-05-28 (更新: 2024-11-04)

备注: The article has been accepted by Frontiers of Computer Science (FCS), with the DOI: {10.1007/s11704-024-40678-2}

DOI: 10.1007/s11704-024-40678-2

🔗 代码/项目: GITHUB

💡 一句话要点

综述:大型语言模型工具学习,提升复杂问题解决能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 工具学习 任务规划 工具选择 工具调用 响应生成 综述 人工智能

📋 核心要点

- 现有方法难以有效利用外部工具增强大型语言模型(LLMs)的能力,缺乏系统性的研究和组织。

- 该综述旨在全面分析LLMs工具学习,从“为什么”和“如何”两个角度进行深入探讨。

- 该研究总结了现有基准和评估方法,并讨论了当前挑战和未来方向,为研究人员和开发者提供指导。

📝 摘要(中文)

近年来,利用大型语言模型(LLMs)进行工具学习已成为一种有前景的范例,旨在增强LLMs解决高度复杂问题的能力。尽管该领域受到了越来越多的关注并且发展迅速,但现有的文献仍然分散且缺乏系统的组织,这给新手的入门带来了障碍。 鉴于此,我们对现有的LLMs工具学习工作进行了全面的综述。 在本综述中,我们重点从两个主要方面回顾现有文献:(1)工具学习为何有益;(2)工具学习如何实施,从而全面理解LLMs的工具学习。 我们首先从六个特定方面探讨工具集成的好处以及工具学习范例的内在优势,从而研究“为什么”。 在“如何”方面,我们根据工具学习工作流程的四个关键阶段(任务规划、工具选择、工具调用和响应生成)对文献进行了系统回顾。 此外,我们还详细总结了现有的基准和评估方法,并根据它们与不同阶段的相关性对其进行分类。 最后,我们讨论了当前的挑战并概述了潜在的未来方向,旨在激发研究人员和工业开发者进一步探索这个新兴且有希望的领域。 我们还在GitHub上维护一个存储库,以不断跟踪该新兴领域的相关论文和资源:https://github.com/quchangle1/LLM-Tool-Survey。

🔬 方法详解

问题定义:现有的大型语言模型在处理复杂任务时,常常受限于自身知识和推理能力。为了增强LLM的能力,一种有效的方法是让LLM学会使用外部工具,例如搜索引擎、计算器、数据库等。然而,现有的工具学习研究较为分散,缺乏系统性的组织和总结,这给研究人员和开发者带来了挑战。

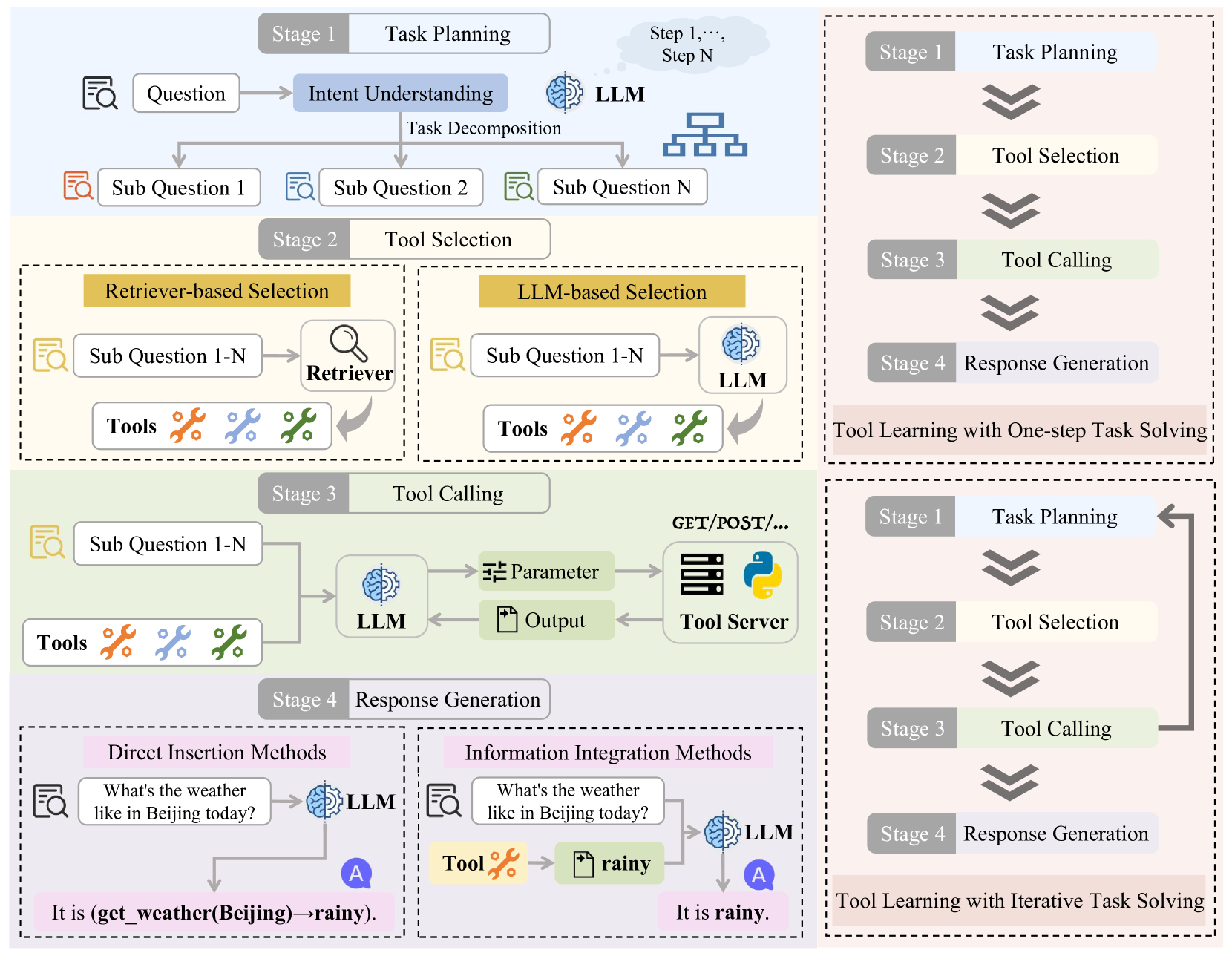

核心思路:该综述的核心思路是从“为什么”和“如何”两个角度对LLM的工具学习进行全面分析。 “为什么”侧重于分析工具学习的优势和必要性,包括工具集成带来的好处以及工具学习范例本身的优势。 “如何”侧重于分析工具学习的具体实现方法,包括任务规划、工具选择、工具调用和响应生成等关键阶段。

技术框架:该综述的技术框架主要围绕工具学习的流程展开,包括以下四个主要阶段: 1. 任务规划:将复杂任务分解为一系列子任务。 2. 工具选择:根据子任务的需求选择合适的工具。 3. 工具调用:使用选定的工具执行子任务。 4. 响应生成:根据工具的输出生成最终的响应。

关键创新:该综述的关键创新在于对LLM工具学习进行了系统性的梳理和总结,提出了一个清晰的框架,涵盖了工具学习的各个方面。此外,该综述还对现有的基准和评估方法进行了分类,并讨论了当前面临的挑战和未来的研究方向。

关键设计:该综述并没有提出新的算法或模型,而是对现有研究进行了整理和分析。在“为什么”部分,作者从六个方面分析了工具学习的优势。在“如何”部分,作者根据工具学习的四个关键阶段对文献进行了分类。此外,作者还维护了一个GitHub仓库,用于跟踪该领域的最新进展。

🖼️ 关键图片

📊 实验亮点

该综述系统地整理了LLM工具学习领域的研究进展,总结了现有方法和评估基准,并指出了未来研究方向。通过GitHub仓库持续跟踪最新论文和资源,为研究人员提供了一个宝贵的参考平台。该综述为理解和推进LLM工具学习提供了坚实的基础。

🎯 应用场景

该研究为大型语言模型在各个领域的应用提供了新的思路,例如智能客服、自动编程、科学研究等。通过工具学习,LLM可以更好地利用外部资源,解决更加复杂和实际的问题,从而提高工作效率和智能化水平。未来的研究可以进一步探索如何更有效地利用工具,以及如何开发更智能的工具。

📄 摘要(原文)

Recently, tool learning with large language models (LLMs) has emerged as a promising paradigm for augmenting the capabilities of LLMs to tackle highly complex problems. Despite growing attention and rapid advancements in this field, the existing literature remains fragmented and lacks systematic organization, posing barriers to entry for newcomers. This gap motivates us to conduct a comprehensive survey of existing works on tool learning with LLMs. In this survey, we focus on reviewing existing literature from the two primary aspects (1) why tool learning is beneficial and (2) how tool learning is implemented, enabling a comprehensive understanding of tool learning with LLMs. We first explore the "why" by reviewing both the benefits of tool integration and the inherent benefits of the tool learning paradigm from six specific aspects. In terms of "how", we systematically review the literature according to a taxonomy of four key stages in the tool learning workflow: task planning, tool selection, tool calling, and response generation. Additionally, we provide a detailed summary of existing benchmarks and evaluation methods, categorizing them according to their relevance to different stages. Finally, we discuss current challenges and outline potential future directions, aiming to inspire both researchers and industrial developers to further explore this emerging and promising area. We also maintain a GitHub repository to continually keep track of the relevant papers and resources in this rising area at https://github.com/quchangle1/LLM-Tool-Survey.