Detection-Correction Structure via General Language Model for Grammatical Error Correction

作者: Wei Li, Houfeng Wang

分类: cs.CL

发布日期: 2024-05-28

备注: Long paper. Accepted by ACL 2024 Main Conference

💡 一句话要点

提出基于通用语言模型GLM的检测-纠错结构DeCoGLM,用于语法纠错。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语法纠错 通用语言模型 检测-纠错结构 多任务学习 自回归模型

📋 核心要点

- 现有语法纠错方法主要集中于直接纠错,忽略了检测与纠错的整合,且大型语言模型在该范式上的探索不足。

- 论文提出DeCoGLM模型,利用GLM的特性,通过检测和纠错两个阶段实现更精确的语法纠错。

- 实验结果表明,DeCoGLM在英语和汉语语法纠错数据集上取得了与当前最优模型相当的性能。

📝 摘要(中文)

语法纠错(GEC)是一项致力于以最小的编辑来修正文本的任务,它可以解耦为检测和纠错两个组成部分。然而,以往的研究主要集中于直接纠错,没有尝试将两者整合到一个模型中。此外,大型语言模型(LLM)对检测-纠错范式的探索仍不充分。本文提出了一种基于通用语言模型(GLM)的集成检测-纠错结构,名为DeCoGLM。检测阶段采用容错检测模板,而纠错阶段利用自回归掩码填充进行局部错误纠正。通过对输入token的策略性组织和注意力掩码的修改,我们在单个模型中实现了多任务学习。我们的模型在英语和汉语GEC数据集上表现出与最先进模型相媲美的性能。进一步的实验证明了检测-纠错结构在LLM中的有效性,为GEC提供了一个有希望的方向。

🔬 方法详解

问题定义:论文旨在解决语法纠错任务中,现有方法缺乏检测和纠错一体化的问题。现有方法通常直接进行纠错,忽略了错误检测的重要性,导致纠错效率和准确率受限。此外,大型语言模型在检测-纠错范式上的潜力尚未充分挖掘。

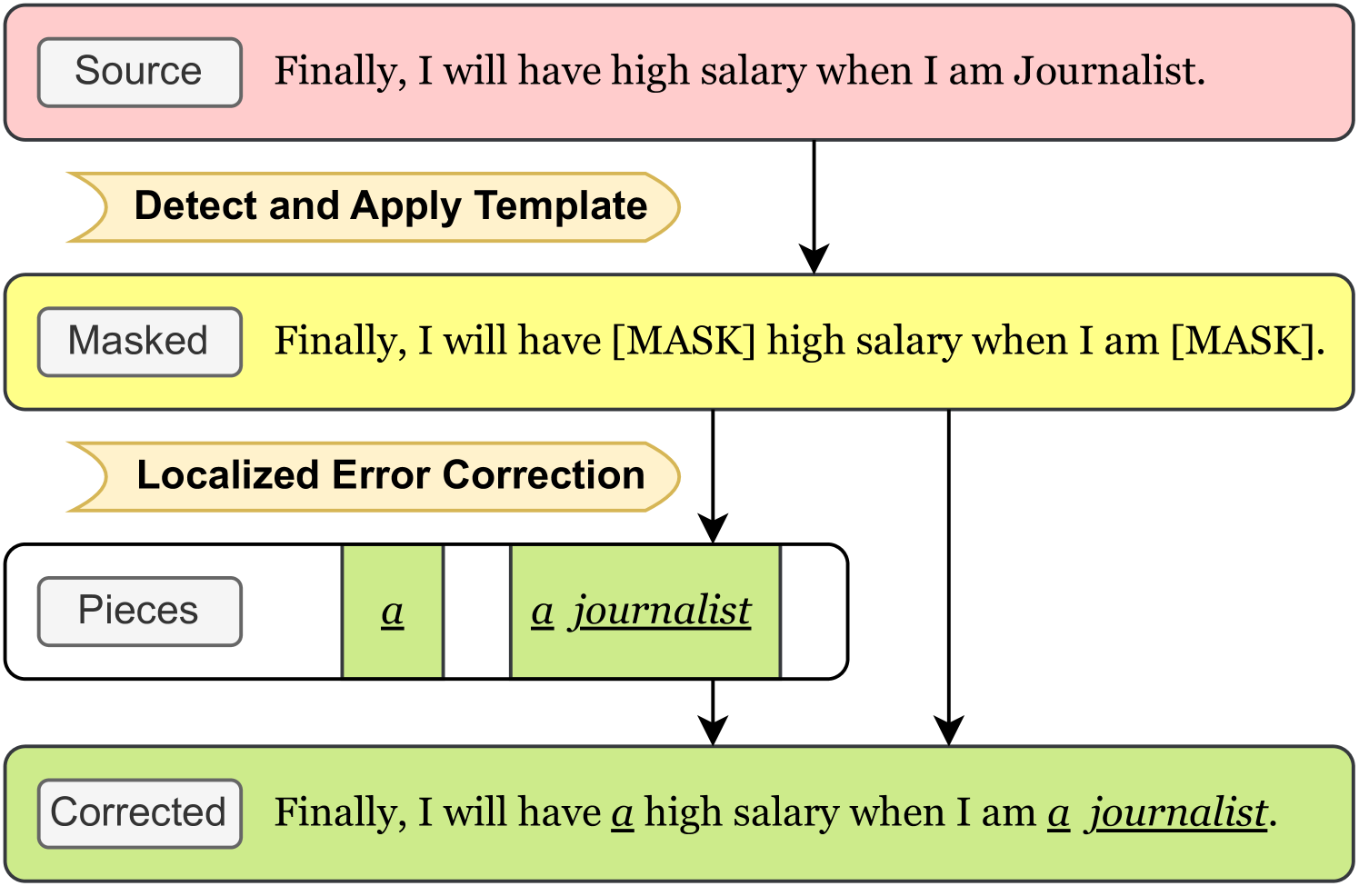

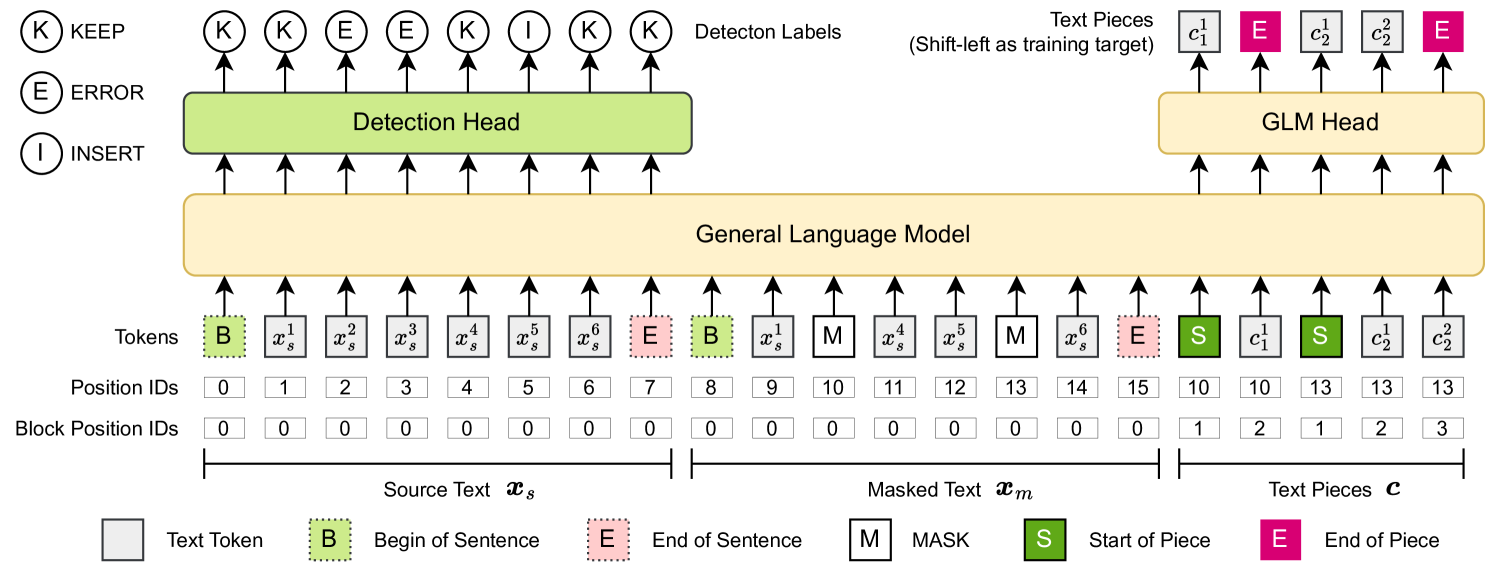

核心思路:论文的核心思路是将语法纠错任务分解为两个阶段:错误检测和错误纠正。通过首先检测出文本中的错误,然后针对性地进行纠正,可以提高纠错的准确性和效率。利用通用语言模型GLM的特性,将两个阶段整合到一个模型中,实现端到端的训练和推理。

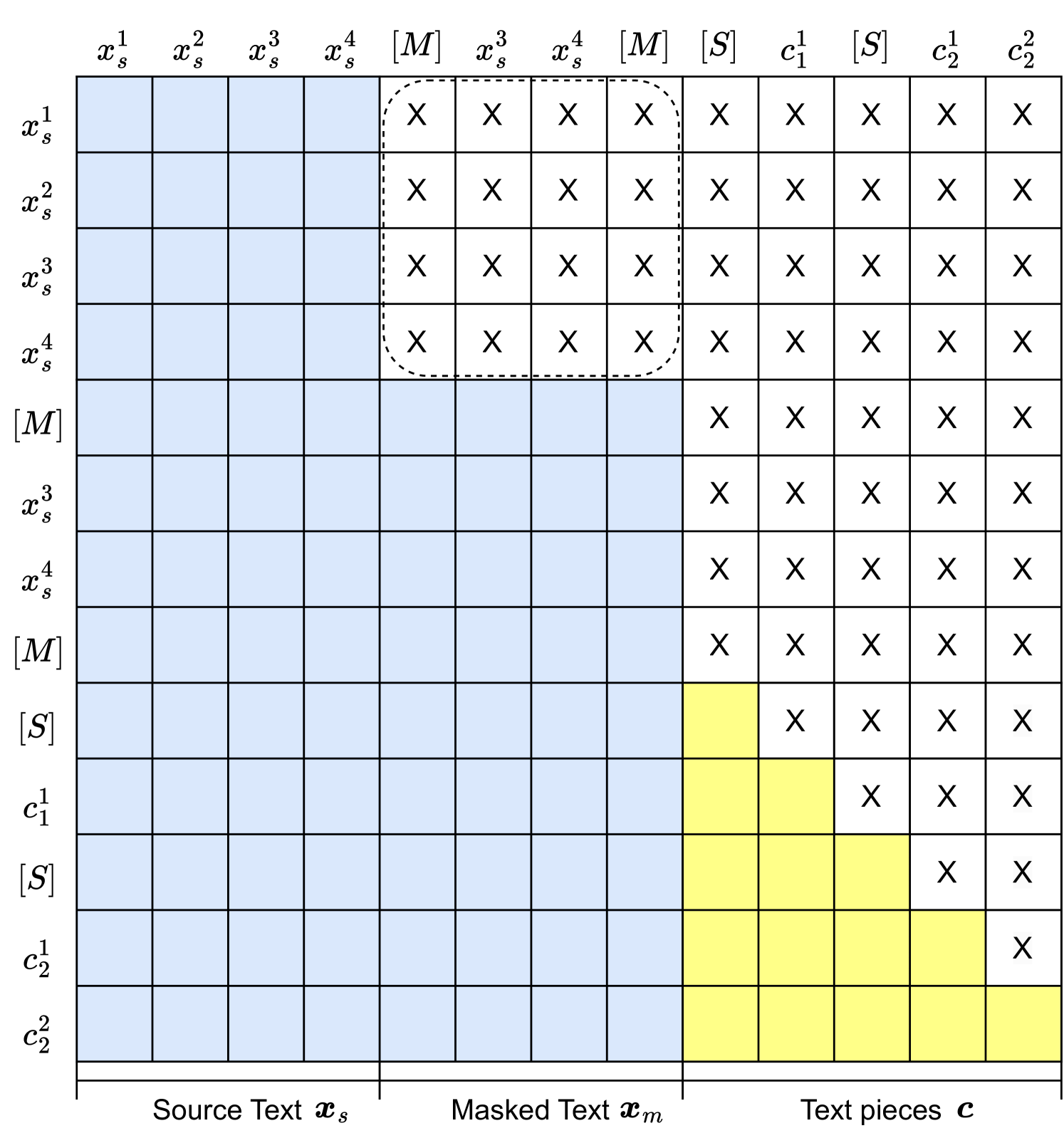

技术框架:DeCoGLM模型包含两个主要阶段:检测阶段和纠错阶段。在检测阶段,模型使用一个容错检测模板,用于识别文本中的错误。在纠错阶段,模型利用自回归掩码填充技术,对检测到的错误进行局部纠正。通过策略性地组织输入token和修改注意力掩码,模型可以在单个模型中同时学习检测和纠错任务。

关键创新:论文的关键创新在于提出了一个集成的检测-纠错结构DeCoGLM,该结构能够在一个模型中同时进行错误检测和错误纠正。与以往只关注直接纠错的方法不同,DeCoGLM通过显式地检测错误,提高了纠错的准确性和效率。此外,论文还探索了大型语言模型在检测-纠错范式中的应用,为GEC提供了一个新的研究方向。

关键设计:在检测阶段,论文设计了一个容错检测模板,允许模型在一定程度上容忍输入中的错误,从而提高检测的鲁棒性。在纠错阶段,论文采用了自回归掩码填充技术,通过预测被掩盖的token来纠正错误。此外,论文还通过修改注意力掩码,使得模型能够同时学习检测和纠错任务。具体的参数设置和网络结构细节未在摘要中详细说明,需要查阅原文。

🖼️ 关键图片

📊 实验亮点

DeCoGLM模型在英语和汉语语法纠错数据集上取得了与当前最优模型相当的性能,证明了检测-纠错结构在大型语言模型中的有效性。具体的性能数据和提升幅度需要在原文中查找。该模型为语法纠错任务提供了一个新的研究方向。

🎯 应用场景

该研究成果可应用于机器翻译、文本校对、教育辅助等领域。通过提高文本的语法正确性,可以提升机器翻译的质量,减少人工校对的工作量。在教育领域,该技术可以帮助学生提高写作水平,提供个性化的语法指导。未来,该技术有望应用于更广泛的自然语言处理任务中。

📄 摘要(原文)

Grammatical error correction (GEC) is a task dedicated to rectifying texts with minimal edits, which can be decoupled into two components: detection and correction. However, previous works have predominantly focused on direct correction, with no prior efforts to integrate both into a single model. Moreover, the exploration of the detection-correction paradigm by large language models (LLMs) remains underdeveloped. This paper introduces an integrated detection-correction structure, named DeCoGLM, based on the General Language Model (GLM). The detection phase employs a fault-tolerant detection template, while the correction phase leverages autoregressive mask infilling for localized error correction. Through the strategic organization of input tokens and modification of attention masks, we facilitate multi-task learning within a single model. Our model demonstrates competitive performance against the state-of-the-art models on English and Chinese GEC datasets. Further experiments present the effectiveness of the detection-correction structure in LLMs, suggesting a promising direction for GEC.