Bayesian WeakS-to-Strong from Text Classification to Generation

作者: Ziyun Cui, Ziyang Zhang, Guangzhi Sun, Wen Wu, Chao Zhang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-05-24 (更新: 2025-03-12)

备注: Accepted by ICLR2025

💡 一句话要点

提出基于贝叶斯弱监督的WeakS-to-Strong框架,提升文本生成任务中强模型的可靠性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 弱监督学习 大型语言模型 模型对齐 贝叶斯方法 文本生成 直接偏好优化 Weak-to-Strong 模型集成

📋 核心要点

- 现有对齐技术难以适应日益复杂的大型语言模型,尤其是在弱监督场景下。

- 提出WeakS-to-Strong框架,通过集成多个弱模型模拟人类意见差异,并使用贝叶斯方法估计置信度。

- 将WeakS-to-Strong应用于文本生成任务,并结合直接偏好优化,提升学生模型的偏好学习能力。

📝 摘要(中文)

随着大型语言模型日益复杂,如何进行对齐成为关键问题,尤其是在人类只能提供弱监督的情况下。本文将Weak-to-Strong方法扩展到WeakS-to-Strong,通过模拟人类意见的多样性,利用弱模型的集成进行监督。采用贝叶斯方法估计置信度分数,以指导WeakS-to-Strong的泛化。此外,还将WeakS-to-Strong的应用从文本分类扩展到文本生成任务,并探索了更高级的监督策略。最后,应用直接偏好优化(Direct Preference Optimization, DPO)来提升学生模型的偏好学习能力,超越了基本的教师强制学习框架。实验结果表明,该方法能够有效提高强学生模型的可靠性,展现了超对齐的潜力。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在弱监督条件下对齐的问题。现有方法难以有效利用弱监督信号,并且无法模拟人类意见的多样性,导致训练出的模型可靠性不足。

核心思路:核心思路是利用多个弱模型的集成(WeakS)来模拟人类意见的多样性,并使用贝叶斯方法估计每个弱模型的置信度,从而更有效地指导强模型的训练。通过这种方式,可以提高强模型在弱监督条件下的泛化能力和可靠性。

技术框架:整体框架包括以下几个主要阶段:1) 训练多个弱模型,每个模型代表一种可能的弱监督信号。2) 使用贝叶斯方法估计每个弱模型的置信度。3) 利用弱模型的集成和置信度信息,训练一个更强的学生模型。4) 在文本生成任务中,使用更高级的监督策略,例如直接偏好优化(DPO),进一步提升学生模型的性能。

关键创新:关键创新在于将Weak-to-Strong方法扩展到WeakS-to-Strong,通过集成多个弱模型来模拟人类意见的多样性。此外,使用贝叶斯方法估计置信度,可以更准确地评估每个弱模型的可靠性。将DPO应用于WeakS-to-Strong框架,进一步提升了学生模型的偏好学习能力。

关键设计:贝叶斯置信度估计的具体方法未知,论文中可能使用了某种特定的贝叶斯模型或近似推断方法。DPO的具体实现细节也未知,可能涉及到特定的奖励函数设计和优化算法。弱模型的数量和选择策略也是关键的设计参数,需要根据具体的任务和数据集进行调整。

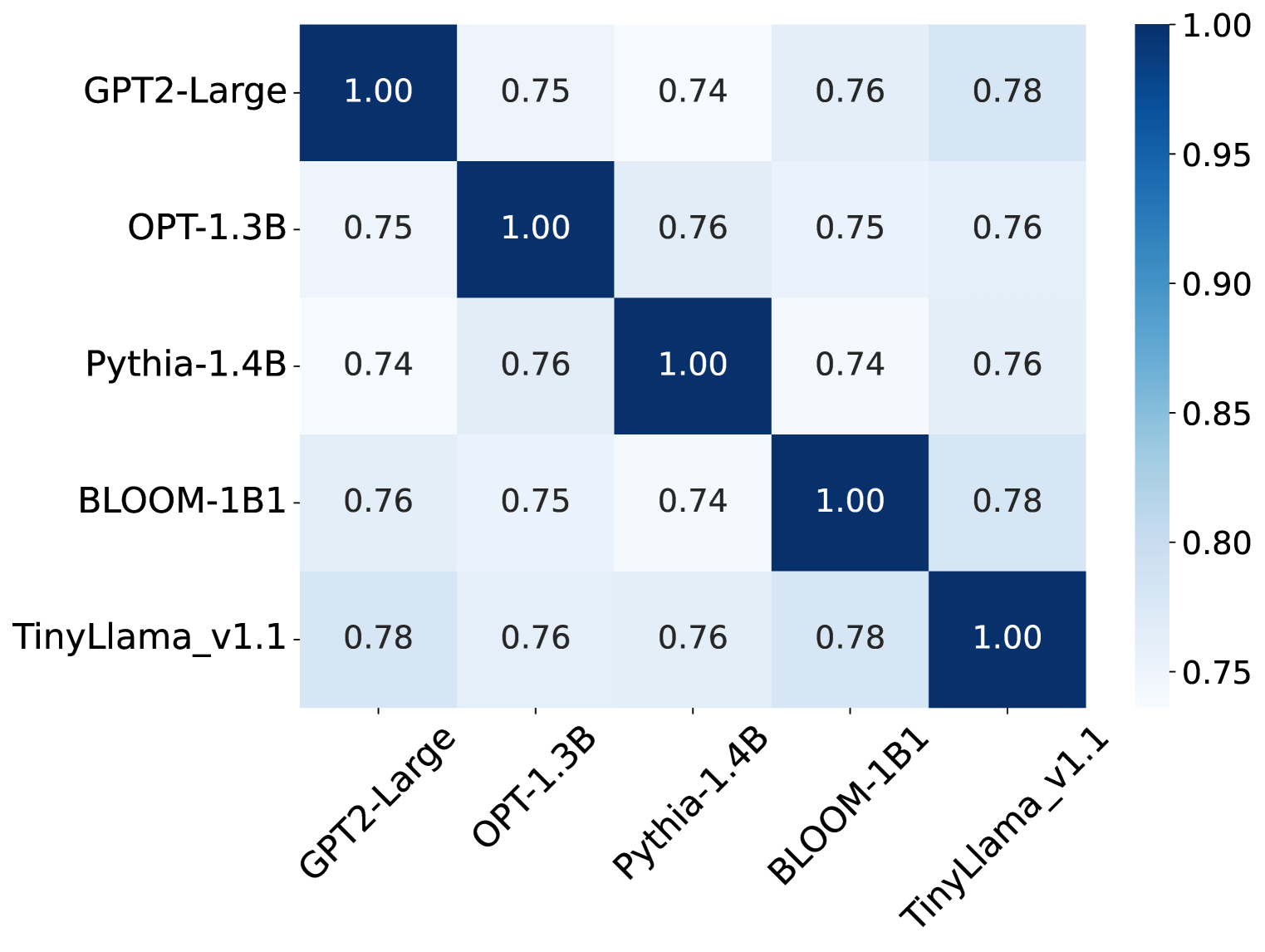

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的WeakS-to-Strong框架的有效性,结果表明,该方法能够显著提高强学生模型的可靠性,尤其是在文本生成任务中。具体性能数据未知,但论文强调了该方法在超对齐方面的潜力,暗示了其在提升模型安全性和可控性方面的积极作用。

🎯 应用场景

该研究成果可应用于各种需要弱监督的大型语言模型对齐场景,例如:自动生成摘要、机器翻译、对话生成等。通过提高模型的可靠性和泛化能力,可以减少人工干预,降低标注成本,并提升模型的实际应用价值。未来,该方法有望应用于更复杂的任务和更大型的模型,推动人工智能的超对齐研究。

📄 摘要(原文)

Advances in large language models raise the question of how alignment techniques will adapt as models become increasingly complex and humans will only be able to supervise them weakly. Weak-to-Strong mimics such a scenario where weak model supervision attempts to harness the full capabilities of a much stronger model. This work extends Weak-to-Strong to WeakS-to-Strong by exploring an ensemble of weak models which simulate the variability in human opinions. Confidence scores are estimated using a Bayesian approach to guide the WeakS-to-Strong generalization. Furthermore, we extend the application of WeakS-to-Strong from text classification tasks to text generation tasks where more advanced strategies are investigated for supervision. Moreover, direct preference optimization is applied to advance the student model's preference learning, beyond the basic learning framework of teacher forcing. Results demonstrate the effectiveness of the proposed approach for the reliability of a strong student model, showing potential for superalignment.