Large Language Models can Deliver Accurate and Interpretable Time Series Anomaly Detection

作者: Jun Liu, Chaoyun Zhang, Jiaxu Qian, Minghua Ma, Si Qin, Chetan Bansal, Qingwei Lin, Saravan Rajmohan, Dongmei Zhang

分类: cs.CL

发布日期: 2024-05-24

💡 一句话要点

提出LLMAD,利用大语言模型实现精确且可解释的时间序列异常检测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列异常检测 大语言模型 可解释性 思维链 上下文学习

📋 核心要点

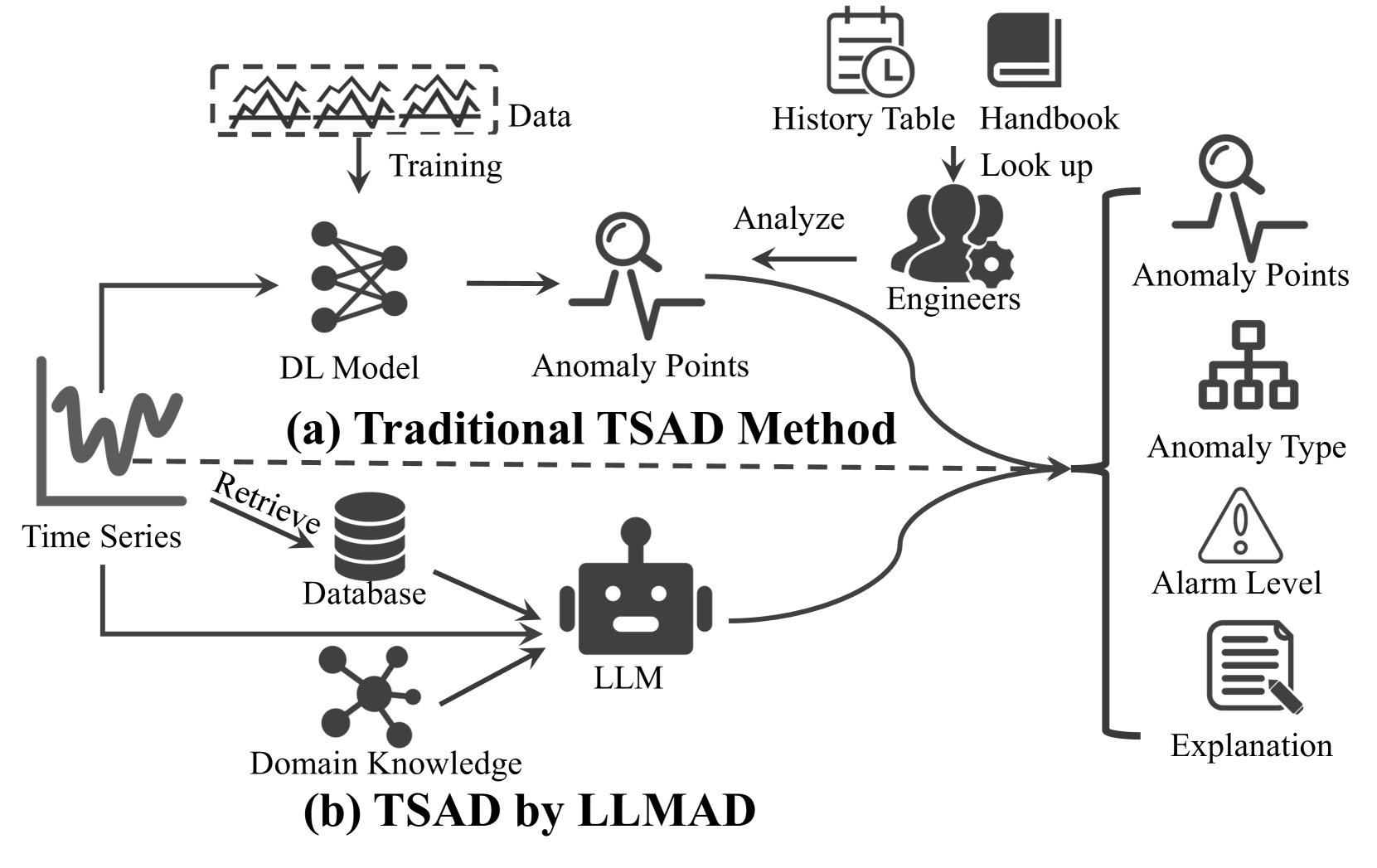

- 传统时间序列异常检测模型依赖深度学习,需要大量训练数据,且缺乏可解释性,难以应用于实际场景。

- LLMAD利用大语言模型的上下文学习能力,通过检索相似时间序列片段并结合思维链推理,实现异常检测。

- 实验表明,LLMAD在三个数据集上取得了与SOTA深度学习方法相当的性能,并提供了可解释的异常检测结果。

📝 摘要(中文)

时间序列异常检测(TSAD)在各个行业中起着关键作用,它通过识别偏离标准趋势的非典型模式来维护系统完整性并实现快速响应措施。传统的TSAD模型通常依赖于深度学习,需要大量的训练数据,并且作为黑盒运行,缺乏对检测到的异常的可解释性。为了解决这些挑战,我们提出了一种新的TSAD方法LLMAD,该方法采用大型语言模型(LLM)来提供准确且可解释的TSAD结果。LLMAD创新性地应用LLM进行上下文异常检测,通过检索正负相似的时间序列片段,显著提高了LLM的有效性。此外,LLMAD采用异常检测思维链(AnoCoT)方法来模拟专家逻辑进行决策。该方法进一步提高了其性能,并使LLMAD能够通过多种视角为其检测提供解释,这对于用户决策尤其重要。在三个数据集上的实验表明,我们的LLMAD实现了与最先进的深度学习方法相当的检测性能,同时为检测提供了卓越的可解释性。据我们所知,这是第一个直接使用LLM进行TSAD的工作。

🔬 方法详解

问题定义:传统时间序列异常检测方法,特别是基于深度学习的方法,通常需要大量的标注数据进行训练,并且模型本身是一个黑盒,难以解释其检测结果。这限制了它们在实际应用中的部署,因为用户需要理解为什么某个时间点被认为是异常的,以便采取适当的措施。

核心思路:LLMAD的核心思路是利用大型语言模型(LLM)强大的上下文学习和推理能力,将时间序列异常检测问题转化为一个语言理解和生成问题。通过检索与待检测时间序列相似的正常和异常片段,并结合思维链(Chain-of-Thought)推理,LLM可以判断当前时间点是否为异常,并给出相应的解释。

技术框架:LLMAD的整体框架包括以下几个主要模块:1) 时间序列嵌入模块:将时间序列数据转换为向量表示。2) 相似片段检索模块:从历史数据中检索与当前时间序列片段相似的正常和异常片段。3) 异常检测思维链(AnoCoT)模块:利用LLM,结合检索到的相似片段,通过思维链的方式进行推理,判断当前时间点是否为异常,并生成解释。

关键创新:LLMAD的关键创新在于将大型语言模型直接应用于时间序列异常检测,并提出了异常检测思维链(AnoCoT)方法。AnoCoT模仿专家进行异常检测的逻辑,使得LLM能够提供可解释的检测结果。此外,通过检索相似的正常和异常片段,LLMAD能够更好地利用LLM的上下文学习能力。

关键设计:在相似片段检索模块中,可以使用不同的距离度量方法(如欧氏距离、余弦相似度)来衡量时间序列片段之间的相似性。在AnoCoT模块中,需要设计合适的prompt,引导LLM进行推理和解释生成。具体的prompt设计可以参考专家进行异常检测的逻辑,例如,首先判断当前时间点是否偏离了历史趋势,然后分析可能的原因。

🖼️ 关键图片

📊 实验亮点

LLMAD在三个公开数据集上进行了评估,结果表明,其检测性能与最先进的深度学习方法相当,同时提供了卓越的可解释性。与传统的黑盒模型相比,LLMAD能够生成自然语言解释,帮助用户理解异常检测的原因,从而提高用户对模型的信任度。

🎯 应用场景

LLMAD可应用于各种需要时间序列异常检测的领域,如工业生产、金融风控、网络安全、医疗健康等。它可以帮助用户及时发现系统中的异常行为,并提供可解释的分析结果,从而辅助用户进行决策,降低风险,提高效率。例如,在工业生产中,LLMAD可以用于检测设备故障;在金融风控中,可以用于识别欺诈交易;在网络安全中,可以用于检测恶意攻击。

📄 摘要(原文)

Time series anomaly detection (TSAD) plays a crucial role in various industries by identifying atypical patterns that deviate from standard trends, thereby maintaining system integrity and enabling prompt response measures. Traditional TSAD models, which often rely on deep learning, require extensive training data and operate as black boxes, lacking interpretability for detected anomalies. To address these challenges, we propose LLMAD, a novel TSAD method that employs Large Language Models (LLMs) to deliver accurate and interpretable TSAD results. LLMAD innovatively applies LLMs for in-context anomaly detection by retrieving both positive and negative similar time series segments, significantly enhancing LLMs' effectiveness. Furthermore, LLMAD employs the Anomaly Detection Chain-of-Thought (AnoCoT) approach to mimic expert logic for its decision-making process. This method further enhances its performance and enables LLMAD to provide explanations for their detections through versatile perspectives, which are particularly important for user decision-making. Experiments on three datasets indicate that our LLMAD achieves detection performance comparable to state-of-the-art deep learning methods while offering remarkable interpretability for detections. To the best of our knowledge, this is the first work that directly employs LLMs for TSAD.