Generalizable and Scalable Multistage Biomedical Concept Normalization Leveraging Large Language Models

作者: Nicholas J Dobbins

分类: cs.CL

发布日期: 2024-05-24

💡 一句话要点

利用大型语言模型提升生物医学概念归一化性能与泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生物医学概念归一化 大型语言模型 自然语言处理 文本挖掘 UMLS 信息抽取 临床数据

📋 核心要点

- 生物医学文本数据丰富但非结构化,概念归一化是关键,现有方法难以充分利用上下文信息。

- 利用LLM生成多样化短语并进行概念剪枝,提升归一化系统的召回率和准确率。

- 实验表明,GPT-3.5-turbo和Vicuna等LLM能显著提升MetaMapLite、QuickUMLS和BM25的性能。

📝 摘要(中文)

背景:生物医学实体归一化对于生物医学研究至关重要,因为自由文本临床数据(如病程记录)的丰富性通常只有在将词语和短语转换为适合分析的结构化和编码表示后才能充分利用。大型语言模型(LLM)在各种自然语言处理(NLP)任务中表现出巨大的潜力和高性能,但它们在归一化中的应用仍未得到充分研究。方法:我们将专有和开源LLM与生物医学研究中常用的几种基于规则的归一化系统相结合。我们采用了一种两步LLM集成方法:(1)使用LLM生成源话语的替代措辞,以及(2)使用各种提示方法来修剪候选UMLS概念。我们使用$F_β$(倾向于召回率高于精确率)和F1来衡量结果。结果:我们评估了来自公开可用的人工注释生物医学摘要数据集中的总共5,523个概念术语和文本上下文。结合GPT-3.5-turbo使归一化系统的整体$F_β$和F1分别提高了+9.5和+7.3(MetaMapLite),+13.9和+10.9(QuickUMLS)以及+10.5和+10.3(BM25),而开源Vicuna模型实现了+10.8和+12.2(MetaMapLite),+14.7和+15(QuickUMLS)以及+15.6和+18.7(BM25)。结论:现有的通用LLM(包括专有和开源)可以大规模利用,以显著提高使用现有工具的归一化性能,而无需进行微调。

🔬 方法详解

问题定义:生物医学概念归一化旨在将自然语言描述的生物医学概念映射到标准化的医学术语或编码体系(如UMLS)。现有方法,如MetaMapLite、QuickUMLS和BM25等,在处理复杂或模糊的文本时,容易出现召回率不足的问题,无法充分利用上下文信息,导致归一化结果不准确。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大文本生成和理解能力,辅助现有的归一化系统。具体来说,首先使用LLM生成输入文本的多样化表达,增加候选概念的覆盖范围;然后,利用LLM对候选概念进行剪枝,去除不相关的概念,提高准确率。这种方法旨在弥补现有方法在上下文理解和语义泛化方面的不足。

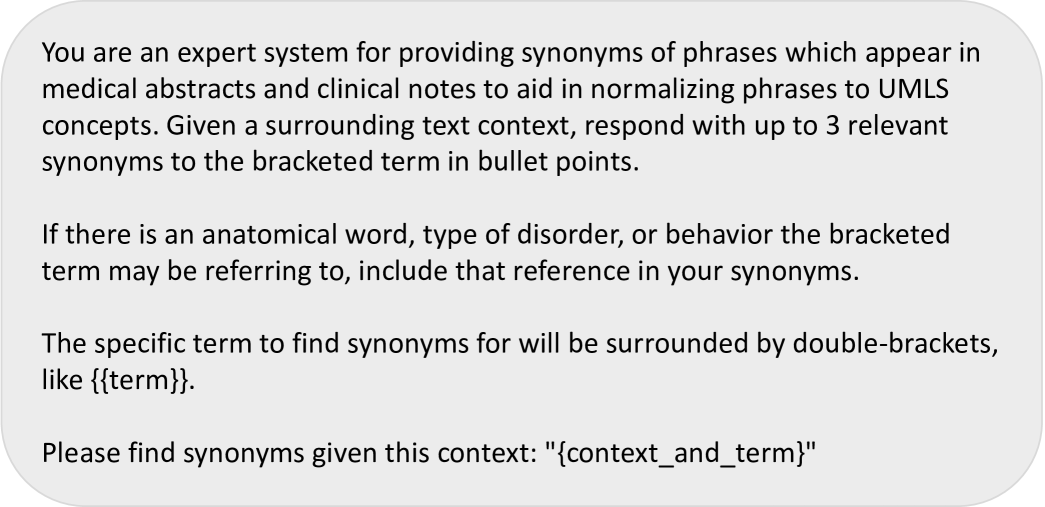

技术框架:整体框架包含两个主要阶段:1) 短语生成阶段:使用LLM(如GPT-3.5-turbo或Vicuna)根据输入的生物医学文本生成多个语义相似的短语变体。通过不同的prompting策略,引导LLM生成更符合医学语境的表达。2) 概念剪枝阶段:将生成的短语变体输入到现有的归一化系统(如MetaMapLite、QuickUMLS或BM25)中,得到候选概念集合。然后,使用LLM对这些候选概念进行排序和筛选,选择最相关的概念作为最终的归一化结果。

关键创新:该论文的关键创新在于将大型语言模型引入到生物医学概念归一化流程中,并设计了一种两阶段的集成方法。与传统的基于规则或统计的方法相比,LLM能够更好地理解上下文信息,生成更丰富的短语变体,并对候选概念进行更准确的评估。此外,该方法无需对LLM进行微调,可以直接利用其通用能力,降低了应用成本。

关键设计:在短语生成阶段,论文尝试了不同的prompting策略,以引导LLM生成更符合医学语境的短语。在概念剪枝阶段,论文使用了不同的排序和筛选方法,例如基于LLM的语义相似度计算。此外,论文还采用了$F_β$指标,其中β>1,以更重视召回率,因为在生物医学领域,尽可能找到所有相关的概念比确保每个概念都绝对准确更为重要。

🖼️ 关键图片

📊 实验亮点

实验结果表明,将GPT-3.5-turbo和Vicuna等LLM集成到现有的归一化系统中,可以显著提高性能。例如,结合GPT-3.5-turbo后,MetaMapLite的$F_β$和F1分别提高了+9.5和+7.3,而Vicuna则分别提高了+10.8和+12.2。在QuickUMLS和BM25上,也观察到了类似的性能提升,表明该方法具有良好的泛化能力。

🎯 应用场景

该研究成果可广泛应用于生物医学信息抽取、临床决策支持、药物研发等领域。通过提高生物医学文本数据的标准化程度,可以促进知识发现、数据共享和跨领域合作。未来,该方法有望应用于更复杂的生物医学文本处理任务,例如病历分析、文献挖掘等。

📄 摘要(原文)

Background: Biomedical entity normalization is critical to biomedical research because the richness of free-text clinical data, such as progress notes, can often be fully leveraged only after translating words and phrases into structured and coded representations suitable for analysis. Large Language Models (LLMs), in turn, have shown great potential and high performance in a variety of natural language processing (NLP) tasks, but their application for normalization remains understudied. Methods: We applied both proprietary and open-source LLMs in combination with several rule-based normalization systems commonly used in biomedical research. We used a two-step LLM integration approach, (1) using an LLM to generate alternative phrasings of a source utterance, and (2) to prune candidate UMLS concepts, using a variety of prompting methods. We measure results by $F_β$, where we favor recall over precision, and F1. Results: We evaluated a total of 5,523 concept terms and text contexts from a publicly available dataset of human-annotated biomedical abstracts. Incorporating GPT-3.5-turbo increased overall $F_β$ and F1 in normalization systems +9.5 and +7.3 (MetaMapLite), +13.9 and +10.9 (QuickUMLS), and +10.5 and +10.3 (BM25), while the open-source Vicuna model achieved +10.8 and +12.2 (MetaMapLite), +14.7 and +15 (QuickUMLS), and +15.6 and +18.7 (BM25). Conclusions: Existing general-purpose LLMs, both propriety and open-source, can be leveraged at scale to greatly improve normalization performance using existing tools, with no fine-tuning.