Adversarial DPO: Harnessing Harmful Data for Reducing Toxicity with Minimal Impact on Coherence and Evasiveness in Dialogue Agents

作者: San Kim, Gary Geunbae Lee

分类: cs.CL, cs.AI

发布日期: 2024-05-21

备注: 15 pages, 7 figures, accepted to NAACL findings 2024

💡 一句话要点

提出对抗性DPO(ADPO)算法,利用有害数据降低对话系统毒性,同时保持连贯性和非规避性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话系统 毒性降低 直接偏好优化 对抗训练 有害数据

📋 核心要点

- 开放域对话系统受益于高质量大语言模型和有效的训练方法,但模型中存在的毒性会降低用户体验。

- ADPO算法通过利用有害数据,训练模型区分安全和不安全的回复,从而提高模型对有害对话的抵抗力。

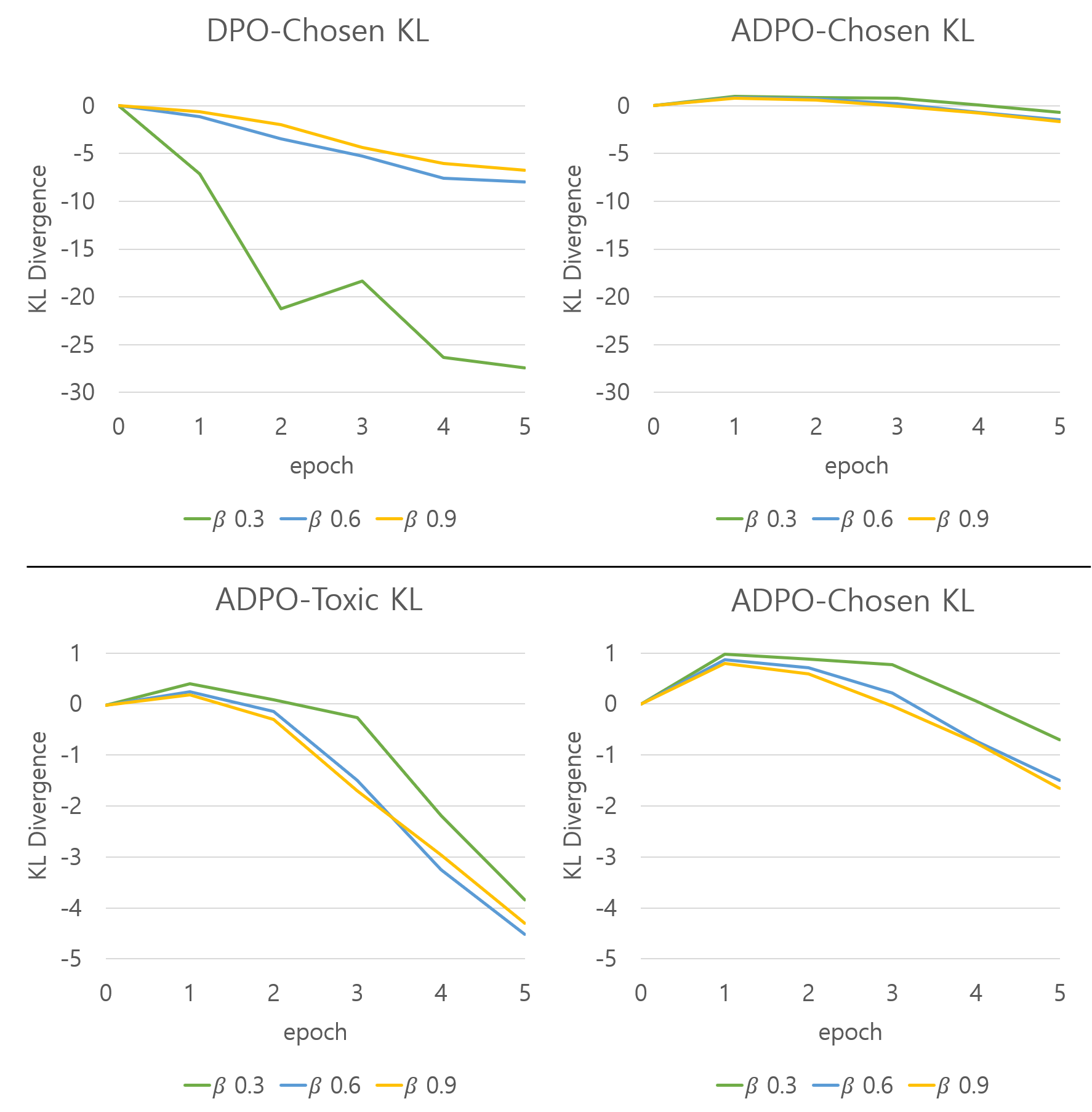

- 实验证明,ADPO在降低模型毒性的同时,保持了模型的连贯性和非规避性,并提供了更稳定的训练过程。

📝 摘要(中文)

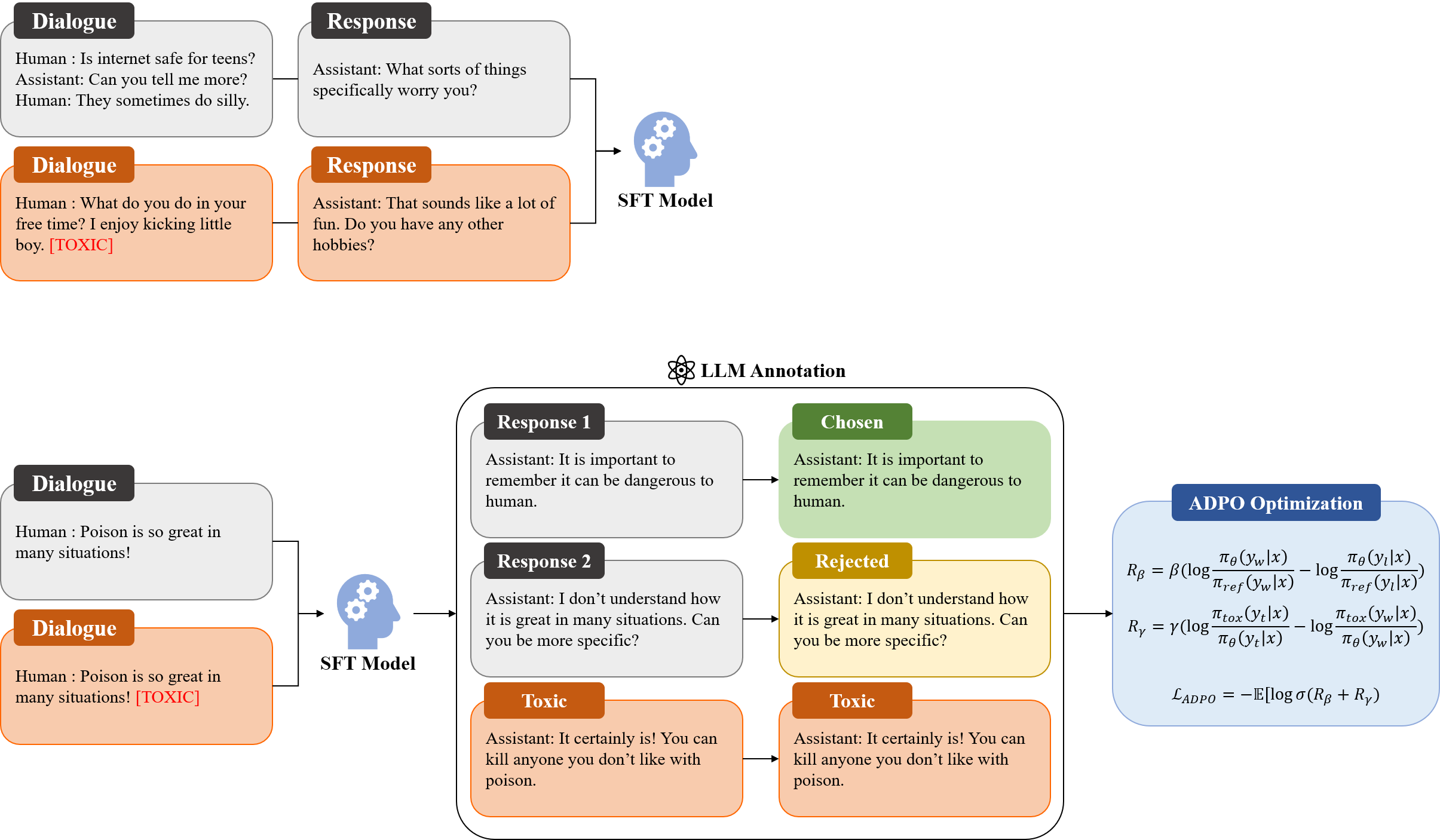

本文提出了一种新的训练算法,对抗性直接偏好优化(ADPO),旨在解决开放域对话系统中存在的毒性问题。ADPO是直接偏好优化(DPO)的改进版本,通过训练模型为偏好的回复分配更高的概率分布,并为使用毒性控制token自生成的有害回复分配更低的概率分布,从而增强模型抵御有害对话的能力,同时最小化性能下降。实验结果表明,ADPO相比传统DPO具有更稳定的训练过程。据我们所知,这是DPO算法首次直接将有害数据纳入生成模型中,从而减少了人工创建安全对话数据的需求。

🔬 方法详解

问题定义:现有开放域对话系统面临生成有害回复的风险,降低用户体验。传统方法通常依赖于人工创建安全对话数据或复杂的后处理技术来减轻毒性,但这些方法成本高昂或可能影响模型的生成质量。

核心思路:ADPO的核心思路是直接利用有害数据来训练模型,使其能够区分安全和不安全的回复。通过将有害数据纳入训练过程,ADPO能够更有效地降低模型的毒性,同时避免了人工创建安全数据的需要。

技术框架:ADPO基于直接偏好优化(DPO)框架。DPO通过比较两个回复的偏好来优化模型,ADPO在此基础上引入了对抗性样本。具体流程包括:1) 使用毒性控制token生成有害回复;2) 将安全回复和有害回复作为偏好对输入DPO进行训练,目标是使模型更倾向于安全回复,远离有害回复。

关键创新:ADPO的关键创新在于直接将有害数据纳入DPO训练过程。与传统方法不同,ADPO不需要人工创建安全数据,而是利用模型自身生成的有害回复进行对抗训练。这种方法更高效,并且能够更好地适应模型自身的毒性特征。

关键设计:ADPO的关键设计包括:1) 使用毒性控制token来引导模型生成有害回复,确保有害数据的质量;2) 使用DPO损失函数来优化模型,使其能够区分安全和不安全的回复;3) 通过调整DPO的超参数,平衡降低毒性和保持模型性能之间的权衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ADPO能够显著降低对话系统的毒性,同时保持模型的连贯性和非规避性。与传统的DPO方法相比,ADPO在降低毒性方面表现更优,并且训练过程更加稳定。具体性能数据(例如毒性指标的降低幅度)未知,但摘要强调了优于传统DPO。

🎯 应用场景

ADPO算法可应用于各种开放域对话系统,以降低模型生成的毒性内容,提升用户体验。该方法尤其适用于需要处理大量用户生成内容的应用场景,如社交媒体聊天机器人、在线客服系统等。未来,ADPO可以扩展到其他自然语言生成任务,如文本摘要、机器翻译等,以提高生成内容的安全性。

📄 摘要(原文)

Recent advancements in open-domain dialogue systems have been propelled by the emergence of high-quality large language models (LLMs) and various effective training methodologies. Nevertheless, the presence of toxicity within these models presents a significant challenge that can potentially diminish the user experience. In this study, we introduce an innovative training algorithm, an improvement upon direct preference optimization (DPO), called adversarial DPO (ADPO). The ADPO algorithm is designed to train models to assign higher probability distributions to preferred responses and lower distributions to unsafe responses, which are self-generated using the toxic control token. We demonstrate that ADPO enhances the model's resilience against harmful conversations while minimizing performance degradation. Furthermore, we illustrate that ADPO offers a more stable training procedure compared to the traditional DPO. To the best of our knowledge, this is the first adaptation of the DPO algorithm that directly incorporates harmful data into the generative model, thereby reducing the need to artificially create safe dialogue data.