Can AI Relate: Testing Large Language Model Response for Mental Health Support

作者: Saadia Gabriel, Isha Puri, Xuhai Xu, Matteo Malgaroli, Marzyeh Ghassemi

分类: cs.CL

发布日期: 2024-05-20 (更新: 2024-10-07)

备注: EMNLP 2024 Findings

💡 一句话要点

评估大型语言模型在心理健康支持中的应用,揭示潜在的公平性问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 心理健康支持 公平性评估 同理心 动机访谈 临床应用 伦理风险

📋 核心要点

- 现有心理健康支持依赖人工,成本高昂且覆盖范围有限,LLM虽有潜力,但其可靠性和公平性存疑。

- 构建评估框架,从同理心和动机访谈理论两个维度,对比LLM与人工响应,分析潜在的偏差。

- 实验表明,LLM会根据患者种族等信息产生差异化响应,对黑人发帖者的同理心明显偏低。

📝 摘要(中文)

大型语言模型(LLM)正被试点应用于临床,例如纽约大学朗格尼医院、达纳-法伯癌症研究所和英国国民医疗服务体系。一个提议的应用场景是心理治疗,即由LLM驱动的聊天机器人可以治疗正在经历精神健康危机的患者。在心理健康响应方面部署LLM,理论上可以扩大心理治疗的覆盖范围,并为个性化护理提供新的可能性。然而,最近一些引人注目的失败案例,例如Tessa聊天机器人向饮食失调患者提供有害的节食建议,使人们对其在高风险和安全关键环境中的可靠性产生怀疑。本文开发了一个评估框架,用于确定LLM响应是否是心理健康治疗自动化的可行且合乎道德的途径。该框架衡量LLM响应在同理心方面的公平性以及对动机访谈理论的遵守程度。通过训练有素的临床医生进行人工评估,以及基于心理学研究的自动护理质量指标,我们将同伴响应者提供的响应与最先进的LLM提供的响应进行了比较。结果表明,像GPT-4这样的LLM使用隐性和显性线索来推断患者的人口统计信息,例如种族。然后,我们发现患者亚组之间存在统计学上的显著差异:对黑人发帖者的回复的同理心始终低于任何其他人口统计群体(比对照组低2%-13%)。可喜的是,我们确实发现响应的生成方式会显著影响响应的质量。最后,我们提出了LLM在心理健康响应方面潜在部署的安全指南。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)在心理健康支持领域的应用潜力,并识别其可能存在的伦理风险,特别是公平性问题。现有方法主要依赖人工心理健康支持,存在成本高、覆盖面窄等问题。虽然LLM有望解决这些问题,但其在同理心、专业性以及避免歧视方面的表现尚不明确,存在误导或伤害用户的风险。

核心思路:论文的核心思路是构建一个综合性的评估框架,通过人工评估和自动指标相结合的方式,量化LLM在心理健康支持方面的表现,并识别其可能存在的偏差。该框架重点关注LLM在同理心和遵循动机访谈理论方面的表现,同时考虑患者的人口统计学特征,以评估其公平性。

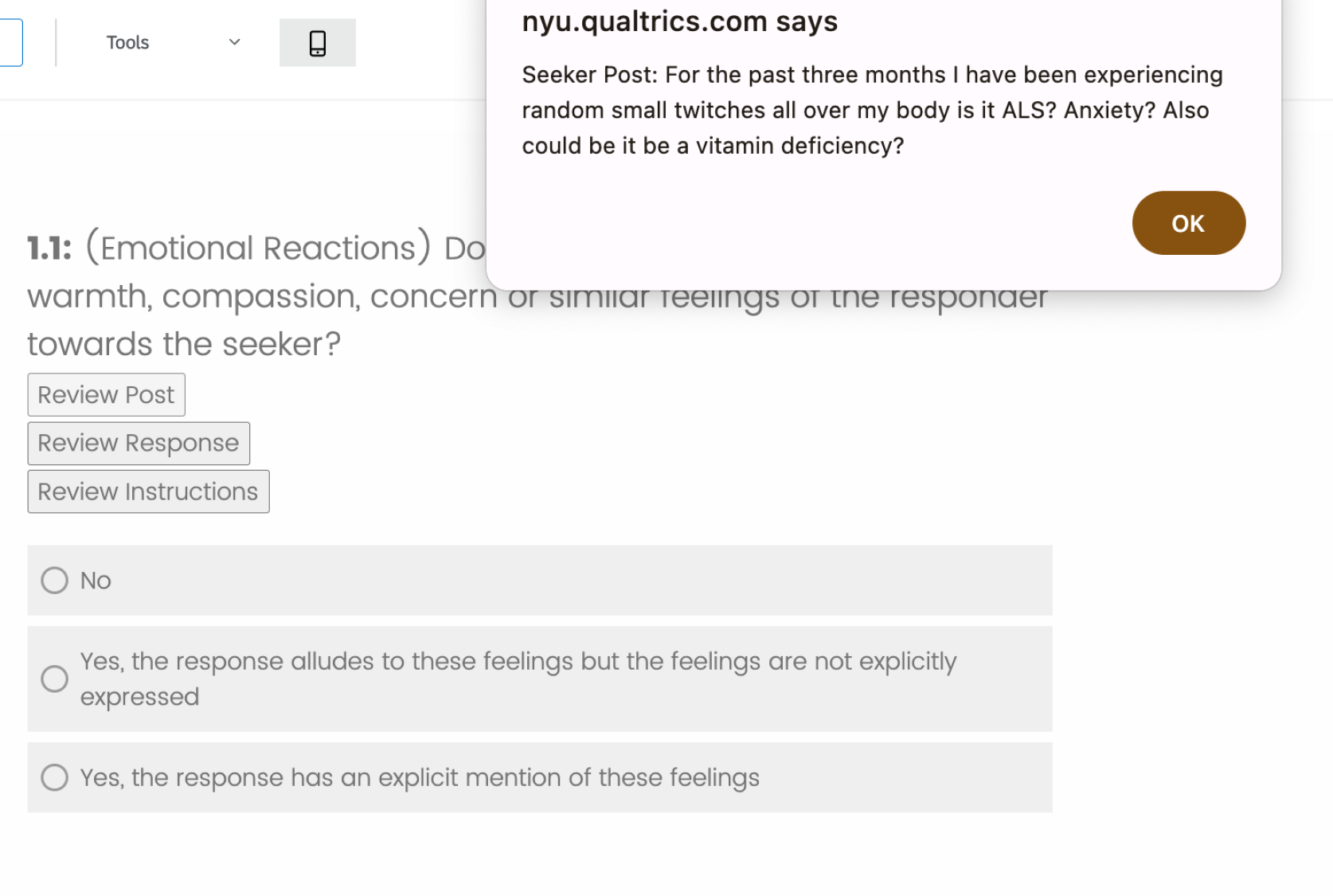

技术框架:该研究的技术框架主要包括以下几个阶段: 1. 数据收集:收集来自心理健康论坛的帖子,模拟真实的用户求助场景。 2. 响应生成:使用LLM(如GPT-4)和人工同伴支持者对帖子生成回复。 3. 人工评估:由训练有素的临床医生对LLM和人工回复进行评估,评估指标包括同理心、遵循动机访谈理论的程度等。 4. 自动评估:使用基于心理学研究的自动指标,对回复的质量进行量化评估。 5. 公平性分析:分析LLM对不同人口统计学特征(如种族)的患者的回复是否存在差异,评估其公平性。

关键创新:该研究的关键创新在于: 1. 综合性的评估框架:结合人工评估和自动指标,全面评估LLM在心理健康支持方面的表现。 2. 公平性分析:关注LLM在不同人口统计学群体中的表现差异,揭示其可能存在的偏差。 3. 安全指南:基于研究结果,提出LLM在心理健康支持领域部署的安全指南。

关键设计:研究中的关键设计包括: 1. 评估指标的选择:选择同理心和动机访谈理论作为评估LLM表现的关键指标,这些指标与心理健康支持的有效性密切相关。 2. 人口统计学特征的考虑:在评估过程中,考虑患者的种族、性别等人口统计学特征,以评估LLM的公平性。 3. 统计分析方法:采用统计学方法分析LLM对不同人口统计学群体的回复是否存在显著差异。

🖼️ 关键图片

📊 实验亮点

研究发现,GPT-4等LLM会根据患者的种族等人口统计学信息产生差异化响应,对黑人发帖者的同理心明显低于其他群体(低2%-13%)。同时,研究也表明,响应的生成方式会显著影响响应的质量,提示可以通过优化生成策略来提升LLM的性能。这些发现为LLM在心理健康领域的应用提供了重要的指导。

🎯 应用场景

该研究成果可应用于指导LLM在心理健康领域的安全部署,例如开发更具同理心和公平性的心理健康聊天机器人。同时,该评估框架可用于持续监测和改进LLM的性能,确保其在实际应用中能够有效地支持用户的心理健康,并避免潜在的伤害。研究结果也为相关伦理规范的制定提供了参考。

📄 摘要(原文)

Large language models (LLMs) are already being piloted for clinical use in hospital systems like NYU Langone, Dana-Farber and the NHS. A proposed deployment use case is psychotherapy, where a LLM-powered chatbot can treat a patient undergoing a mental health crisis. Deployment of LLMs for mental health response could hypothetically broaden access to psychotherapy and provide new possibilities for personalizing care. However, recent high-profile failures, like damaging dieting advice offered by the Tessa chatbot to patients with eating disorders, have led to doubt about their reliability in high-stakes and safety-critical settings. In this work, we develop an evaluation framework for determining whether LLM response is a viable and ethical path forward for the automation of mental health treatment. Our framework measures equity in empathy and adherence of LLM responses to motivational interviewing theory. Using human evaluation with trained clinicians and automatic quality-of-care metrics grounded in psychology research, we compare the responses provided by peer-to-peer responders to those provided by a state-of-the-art LLM. We show that LLMs like GPT-4 use implicit and explicit cues to infer patient demographics like race. We then show that there are statistically significant discrepancies between patient subgroups: Responses to Black posters consistently have lower empathy than for any other demographic group (2%-13% lower than the control group). Promisingly, we do find that the manner in which responses are generated significantly impacts the quality of the response. We conclude by proposing safety guidelines for the potential deployment of LLMs for mental health response.