MapCoder: Multi-Agent Code Generation for Competitive Problem Solving

作者: Md. Ashraful Islam, Mohammed Eunus Ali, Md Rizwan Parvez

分类: cs.CL, cs.AI

发布日期: 2024-05-18

🔗 代码/项目: GITHUB

💡 一句话要点

MapCoder:多智能体协同代码生成,解决复杂编程问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 多智能体系统 大型语言模型 程序合成 自动化编程

📋 核心要点

- 现有代码生成方法难以应对复杂问题,尤其是在理解问题描述、设计算法和调试代码方面。

- MapCoder采用多智能体协同机制,模拟人类开发者的完整程序合成周期,提升代码生成质量。

- 实验表明,MapCoder在多个代码生成基准测试中取得了显著的性能提升,达到新的state-of-the-art水平。

📝 摘要(中文)

代码生成是一项极具挑战的任务,它需要深刻理解复杂的自然语言问题描述,生成用于复杂算法和数据结构的代码指令,并成功执行全面的单元测试。尽管大型语言模型(LLMs)在自然语言处理方面表现出令人印象深刻的能力,但它们在代码生成任务中的性能仍然有限。本文提出了一种新的代码生成方法,该方法利用多智能体提示,独特地复制了人类开发者在程序合成中的完整周期。我们的框架MapCoder由四个LLM智能体组成,专门用于模拟该周期的各个阶段:回忆相关示例、规划、代码生成和调试。经过在八个具有挑战性的竞争性问题解决和程序合成基准上进行的多项LLM消融和分析实验,MapCoder展示了卓越的代码生成能力,在HumanEval(93.9%)、MBPP(83.1%)、APPS(22.0%)、CodeContests(28.5%)和xCodeEval(45.3%)上取得了新的最先进结果(pass@1)。此外,我们的方法在各种编程语言和不同的问题难度下始终提供卓越的性能。我们在https://github.com/Md-Ashraful-Pramanik/MapCoder开源了我们的框架。

🔬 方法详解

问题定义:论文旨在解决复杂编程问题的自动代码生成问题。现有方法,特别是依赖单一大型语言模型的方法,在理解复杂问题描述、规划算法、生成正确代码以及有效调试方面存在局限性,导致代码生成成功率较低。

核心思路:论文的核心思路是将代码生成过程分解为多个阶段,并为每个阶段设计专门的智能体。通过多智能体之间的协同工作,模拟人类开发者解决问题的过程,从而提高代码生成的质量和成功率。这种分解和协同的思想有助于更好地利用大型语言模型的能力,并克服单一模型在复杂任务中的不足。

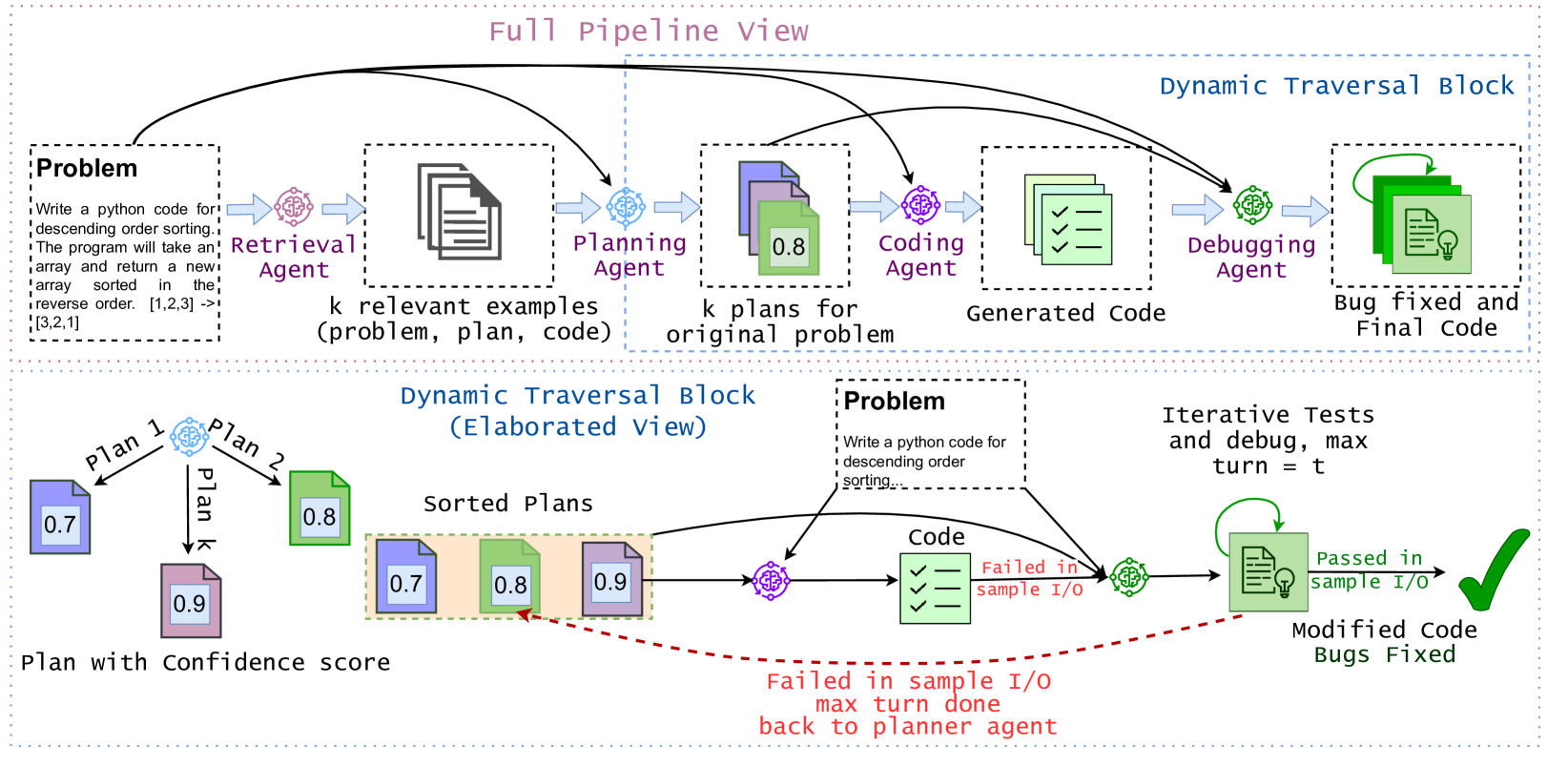

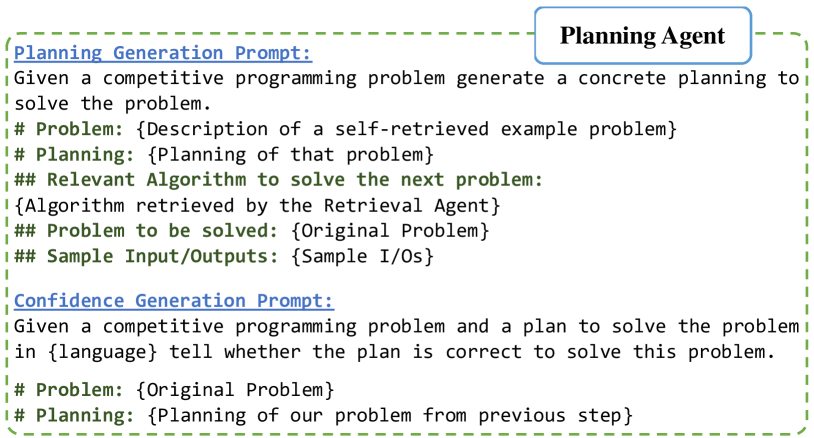

技术框架:MapCoder框架包含四个主要智能体:1) 回忆智能体:负责从已有代码库中检索相关示例,为后续步骤提供参考;2) 规划智能体:根据问题描述制定详细的解题计划,包括算法选择和数据结构设计;3) 代码生成智能体:根据规划生成代码;4) 调试智能体:负责测试和调试生成的代码,修复错误。这四个智能体依次执行,形成一个完整的代码生成周期。

关键创新:MapCoder的关键创新在于其多智能体协同的架构,它将复杂的代码生成任务分解为多个子任务,并为每个子任务设计专门的智能体。这种分解和协同的方式能够更好地利用大型语言模型的能力,并模拟人类开发者的工作流程。与传统的单一模型方法相比,MapCoder能够更有效地处理复杂问题,并生成更高质量的代码。

关键设计:论文中没有详细描述关键的参数设置、损失函数、网络结构等技术细节。框架主要依赖于大型语言模型的能力,通过精心设计的prompt来引导每个智能体的行为。具体的prompt设计是影响性能的关键因素,但论文中没有提供详细的prompt工程信息。框架使用pass@1指标评估代码生成效果,即一次尝试生成正确代码的概率。

🖼️ 关键图片

📊 实验亮点

MapCoder在多个代码生成基准测试中取得了显著的性能提升,在HumanEval上达到93.9%,MBPP上达到83.1%,APPS上达到22.0%,CodeContests上达到28.5%,xCodeEval上达到45.3%,均超过了现有state-of-the-art方法。这些结果表明,MapCoder具有强大的代码生成能力,能够有效解决复杂编程问题。

🎯 应用场景

MapCoder具有广泛的应用前景,可用于自动化软件开发、编程教育、代码辅助工具等领域。它可以帮助开发者快速生成代码,提高开发效率,降低开发成本。此外,MapCoder还可以用于编程教育,帮助学生更好地理解和掌握编程知识。未来,MapCoder有望成为软件开发领域的重要工具。

📄 摘要(原文)

Code synthesis, which requires a deep understanding of complex natural language problem descriptions, generation of code instructions for complex algorithms and data structures, and the successful execution of comprehensive unit tests, presents a significant challenge. While large language models (LLMs) demonstrate impressive proficiency in natural language processing, their performance in code generation tasks remains limited. In this paper, we introduce a new approach to code generation tasks leveraging multi-agent prompting that uniquely replicates the full cycle of program synthesis as observed in human developers. Our framework, MapCoder, consists of four LLM agents specifically designed to emulate the stages of this cycle: recalling relevant examples, planning, code generation, and debugging. After conducting thorough experiments, with multiple LLM ablations and analyses across eight challenging competitive problem-solving and program synthesis benchmarks, MapCoder showcases remarkable code generation capabilities, achieving new state-of-the-art results (pass@1) on HumanEval (93.9%), MBPP (83.1%), APPS (22.0%), CodeContests (28.5%), and xCodeEval (45.3%). Moreover, our method consistently delivers superior performance across various programming languages and varying problem difficulties. We open-source our framework at https://github.com/Md-Ashraful-Pramanik/MapCoder.