EnviroExam: Benchmarking Environmental Science Knowledge of Large Language Models

作者: Yu Huang, Liang Guo, Wanqian Guo, Zhe Tao, Yang Lv, Zhihao Sun, Dongfang Zhao

分类: cs.CL, cs.AI

发布日期: 2024-05-18

💡 一句话要点

EnviroExam:构建环境科学知识评测基准,评估大语言模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 环境科学 大型语言模型 知识评估 基准测试 零样本学习

📋 核心要点

- 现有大型语言模型缺乏在环境科学领域的有效评估方法,难以保证其在该领域的应用效果。

- EnviroExam构建了全面的环境科学知识评估基准,覆盖多层次课程体系,包含大量专业问题。

- 实验结果揭示了不同开源大语言模型在环境科学领域的性能差异,为模型选择和优化提供依据。

📝 摘要(中文)

本文提出了EnviroExam,一种综合性的评估方法,旨在评估大型语言模型在环境科学领域的知识掌握程度。EnviroExam基于国际顶尖大学的环境科学课程体系,涵盖本科、硕士和博士阶段的42门核心课程,共包含936个问题。通过对31个开源大型语言模型进行0-shot和5-shot测试,EnviroExam揭示了这些模型在环境科学领域的性能差异,并提供了详细的评估标准。结果表明,61.3%的模型通过了5-shot测试,而48.39%的模型通过了0-shot测试。通过引入变异系数作为指标,从多个角度评估了主流开源大型语言模型在环境科学领域的表现,为该领域语言模型的选择和微调提供了有效的标准。未来的研究将涉及使用专门的环境科学教科书构建更多特定领域的测试集,以进一步提高评估的准确性和针对性。

🔬 方法详解

问题定义:当前缺乏针对大型语言模型在环境科学领域知识掌握程度的有效评估方法。现有方法难以全面、准确地衡量模型在该领域的专业能力,阻碍了其在环境科学相关任务中的应用。因此,需要构建一个能够全面评估模型环境科学知识的基准测试。

核心思路:EnviroExam的核心思路是构建一个基于环境科学课程体系的综合性评估方法。通过收集和整理国际顶尖大学的环境科学课程,提取核心知识点并设计相应的问题,从而全面评估模型在该领域的知识掌握程度。这种方法能够更准确地反映模型在环境科学领域的专业能力。

技术框架:EnviroExam的整体框架包括以下几个主要阶段:1)课程体系构建:收集国际顶尖大学的环境科学课程,涵盖本科、硕士和博士阶段;2)知识点提取:从课程大纲和教材中提取核心知识点;3)问题设计:根据知识点设计选择题、填空题等多种题型;4)模型测试:使用0-shot和5-shot方法对大型语言模型进行测试;5)结果分析:分析模型在不同课程和题型上的表现,并计算变异系数等指标。

关键创新:EnviroExam的关键创新在于其针对环境科学领域的专业性和全面性。与通用的语言模型评估基准不同,EnviroExam专注于评估模型在环境科学领域的知识掌握程度,能够更准确地反映模型在该领域的专业能力。此外,EnviroExam还引入了变异系数等指标,从多个角度评估模型的性能。

关键设计:EnviroExam的关键设计包括:1)课程选择:选择国际顶尖大学的环境科学课程,保证了测试的专业性和权威性;2)问题数量:包含936个问题,保证了测试的全面性;3)评估指标:引入变异系数等指标,从多个角度评估模型的性能;4)测试方法:采用0-shot和5-shot方法,评估模型的泛化能力和学习能力。

🖼️ 关键图片

📊 实验亮点

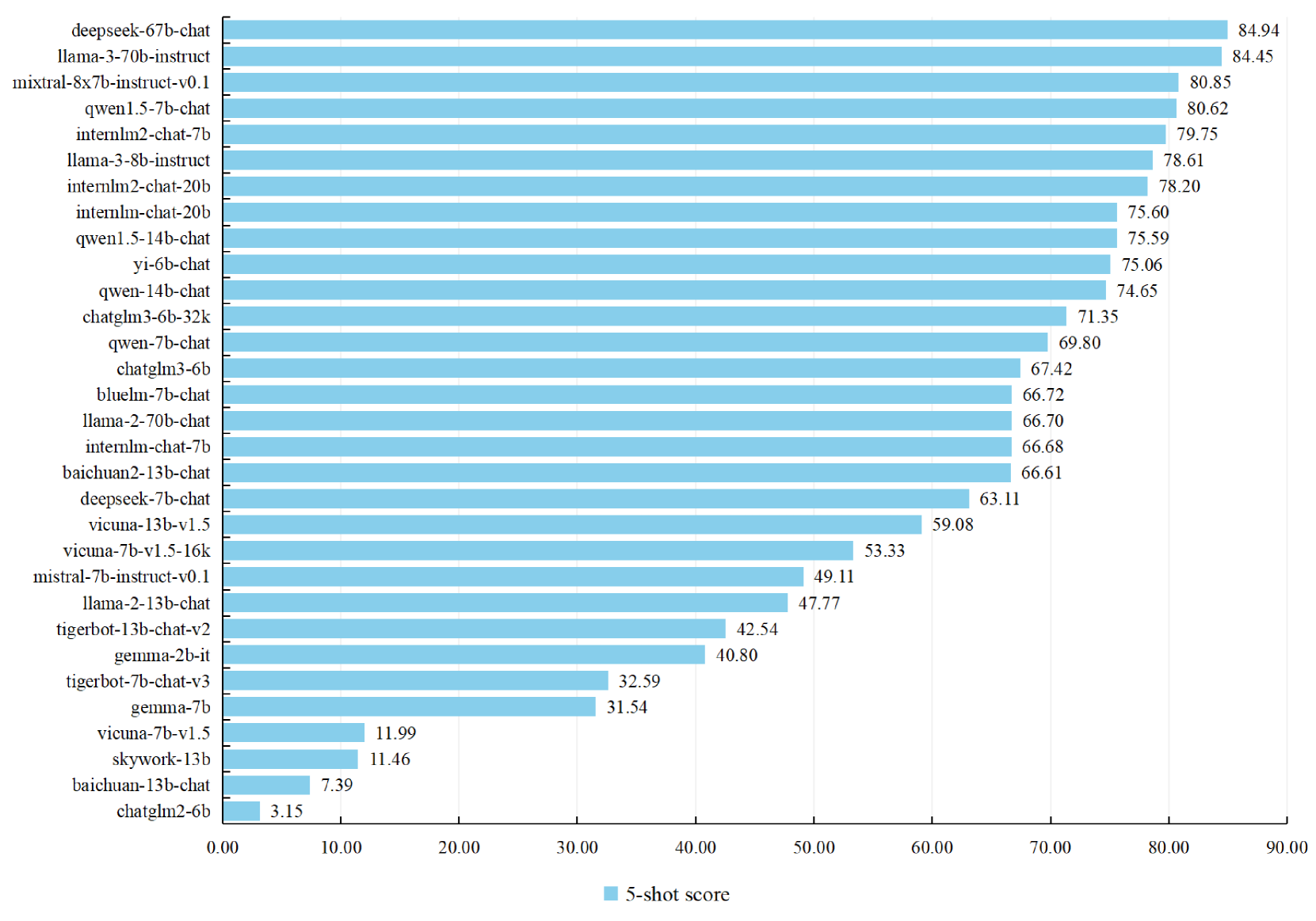

EnviroExam对31个开源大型语言模型进行了0-shot和5-shot测试,结果显示61.3%的模型通过了5-shot测试,而48.39%的模型通过了0-shot测试。该研究揭示了不同模型在环境科学领域的性能差异,并提供了详细的评估标准。通过引入变异系数,可以从多个角度评估模型的性能,为模型选择和微调提供依据。

🎯 应用场景

EnviroExam可用于评估和选择适用于环境科学领域的大型语言模型,例如用于环境监测数据分析、环境政策咨询、环境教育等。该基准测试有助于推动大型语言模型在环境科学领域的应用,并促进相关技术的创新和发展。未来,可以基于EnviroExam构建更专业的环境科学知识库和问答系统。

📄 摘要(原文)

In the field of environmental science, it is crucial to have robust evaluation metrics for large language models to ensure their efficacy and accuracy. We propose EnviroExam, a comprehensive evaluation method designed to assess the knowledge of large language models in the field of environmental science. EnviroExam is based on the curricula of top international universities, covering undergraduate, master's, and doctoral courses, and includes 936 questions across 42 core courses. By conducting 0-shot and 5-shot tests on 31 open-source large language models, EnviroExam reveals the performance differences among these models in the domain of environmental science and provides detailed evaluation standards. The results show that 61.3% of the models passed the 5-shot tests, while 48.39% passed the 0-shot tests. By introducing the coefficient of variation as an indicator, we evaluate the performance of mainstream open-source large language models in environmental science from multiple perspectives, providing effective criteria for selecting and fine-tuning language models in this field. Future research will involve constructing more domain-specific test sets using specialized environmental science textbooks to further enhance the accuracy and specificity of the evaluation.