LG AI Research & KAIST at EHRSQL 2024: Self-Training Large Language Models with Pseudo-Labeled Unanswerable Questions for a Reliable Text-to-SQL System on EHRs

作者: Yongrae Jo, Seongyun Lee, Minju Seo, Sung Ju Hwang, Moontae Lee

分类: cs.CL

发布日期: 2024-05-18

备注: NAACL 2024 Clinical NLP Workshop

💡 一句话要点

提出基于伪标签不可回答问题的自训练方法,提升EHR文本到SQL系统的可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 电子病历 自训练 伪标签 不可回答问题

📋 核心要点

- 现有Text-to-SQL模型在医疗领域面临挑战,需要准确识别不可回答的问题以避免错误信息。

- 论文提出利用伪标签的不可回答问题进行自训练,增强模型识别不确定预测的能力。

- 实验结果表明,该方法在EHRSQL 2024共享任务中表现出色,验证了其有效性。

📝 摘要(中文)

本文提出了一种自训练策略,利用伪标签的不可回答问题来增强电子病历(EHR)文本到SQL模型的可靠性。该模型对于医疗专业人员在没有SQL知识的情况下访问EHR至关重要。随着大型语言模型的进步,这些系统已经能够更好地将复杂问题转化为SQL查询。然而,医疗保健领域对可靠性的关键需求要求这些模型能够准确识别不可回答的问题或不确定的预测,以防止错误信息的产生。该方法包括一个两阶段的训练过程,然后是基于token熵和查询执行的过滤方法。在EHRSQL 2024共享任务中的出色表现验证了该方法的有效性,展示了通过更可靠的文本到SQL系统改善医疗决策的潜力。

🔬 方法详解

问题定义:现有的Text-to-SQL模型在电子病历(EHR)领域应用时,面临着一个关键问题:如何准确识别用户提出的问题是否可以回答。如果模型无法识别不可回答的问题,可能会生成错误的SQL查询,从而导致错误的医疗决策。现有方法在这方面存在不足,容易产生误导性信息。

核心思路:本文的核心思路是利用自训练的方法,通过生成伪标签的不可回答问题来训练模型,使其能够更好地区分可回答和不可回答的问题。通过这种方式,模型可以学习到哪些问题是缺乏足够信息或者超出数据库范围的,从而避免生成错误的SQL查询。

技术框架:该方法包含一个两阶段的训练过程。第一阶段,使用现有的Text-to-SQL模型生成伪标签的不可回答问题。第二阶段,使用这些伪标签数据对模型进行自训练,提高其识别不可回答问题的能力。此外,还引入了一个基于token熵和查询执行的过滤方法,用于进一步筛选高质量的伪标签数据。整体流程为:原始数据 -> 伪标签生成 -> 数据过滤 -> 模型自训练 -> 最终模型。

关键创新:该方法最重要的创新点在于利用伪标签的不可回答问题进行自训练。与传统的监督学习方法不同,该方法不需要人工标注大量的不可回答问题,而是通过模型自身生成伪标签数据,从而降低了标注成本,并能够更好地适应EHR数据的特点。

关键设计:在伪标签生成阶段,使用了现有的Text-to-SQL模型来生成SQL查询,并判断查询结果是否为空。如果查询结果为空,则认为该问题是不可回答的,并生成相应的伪标签。在数据过滤阶段,使用了token熵来衡量问题的复杂度和不确定性,并使用查询执行结果来验证伪标签的准确性。具体的参数设置和损失函数细节在论文中未明确给出,属于未知信息。

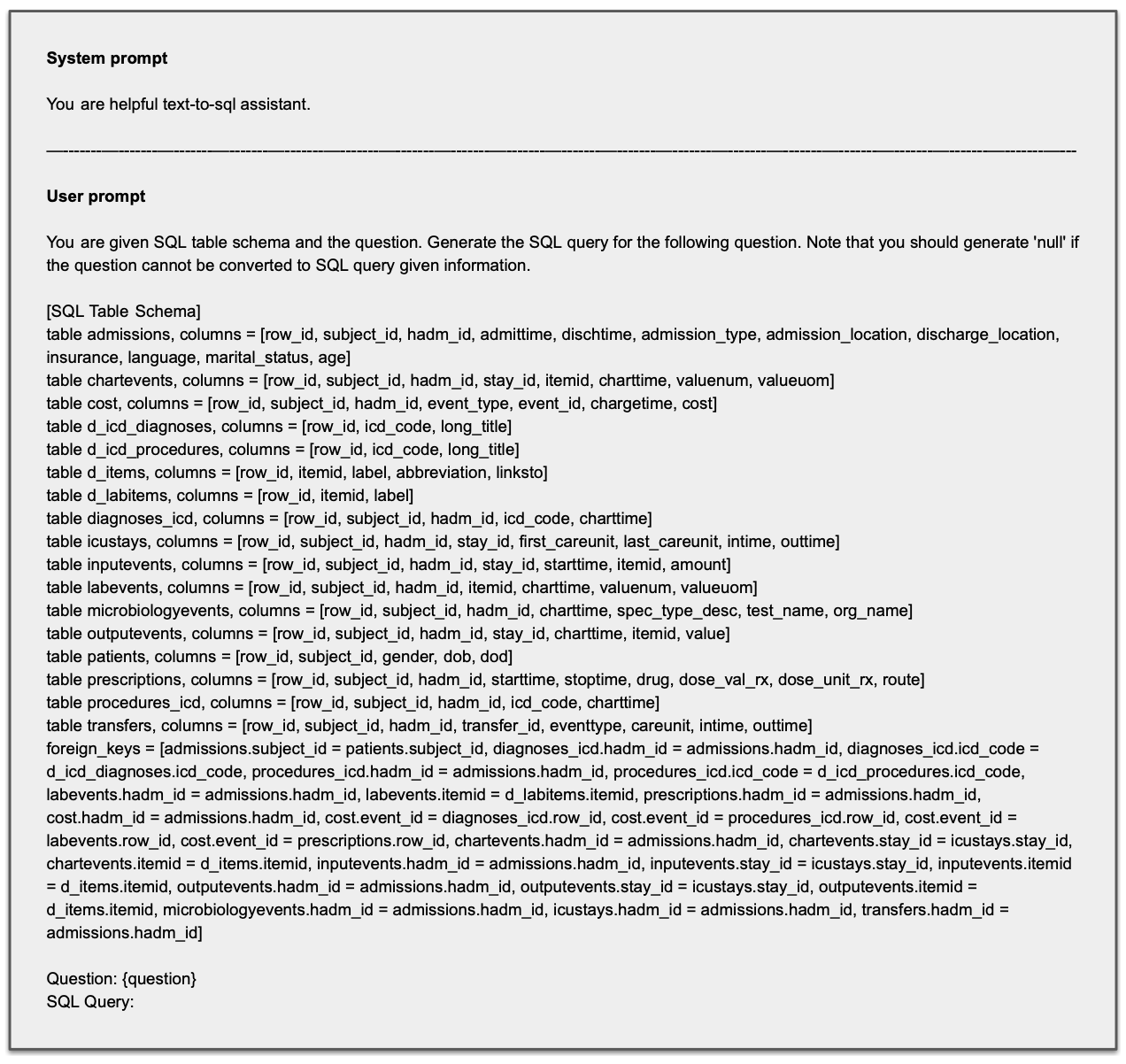

🖼️ 关键图片

📊 实验亮点

该研究在EHRSQL 2024共享任务中取得了优异的成绩,验证了所提出方法的有效性。具体的性能数据和对比基线在摘要中未给出,属于未知信息。但总体而言,该方法能够显著提高Text-to-SQL系统在EHR领域的可靠性,具有重要的实际意义。

🎯 应用场景

该研究成果可应用于各种医疗信息系统,帮助医生和研究人员更方便地查询和分析电子病历数据。通过提高Text-to-SQL系统的可靠性,可以减少错误信息的产生,从而改善医疗决策,提高医疗质量。未来,该技术有望扩展到其他领域的数据库查询,例如金融、法律等。

📄 摘要(原文)

Text-to-SQL models are pivotal for making Electronic Health Records (EHRs) accessible to healthcare professionals without SQL knowledge. With the advancements in large language models, these systems have become more adept at translating complex questions into SQL queries. Nonetheless, the critical need for reliability in healthcare necessitates these models to accurately identify unanswerable questions or uncertain predictions, preventing misinformation. To address this problem, we present a self-training strategy using pseudo-labeled unanswerable questions to enhance the reliability of text-to-SQL models for EHRs. This approach includes a two-stage training process followed by a filtering method based on the token entropy and query execution. Our methodology's effectiveness is validated by our top performance in the EHRSQL 2024 shared task, showcasing the potential to improve healthcare decision-making through more reliable text-to-SQL systems.