SBAAM! Eliminating Transcript Dependency in Automatic Subtitling

作者: Marco Gaido, Sara Papi, Matteo Negri, Mauro Cettolo, Luisa Bentivogli

分类: cs.CL

发布日期: 2024-05-17

备注: Accepted to ACL 2024 main conference

💡 一句话要点

SBAAM:提出一种无需中间转录的自动字幕生成模型,提升多语言字幕生成效果。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动字幕生成 端到端模型 语音翻译 时间戳预测 无转录 多语言处理 深度学习

📋 核心要点

- 现有自动字幕生成方法依赖自动转录文本,转录质量直接影响最终字幕效果,限制了整体性能。

- SBAAM模型无需中间转录,直接从语音生成字幕,包括翻译、分割和时间戳预测,实现端到端优化。

- 实验结果表明,SBAAM在多种语言对和不同条件下均取得了领先的性能,并通过人工评估验证了其有效性。

📝 摘要(中文)

字幕在增强视听内容的可访问性方面起着关键作用,它包含三个主要子任务:翻译口语对话、将翻译分割成简洁的文本单元以及估计控制其屏幕显示时长的时戳。过去自动化该过程的尝试在不同程度上依赖于自动转录,并以不同的方式用于这三个子任务。针对这种对转录依赖的公认局限性,最近的研究已转向用于翻译和分割的无转录解决方案,而直接生成时戳仍是未知的领域。为了填补这一空白,我们推出了第一个能够生成自动字幕的直接模型,完全消除了对中间转录的依赖,也包括时戳预测。实验结果,在人工评估的支持下,展示了我们的解决方案在多种语言对和不同条件下的最新性能。

🔬 方法详解

问题定义:论文旨在解决自动字幕生成过程中对自动语音转录(ASR)的依赖问题。现有方法通常先将语音转录成文本,然后再进行翻译、分割和时间戳预测。这种pipeline方式存在两个主要痛点:一是ASR的错误会传递到后续模块,影响字幕质量;二是各个模块独立优化,无法实现全局最优。

核心思路:论文的核心思路是设计一个端到端的模型,直接从语音信号生成字幕,无需中间的ASR转录步骤。通过联合优化翻译、分割和时间戳预测,避免了错误传递,并实现了全局最优。这种方法类似于机器翻译领域中流行的直接翻译方法,即直接从源语言语音翻译成目标语言文本。

技术框架:SBAAM模型的整体架构是一个encoder-decoder框架。Encoder负责将语音信号编码成高维特征表示,Decoder负责根据这些特征生成字幕文本和对应的时间戳。具体来说,Encoder可以使用卷积神经网络(CNN)或Transformer等结构来提取语音特征。Decoder通常采用循环神经网络(RNN)或Transformer结构,并结合注意力机制来生成字幕文本。时间戳预测可以作为一个辅助任务,与字幕生成任务联合训练。

关键创新:SBAAM模型最重要的技术创新点在于完全消除了对中间转录的依赖,实现了端到端的字幕生成。这与传统的pipeline方法形成了鲜明对比,避免了ASR错误的传递,并允许模型直接学习语音信号和字幕之间的映射关系。此外,联合优化翻译、分割和时间戳预测,可以进一步提升字幕质量。

关键设计:论文中可能涉及的关键设计包括:1) Encoder的网络结构和参数设置,例如CNN的卷积核大小、Transformer的层数和注意力头数等;2) Decoder的网络结构和参数设置,例如RNN的隐藏层大小、Transformer的层数和注意力头数等;3) 时间戳预测模块的设计,例如使用回归模型或分类模型来预测时间戳;4) 损失函数的设计,例如使用交叉熵损失函数来训练字幕生成任务,使用均方误差损失函数来训练时间戳预测任务,并结合正则化项来防止过拟合。

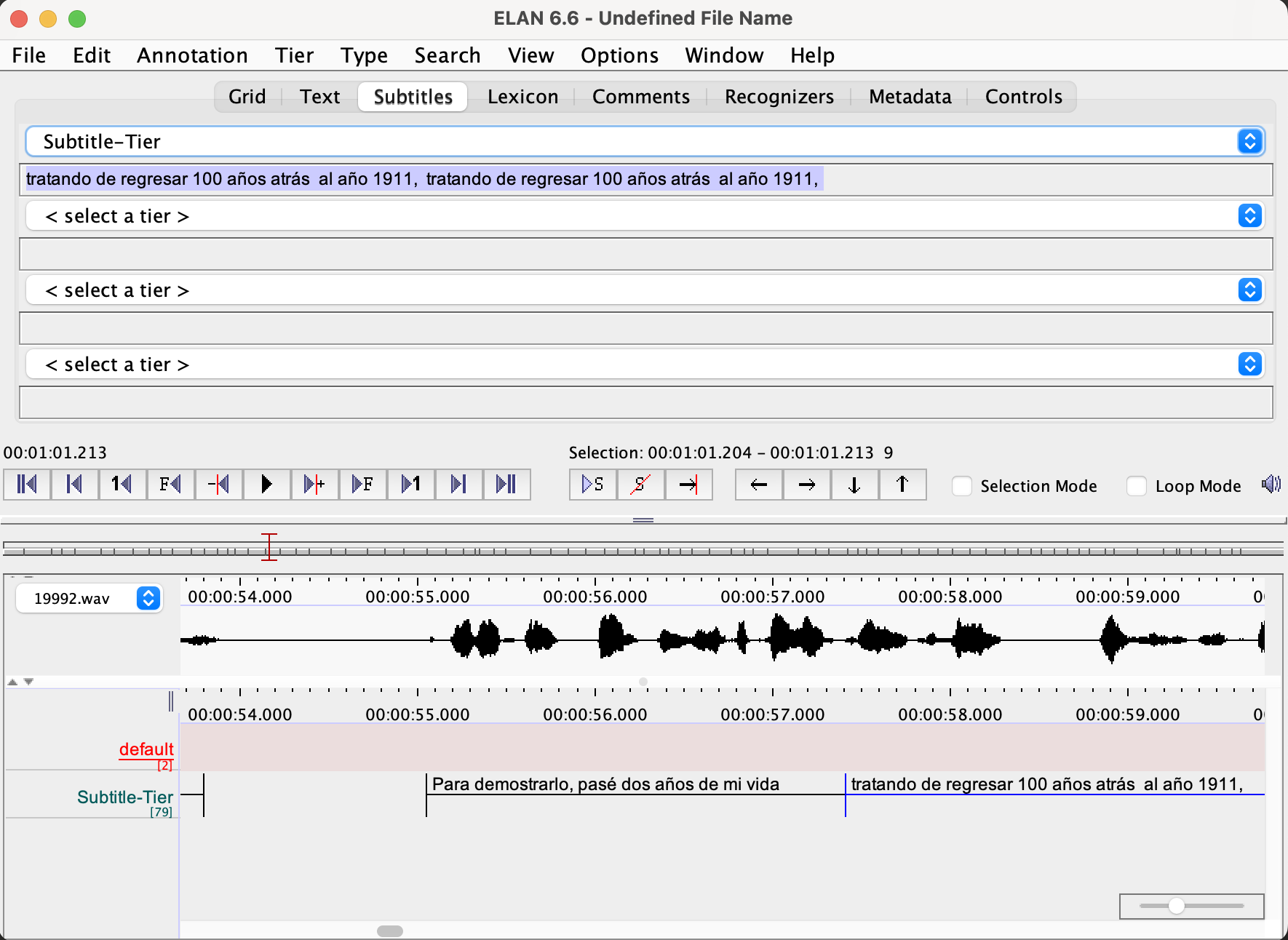

🖼️ 关键图片

📊 实验亮点

实验结果表明,SBAAM模型在多个语言对上取得了显著的性能提升,超越了依赖转录的传统方法。人工评估也证实了SBAAM生成的字幕质量更高,更易于理解。具体性能数据(例如BLEU值、时间戳准确率等)和对比基线需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于视频平台、在线教育、会议转录等领域,提升视听内容的可访问性和用户体验。尤其对于小语种或口音复杂的场景,无需依赖高质量的语音转录,也能生成准确的字幕,具有重要的实际应用价值。未来,该技术有望进一步发展,实现更加智能和个性化的字幕生成。

📄 摘要(原文)

Subtitling plays a crucial role in enhancing the accessibility of audiovisual content and encompasses three primary subtasks: translating spoken dialogue, segmenting translations into concise textual units, and estimating timestamps that govern their on-screen duration. Past attempts to automate this process rely, to varying degrees, on automatic transcripts, employed diversely for the three subtasks. In response to the acknowledged limitations associated with this reliance on transcripts, recent research has shifted towards transcription-free solutions for translation and segmentation, leaving the direct generation of timestamps as uncharted territory. To fill this gap, we introduce the first direct model capable of producing automatic subtitles, entirely eliminating any dependence on intermediate transcripts also for timestamp prediction. Experimental results, backed by manual evaluation, showcase our solution's new state-of-the-art performance across multiple language pairs and diverse conditions.