Benchmarking Large Language Models on CFLUE -- A Chinese Financial Language Understanding Evaluation Dataset

作者: Jie Zhu, Junhui Li, Yalong Wen, Lifan Guo

分类: cs.CL, cs.AI

发布日期: 2024-05-17

备注: Accepted by ACL 2024

期刊: The 62nd Annual Meeting of the Association for Computational Linguistics(ACL),2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出CFLUE:一个中文金融语言理解评估基准,用于全面评估大型语言模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 中文金融 语言理解 评估基准 知识评估 应用评估 自然语言处理

📋 核心要点

- 现有大型语言模型缺乏在中文金融领域的专业评估基准,难以准确衡量其在该领域的理解能力。

- CFLUE构建了知识评估和应用评估数据集,全面评估LLM在金融领域的知识掌握和实际应用能力。

- 实验结果表明,现有LLM在金融知识理解方面仍有提升空间,轻量级模型在应用评估中表现出竞争力。

📝 摘要(中文)

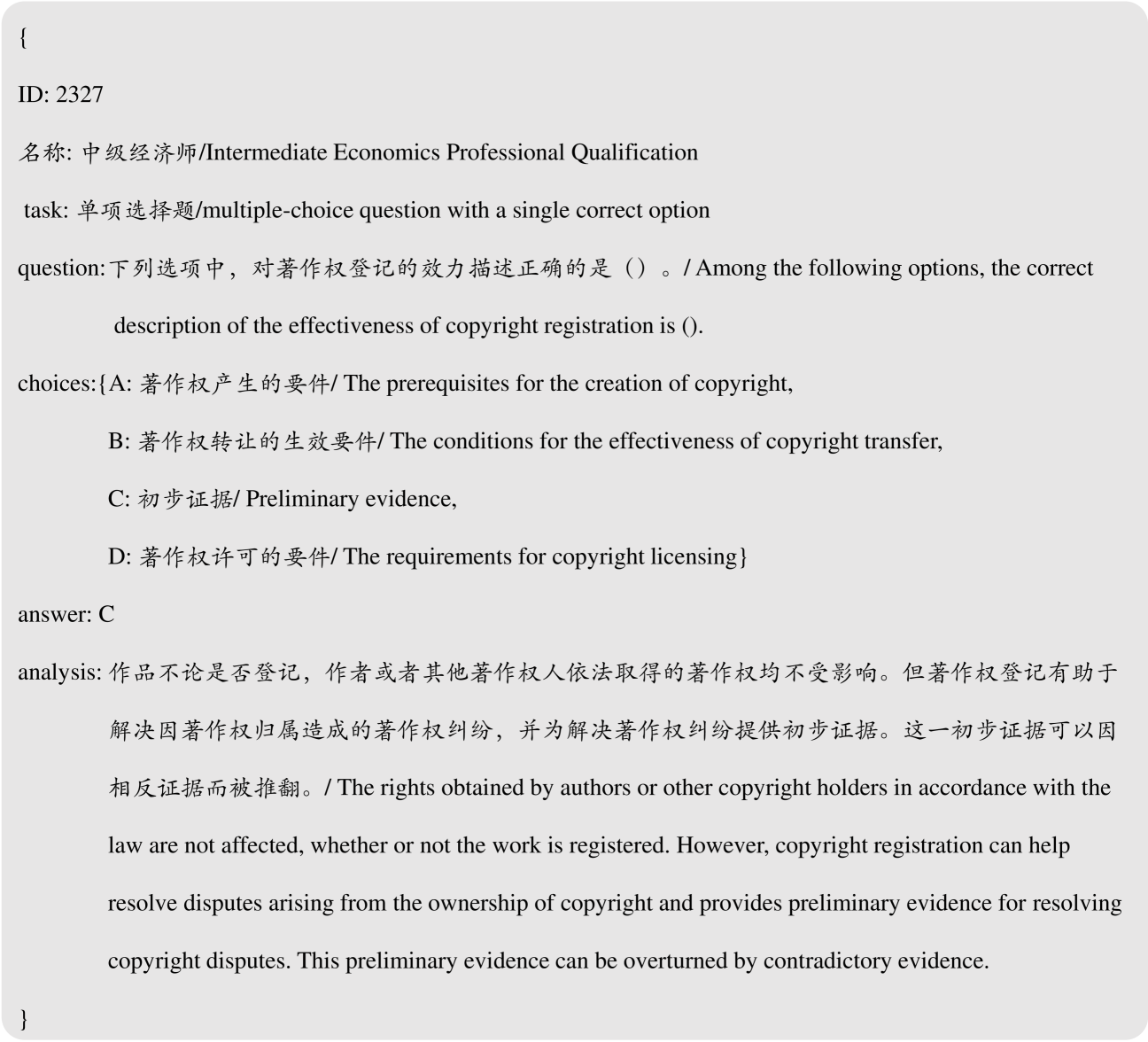

随着大型语言模型(LLMs)在自然语言处理(NLP)领域取得的突破性进展,迫切需要新的基准来跟上LLMs的快速发展。本文提出了CFLUE,即中文金融语言理解评估基准,旨在评估LLMs在各个维度上的能力。具体来说,CFLUE提供了为知识评估和应用评估量身定制的数据集。在知识评估方面,它包含38K+个多项选择题,并附带相应的解题思路。这些问题具有双重目的:答案预测和问题推理。在应用评估方面,CFLUE包含16K+个测试实例,涵盖文本分类、机器翻译、关系抽取、阅读理解和文本生成等不同的NLP任务。基于CFLUE,我们对具有代表性的LLMs进行了全面评估。结果表明,在知识评估的答案预测中,只有GPT-4和GPT-4-turbo的准确率超过60%,这表明当前的LLMs仍有很大的改进空间。在应用评估中,尽管GPT-4和GPT-4-turbo是表现最好的两个模型,但它们相对于轻量级LLMs的显著优势明显减弱。与CFLUE相关的数据集和脚本可在https://github.com/aliyun/cflue上公开获取。

🔬 方法详解

问题定义:论文旨在解决缺乏针对中文金融领域的大型语言模型(LLM)评估基准的问题。现有方法无法充分评估LLM在金融领域的知识掌握和应用能力,阻碍了LLM在该领域的进一步发展。现有基准可能缺乏金融领域的专业性,或者覆盖的任务类型不够全面。

核心思路:论文的核心思路是构建一个全面、专业的中文金融语言理解评估基准CFLUE。该基准包含知识评估和应用评估两部分,分别考察LLM在金融知识方面的掌握程度和在实际NLP任务中的应用能力。通过CFLUE,可以更准确地评估LLM在中文金融领域的性能,并为未来的研究提供指导。

技术框架:CFLUE基准包含两个主要部分:知识评估和应用评估。知识评估部分包含38K+个多项选择题,每个问题都附带解题思路,用于评估LLM的答案预测和问题推理能力。应用评估部分包含16K+个测试实例,涵盖文本分类、机器翻译、关系抽取、阅读理解和文本生成等不同的NLP任务。研究人员可以使用CFLUE提供的API和脚本,方便地对LLM进行评估。

关键创新:CFLUE的关键创新在于其针对中文金融领域的专业性和全面性。与现有的通用型基准相比,CFLUE更关注金融领域的特定知识和任务,能够更准确地评估LLM在该领域的性能。此外,CFLUE同时包含知识评估和应用评估两部分,可以全面考察LLM在金融领域的理解能力。

关键设计:在知识评估部分,问题设计涵盖了金融领域的各个方面,包括金融概念、法规、市场分析等。每个问题都经过专家审核,确保其专业性和准确性。在应用评估部分,任务选择涵盖了金融领域常见的NLP任务,例如金融文本分类、研报机器翻译、财经新闻关系抽取等。数据集的划分保证了训练集、验证集和测试集的分布一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在知识评估的答案预测中,只有GPT-4和GPT-4-turbo的准确率超过60%,表明现有LLM在金融知识理解方面仍有提升空间。在应用评估中,GPT-4和GPT-4-turbo表现最佳,但与轻量级LLM的差距并不显著,说明轻量级模型在特定任务上具有竞争力。

🎯 应用场景

该研究成果可应用于金融领域的智能客服、风险评估、投资决策支持等场景。通过CFLUE基准,可以筛选和优化更适合金融领域的LLM,提高金融服务的效率和质量。未来,可以进一步扩展CFLUE的数据集和任务类型,使其能够更好地适应金融领域的快速发展。

📄 摘要(原文)

In light of recent breakthroughs in large language models (LLMs) that have revolutionized natural language processing (NLP), there is an urgent need for new benchmarks to keep pace with the fast development of LLMs. In this paper, we propose CFLUE, the Chinese Financial Language Understanding Evaluation benchmark, designed to assess the capability of LLMs across various dimensions. Specifically, CFLUE provides datasets tailored for both knowledge assessment and application assessment. In knowledge assessment, it consists of 38K+ multiple-choice questions with associated solution explanations. These questions serve dual purposes: answer prediction and question reasoning. In application assessment, CFLUE features 16K+ test instances across distinct groups of NLP tasks such as text classification, machine translation, relation extraction, reading comprehension, and text generation. Upon CFLUE, we conduct a thorough evaluation of representative LLMs. The results reveal that only GPT-4 and GPT-4-turbo achieve an accuracy exceeding 60\% in answer prediction for knowledge assessment, suggesting that there is still substantial room for improvement in current LLMs. In application assessment, although GPT-4 and GPT-4-turbo are the top two performers, their considerable advantage over lightweight LLMs is noticeably diminished. The datasets and scripts associated with CFLUE are openly accessible at https://github.com/aliyun/cflue.