Can formal argumentative reasoning enhance LLMs performances?

作者: Federico Castagna, Isabel Sassoon, Simon Parsons

分类: cs.CL, cs.AI

发布日期: 2024-05-16

💡 一句话要点

提出MQArgEng,利用计算论证增强大型语言模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 计算论证 自然语言处理 推理能力 对话系统

📋 核心要点

- 现有大型语言模型依赖大量资源进行训练和升级,缺乏轻量级的性能提升方法。

- 论文提出MQArgEng管道,利用计算论证语义增强LLM的推理和对话能力。

- 实验结果表明,MQArgEng在MT-Bench测试中,多数主题类别上实现了适度的性能提升。

📝 摘要(中文)

近年来,深度学习驱动的自然语言模型取得了显著的性能提升,尤其是在大型语言模型(LLM)的开发和发布方面。这些改进提高了人工智能生成内容的质量,但依赖于资源密集型的模型训练和升级。尽管不同的研究提出了各种无需重新训练即可增强LLM的技术,但没有研究考虑将计算论证作为一种选择。这是一个错失的机会,因为计算论证是一种直观的机制,可以正式地捕捉智能体的交互以及在此类交互中可能出现的信息冲突,因此它似乎非常适合以无缝的方式提升LLM的推理和对话能力。在本文中,我们提出了一个管道(MQArgEng)和一个初步研究,以评估引入计算论证语义对LLM性能的影响。我们实验的目标是提供概念验证和可行性分析,以促进(或阻止)未来研究开发用于LLM的成熟的论证引擎插件。使用MT-Bench的探索性结果表明,MQArgEng在大多数考察的主题类别中提供了适度的性能提升,因此显示出希望并值得进一步研究。

🔬 方法详解

问题定义:现有大型语言模型(LLM)的性能提升主要依赖于模型本身的训练和升级,这需要大量的计算资源和时间。缺乏一种轻量级、可插拔的方法来增强LLM的推理和对话能力。现有方法没有充分利用计算论证在形式化捕捉智能体交互和信息冲突方面的优势。

核心思路:论文的核心思路是将计算论证的语义融入到LLM中,从而提升其推理和对话能力。通过形式化地表示和处理信息之间的冲突,使LLM能够更好地理解和应对复杂的问题。这种方法无需重新训练LLM,而是通过一个外部的论证引擎来实现。

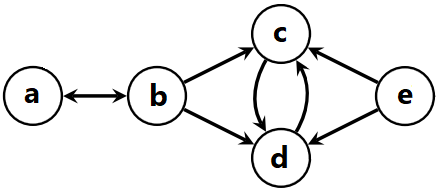

技术框架:MQArgEng管道包含以下主要模块:1) 问题输入模块,接收用户提出的问题。2) LLM生成初始答案模块,利用LLM生成初步的答案。3) 论证引擎模块,该模块利用计算论证语义对LLM的初始答案进行分析和推理,识别潜在的冲突和矛盾。4) 答案优化模块,基于论证引擎的分析结果,对LLM的答案进行优化和修正。5) 输出模块,将优化后的答案呈现给用户。

关键创新:论文的关键创新在于将计算论证与大型语言模型相结合,提出了一种新的LLM增强方法。这种方法不需要重新训练LLM,而是通过一个外部的论证引擎来提升其推理和对话能力。这是首次尝试将计算论证应用于LLM的性能增强。

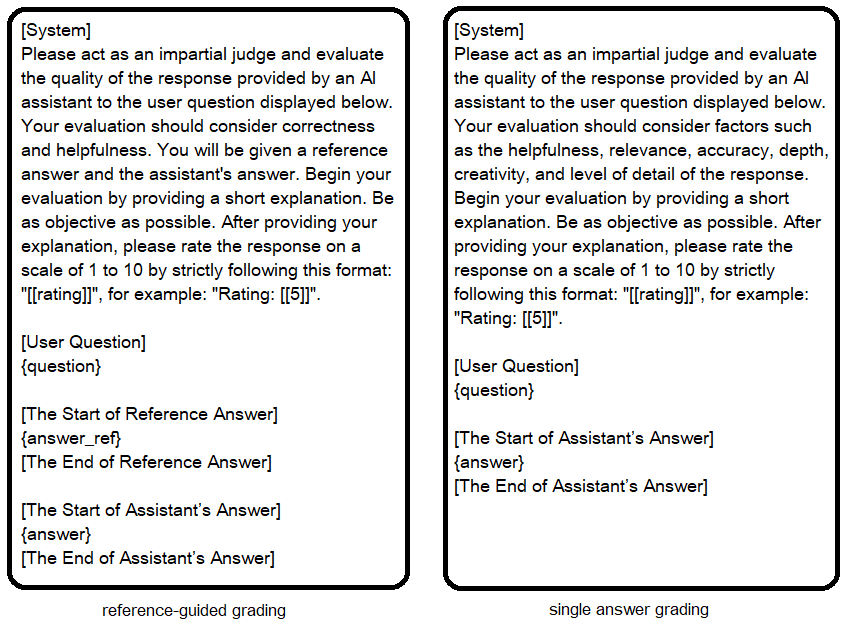

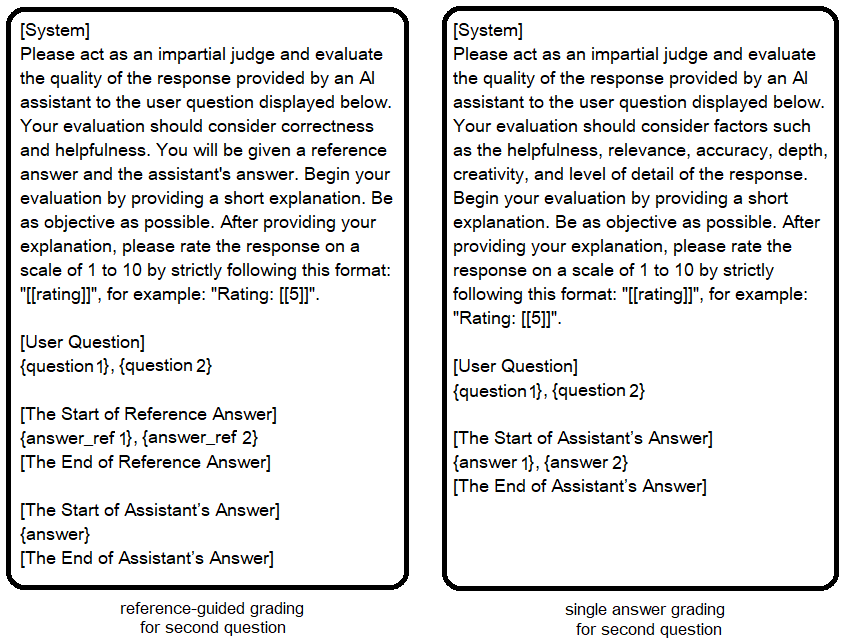

关键设计:论文中,论证引擎的具体实现细节(如使用的论证框架、推理规则等)以及答案优化模块的具体策略(如如何根据论证结果修改LLM的答案)在摘要中没有详细说明,属于未知信息。MT-Bench作为评估工具,用于衡量LLM在不同主题上的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MQArgEng在MT-Bench测试中,多数主题类别上实现了适度的性能提升。虽然具体的性能提升幅度未在摘要中给出,但该结果验证了计算论证在增强LLM性能方面的潜力,并为未来的研究方向提供了有价值的参考。

🎯 应用场景

该研究成果可应用于智能客服、问答系统、对话机器人等领域,提升LLM在复杂问题上的推理和对话能力。通过引入计算论证,可以使LLM更好地处理信息冲突和矛盾,从而提供更准确、更可靠的答案。未来,该方法有望成为一种通用的LLM增强手段,广泛应用于各种自然语言处理任务。

📄 摘要(原文)

Recent years witnessed significant performance advancements in deep-learning-driven natural language models, with a strong focus on the development and release of Large Language Models (LLMs). These improvements resulted in better quality AI-generated output but rely on resource-expensive training and upgrading of models. Although different studies have proposed a range of techniques to enhance LLMs without retraining, none have considered computational argumentation as an option. This is a missed opportunity since computational argumentation is an intuitive mechanism that formally captures agents' interactions and the information conflict that may arise during such interplays, and so it seems well-suited for boosting the reasoning and conversational abilities of LLMs in a seamless manner. In this paper, we present a pipeline (MQArgEng) and preliminary study to evaluate the effect of introducing computational argumentation semantics on the performance of LLMs. Our experiment's goal was to provide a proof-of-concept and a feasibility analysis in order to foster (or deter) future research towards a fully-fledged argumentation engine plugin for LLMs. Exploratory results using the MT-Bench indicate that MQArgEng provides a moderate performance gain in most of the examined topical categories and, as such, show promise and warrant further research.