CPsyExam: A Chinese Benchmark for Evaluating Psychology using Examinations

作者: Jiahao Zhao, Jingwei Zhu, Minghuan Tan, Min Yang, Renhao Li, Di Yang, Chenhao Zhang, Guancheng Ye, Chengming Li, Xiping Hu, Derek F. Wong

分类: cs.CL

发布日期: 2024-05-16 (更新: 2024-12-10)

备注: To appear in COLING 2025

💡 一句话要点

提出中文心理学考试基准CPsyExam,用于评估LLM的心理学知识和案例分析能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理学 大型语言模型 基准测试 案例分析 中文 知识评估 自然语言处理

📋 核心要点

- 现有LLM在心理学知识理解和实际案例分析方面存在不足,缺乏专门的中文心理学评估基准。

- 构建CPsyExam基准,包含心理学知识和案例分析两部分,侧重于考察LLM在实际场景中应用心理学知识的能力。

- 实验评估了多种LLM在CPsyExam上的表现,证明了该基准能够有效评估和比较LLM的心理学理解能力。

📝 摘要(中文)

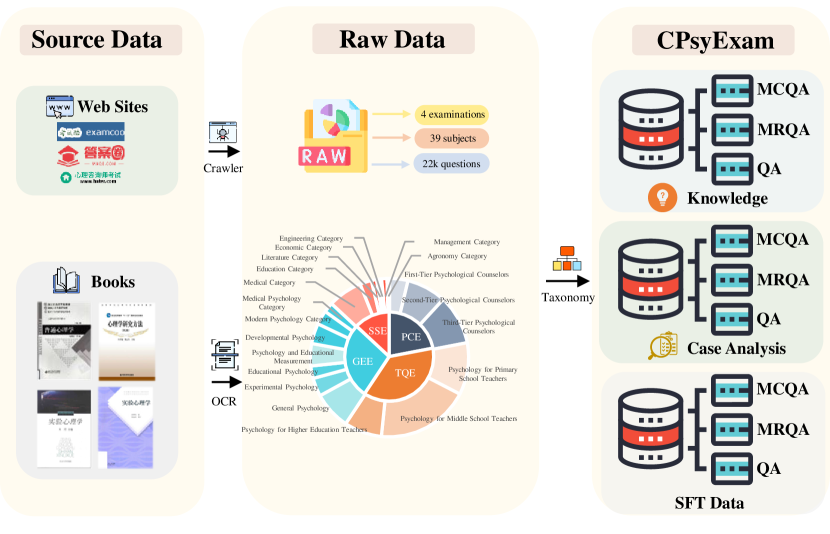

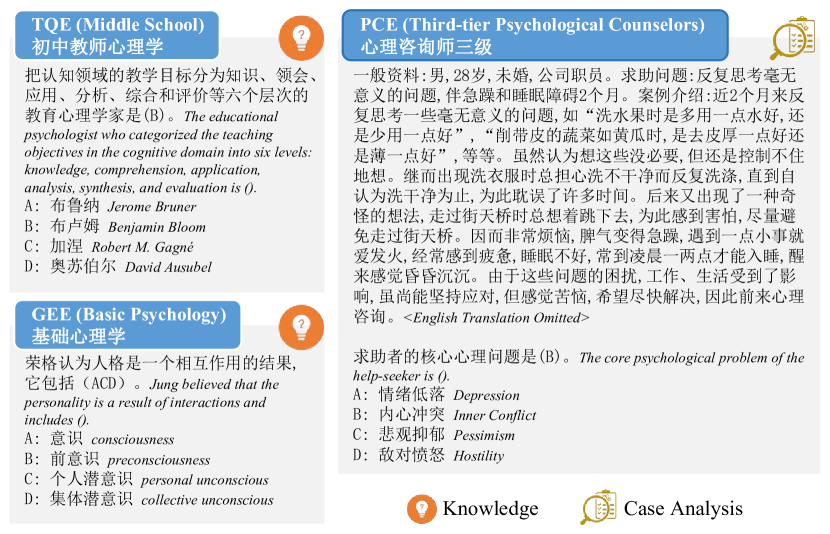

本文介绍了一种新的心理学基准CPsyExam,该基准由中文考试中的问题构建而成。CPsyExam的设计分别侧重于心理学知识和案例分析,认识到将心理学知识应用于实际场景的重要性。从22k个问题中,我们利用4k个问题创建了该基准,该基准提供了对主题的均衡覆盖,并结合了各种案例分析技术。此外,我们评估了一系列现有的大型语言模型(LLM),包括开源模型和基于API的模型。我们的实验和分析表明,CPsyExam可以作为一个有效的基准,用于增强LLM对心理学的理解,并能够比较各种粒度的LLM。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)在心理学领域的知识掌握和应用能力方面存在不足。缺乏专门针对中文心理学知识的评估基准,难以有效衡量和提升LLM在心理学领域的表现。现有方法难以区分LLM对心理学理论知识的掌握程度以及将这些知识应用于实际案例分析的能力。

核心思路:本文的核心思路是构建一个专门的中文心理学考试基准CPsyExam,该基准包含心理学知识和案例分析两部分,分别评估LLM对心理学理论知识的掌握程度以及将这些知识应用于实际场景的能力。通过该基准,可以更全面地评估和比较不同LLM在心理学领域的表现,并促进LLM在该领域的进一步发展。

技术框架:CPsyExam的构建流程主要包括以下几个阶段:1) 数据收集:从中文心理学相关考试中收集了22k个问题。2) 数据筛选:从收集的问题中筛选出4k个问题,确保问题覆盖心理学的各个主题,并包含各种案例分析技术。3) 基准构建:将筛选后的问题构建成CPsyExam基准,该基准包含心理学知识和案例分析两部分。4) 模型评估:使用CPsyExam基准评估各种LLM,包括开源模型和基于API的模型。5) 结果分析:对评估结果进行分析,比较不同LLM在心理学领域的表现。

关键创新:CPsyExam的关键创新在于其专门针对中文心理学知识,并区分了心理学知识和案例分析两部分。与现有的通用型基准相比,CPsyExam能够更准确地评估LLM在心理学领域的表现。此外,CPsyExam还包含了各种案例分析技术,能够更全面地评估LLM将心理学知识应用于实际场景的能力。

关键设计:CPsyExam基准包含选择题、判断题和案例分析题等多种题型,以全面评估LLM的心理学知识和应用能力。案例分析题的设计侧重于考察LLM在实际场景中应用心理学理论解决问题的能力。基准的构建过程中,对问题的难度和覆盖范围进行了精细的控制,以确保基准的有效性和可靠性。具体参数设置和损失函数等技术细节未在摘要中提及,属于未知信息。

🖼️ 关键图片

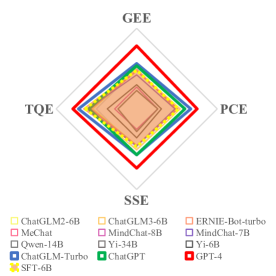

📊 实验亮点

实验结果表明,CPsyExam能够有效区分不同LLM在心理学知识和案例分析方面的能力。不同LLM在CPsyExam上的表现存在显著差异,表明该基准能够为LLM的心理学能力提升提供有效的反馈。具体的性能数据和提升幅度未在摘要中提及,属于未知信息。

🎯 应用场景

CPsyExam可用于评估和提升LLM在心理咨询、心理健康教育、人机交互等领域的应用能力。通过该基准,可以开发出更智能、更专业的心理学AI助手,为用户提供个性化的心理健康服务。未来,该基准还可以扩展到其他语言和文化背景,促进全球心理健康领域的发展。

📄 摘要(原文)

In this paper, we introduce a novel psychological benchmark, CPsyExam, constructed from questions sourced from Chinese language examinations. CPsyExam is designed to prioritize psychological knowledge and case analysis separately, recognizing the significance of applying psychological knowledge to real-world scenarios. From the pool of 22k questions, we utilize 4k to create the benchmark that offers balanced coverage of subjects and incorporates a diverse range of case analysis techniques.Furthermore, we evaluate a range of existing large language models~(LLMs), spanning from open-sourced to API-based models. Our experiments and analysis demonstrate that CPsyExam serves as an effective benchmark for enhancing the understanding of psychology within LLMs and enables the comparison of LLMs across various granularities.