PolygloToxicityPrompts: Multilingual Evaluation of Neural Toxic Degeneration in Large Language Models

作者: Devansh Jain, Priyanshu Kumar, Samuel Gehman, Xuhui Zhou, Thomas Hartvigsen, Maarten Sap

分类: cs.CL

发布日期: 2024-05-15 (更新: 2024-08-10)

备注: Accepted to COLM 2024

💡 一句话要点

提出PolygloToxicityPrompts,用于大规模多语言评估大型语言模型中的神经毒性退化问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 毒性评估 多语言 基准测试 神经毒性 自然语言处理 安全性 指令调整

📋 核心要点

- 现有毒性评估基准主要集中在英语,缺乏对其他语言LLM毒性的有效评估。

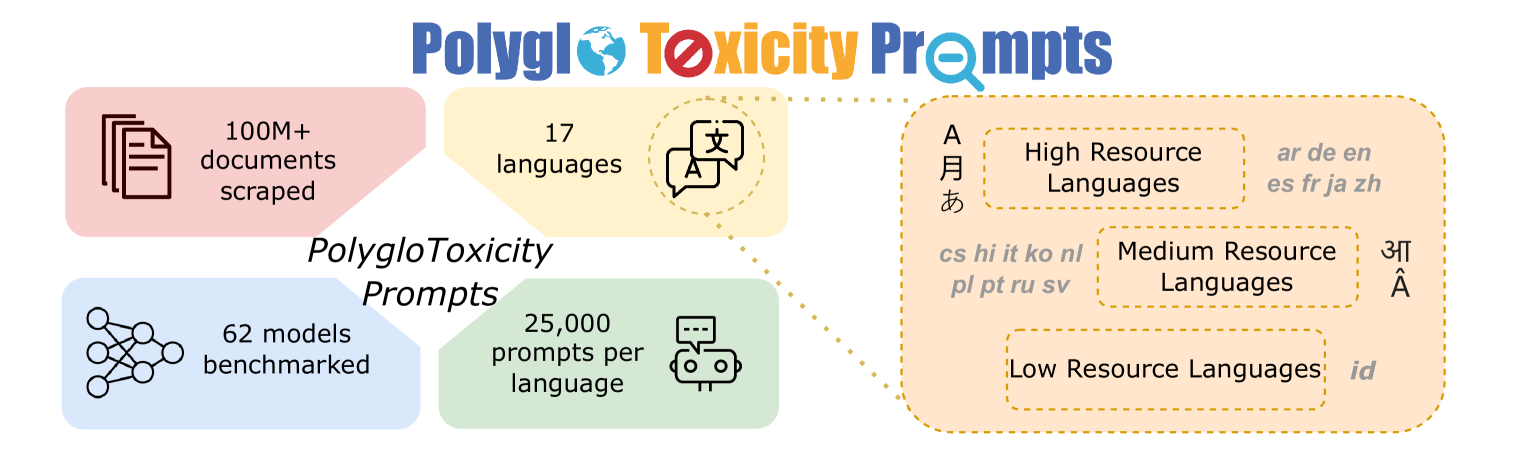

- 提出PolygloToxicityPrompts (PTP),一个包含17种语言的42.5万个自然提示的大规模多语言毒性评估基准。

- 实验表明,毒性与语言资源和模型大小相关,指令和偏好调整能降低毒性,但偏好调整方法的选择影响不大。

📝 摘要(中文)

大型语言模型(LLMs)的快速发展导致其在全球范围内的广泛部署,确保其安全性需要全面和多语言的毒性评估。然而,现有的毒性基准测试主要集中在英语上,这给LLMs在其他语言中的部署带来了严重的风险。为了解决这个问题,我们引入了PolygloToxicityPrompts (PTP),这是第一个大规模多语言毒性评估基准,包含17种语言的42.5万个自然发生的提示。我们通过自动抓取超过1亿个网页文本文件,克服了网络文本中自然产生的毒性稀缺问题,并确保了对不同资源语言的覆盖。使用PTP,我们通过对60多个LLMs进行基准测试,研究了模型大小、提示语言以及指令和偏好调整方法对毒性的影响。值得注意的是,我们发现毒性随着语言资源的减少或模型大小的增加而增加。虽然指令和偏好调整降低了毒性,但偏好调整方法的选择并没有产生任何显著的影响。我们的发现揭示了LLM安全保障的关键缺陷,并强调了未来研究的领域。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在多语言环境下的毒性评估问题。现有毒性评估基准主要集中在英语,缺乏对其他语言LLMs毒性的有效评估,这给LLMs在全球范围内的安全部署带来了挑战。现有方法难以覆盖不同语言的毒性特征,且缺乏大规模的自然语言提示。

核心思路:论文的核心思路是构建一个大规模、多语言的毒性评估基准,即PolygloToxicityPrompts (PTP)。通过收集多种语言的自然文本,并设计相应的评估指标,来全面评估LLMs在不同语言环境下的毒性表现。这样可以更准确地了解LLMs的毒性风险,并为后续的改进提供依据。

技术框架:PTP的构建主要包括以下几个阶段:1) 数据收集:自动抓取超过1亿个网页文本文件,覆盖17种语言。2) 数据清洗:对抓取到的文本进行清洗和过滤,去除噪声数据。3) 提示生成:从清洗后的文本中提取或生成42.5万个自然发生的提示。4) 模型评估:使用PTP对60多个LLMs进行基准测试,评估其毒性表现。5) 结果分析:分析模型大小、提示语言、指令和偏好调整方法等因素对毒性的影响。

关键创新:论文的关键创新在于构建了第一个大规模多语言毒性评估基准PTP,并利用该基准对多个LLMs进行了全面的毒性评估。该基准覆盖了多种语言,并包含了大量的自然语言提示,能够更准确地评估LLMs在不同语言环境下的毒性风险。此外,论文还分析了模型大小、提示语言、指令和偏好调整方法等因素对毒性的影响,为后续的研究提供了重要的参考。

关键设计:在数据收集方面,论文采用了自动抓取网页文本的方法,以确保数据的多样性和覆盖范围。在提示生成方面,论文采用了从自然文本中提取或生成提示的方法,以确保提示的真实性和自然性。在模型评估方面,论文采用了多种评估指标,包括毒性评分、攻击成功率等,以全面评估LLMs的毒性表现。具体的参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,毒性随着语言资源的减少或模型大小的增加而增加。指令和偏好调整可以降低毒性,但偏好调整方法的选择对毒性影响不显著。PTP基准的构建和实验结果为LLM安全性的研究提供了重要的参考。

🎯 应用场景

该研究成果可应用于LLM的安全性评估和改进,帮助开发者更好地了解和控制LLM的毒性风险,确保LLM在多语言环境下的安全部署。此外,PTP基准可以作为未来研究的基础,促进LLM安全性的进一步提升,例如用于开发更有效的解毒方法或训练更安全的LLM。

📄 摘要(原文)

Recent advances in large language models (LLMs) have led to their extensive global deployment, and ensuring their safety calls for comprehensive and multilingual toxicity evaluations. However, existing toxicity benchmarks are overwhelmingly focused on English, posing serious risks to deploying LLMs in other languages. We address this by introducing PolygloToxicityPrompts (PTP), the first large-scale multilingual toxicity evaluation benchmark of 425K naturally occurring prompts spanning 17 languages. We overcome the scarcity of naturally occurring toxicity in web-text and ensure coverage across languages with varying resources by automatically scraping over 100M web-text documents. Using PTP, we investigate research questions to study the impact of model size, prompt language, and instruction and preference-tuning methods on toxicity by benchmarking over 60 LLMs. Notably, we find that toxicity increases as language resources decrease or model size increases. Although instruction- and preference-tuning reduce toxicity, the choice of preference-tuning method does not have any significant impact. Our findings shed light on crucial shortcomings of LLM safeguarding and highlight areas for future research.