Is Your LLM Outdated? A Deep Look at Temporal Generalization

作者: Chenghao Zhu, Nuo Chen, Yufei Gao, Yunyi Zhang, Prayag Tiwari, Benyou Wang

分类: cs.CL, cs.AI

发布日期: 2024-05-14 (更新: 2025-04-02)

备注: NAACL 2025 Oral

期刊: Proceedings of the 2025 Conference of the Nations of the Americas Chapter of the Association for Computational Linguistics: Human Language Technologies (Volume 1: Long Papers) (2025) 7433-7457

DOI: 10.18653/v1/2025.naacl-long.381

🔗 代码/项目: GITHUB

💡 一句话要点

提出FreshBench评估框架,揭示大语言模型在时序泛化能力上的偏差与退化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 时序泛化 评估框架 FreshBench 时间偏差

📋 核心要点

- 现有LLM评估benchmark缺乏对模型时序泛化能力的深入考察,无法有效衡量模型在时间动态变化下的适应性。

- 论文提出FreshBench评估框架,利用新鲜文本和事件预测任务,避免数据泄露和主观偏见,从而更准确地评估LLM的时序泛化能力。

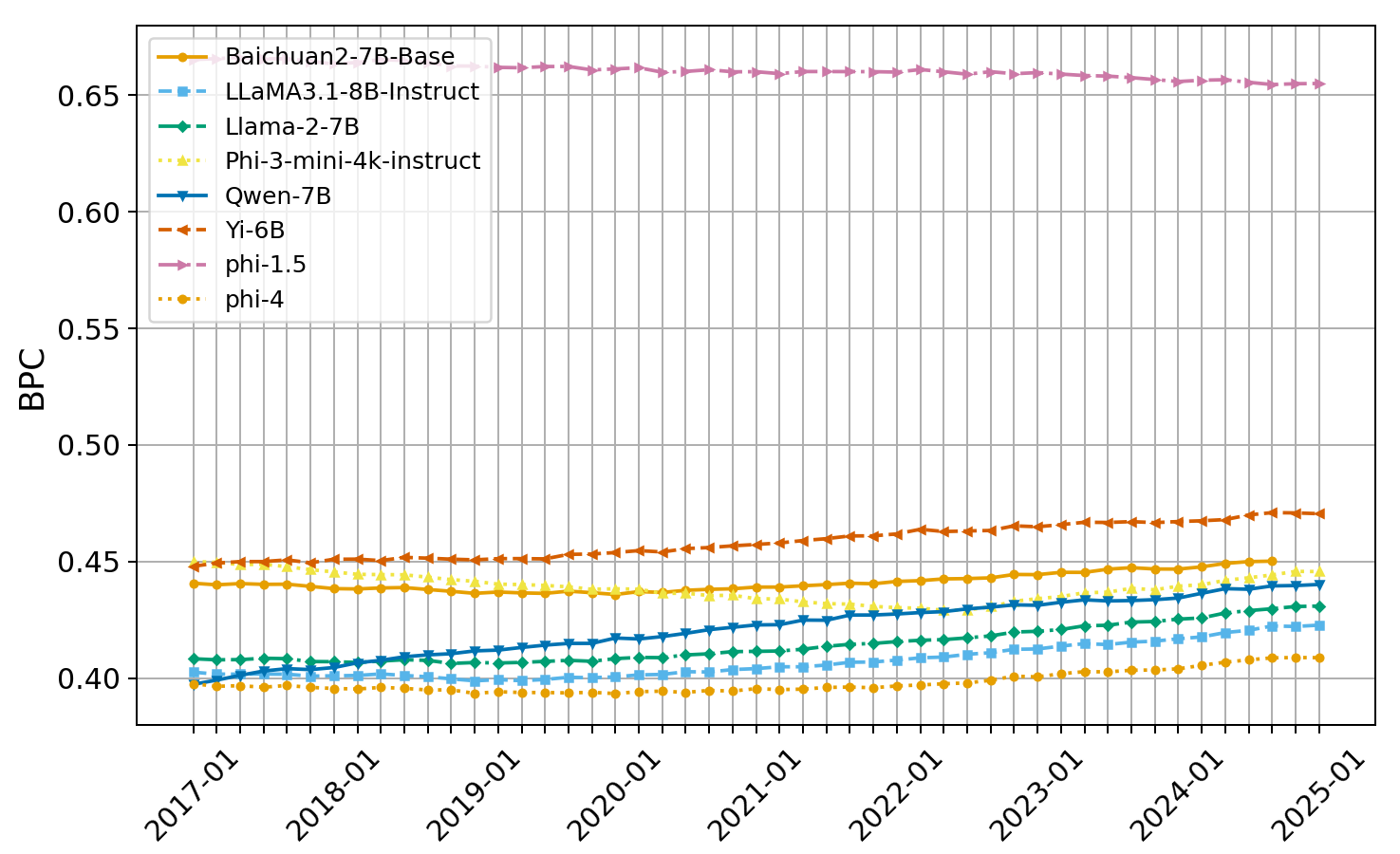

- 实验结果表明,LLM存在显著的时序偏差,且性能随时间推移而下降,开源模型在长期适应性方面优于闭源模型。

📝 摘要(中文)

大型语言模型(LLM)的快速发展催生了考虑时间动态的基准测试。然而,由于语言和信息固有的动态性,我们对于这些模型在不同时间背景下的泛化能力仍然缺乏深入理解。本文提出了LLM中的时间泛化概念,包括过去和未来泛化中的偏差。我们引入了FreshBench,这是一个新的评估框架,它采用新鲜文本和事件预测来评估LLM的时间适应性,确保评估过程免受数据泄露和主观偏差的影响。实验表明,LLM存在显著的时间偏差,并且性能随时间推移而下降。研究结果表明,强大的模型虽然最初表现优异,但在未来泛化中往往会更快地衰退。此外,强大的开源模型比其闭源模型表现出更好的长期适应性。代码已在https://github.com/FreedomIntelligence/FreshBench上发布。

🔬 方法详解

问题定义:现有的大语言模型评估benchmark在评估模型时序泛化能力时存在不足。由于语言和信息的动态变化,模型在不同时间背景下的表现可能存在差异。现有的评估方法难以有效衡量模型在面对新出现的事件和信息时的适应能力,并且容易受到数据泄露的影响,导致评估结果不准确。因此,如何准确评估LLM的时序泛化能力是一个重要的研究问题。

核心思路:论文的核心思路是构建一个更加严格和客观的评估框架,即FreshBench,来评估LLM的时序泛化能力。FreshBench通过使用新鲜的文本和事件预测任务,避免了数据泄露的可能性,从而更准确地反映模型在面对新信息时的表现。此外,FreshBench还考虑了过去和未来泛化中的偏差,从而更全面地评估模型的时序适应性。

技术框架:FreshBench评估框架主要包含以下几个阶段: 1. 数据收集:收集不同时间段的文本数据和事件数据,确保数据的时效性和多样性。 2. 任务构建:构建新鲜文本和事件预测任务,要求模型根据历史信息预测未来的文本内容或事件发生。 3. 模型评估:使用构建的任务评估LLM的时序泛化能力,并分析模型在不同时间段的表现。 4. 偏差分析:分析模型在过去和未来泛化中的偏差,从而更深入地了解模型的时序适应性。

关键创新:FreshBench的关键创新在于其评估的严格性和客观性。它通过使用新鲜的文本和事件预测任务,避免了数据泄露的可能性,从而更准确地反映模型在面对新信息时的表现。此外,FreshBench还考虑了过去和未来泛化中的偏差,从而更全面地评估模型的时序适应性。与现有方法相比,FreshBench能够更准确地评估LLM的时序泛化能力,并为模型改进提供更有效的指导。

关键设计:FreshBench的关键设计包括: 1. 新鲜数据选择:选择在评估时间点之前未被模型训练过的数据,确保评估的公平性。 2. 事件预测任务设计:设计能够反映真实世界事件的任务,例如预测新闻标题或事件描述。 3. 偏差评估指标:设计能够量化模型在过去和未来泛化中偏差的指标,例如时间衰减率或偏差幅度。这些指标能够帮助研究人员更深入地了解模型的时序适应性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM存在显著的时序偏差,并且性能随时间推移而下降。具体来说,强大的模型虽然最初表现优异,但在未来泛化中往往会更快地衰退。此外,强大的开源模型比其闭源模型表现出更好的长期适应性。这些发现为LLM的开发和应用提供了重要的指导。

🎯 应用场景

该研究成果可应用于评估和改进大语言模型在信息检索、新闻推荐、金融预测等领域的时序泛化能力。通过FreshBench评估框架,可以帮助开发者更好地了解模型的局限性,并针对性地进行优化,从而提高模型在实际应用中的可靠性和准确性。此外,该研究也为未来LLM的长期发展提供了重要的参考。

📄 摘要(原文)

The rapid advancement of Large Language Models (LLMs) has led to the development of benchmarks that consider temporal dynamics, however, there remains a gap in understanding how well these models can generalize across temporal contexts due to the inherent dynamic nature of language and information. This paper introduces the concept of temporal generalization in LLMs, including bias in past and future generalizations. Then we introduce FreshBench, a new evaluation framework that employs fresh text and event prediction for assessing LLMs' temporal adaptability, ensuring the evaluation process free from data leakage and subjective bias. The experiment shows significant temporal biases and a decline in performance over time. Our findings reveal that powerful models, while initially superior, tend to decline more rapidly in future generalization. Additionally, powerful open-source models demonstrate better long-term adaptability compared to their closed-source counterparts. Our code is available at https://github.com/FreedomIntelligence/FreshBench.