UCCIX: Irish-eXcellence Large Language Model

作者: Khanh-Tung Tran, Barry O'Sullivan, Hoang D. Nguyen

分类: cs.CL, cs.AI

发布日期: 2024-05-13

💡 一句话要点

UCCIX:面向极低资源爱尔兰语的大语言模型持续预训练框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 低资源语言 爱尔兰语 持续预训练 知识迁移

📋 核心要点

- 现有大语言模型主要集中于高资源语言,对爱尔兰语等极低资源语言的支持严重不足。

- 论文提出一种新颖的持续预训练框架,专门为极低资源语言定制,降低了对大规模数据的依赖。

- 实验结果表明,UCCIX模型在爱尔兰语任务上优于更大的模型,性能提升高达12%。

📝 摘要(中文)

本文介绍了UCCIX,一个开源的、基于爱尔兰语的大语言模型,旨在解决大语言模型主要集中于高资源语言,而对爱尔兰语等极低资源语言支持不足的问题。论文提出了一种新颖的持续预训练框架,专门为极低资源语言定制,仅需少量文本数据即可完成训练,打破了传统大语言模型对数据规模的依赖。UCCIX模型基于Llama 2-13B,在爱尔兰语任务上超越了更大的模型,性能提升高达12%,验证了该方法的有效性和效率。此外,论文还贡献了全面的爱尔兰语基准数据集,包括爱尔兰语问答数据集IrishQA和爱尔兰语版本的MT-bench,为爱尔兰语大语言模型系统的评估和未来研究提供了支持。该研究旨在保护和推广爱尔兰语,以及爱尔兰的知识和文化,并为其他本土语言的大语言模型适配提供框架。

🔬 方法详解

问题定义:论文旨在解决大语言模型在爱尔兰语等极低资源语言上的应用问题。现有方法依赖于大规模数据集,这对于资源匮乏的语言来说是巨大的挑战,导致模型性能不佳,无法有效支持这些语言的数字化发展。

核心思路:论文的核心思路是利用持续预训练,在已有的预训练模型(Llama 2-13B)的基础上,使用少量的爱尔兰语数据进行进一步训练。这种方法能够有效地将通用语言知识迁移到爱尔兰语上,从而在数据量有限的情况下提升模型性能。

技术框架:整体框架包括以下步骤:首先,选择一个合适的预训练模型作为基础模型;然后,收集和清洗爱尔兰语文本数据;接着,使用这些数据对基础模型进行持续预训练;最后,在爱尔兰语任务上对模型进行微调和评估。论文还贡献了IrishQA和MT-bench的爱尔兰语版本,用于模型的评估。

关键创新:该论文的关键创新在于提出了一种针对极低资源语言的持续预训练框架,该框架能够在数据量有限的情况下,有效地提升大语言模型在这些语言上的性能。此外,论文还贡献了爱尔兰语的基准数据集,为该领域的研究提供了宝贵的资源。

关键设计:论文基于Llama 2-13B模型,并使用爱尔兰语数据进行持续预训练。具体的参数设置和损失函数等技术细节在论文中可能没有详细描述,属于未知信息。但整体思路是利用已有的预训练模型作为起点,通过少量数据进行微调,从而快速适应目标语言。

🖼️ 关键图片

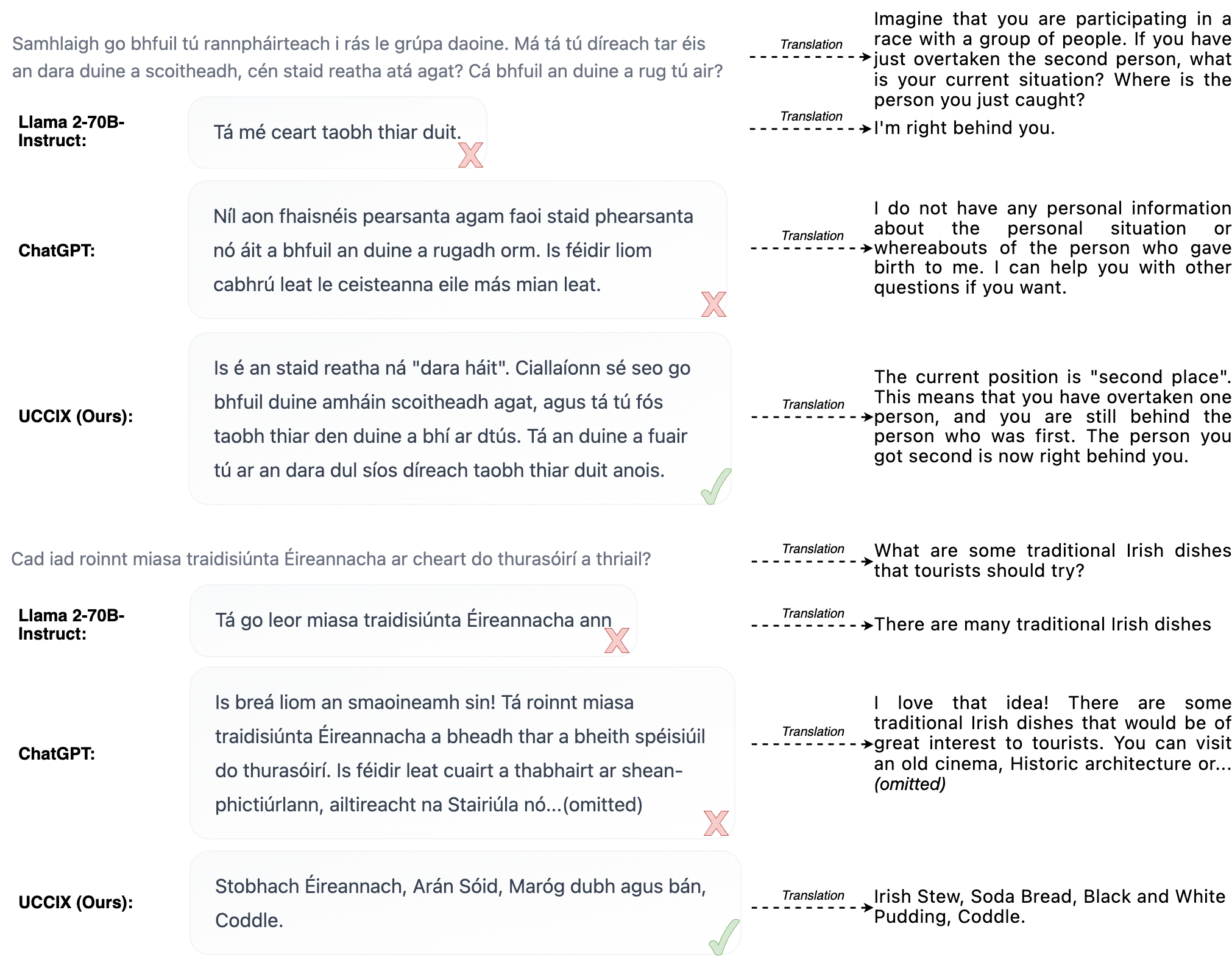

📊 实验亮点

UCCIX模型在爱尔兰语任务上表现出色,超越了更大的模型,性能提升高达12%。这表明该论文提出的持续预训练框架在极低资源语言上具有显著优势。同时,论文贡献的爱尔兰语基准数据集为后续研究提供了重要的评估工具。

🎯 应用场景

该研究成果可应用于爱尔兰语的机器翻译、问答系统、文本生成等领域,有助于保护和推广爱尔兰语文化。此外,该方法还可推广到其他低资源语言,促进全球语言多样性的保护和发展,并为相关语言的信息化建设提供技术支持。

📄 摘要(原文)

The development of Large Language Models (LLMs) has predominantly focused on high-resource languages, leaving extremely low-resource languages like Irish with limited representation. This work presents UCCIX, a pioneering effort on the development of an open-source Irish-based LLM. We propose a novel framework for continued pre-training of LLMs specifically adapted for extremely low-resource languages, requiring only a fraction of the textual data typically needed for training LLMs according to scaling laws. Our model, based on Llama 2-13B, outperforms much larger models on Irish language tasks with up to 12% performance improvement, showcasing the effectiveness and efficiency of our approach. We also contribute comprehensive Irish benchmarking datasets, including IrishQA, a question-answering dataset, and Irish version of MT-bench. These datasets enable rigorous evaluation and facilitate future research in Irish LLM systems. Our work aims to preserve and promote the Irish language, knowledge, and culture of Ireland in the digital era while providing a framework for adapting LLMs to other indigenous languages.