Open-vocabulary Auditory Neural Decoding Using fMRI-prompted LLM

作者: Xiaoyu Chen, Changde Du, Che Liu, Yizhe Wang, Huiguang He

分类: cs.HC, cs.CL

发布日期: 2024-05-13

💡 一句话要点

提出Brain Prompt GPT,利用fMRI信号提示LLM实现开放词汇听觉神经解码

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经解码 脑机接口 fMRI 大型语言模型 GPT-2 开放词汇 听觉语义

📋 核心要点

- 现有脑机接口研究在解码fMRI信号中的语义信息时,主要集中于小词汇集,限制了开放词汇连续文本解码的探索。

- 论文提出Brain Prompt GPT (BP-GPT),利用fMRI提取的脑表示作为提示,驱动GPT-2等大型语言模型进行解码。

- 实验结果表明,BP-GPT在听觉语义解码任务上显著优于现有方法,METEOR指标提升高达4.61%,BERTScore提升2.43%。

📝 摘要(中文)

本文提出了一种新的方法,即Brain Prompt GPT (BP-GPT),用于从脑信号中解码语言信息,特别是从fMRI信号中解码语义信息。现有方法主要集中在解码小词汇集,而本文旨在探索开放词汇的连续文本解码。BP-GPT使用从fMRI中提取的脑表示作为提示,利用GPT-2将fMRI信号解码为刺激文本。此外,引入了文本到文本的基线,并将fMRI提示与文本提示对齐。通过引入文本到文本的基线,BP-GPT可以提取更鲁棒的脑提示,并促进预训练LLM的解码。在开源听觉语义解码数据集上的评估表明,与最先进的方法相比,BP-GPT在所有受试者上的METEOR指标上实现了高达4.61%的显著提升,在BERTScore指标上实现了2.43%的提升。实验结果表明,使用脑表示作为提示来进一步驱动LLM进行听觉神经解码是可行且有效的。

🔬 方法详解

问题定义:现有基于fMRI信号的神经解码方法主要集中于解码有限的词汇集,无法有效处理开放词汇的连续文本解码任务。这些方法难以捕捉大脑活动与复杂语义信息之间的关联,限制了其在实际脑机接口应用中的潜力。

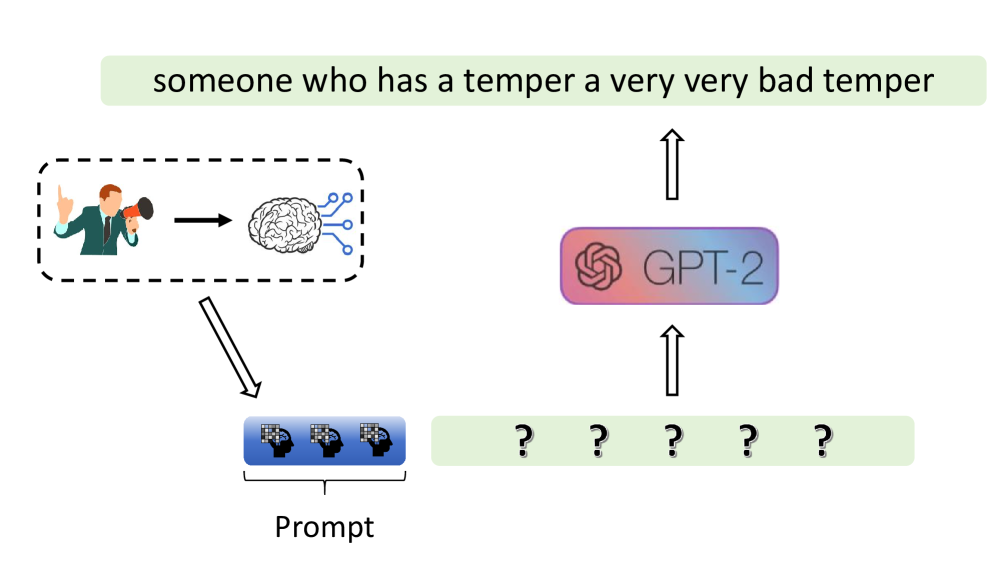

核心思路:论文的核心思路是将fMRI信号提取的脑表示作为提示(Prompt),输入到预训练的大型语言模型(LLM)中,利用LLM强大的语言生成能力,将脑信号解码为连续的文本。通过这种方式,可以有效利用LLM的先验知识,提高解码的准确性和泛化能力。

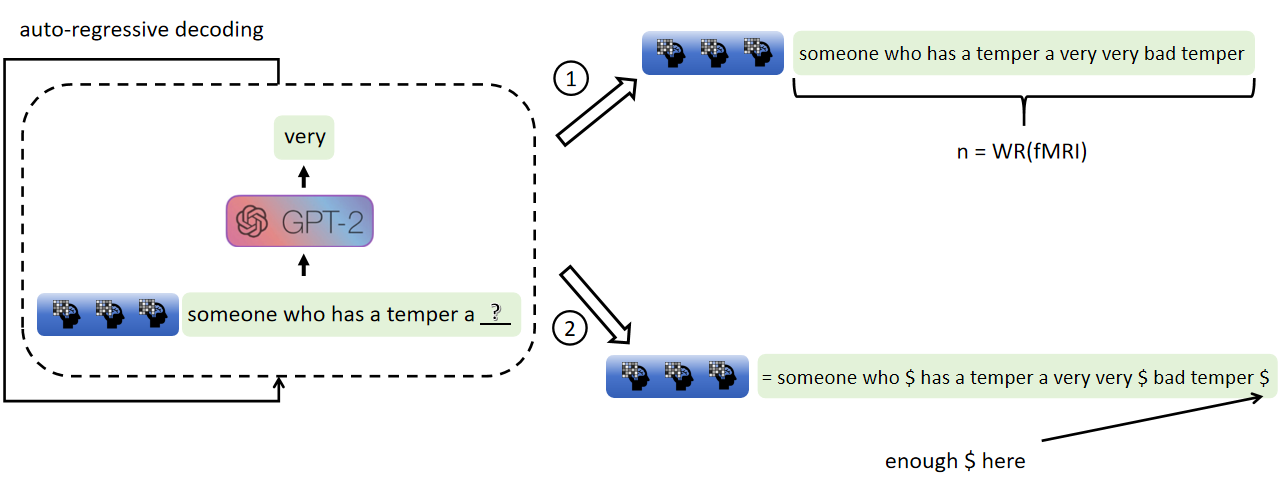

技术框架:BP-GPT的整体框架包括以下几个主要模块:1) fMRI信号预处理和特征提取;2) 脑表示(Brain Representation)生成,将fMRI信号转换为LLM可理解的提示;3) 文本到文本基线,用于对齐fMRI提示和文本提示,增强脑提示的鲁棒性;4) GPT-2解码器,利用脑提示生成文本。整个流程通过优化脑提示和解码器参数,实现fMRI信号到文本的转换。

关键创新:该方法最重要的创新点在于将脑表示作为提示,驱动预训练的LLM进行神经解码。与传统的直接解码方法相比,BP-GPT充分利用了LLM的语言知识,避免了从头训练解码模型的需要,提高了解码的效率和准确性。此外,引入文本到文本的基线,进一步提升了脑提示的质量。

关键设计:在关键设计方面,论文可能涉及以下技术细节:1) 如何将fMRI信号转换为LLM可理解的脑表示,例如使用线性映射或神经网络;2) 如何设计文本到文本的基线,例如使用Transformer模型;3) 如何优化脑提示和GPT-2解码器的参数,例如使用交叉熵损失函数或对比学习方法;4) 如何选择合适的GPT-2模型和训练策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BP-GPT在开放词汇听觉神经解码任务上取得了显著的性能提升。与最先进的方法相比,BP-GPT在METEOR指标上提升了高达4.61%,在BERTScore指标上提升了2.43%。这些结果表明,使用脑表示作为提示来驱动LLM进行神经解码是有效可行的,为未来的脑机接口研究提供了新的思路。

🎯 应用场景

该研究成果可应用于脑机接口领域,例如帮助失语症患者进行交流,或用于监测和理解大脑的认知活动。通过解码大脑活动,可以实现更自然、更高效的人机交互方式,为医疗、教育和娱乐等领域带来新的可能性。未来,该技术有望应用于更复杂的认知任务解码,例如情感识别和意图预测。

📄 摘要(原文)

Decoding language information from brain signals represents a vital research area within brain-computer interfaces, particularly in the context of deciphering the semantic information from the fMRI signal. However, many existing efforts concentrate on decoding small vocabulary sets, leaving space for the exploration of open vocabulary continuous text decoding. In this paper, we introduce a novel method, the \textbf{Brain Prompt GPT (BP-GPT)}. By using the brain representation that is extracted from the fMRI as a prompt, our method can utilize GPT-2 to decode fMRI signals into stimulus text. Further, we introduce a text-to-text baseline and align the fMRI prompt to the text prompt. By introducing the text-to-text baseline, our BP-GPT can extract a more robust brain prompt and promote the decoding of pre-trained LLM. We evaluate our BP-GPT on the open-source auditory semantic decoding dataset and achieve a significant improvement up to $4.61\%$ on METEOR and $2.43\%$ on BERTScore across all the subjects compared to the state-of-the-art method. The experimental results demonstrate that using brain representation as a prompt to further drive LLM for auditory neural decoding is feasible and effective.