SaudiBERT: A Large Language Model Pretrained on Saudi Dialect Corpora

作者: Faisal Qarah

分类: cs.CL, cs.AI

发布日期: 2024-05-10

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出SaudiBERT,一个基于沙特方言语料预训练的大型语言模型,显著提升沙特方言文本理解任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 沙特方言 预训练语言模型 BERT 情感分析 文本分类 阿拉伯语 自然语言处理

📋 核心要点

- 现有阿拉伯语语言模型在处理沙特方言文本时表现不佳,缺乏针对性训练数据是主要瓶颈。

- SaudiBERT通过在自建的大规模沙特方言语料库上进行预训练,从而提升模型对沙特方言的理解能力。

- 实验表明,SaudiBERT在情感分析和文本分类任务上显著优于其他多方言阿拉伯语模型,F1值分别达到86.15%和87.86%。

📝 摘要(中文)

本文介绍了SaudiBERT,一个专门基于沙特方言文本预训练的单方言阿拉伯语语言模型。为了验证模型的有效性,我们将SaudiBERT与六种不同的多方言阿拉伯语语言模型在11个评估数据集上进行了比较,这些数据集分为两组:情感分析和文本分类。SaudiBERT在这两组中分别取得了86.15%和87.86%的平均F1分数,显著优于所有其他比较模型。此外,我们还提出了两个新的沙特方言语料库:沙特推文大型语料库(STMC),包含超过1.41亿条沙特方言推文,以及沙特论坛语料库(SFC),包含从五个沙特在线论坛收集的15.2 GB文本。这两个语料库都用于预训练所提出的模型,并且是文献中报道的最大的沙特方言语料库。结果证实了SaudiBERT在理解和分析沙特方言阿拉伯语文本方面的有效性,在大多数任务中取得了最先进的结果,并超过了研究中包含的其他语言模型。SaudiBERT模型已在Hugging Face上公开。

🔬 方法详解

问题定义:现有阿拉伯语预训练模型,尤其是多方言模型,在处理特定地区的方言(如沙特方言)时,由于训练数据分布不匹配,性能会显著下降。缺乏大规模、高质量的沙特方言语料库是制约模型性能提升的关键因素。

核心思路:论文的核心思路是构建一个专门针对沙特方言的预训练语言模型,通过在海量的沙特方言文本数据上进行训练,使模型能够更好地捕捉沙特方言的语言特征和语义信息。这种针对性训练能够有效提升模型在沙特方言相关任务上的表现。

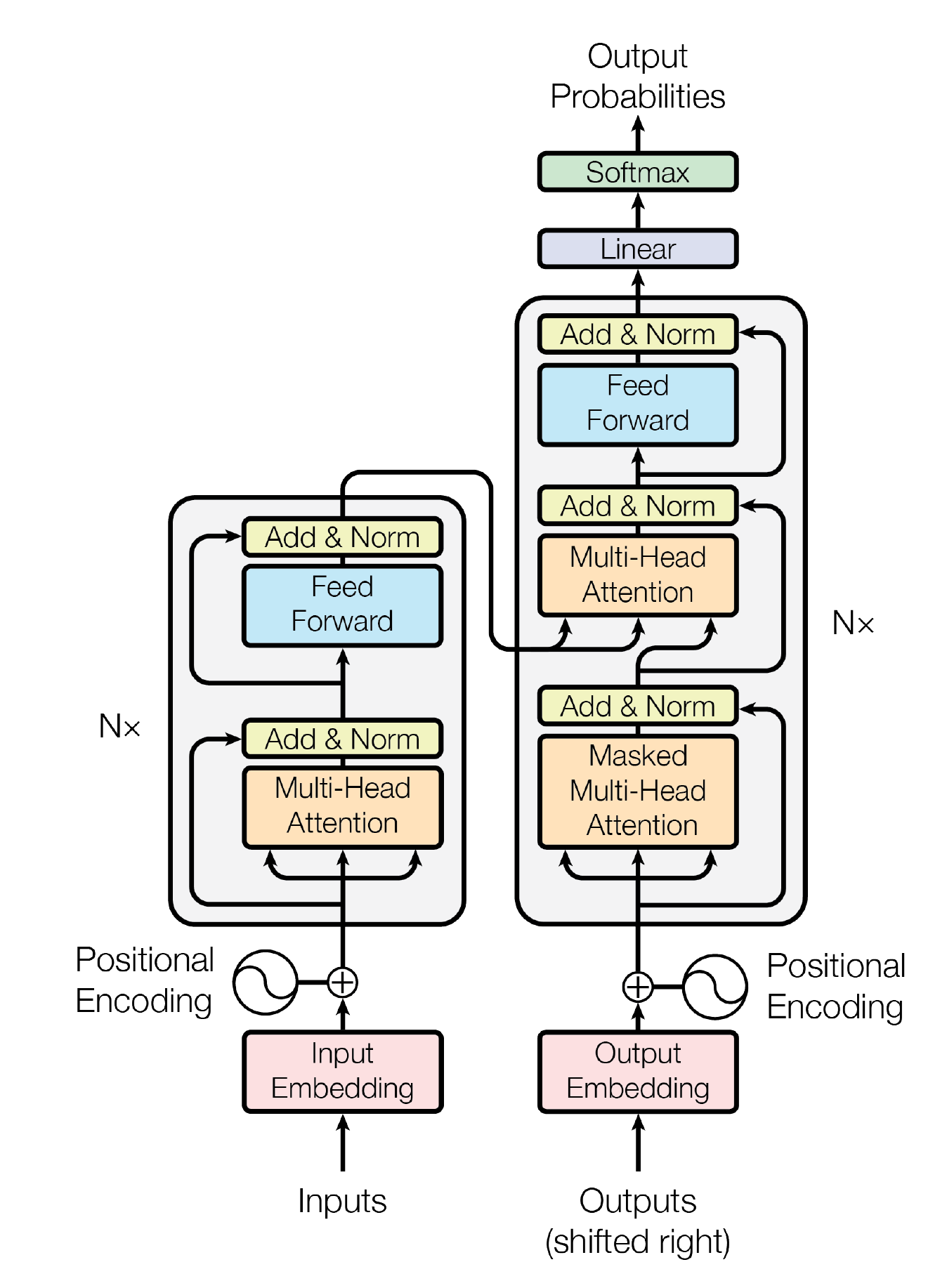

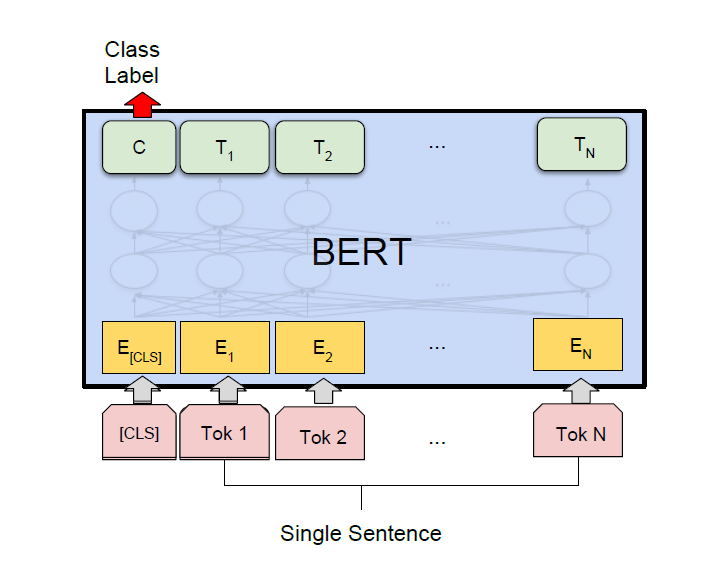

技术框架:SaudiBERT的整体框架遵循了BERT的经典结构,即Transformer编码器。主要流程包括:1) 构建大规模沙特方言语料库(STMC和SFC);2) 使用构建的语料库对BERT模型进行预训练;3) 在下游任务(情感分析、文本分类)上对预训练模型进行微调。

关键创新:该论文的关键创新在于构建了两个迄今为止最大的沙特方言语料库STMC和SFC,并利用这些语料库预训练了SaudiBERT模型。与以往的多方言模型相比,SaudiBERT专注于单一方言,从而能够更精细地学习该方言的语言模式。

关键设计:SaudiBERT采用了标准的BERT模型结构,具体参数设置(如Transformer层数、隐藏层大小、注意力头数等)未知,但可以推测作者可能根据沙特方言的特点进行了一些调整。损失函数采用BERT常用的Masked Language Modeling (MLM) 和 Next Sentence Prediction (NSP) (如果使用)。具体微调过程中的参数设置也未知。

🖼️ 关键图片

📊 实验亮点

SaudiBERT在11个沙特方言数据集上进行了评估,包括情感分析和文本分类任务。实验结果表明,SaudiBERT在情感分析任务上取得了86.15%的平均F1分数,在文本分类任务上取得了87.86%的平均F1分数,显著优于其他六种多方言阿拉伯语模型。这些结果表明,SaudiBERT在理解和分析沙特方言文本方面具有显著优势。

🎯 应用场景

SaudiBERT在沙特阿拉伯地区的自然语言处理应用中具有广泛的应用前景,例如:社交媒体情感分析、舆情监控、客户服务、智能问答、内容推荐等。该模型能够更准确地理解沙特方言文本,从而提升相关应用的性能和用户体验。未来,可以将其应用于语音识别、机器翻译等领域,促进沙特方言的数字化发展。

📄 摘要(原文)

In this paper, we introduce SaudiBERT, a monodialect Arabic language model pretrained exclusively on Saudi dialectal text. To demonstrate the model's effectiveness, we compared SaudiBERT with six different multidialect Arabic language models across 11 evaluation datasets, which are divided into two groups: sentiment analysis and text classification. SaudiBERT achieved average F1-scores of 86.15\% and 87.86\% in these groups respectively, significantly outperforming all other comparative models. Additionally, we present two novel Saudi dialectal corpora: the Saudi Tweets Mega Corpus (STMC), which contains over 141 million tweets in Saudi dialect, and the Saudi Forums Corpus (SFC), which includes 15.2 GB of text collected from five Saudi online forums. Both corpora are used in pretraining the proposed model, and they are the largest Saudi dialectal corpora ever reported in the literature. The results confirm the effectiveness of SaudiBERT in understanding and analyzing Arabic text expressed in Saudi dialect, achieving state-of-the-art results in most tasks and surpassing other language models included in the study. SaudiBERT model is publicly available on \url{https://huggingface.co/faisalq/SaudiBERT}.