Exploring the Human-LLM Synergy in Advancing Theory-driven Qualitative Analysis

作者: Han Meng, Yitian Yang, Wayne Fu, Jungup Lee, Yunan Li, Yi-Chieh Lee

分类: cs.HC, cs.CL, cs.CY

发布日期: 2024-05-09 (更新: 2025-11-27)

备注: 51 pages, 6 figures, accepted by ACM Trans. Comput.-Hum. Interact (TOCHI)

💡 一句话要点

提出CHALET,利用人-LLM协同推进理论驱动的定性分析,发现新见解。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 大型语言模型 定性分析 理论驱动 迭代编码

📋 核心要点

- 现有方法难以充分挖掘LLM在理论框架外,人-LLM协作发现新见解的潜力。

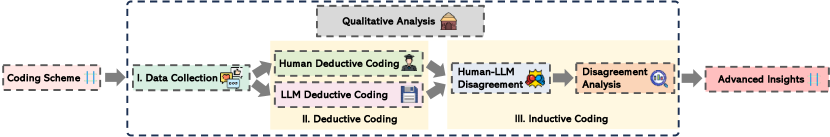

- CHALET通过人-LLM迭代编码、分歧分析和概念化,推进理论驱动的定性分析。

- 实验表明,CHALET能有效揭示精神疾病污名在认知、情感和行为维度上的潜在主题。

📝 摘要(中文)

定性编码是人机交互(HCI)领域中一项要求高但至关重要的研究方法。虽然最近的研究表明,大型语言模型(LLM)有能力在理论框架内执行定性编码,但它们在协作式人-LLM发现和生成超出初始理论的新见解方面的潜力仍未得到充分探索。为了弥补这一差距,我们提出了一种新颖的方法CHALET,它利用人-LLM伙伴关系的力量,通过促进迭代编码、分歧分析和定性数据的概念化来推进理论驱动的定性分析。我们通过将CHALET应用于与精神疾病污名相关的对话的定性分析,并使用归因模型作为理论框架,证明了CHALET的效用。结果突出了人-LLM协作在揭示认知、情感和行为维度上污名的潜在主题方面的独特贡献。我们讨论了人-LLM协作方法对HCI社区及其他领域的基于理论的定性分析的方法论意义。

🔬 方法详解

问题定义:论文旨在解决如何更有效地利用LLM辅助定性研究人员,在理论框架下发现新的、更深层次的见解的问题。现有方法主要集中于LLM在既定理论框架内的编码能力,忽略了LLM与人类研究者协同探索、挑战和扩展现有理论的潜力。现有方法的痛点在于缺乏有效的人-LLM协作机制,难以充分发挥LLM的创造性和洞察力。

核心思路:论文的核心思路是构建一个支持人-LLM迭代协作的框架,使LLM能够辅助研究者进行编码、分析分歧,并在此基础上提出新的概念和主题。通过迭代过程,人类研究者可以引导LLM的分析方向,而LLM则可以提供新的视角和见解,从而共同推进理论发展。

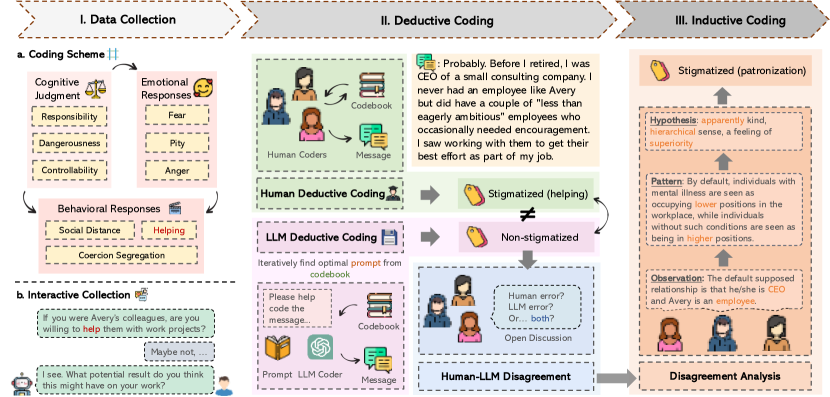

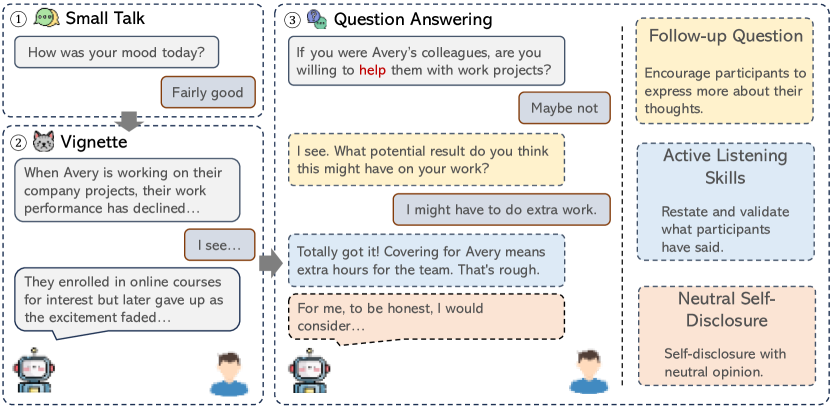

技术框架:CHALET框架包含三个主要阶段:1) 迭代编码:人类研究者和LLM独立对数据进行编码,并记录编码过程中的思考和理由。2) 分歧分析:比较人类和LLM的编码结果,识别分歧点,并分析分歧的原因。3) 概念化:基于编码结果和分歧分析,人类研究者和LLM共同提出新的概念和主题,并对现有理论进行修正和扩展。

关键创新:该论文的关键创新在于提出了一个系统化的人-LLM协作框架,用于理论驱动的定性分析。与以往研究仅关注LLM的自动化编码能力不同,CHALET强调人-LLM的互动和协作,充分发挥了人类的领域知识和LLM的计算能力。这种协作模式能够促进更深入的理论探索和创新。

关键设计:CHALET框架的关键设计包括:1) 使用清晰的编码指南,确保人类和LLM对编码任务有共同的理解。2) 设计有效的分歧分析方法,帮助研究者理解LLM的推理过程,并识别潜在的偏差。3) 采用迭代式的协作流程,允许人类研究者根据LLM的反馈调整编码策略,并引导LLM进行更深入的分析。具体的参数设置、损失函数、网络结构等技术细节未在摘要中提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

CHALET应用于精神疾病污名相关的对话分析,使用归因模型作为理论框架。实验结果表明,人-LLM协作能够揭示认知、情感和行为维度上污名的潜在主题,证明了该方法在发现潜在主题方面的有效性。具体的性能数据和提升幅度未在摘要中给出,属于未知信息。

🎯 应用场景

该研究成果可应用于各种需要定性分析的领域,例如社会科学、心理学、市场营销等。通过人-LLM协作,研究人员可以更高效地分析大量文本数据,发现隐藏的模式和见解,并在此基础上发展新的理论。该方法还可以用于辅助决策制定,例如在产品设计、政策制定等方面。

📄 摘要(原文)

Qualitative coding is a demanding yet crucial research method in the field of Human-Computer Interaction (HCI). While recent studies have shown the capability of large language models (LLMs) to perform qualitative coding within theoretical frameworks, their potential for collaborative human-LLM discovery and generation of new insights beyond initial theory remains underexplored. To bridge this gap, we proposed CHALET, a novel approach that harnesses the power of human-LLM partnership to advance theory-driven qualitative analysis by facilitating iterative coding, disagreement analysis, and conceptualization of qualitative data. We demonstrated CHALET's utility by applying it to the qualitative analysis of conversations related to mental-illness stigma, using the attribution model as the theoretical framework. Results highlighted the unique contribution of human-LLM collaboration in uncovering latent themes of stigma across the cognitive, emotional, and behavioral dimensions. We discuss the methodological implications of the human-LLM collaborative approach to theory-based qualitative analysis for the HCI community and beyond.