Can large language models understand uncommon meanings of common words?

作者: Jinyang Wu, Feihu Che, Xinxin Zheng, Shuai Zhang, Ruihan Jin, Shuai Nie, Pengpeng Shao, Jianhua Tao

分类: cs.CL, cs.AI

发布日期: 2024-05-09

💡 一句话要点

构建LeSC数据集,揭示大语言模型在理解常见词语非常见含义方面的不足

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 语义理解 词汇语义 数据集构建 自然语言处理

📋 核心要点

- 现有大语言模型在表面层面的自然语言理解表现出色,但缺乏对细粒度语义理解能力的深入评估。

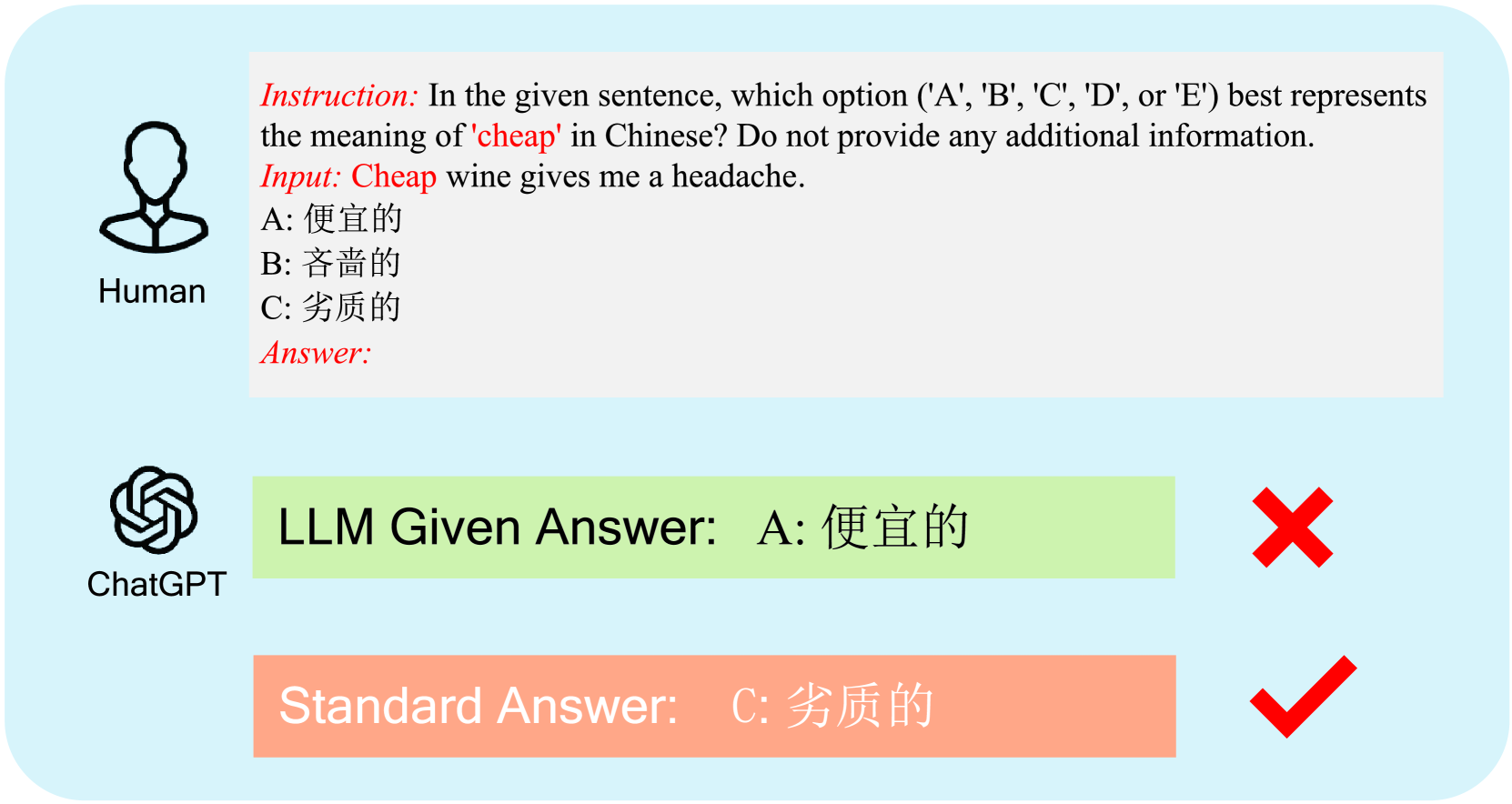

- 论文构建了词汇语义理解(LeSC)数据集,用于评估模型理解常见词语非常见含义的能力。

- 实验结果表明,即使是GPT-4等先进模型,在LeSC数据集上的表现也远低于人类水平,表明模型在该方面存在不足。

📝 摘要(中文)

大型语言模型(LLMs),如ChatGPT,在各种自然语言理解(NLU)任务中展现了显著的进步,包括智能对话和自主代理。然而,由于缺乏广泛认可的测试机制,LLMs是否真正理解世界仍然不清楚。为了弥补这一差距,本研究深入探讨了LLMs细致的语义理解能力,特别是关于常见词语的非常见含义。该研究基于心理学中人类交流的基本原则,即准确共享对词语语义的理解。具体而言,本文创新性地构建了一个词汇语义理解(LeSC)数据集,并提出了新的评估指标,这是第一个包含细粒度和跨语言维度的基准。通过引入不同规模和架构的开源和闭源模型,大量的实验表明,现有模型在这个基本的词汇意义理解任务中表现不佳。值得注意的是,即使是最先进的LLMs,如GPT-4和GPT-3.5,也分别落后于16岁的人类3.9%和22.3%。此外,还引入了多种先进的提示技术和检索增强生成来缓解这个问题,但仍然存在局限性。这项研究强调了上述关键缺陷,旨在激发进一步的研究,并为开发更智能的LLMs提供新的见解。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLMs)在理解常见词汇的非常见含义时表现出的不足。现有方法主要关注表面层面的自然语言理解,忽略了对细粒度语义理解能力的评估,导致无法准确判断LLMs是否真正理解语言的深层含义。这种不足限制了LLMs在需要精确语义理解的任务中的应用,例如法律文本分析、医学诊断等。

核心思路:论文的核心思路是构建一个专门用于评估LLMs理解常见词汇非常见含义能力的数据集,即LeSC(Lexical Semantic Comprehension)数据集。通过设计包含歧义词汇的测试用例,考察LLMs能否根据上下文正确理解词汇的非常见含义。这种方法能够更直接地评估LLMs的语义理解能力,并揭示其在处理复杂语义时的局限性。

技术框架:论文的技术框架主要包括以下几个部分:1) LeSC数据集的构建,包括选择常见词汇、设计歧义语境、进行人工标注等;2) 选取不同规模和架构的LLMs进行实验,包括开源模型和闭源模型;3) 设计评估指标,用于衡量LLMs在LeSC数据集上的表现;4) 尝试使用不同的提示技术和检索增强生成方法来提升LLMs的性能。

关键创新:论文的关键创新在于LeSC数据集的构建和对LLMs在理解常见词汇非常见含义方面的评估。LeSC数据集是第一个专门用于评估LLMs细粒度语义理解能力的基准,它能够更有效地揭示LLMs在处理复杂语义时的局限性。此外,论文还提出了新的评估指标,用于更准确地衡量LLMs在LeSC数据集上的表现。

关键设计:LeSC数据集的关键设计包括:1) 词汇选择:选择在日常生活中常见的词汇,但这些词汇具有多种含义;2) 语境设计:为每个词汇设计多个语境,其中一些语境使用词汇的常见含义,另一些语境使用词汇的非常见含义;3) 人工标注:由人工标注人员判断在每个语境中词汇的正确含义;4) 评估指标:采用准确率、召回率等指标来衡量LLMs的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的大语言模型在LeSC数据集上的表现普遍不佳,即使是GPT-4和GPT-3.5等最先进的模型,也分别落后于16岁的人类3.9%和22.3%。这表明,现有模型在理解常见词汇非常见含义方面仍然存在显著的不足。此外,论文还尝试了多种提示技术和检索增强生成方法,但这些方法在提升模型性能方面的效果有限。

🎯 应用场景

该研究成果可应用于提升大语言模型在需要精确语义理解的场景中的表现,例如法律文本分析、医学诊断、金融风险评估等。通过提高模型对词汇细微差别的理解能力,可以减少误判和错误决策,提高相关应用的可靠性和准确性。此外,该研究也为未来开发更智能、更符合人类认知的大语言模型提供了新的方向。

📄 摘要(原文)

Large language models (LLMs) like ChatGPT have shown significant advancements across diverse natural language understanding (NLU) tasks, including intelligent dialogue and autonomous agents. Yet, lacking widely acknowledged testing mechanisms, answering `whether LLMs are stochastic parrots or genuinely comprehend the world' remains unclear, fostering numerous studies and sparking heated debates. Prevailing research mainly focuses on surface-level NLU, neglecting fine-grained explorations. However, such explorations are crucial for understanding their unique comprehension mechanisms, aligning with human cognition, and finally enhancing LLMs' general NLU capacities. To address this gap, our study delves into LLMs' nuanced semantic comprehension capabilities, particularly regarding common words with uncommon meanings. The idea stems from foundational principles of human communication within psychology, which underscore accurate shared understandings of word semantics. Specifically, this paper presents the innovative construction of a Lexical Semantic Comprehension (LeSC) dataset with novel evaluation metrics, the first benchmark encompassing both fine-grained and cross-lingual dimensions. Introducing models of both open-source and closed-source, varied scales and architectures, our extensive empirical experiments demonstrate the inferior performance of existing models in this basic lexical-meaning understanding task. Notably, even the state-of-the-art LLMs GPT-4 and GPT-3.5 lag behind 16-year-old humans by 3.9% and 22.3%, respectively. Additionally, multiple advanced prompting techniques and retrieval-augmented generation are also introduced to help alleviate this trouble, yet limitations persist. By highlighting the above critical shortcomings, this research motivates further investigation and offers novel insights for developing more intelligent LLMs.