The Effect of Model Size on LLM Post-hoc Explainability via LIME

作者: Henning Heyen, Amy Widdicombe, Noah Y. Siegel, Maria Perez-Ortiz, Philip Treleaven

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-05-08

备注: Published at ICLR 2024 Workshop on Secure and Trustworthy Large Language Models

💡 一句话要点

研究表明增大LLM模型尺寸不一定提升LIME事后解释的合理性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 可解释性 LIME 事后解释 模型尺寸

📋 核心要点

- 大型语言模型性能提升依赖于模型尺寸的增大,但其可解释性受到的影响尚不明确。

- 该研究使用LIME方法解释不同尺寸DeBERTaV3模型在NLI和ZSC任务上的决策过程。

- 实验发现,模型尺寸增大并未提升LIME解释的合理性,暗示解释与模型内部机制的脱节。

📝 摘要(中文)

大型语言模型(LLMs)正变得越来越大,以提高性能。然而,人们对这种趋势如何影响可解释性知之甚少。本研究探讨了LIME对四种不同尺寸的DeBERTaV3模型在自然语言推理(NLI)和零样本分类(ZSC)任务上的解释。我们基于解释对模型内部决策过程的忠实度和它们的合理性(即它们与人类解释的一致性)来评估这些解释。关键发现是,尽管模型性能有所提高,但模型尺寸的增加与合理性并不相关,这表明随着模型尺寸的增加,LIME解释与模型内部过程之间存在不一致。我们的结果进一步表明了NLI上下文中忠实度指标的局限性。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLMs)尺寸增大对其事后可解释性的影响。现有方法,特别是基于LIME的解释方法,在大型模型上的表现和可靠性尚不清楚。现有研究缺乏对模型尺寸与解释质量之间关系的系统性分析,这使得我们难以信任大型语言模型的决策过程。

核心思路:论文的核心思路是通过比较不同尺寸的LLM在相同任务上的LIME解释,来评估模型尺寸对解释质量的影响。通过考察解释的忠实度和合理性,可以判断LIME解释是否能够准确反映模型的内部决策过程,以及这些解释是否与人类的直觉相符。如果模型尺寸增大导致解释质量下降,则表明LIME方法可能不适用于解释非常大的模型。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择DeBERTaV3模型作为研究对象,并选取四种不同尺寸的模型;2) 在自然语言推理(NLI)和零样本分类(ZSC)任务上评估这些模型;3) 使用LIME方法为每个模型的预测生成解释;4) 通过忠实度指标和人工评估来衡量解释的质量,包括解释对模型决策过程的忠实程度以及与人类解释的合理性;5) 分析模型尺寸与解释质量之间的关系。

关键创新:该研究的关键创新在于它系统地研究了模型尺寸对LLM事后可解释性的影响。以往的研究主要关注如何提高解释方法的性能,而忽略了模型尺寸可能带来的影响。该研究表明,简单地增大模型尺寸可能并不能提高解释的质量,甚至可能导致解释与模型内部过程的脱节。这一发现对于理解和改进大型语言模型的可解释性具有重要意义。

关键设计:在实验设计方面,论文选择了DeBERTaV3模型,因为它是一种常用的、性能良好的LLM。论文使用了四种不同尺寸的DeBERTaV3模型,以便观察模型尺寸对解释质量的影响。在评估解释质量方面,论文使用了忠实度指标和人工评估。忠实度指标衡量解释对模型决策过程的忠实程度,而人工评估则衡量解释与人类解释的合理性。通过结合这两种评估方法,可以更全面地了解解释的质量。

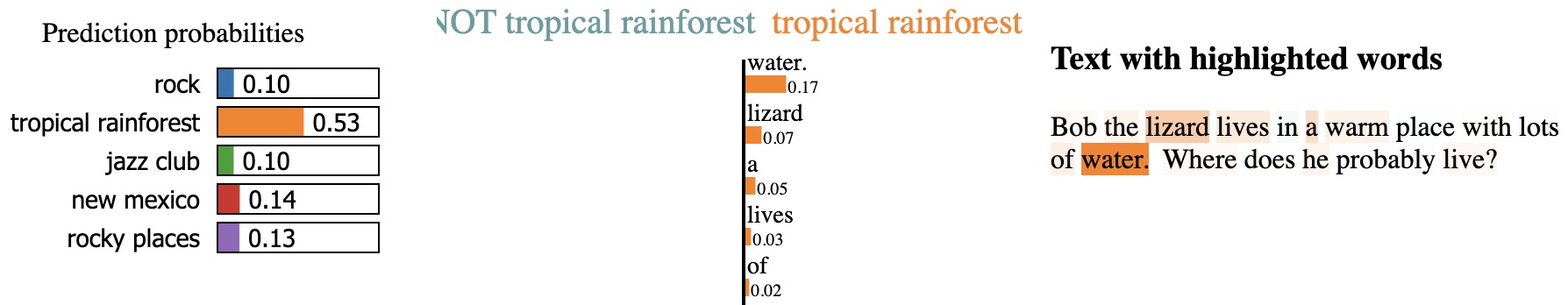

🖼️ 关键图片

📊 实验亮点

实验结果表明,尽管DeBERTaV3模型性能随尺寸增大而提升,但LIME解释的合理性并未相应提高,甚至出现下降趋势。这暗示LIME方法在解释超大模型时可能存在局限性。此外,研究还发现NLI任务中常用的忠实度指标可能存在偏差。

🎯 应用场景

该研究成果可应用于对大型语言模型的可信度评估,尤其是在金融、医疗等高风险领域。通过理解模型尺寸对可解释性的影响,可以帮助开发者选择合适的模型尺寸,并改进解释方法,从而提高人们对AI决策的信任度,促进AI技术的负责任应用。

📄 摘要(原文)

Large language models (LLMs) are becoming bigger to boost performance. However, little is known about how explainability is affected by this trend. This work explores LIME explanations for DeBERTaV3 models of four different sizes on natural language inference (NLI) and zero-shot classification (ZSC) tasks. We evaluate the explanations based on their faithfulness to the models' internal decision processes and their plausibility, i.e. their agreement with human explanations. The key finding is that increased model size does not correlate with plausibility despite improved model performance, suggesting a misalignment between the LIME explanations and the models' internal processes as model size increases. Our results further suggest limitations regarding faithfulness metrics in NLI contexts.