Conversational Topic Recommendation in Counseling and Psychotherapy with Decision Transformer and Large Language Models

作者: Aylin Gunal, Baihan Lin, Djallel Bouneffouf

分类: cs.CL

发布日期: 2024-05-08

备注: 5 pages excluding references, 3 figures; accepted at Clinical NLP Workshop @ NAACL 2024

💡 一句话要点

利用决策Transformer和LLM,为心理咨询对话提供话题推荐

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理咨询 话题推荐 决策Transformer 强化学习 大型语言模型 离线学习 LLaMA-2

📋 核心要点

- 心理健康需求激增,现有自动化临床支持系统整合AI能力不足,尤其缺乏有效的话题推荐机制。

- 提出基于决策Transformer的离线强化学习方法,从历史对话数据中学习话题推荐策略,并用其结果微调LLM。

- 实验表明,该方法优于基线强化学习方法,但基于LLaMA-2 7B的实现效果混合,未来有提升空间。

📝 摘要(中文)

鉴于对心理健康援助的需求日益增长,人工智能(AI),特别是大型语言模型(LLM),可能对集成到自动化临床支持系统中具有重要价值。本文利用决策Transformer架构,为患者和心理健康专业人员之间的咨询对话提供话题推荐。该架构用于离线强化学习,我们从对话中提取状态(对话轮次嵌入)、动作(对话主题)和奖励(衡量患者和治疗师之间一致性的分数),以训练决策Transformer模型。我们展示了相对于基线强化学习方法的改进,并提出了一种新颖的系统,利用我们模型的输出作为合成标签,用于微调大型语言模型以执行相同的任务。虽然我们基于LLaMA-2 7B的实现结果好坏参半,但未来的工作无疑可以基于该设计。

🔬 方法详解

问题定义:论文旨在解决心理咨询对话中,如何自动推荐合适话题的问题。现有方法要么依赖人工标注,成本高昂;要么使用简单的规则或统计方法,效果不佳,无法捕捉对话的动态性和患者的真实需求。

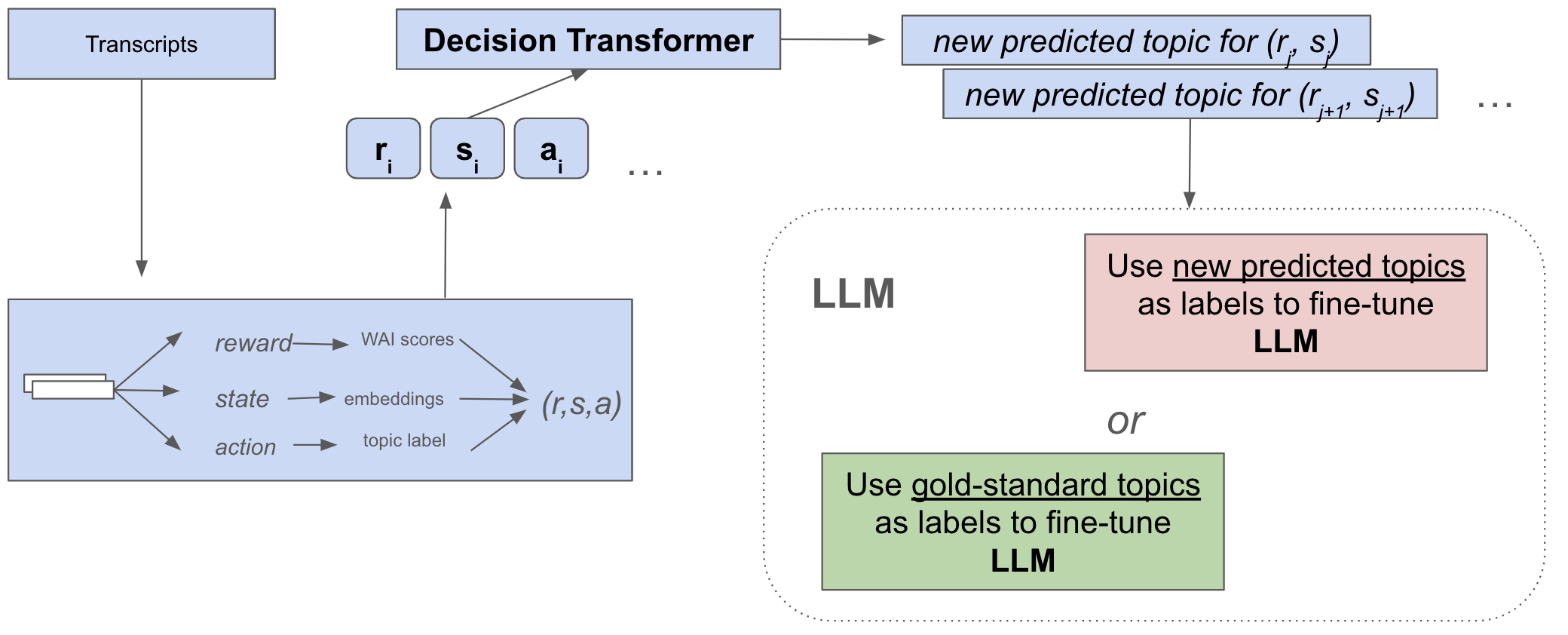

核心思路:论文的核心思路是将话题推荐问题建模成一个序列决策问题,利用强化学习从历史对话数据中学习最优策略。具体而言,使用决策Transformer,这是一种能够处理序列决策问题的Transformer变体,可以学习在给定对话状态下选择哪个话题能够最大化长期奖励。同时,利用决策Transformer的输出来生成合成标签,用于微调大型语言模型,从而提升LLM在话题推荐任务上的性能。

技术框架:整体框架包含两个主要阶段:1) 使用决策Transformer进行离线强化学习。从历史对话数据中提取状态(对话轮次嵌入)、动作(对话主题)和奖励(衡量患者和治疗师之间一致性的分数),训练决策Transformer模型。2) 使用决策Transformer的输出作为合成标签,微调大型语言模型。将决策Transformer预测的话题作为LLM的训练目标,从而提升LLM在话题推荐任务上的性能。

关键创新:论文的关键创新在于将决策Transformer应用于心理咨询对话的话题推荐任务,并提出了一种利用决策Transformer的输出作为合成标签来微调大型语言模型的新方法。这种方法结合了强化学习和预训练语言模型的优势,能够更有效地学习话题推荐策略。

关键设计:在决策Transformer的训练中,状态表示为对话轮次的嵌入向量,动作表示为话题的ID,奖励函数衡量患者和治疗师之间的一致性。在LLM的微调中,使用交叉熵损失函数,将决策Transformer预测的话题作为LLM的训练目标。论文使用LLaMA-2 7B作为LLM的backbone。

🖼️ 关键图片

📊 实验亮点

论文实验结果表明,基于决策Transformer的强化学习方法优于基线强化学习方法,证明了该方法的有效性。虽然基于LLaMA-2 7B的微调结果混合,但为后续研究提供了宝贵的经验和方向。该研究探索了将强化学习和大型语言模型结合应用于心理咨询领域的可能性。

🎯 应用场景

该研究成果可应用于自动化心理咨询系统,辅助心理咨询师进行话题选择,提高咨询效率和质量。此外,该方法也可推广到其他对话场景,如客服对话、教育辅导等,具有广泛的应用前景。未来,结合患者的情绪状态和个性化信息,可以进一步提升话题推荐的准确性和个性化程度。

📄 摘要(原文)

Given the increasing demand for mental health assistance, artificial intelligence (AI), particularly large language models (LLMs), may be valuable for integration into automated clinical support systems. In this work, we leverage a decision transformer architecture for topic recommendation in counseling conversations between patients and mental health professionals. The architecture is utilized for offline reinforcement learning, and we extract states (dialogue turn embeddings), actions (conversation topics), and rewards (scores measuring the alignment between patient and therapist) from previous turns within a conversation to train a decision transformer model. We demonstrate an improvement over baseline reinforcement learning methods, and propose a novel system of utilizing our model's output as synthetic labels for fine-tuning a large language model for the same task. Although our implementation based on LLaMA-2 7B has mixed results, future work can undoubtedly build on the design.