Long Context Alignment with Short Instructions and Synthesized Positions

作者: Wenhao Wu, Yizhong Wang, Yao Fu, Xiang Yue, Dawei Zhu, Sujian Li

分类: cs.CL

发布日期: 2024-05-07

备注: preview

💡 一句话要点

提出SkipAlign,通过合成位置索引增强LLM长文本处理能力,无需额外数据。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本处理 指令微调 位置编码 长程依赖 大型语言模型

📋 核心要点

- 现有LLM处理长文本指令面临挑战,需要大量高质量数据和计算资源。

- SkipAlign通过在训练样本中插入跳跃的位置索引,合成长程依赖,提升长文本处理能力。

- 实验表明,SkipAlign在多种长文本任务中有效,6B参数模型性能可与GPT-3.5-Turbo-16K媲美。

📝 摘要(中文)

大型语言模型(LLMs)有效处理超长上下文指令仍然面临挑战,通常需要高质量的长数据和大量的计算资源。本文提出了一种新的技术——Step-Skipping Alignment (SkipAlign),旨在提升LLMs在对齐阶段的长文本处理能力,而无需在原始数据长度之外进行额外投入。SkipAlign基于长程依赖关系对于增强LLM的长文本能力至关重要的前提而开发。SkipAlign并非简单地扩展输入样本的长度,而是从位置索引的角度合成长程依赖关系。这是通过在指令跟随样本中策略性地插入跳过的位置来实现的,它利用数据的语义结构来有效地扩展上下文。通过对具有各种上下文窗口大小的基础模型进行的大量实验,SkipAlign证明了其在各种长文本任务中的有效性。特别值得注意的是,通过仔细选择基础模型和对齐数据集,仅使用6B参数的SkipAlign就能实现最佳性能,并且在LongBench上与GPT-3.5-Turbo-16K等强大的基线模型相媲美。

🔬 方法详解

问题定义:现有大型语言模型在处理长文本上下文时面临挑战,主要痛点在于需要大量高质量的长文本数据进行训练,并且训练过程需要消耗大量的计算资源。仅仅通过增加输入样本的长度来提升模型性能的方式,成本高昂且效果有限。

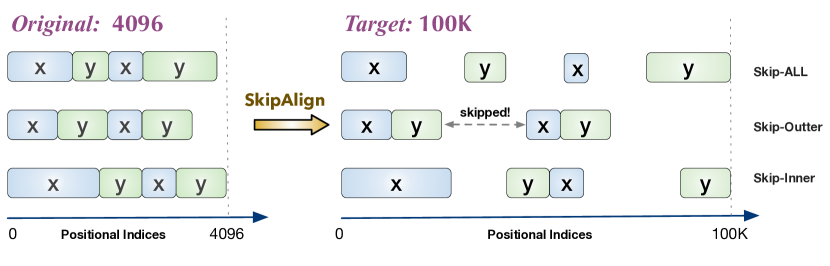

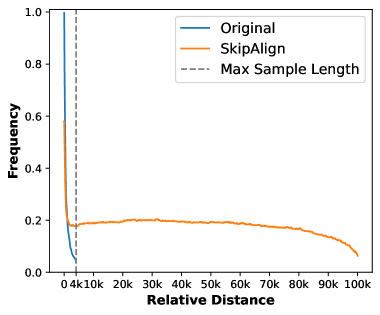

核心思路:SkipAlign的核心思路是通过在训练样本中人为地引入“跳跃”的位置索引,来模拟长程依赖关系。模型在训练过程中,会学习到这些跳跃的位置索引之间的关联,从而提升其处理长文本的能力。这种方法不需要额外增加训练数据的长度,而是通过巧妙地设计位置索引来达到扩展上下文的目的。

技术框架:SkipAlign的整体框架是在指令微调(Instruction Tuning)阶段,对训练数据进行预处理。具体来说,对于每个训练样本,SkipAlign会根据一定的策略,在原始的位置索引序列中插入一些“跳跃”的位置。例如,原始序列为[1, 2, 3, 4, 5],SkipAlign可能会将其修改为[1, 2, 50, 51, 5]。修改后的序列包含了长程依赖的信息,模型在训练过程中会学习到这些依赖关系。完成数据预处理后,就可以使用标准的指令微调流程来训练模型。

关键创新:SkipAlign最重要的创新点在于其合成长程依赖关系的方式。与以往直接增加输入长度的方法不同,SkipAlign通过修改位置索引,使得模型能够在有限的输入长度内学习到更长的依赖关系。这种方法更加高效,并且可以有效地利用现有的训练数据。

关键设计:SkipAlign的关键设计在于如何选择跳跃的位置。论文中提到,需要根据数据的语义结构来选择跳跃的位置,以保证跳跃后的序列仍然具有一定的语义连贯性。具体的跳跃策略可以根据不同的任务和数据集进行调整。此外,SkipAlign还可以与其他长文本处理技术相结合,例如注意力机制的改进等,以进一步提升模型性能。

🖼️ 关键图片

📊 实验亮点

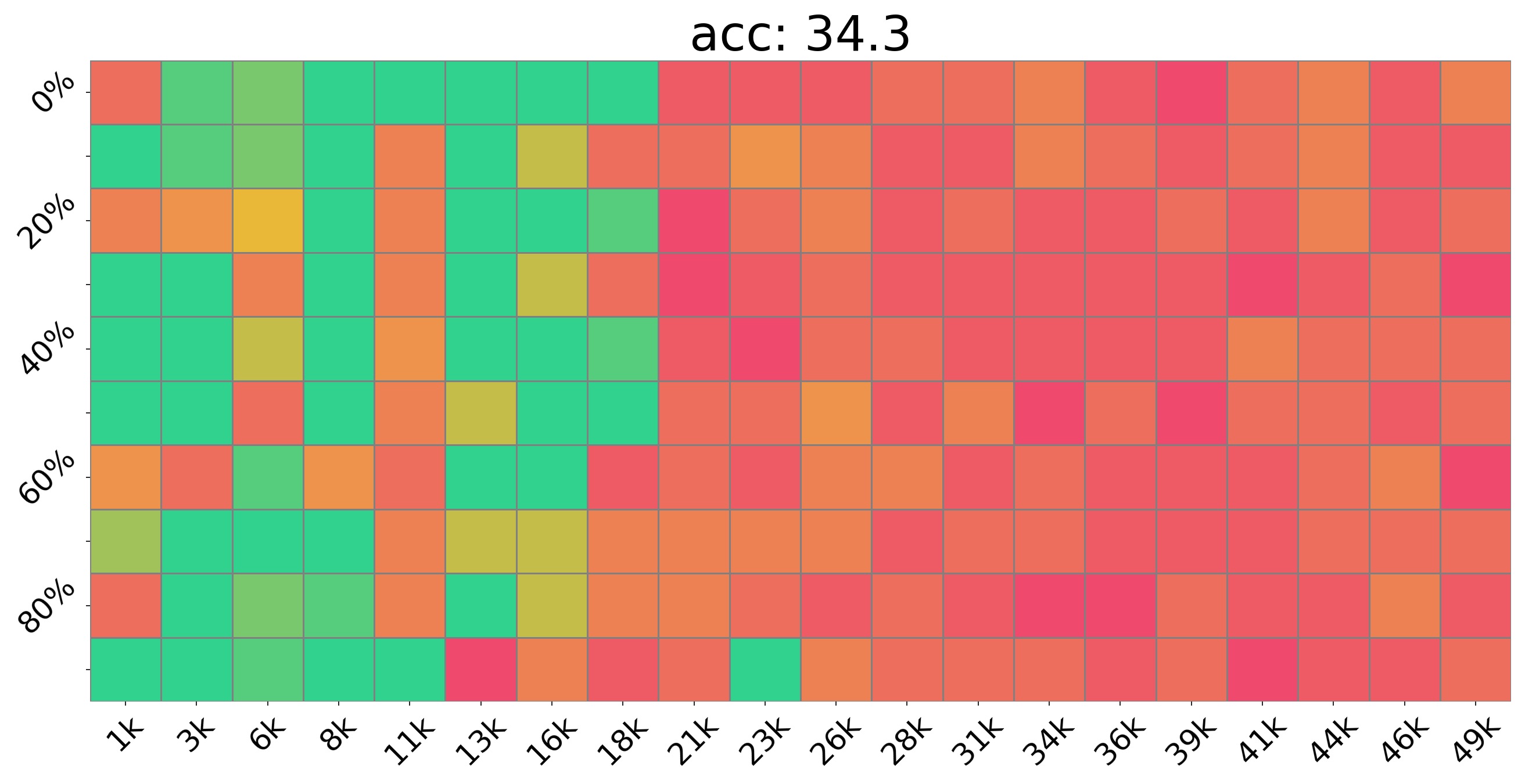

SkipAlign在LongBench等长文本基准测试中表现出色。实验结果表明,使用SkipAlign训练的6B参数模型,其性能可以与GPT-3.5-Turbo-16K等更大型的模型相媲美。这表明SkipAlign能够有效地提升模型的长文本处理能力,并且具有较高的效率。

🎯 应用场景

SkipAlign技术可应用于各种需要处理长文本的场景,例如长篇文档摘要、代码生成、对话系统等。通过提升模型对长文本的理解能力,可以改善用户体验,提高工作效率。该技术还有助于降低训练长文本模型的成本,使得更多研究者和开发者能够参与到长文本处理的研究中来。

📄 摘要(原文)

Effectively handling instructions with extremely long context remains a challenge for Large Language Models (LLMs), typically necessitating high-quality long data and substantial computational resources. This paper introduces Step-Skipping Alignment (SkipAlign), a new technique designed to enhance the long-context capabilities of LLMs in the phase of alignment without the need for additional efforts beyond training with original data length. SkipAlign is developed on the premise that long-range dependencies are fundamental to enhancing an LLM's capacity of long context. Departing from merely expanding the length of input samples, SkipAlign synthesizes long-range dependencies from the aspect of positions indices. This is achieved by the strategic insertion of skipped positions within instruction-following samples, which utilizes the semantic structure of the data to effectively expand the context. Through extensive experiments on base models with a variety of context window sizes, SkipAlign demonstrates its effectiveness across a spectrum of long-context tasks. Particularly noteworthy is that with a careful selection of the base model and alignment datasets, SkipAlign with only 6B parameters achieves it's best performance and comparable with strong baselines like GPT-3.5-Turbo-16K on LongBench.