Self-Improving Customer Review Response Generation Based on LLMs

作者: Guy Azov, Tatiana Pelc, Adi Fledel Alon, Gila Kamhi

分类: cs.CL, cs.AI

发布日期: 2024-05-06

备注: 18 pages, 4 figure, 8 figures in Appendix, accepted to LREC-COLING 2024 workshop

💡 一句话要点

提出SCRABLE,一种基于LLM自优化的用户评论自动回复系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 用户评论回复 大型语言模型 检索增强生成 自优化 自动化

📋 核心要点

- 开发者难以管理海量用户评论,尤其是在流行应用中,亟需自动化解决方案来简化回复流程。

- SCRABLE利用RAG和LLM,通过自优化提示和LLM判断机制,实现客户评论回复的自动化和性能提升。

- 实验表明,SCRABLE在生成高质量回复方面表现出色,相比基线方法,性能提升超过8.5%。

📝 摘要(中文)

本文提出了一种名为SCRABLE的自适应客户评论回复自动化系统,该系统利用检索增强生成(RAG)和先进的大型语言模型(LLM)来生成自动回复。SCRABLE通过自优化提示和基于LLM的判断机制来不断提升自身性能。此外,本文还引入了一种自动评分机制,模拟人工评估员的角色,以评估客户评论领域中生成的回复质量。在真实数据集上进行的大量实验和分析表明,该方法能够有效地生成高质量的回复,与基线相比,性能提升超过8.5%。通过对生成回复的手动检查进一步验证了所提出系统的有效性。

🔬 方法详解

问题定义:论文旨在解决开发者难以高效回复大量用户评论的问题。现有方法在生成高质量、个性化回复方面存在不足,无法有效提升用户满意度和应用评分。

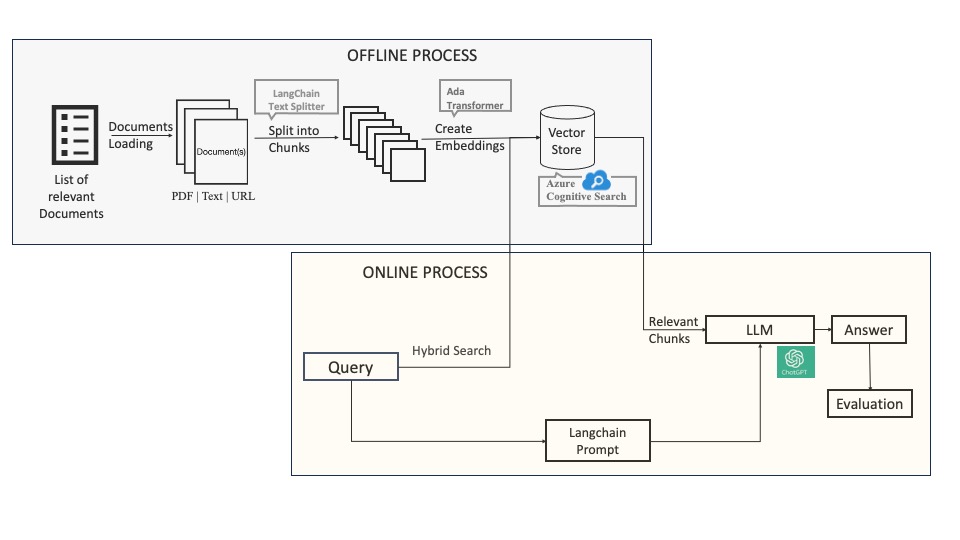

核心思路:论文的核心思路是利用RAG和LLM,结合自优化提示和LLM判断机制,构建一个能够自我提升的客户评论回复系统。通过检索用户贡献的文档,为LLM提供上下文信息,提高回复的准确性和相关性。

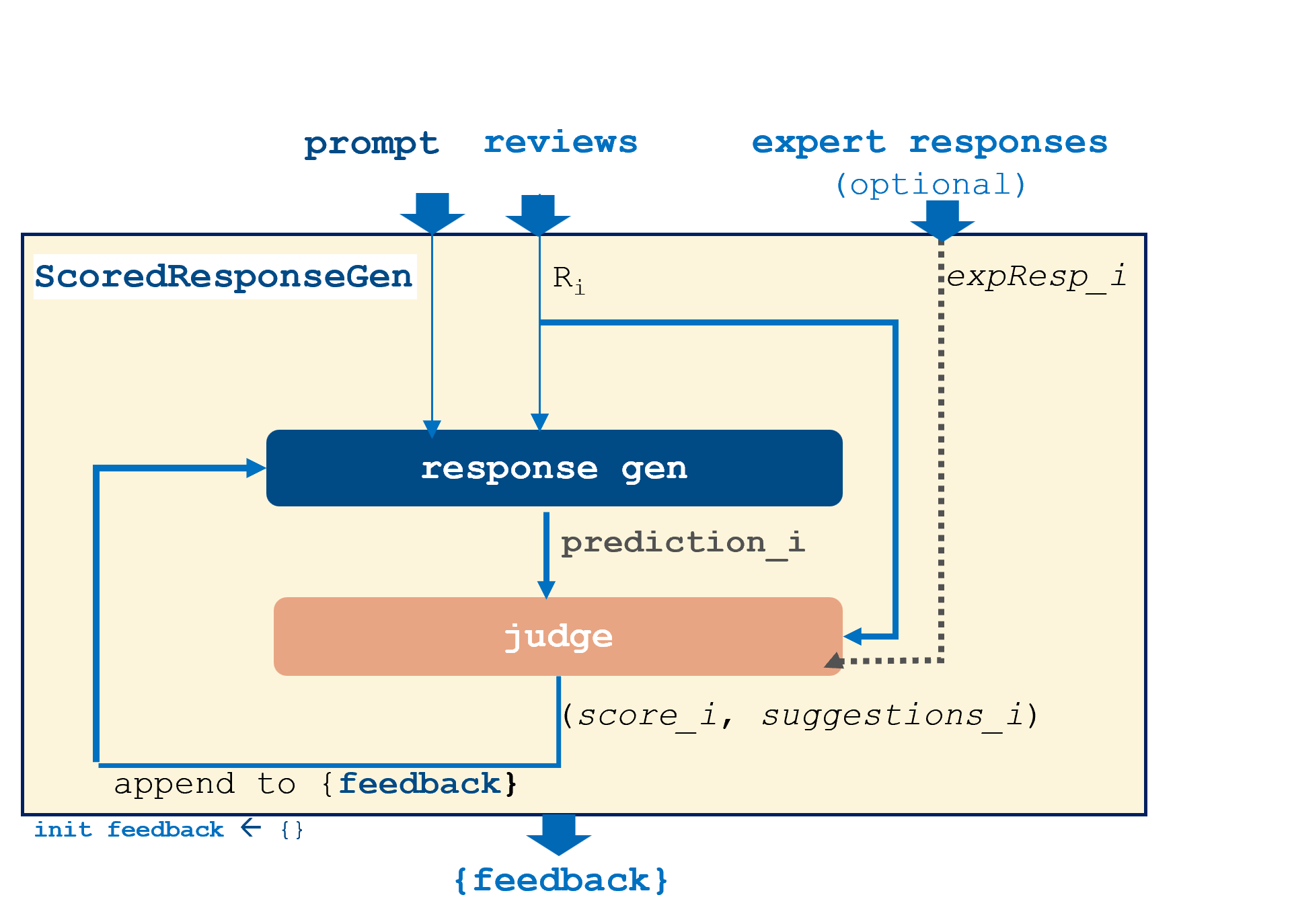

技术框架:SCRABLE系统的整体架构包含以下几个主要模块:1) 用户评论接收模块;2) 文档检索模块(RAG),用于检索与用户评论相关的文档;3) LLM回复生成模块,基于检索到的文档和用户评论生成回复;4) 自优化提示模块,通过LLM判断机制评估回复质量,并优化提示词,提升LLM的生成能力;5) 自动评分模块,模拟人工评估员,对生成的回复进行评分。

关键创新:论文的关键创新在于提出了一个自优化的客户评论回复系统,该系统能够通过LLM判断机制不断提升回复质量。此外,还引入了一种自动评分机制,用于评估回复质量,并指导提示词的优化。

关键设计:论文中,提示词的设计至关重要,需要引导LLM生成高质量、个性化的回复。LLM判断机制的设计也需要仔细考虑,以确保能够准确评估回复质量,并为提示词优化提供有效的反馈。具体的参数设置、损失函数和网络结构等技术细节在论文中可能没有详细描述,需要进一步查阅论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SCRABLE系统在生成高质量回复方面表现出色,与基线方法相比,性能提升超过8.5%。通过人工评估,进一步验证了SCRABLE系统生成的回复具有更高的质量和相关性,能够有效提升用户满意度。

🎯 应用场景

该研究成果可应用于各类应用商店、电商平台等,帮助开发者或商家自动回复用户评论,提升用户满意度,维护品牌形象。未来,该技术可进一步扩展到其他客户服务领域,例如智能客服、在线咨询等,实现更高效、个性化的客户互动。

📄 摘要(原文)

Previous studies have demonstrated that proactive interaction with user reviews has a positive impact on the perception of app users and encourages them to submit revised ratings. Nevertheless, developers encounter challenges in managing a high volume of reviews, particularly in the case of popular apps with a substantial influx of daily reviews. Consequently, there is a demand for automated solutions aimed at streamlining the process of responding to user reviews. To address this, we have developed a new system for generating automatic responses by leveraging user-contributed documents with the help of retrieval-augmented generation (RAG) and advanced Large Language Models (LLMs). Our solution, named SCRABLE, represents an adaptive customer review response automation that enhances itself with self-optimizing prompts and a judging mechanism based on LLMs. Additionally, we introduce an automatic scoring mechanism that mimics the role of a human evaluator to assess the quality of responses generated in customer review domains. Extensive experiments and analyses conducted on real-world datasets reveal that our method is effective in producing high-quality responses, yielding improvement of more than 8.5% compared to the baseline. Further validation through manual examination of the generated responses underscores the efficacy our proposed system.