Lifelong Knowledge Editing for LLMs with Retrieval-Augmented Continuous Prompt Learning

作者: Qizhou Chen, Taolin Zhang, Xiaofeng He, Dongyang Li, Chengyu Wang, Longtao Huang, Hui Xue

分类: cs.CL

发布日期: 2024-05-06 (更新: 2025-03-14)

备注: EMNLP 2024 main

💡 一句话要点

提出RECIPE,一种检索增强的持续提示学习方法,用于LLM的终身知识编辑。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 终身学习 知识编辑 大型语言模型 检索增强 持续提示学习

📋 核心要点

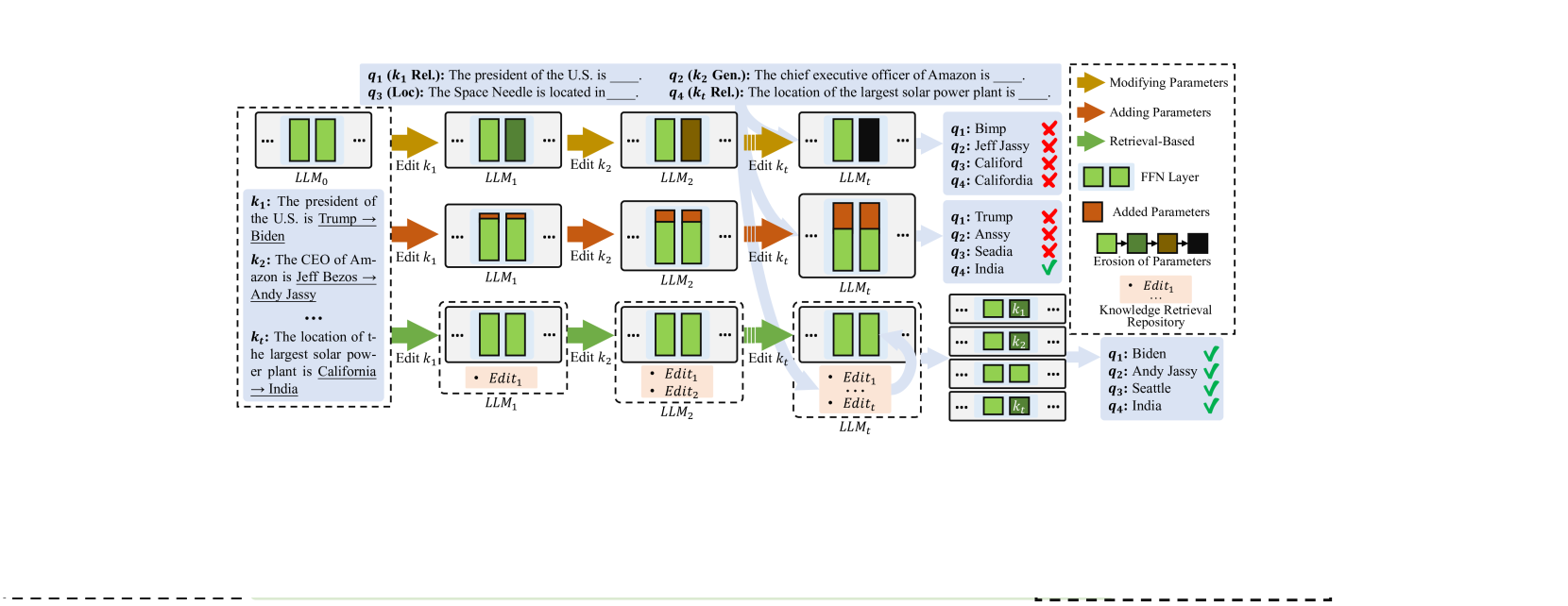

- 现有LLM知识编辑方法在终身学习场景中面临灾难性遗忘和性能下降的挑战。

- RECIPE通过检索增强的持续提示学习,将知识转化为连续提示并动态判断检索知识的相关性。

- 实验表明,RECIPE在多个LLM和数据集上实现了优异的编辑性能,并保持了整体性能。

📝 摘要(中文)

模型编辑旨在修正大型语言模型(LLM)中过时或错误的知识,而无需耗费大量资源进行重新训练。终身模型编辑是最具挑战性的任务,它满足了LLM的持续编辑需求。先前的工作主要集中在单次或批量编辑上;然而,由于灾难性的知识遗忘和模型性能的下降,这些方法在终身编辑场景中表现不佳。虽然基于检索的方法缓解了这些问题,但它们受到将检索到的知识集成到模型中的缓慢而繁琐的过程的阻碍。在这项工作中,我们介绍了一种检索增强的持续提示学习方法RECIPE,以提高终身学习中的编辑效率和推理效率。RECIPE首先将知识语句转换为简短而信息丰富的连续提示,并将其作为前缀添加到LLM的输入查询嵌入中,以有效地根据知识优化响应。它进一步集成了知识哨兵(KS),作为一个中间媒介来计算动态阈值,确定检索存储库是否包含相关知识。我们的检索器和提示编码器经过联合训练,以实现编辑属性,即可靠性、通用性和局部性。在我们的实验中,RECIPE在多个LLM和编辑数据集上进行了广泛的评估,并取得了优异的编辑性能。RECIPE还展示了其在保持LLM整体性能的同时,快速编辑和推理的能力。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在终身学习场景下的知识编辑问题。现有的模型编辑方法,如单次或批量编辑,在持续学习过程中容易出现灾难性遗忘,导致模型性能下降。基于检索的方法虽然可以缓解遗忘问题,但检索过程耗时,且难以有效集成检索到的知识。

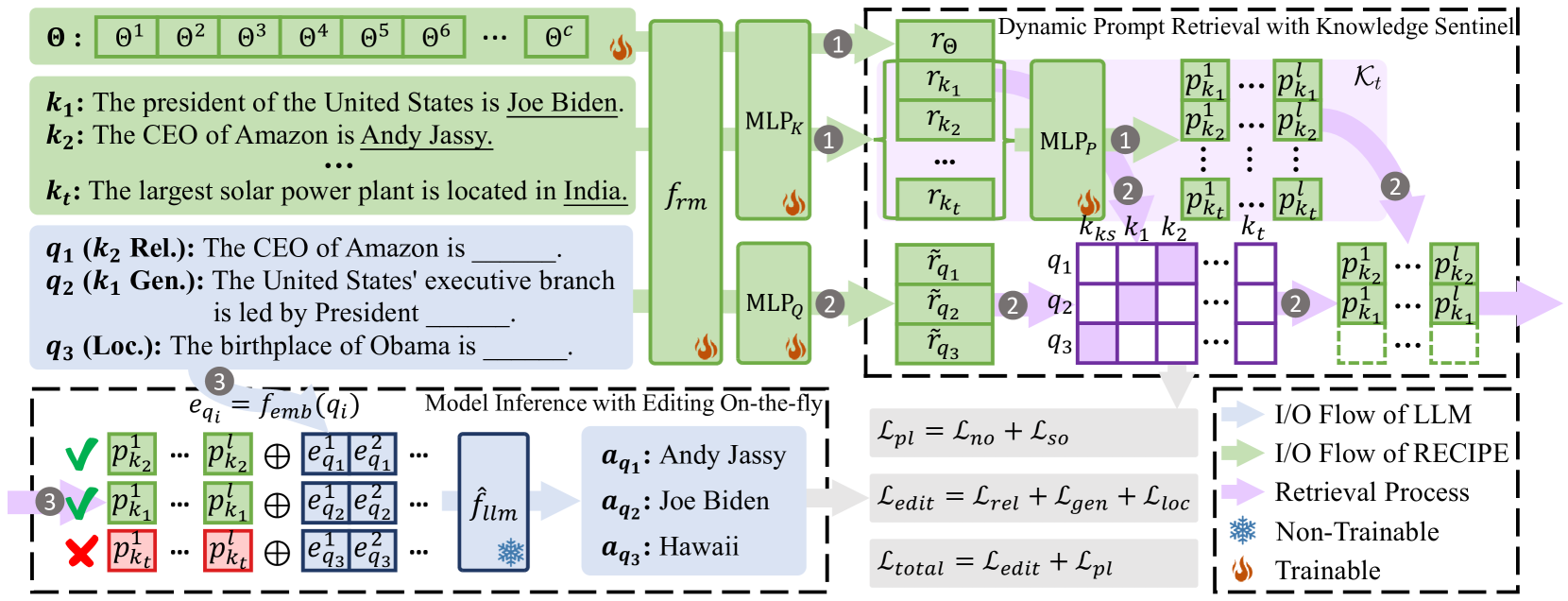

核心思路:论文的核心思路是利用检索增强的持续提示学习,将知识转化为可学习的连续提示,并将其注入到LLM的输入中。通过检索相关知识,并利用知识哨兵(Knowledge Sentinel)动态判断检索知识的相关性,从而提高编辑的效率和准确性。这种方法旨在避免重新训练整个模型,同时保持模型的整体性能。

技术框架:RECIPE框架主要包含以下几个模块:1) 知识检索器:用于从知识库中检索与输入查询相关的知识。2) 提示编码器:将检索到的知识编码为连续提示。3) 知识哨兵(KS):用于判断检索到的知识是否与输入查询相关,并动态调整阈值。4) LLM:接收带有提示的输入查询,并生成相应的响应。整个流程是,给定一个输入查询,首先通过知识检索器检索相关知识,然后通过提示编码器将知识编码为连续提示,知识哨兵判断相关性,最后将提示添加到输入查询中,输入到LLM中生成响应。

关键创新:RECIPE的关键创新在于:1) 提出了检索增强的持续提示学习方法,将知识编辑问题转化为提示学习问题,避免了重新训练整个模型。2) 引入了知识哨兵(KS),用于动态判断检索知识的相关性,提高了编辑的准确性。3) 联合训练检索器和提示编码器,以实现编辑的可靠性、通用性和局部性。

关键设计:RECIPE的关键设计包括:1) 使用连续提示来表示知识,这些提示是可学习的,可以根据不同的输入查询进行调整。2) 知识哨兵(KS)通过计算输入查询和检索到的知识之间的相似度来判断相关性,并使用动态阈值来调整判断标准。3) 检索器和提示编码器通过联合训练,使用三元组损失函数来优化,以提高检索和编码的效率和准确性。具体来说,三元组损失函数鼓励相关知识的提示与输入查询更接近,而不相关知识的提示与输入查询更远。

🖼️ 关键图片

📊 实验亮点

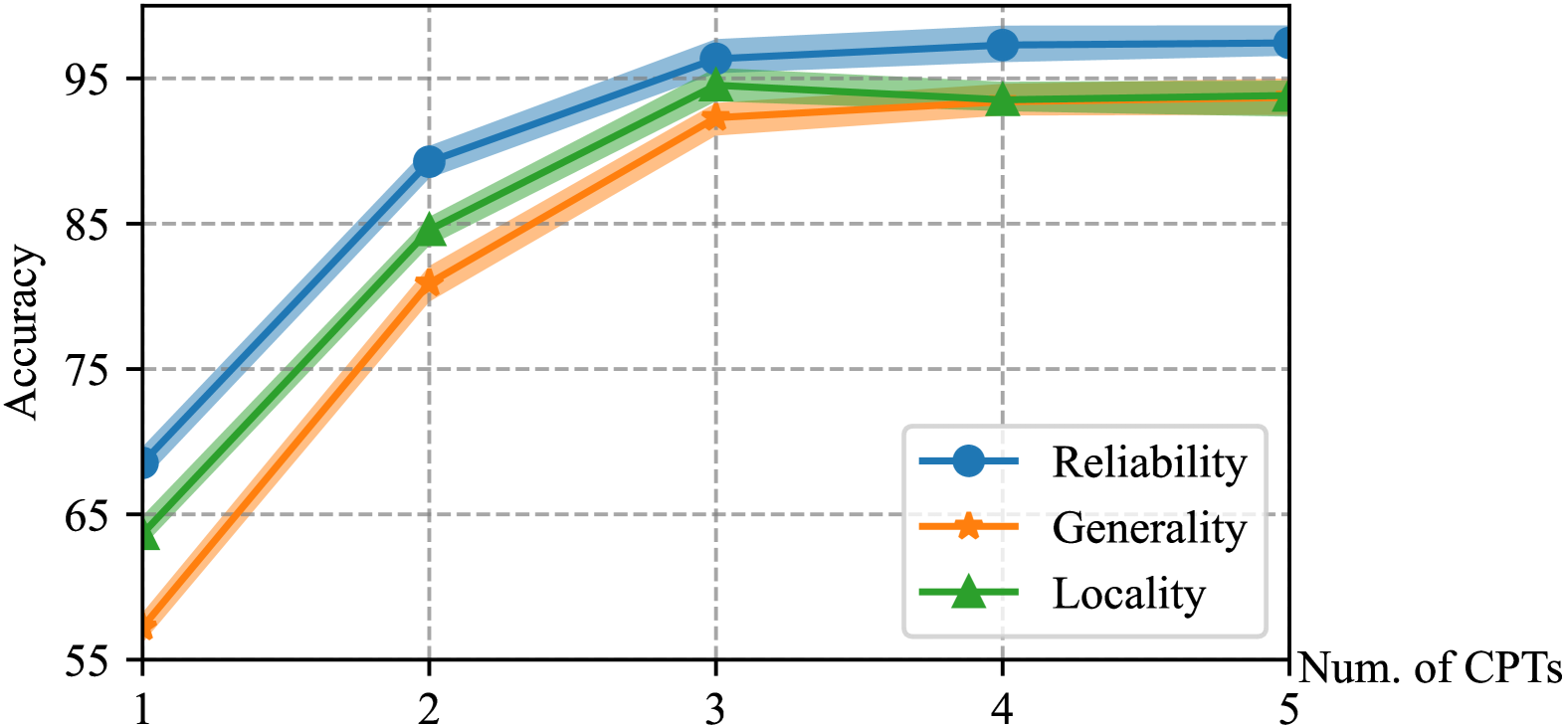

实验结果表明,RECIPE在多个LLM和编辑数据集上取得了优异的编辑性能,显著优于现有的模型编辑方法。具体来说,RECIPE在编辑的可靠性、通用性和局部性方面均取得了显著提升。同时,RECIPE还展示了其在保持LLM整体性能的同时,快速编辑和推理的能力。例如,在某些数据集上,RECIPE的编辑成功率比基线方法提高了10%以上。

🎯 应用场景

该研究成果可应用于各种需要持续知识更新的LLM应用场景,例如智能客服、知识问答、内容生成等。通过RECIPE,LLM可以快速适应新的知识,修正错误信息,提高回答的准确性和可靠性,从而提升用户体验和应用价值。未来,该方法可以进一步扩展到多模态知识编辑,以及更复杂的知识推理场景。

📄 摘要(原文)

Model editing aims to correct outdated or erroneous knowledge in large language models (LLMs) without the need for costly retraining. Lifelong model editing is the most challenging task that caters to the continuous editing requirements of LLMs. Prior works primarily focus on single or batch editing; nevertheless, these methods fall short in lifelong editing scenarios due to catastrophic knowledge forgetting and the degradation of model performance. Although retrieval-based methods alleviate these issues, they are impeded by slow and cumbersome processes of integrating the retrieved knowledge into the model. In this work, we introduce RECIPE, a RetriEval-augmented ContInuous Prompt lEarning method, to boost editing efficacy and inference efficiency in lifelong learning. RECIPE first converts knowledge statements into short and informative continuous prompts, prefixed to the LLM's input query embedding, to efficiently refine the response grounded on the knowledge. It further integrates the Knowledge Sentinel (KS) that acts as an intermediary to calculate a dynamic threshold, determining whether the retrieval repository contains relevant knowledge. Our retriever and prompt encoder are jointly trained to achieve editing properties, i.e., reliability, generality, and locality. In our experiments, RECIPE is assessed extensively across multiple LLMs and editing datasets, where it achieves superior editing performance. RECIPE also demonstrates its capability to maintain the overall performance of LLMs alongside showcasing fast editing and inference speed.