A Two-Stage Prediction-Aware Contrastive Learning Framework for Multi-Intent NLU

作者: Guanhua Chen, Yutong Yao, Derek F. Wong, Lidia S. Chao

分类: cs.CL

发布日期: 2024-05-05

备注: LREC-COLING 2024

💡 一句话要点

提出预测感知对比学习框架PACL,解决多意图NLU中模型混淆问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多意图NLU 对比学习 预测感知 自然语言理解 低资源学习

📋 核心要点

- 多意图NLU面临模型混淆问题,现有对比学习方法忽略了共享意图的丰富信息。

- 提出PACL框架,通过词级预训练和预测感知对比微调,利用共享意图信息。

- 实验结果表明,PACL在低数据和全数据场景下均优于现有基线方法。

📝 摘要(中文)

多意图自然语言理解(NLU)由于单个语句中存在多个意图,导致模型混淆,面临着严峻的挑战。以往的研究主要通过对比学习来增大不同多意图标签之间的间隔,但它们不太适合多意图NLU的细微差别,忽略了共享意图之间的丰富信息,而这些信息有利于构建更好的嵌入空间,尤其是在低数据场景下。本文提出了一种用于多意图NLU的两阶段预测感知对比学习(PACL)框架,以利用这些有价值的知识。我们的方法通过整合词级预训练和预测感知对比微调来利用共享意图信息。我们使用词级数据增强策略构建预训练数据集。随后,我们的框架在对比微调期间动态地为实例分配角色,同时引入预测感知对比损失,以最大化对比学习的影响。我们在三个广泛使用的数据集上进行了实验和实证分析,结果表明我们的方法在低数据和全数据场景下都优于三个突出的基线。

🔬 方法详解

问题定义:多意图NLU任务旨在理解包含多个意图的语句。现有方法,特别是基于对比学习的方法,主要关注区分不同的多意图标签,但忽略了不同意图之间的关联性,尤其是在数据量较少的情况下,这种关联性对于学习更好的语义表示至关重要。模型容易混淆相似意图,导致性能下降。

核心思路:论文的核心思路是利用语句中共享意图的信息来提升模型对多意图的理解能力。通过预训练阶段学习词级别的语义信息,并在微调阶段动态调整对比学习的策略,使得模型能够更好地捕捉意图之间的关系,从而提升整体的NLU性能。

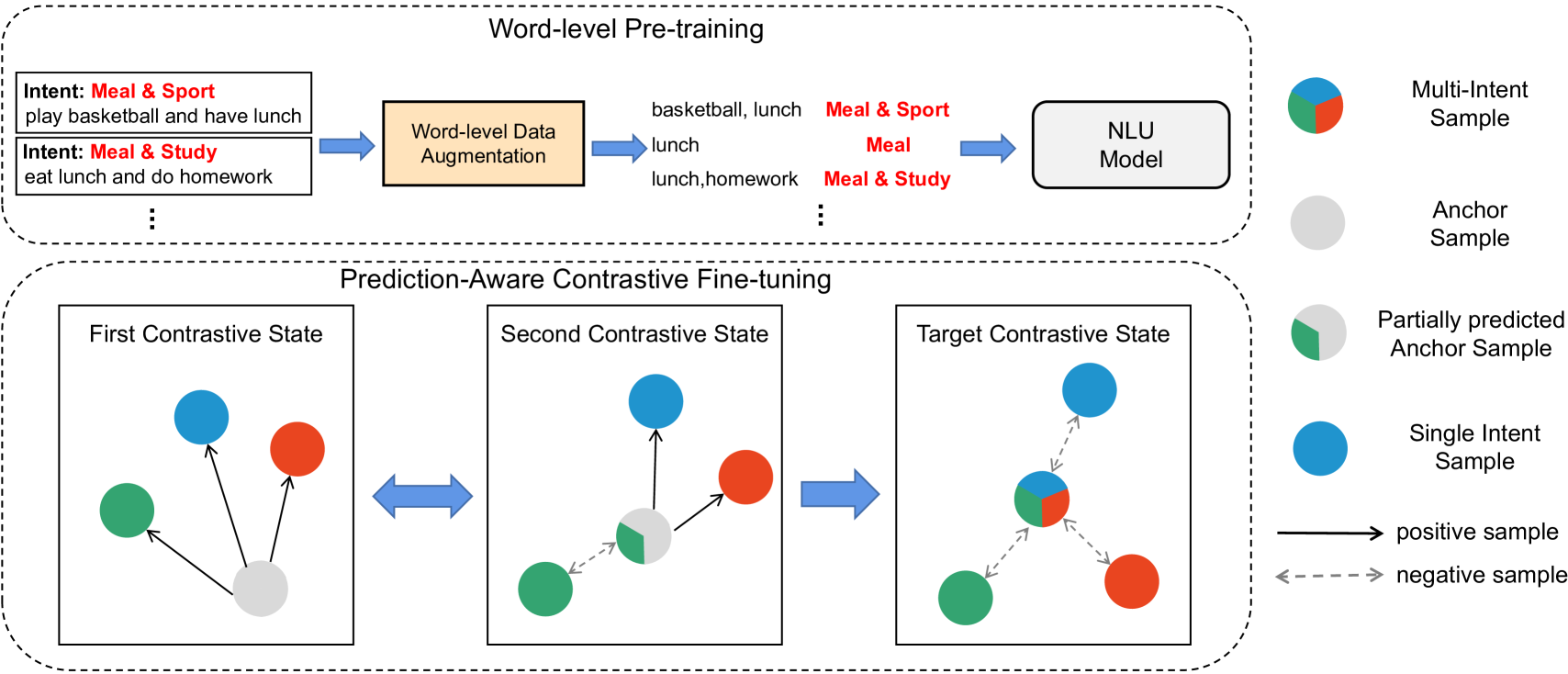

技术框架:PACL框架包含两个主要阶段:预训练阶段和对比微调阶段。在预训练阶段,使用词级别的数据增强策略构建预训练数据集,并训练模型学习词级别的语义表示。在对比微调阶段,框架动态地为实例分配角色,并引入预测感知对比损失,以最大化对比学习的效果。整体流程是先通过预训练获得较好的词嵌入,再通过对比学习微调,使得模型能够更好地区分和理解不同的意图组合。

关键创新:该论文的关键创新在于提出了“预测感知”的对比学习方法。传统的对比学习方法通常静态地对待所有样本,而PACL框架能够根据模型的预测结果动态地调整对比学习的策略,使得模型更加关注那些容易混淆的样本,从而提升学习效率和性能。

关键设计:在预训练阶段,使用了词级别的数据增强策略,例如随机替换、删除和插入等,以增加数据的多样性。在对比微调阶段,设计了预测感知对比损失函数,该损失函数根据模型预测的置信度来调整对比学习的权重。具体来说,对于模型预测置信度较低的样本,会赋予更高的权重,以促使模型更好地学习这些样本的特征。

🖼️ 关键图片

📊 实验亮点

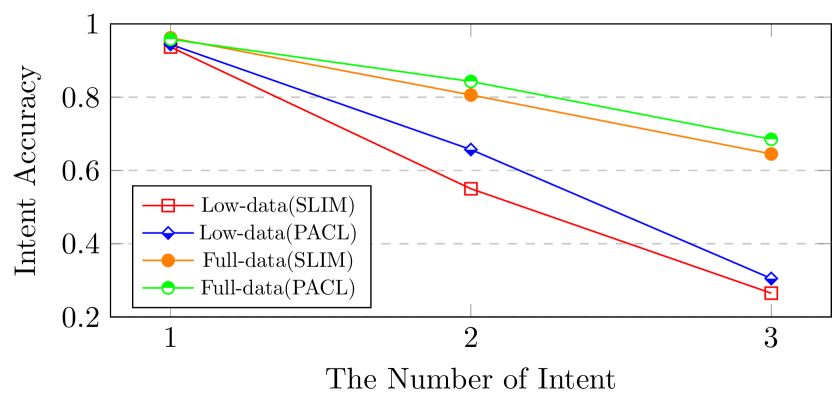

实验结果表明,PACL框架在三个广泛使用的数据集上均取得了显著的性能提升。在低数据场景下,PACL的性能提升尤为明显,表明其能够有效利用有限的数据进行学习。与三个基线模型相比,PACL在各项指标上均取得了最佳结果,证明了其有效性。

🎯 应用场景

该研究成果可应用于智能客服、语音助手、智能家居等领域,提升机器对用户复杂意图的理解能力,从而提供更精准、个性化的服务。例如,在智能客服中,能够准确识别用户提出的多个问题,并给出相应的解答;在智能家居中,能够理解用户发出的包含多个指令的语音指令,并控制多个设备协同工作。

📄 摘要(原文)

Multi-intent natural language understanding (NLU) presents a formidable challenge due to the model confusion arising from multiple intents within a single utterance. While previous works train the model contrastively to increase the margin between different multi-intent labels, they are less suited to the nuances of multi-intent NLU. They ignore the rich information between the shared intents, which is beneficial to constructing a better embedding space, especially in low-data scenarios. We introduce a two-stage Prediction-Aware Contrastive Learning (PACL) framework for multi-intent NLU to harness this valuable knowledge. Our approach capitalizes on shared intent information by integrating word-level pre-training and prediction-aware contrastive fine-tuning. We construct a pre-training dataset using a word-level data augmentation strategy. Subsequently, our framework dynamically assigns roles to instances during contrastive fine-tuning while introducing a prediction-aware contrastive loss to maximize the impact of contrastive learning. We present experimental results and empirical analysis conducted on three widely used datasets, demonstrating that our method surpasses the performance of three prominent baselines on both low-data and full-data scenarios.