Open-SQL Framework: Enhancing Text-to-SQL on Open-source Large Language Models

作者: Xiaojun Chen, Tianle Wang, Tianhao Qiu, Jianbin Qin, Min Yang

分类: cs.CL, cs.AI

发布日期: 2024-05-04

💡 一句话要点

Open-SQL框架:增强开源大语言模型在Text-to-SQL任务中的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 大语言模型 开源模型 监督微调 思维链 数据库 少样本学习

📋 核心要点

- 开源LLM在Text-to-SQL任务中面临上下文理解和响应连贯性的挑战,现有方法难以有效处理。

- Open-SQL框架通过openprompt策略、监督微调、思维链和token高效技术来提升开源LLM的Text-to-SQL能力。

- 实验结果表明,该方法显著提升了Llama2-7B和Code Llama-7B在BIRD-Dev数据集上的性能,甚至超越了GPT-4。

📝 摘要(中文)

本文提出了Open-SQL框架,旨在解决开源大语言模型(LLMs)在Text-to-SQL任务中面临的上下文理解和响应连贯性挑战。该框架包含对开源LLMs在Text-to-SQL任务中的全面评估、用于有效问题表示的openprompt策略、以及用于监督微调的创新策略。同时,探索了思维链(Chain-of-Thought)在逐步推理中的优势,并提出了openexample方法以增强少样本学习。此外,还引入了token高效技术,如可变长度开放数据库模式(Variable-length Open DB Schema)、目标列截断(Target Column Truncation)和示例列截断(Example Column Truncation),以应对大规模数据库的挑战。研究结果强调了进一步研究监督微调对上下文学习能力影响的必要性。实验表明,该方法显著提升了Llama2-7B和Code Llama-7B在BIRD-Dev数据集上的性能,其中Code Llama-7B甚至超越了GPT-4。

🔬 方法详解

问题定义:Text-to-SQL任务旨在将自然语言问题转换为SQL查询语句。现有方法,特别是基于开源大语言模型的方法,在处理复杂的上下文信息、保持响应的连贯性以及有效利用数据库schema信息方面存在不足。这些痛点限制了开源LLM在Text-to-SQL任务中的实际应用。

核心思路:Open-SQL框架的核心思路是通过一系列策略,包括改进问题表示、优化微调过程、利用思维链推理以及减少token使用量,来增强开源LLM在Text-to-SQL任务中的性能。这样设计的目的是使模型更好地理解问题意图,更有效地利用数据库信息,并生成更准确的SQL查询。

技术框架:Open-SQL框架包含以下主要模块:1) 评估模块:对开源LLM在Text-to-SQL任务中的性能进行全面评估。2) 问题表示模块:采用openprompt策略,优化问题表示,使模型更容易理解问题意图。3) 微调模块:使用创新策略进行监督微调,提升模型的Text-to-SQL能力。4) 推理模块:利用思维链(Chain-of-Thought)进行逐步推理,提高查询的准确性。5) Token优化模块:引入可变长度开放数据库模式、目标列截断和示例列截断等技术,减少token使用量,提高效率。

关键创新:该论文的关键创新在于针对开源LLM在Text-to-SQL任务中的特点,提出了一系列定制化的策略。这些策略包括:1) openprompt策略:用于改进问题表示。2) 监督微调策略:用于提升模型性能。3) openexample方法:用于增强少样本学习。4) token高效技术:用于减少token使用量。这些策略的组合使用,使得开源LLM在Text-to-SQL任务中取得了显著的性能提升。

关键设计:在token优化方面,可变长度开放数据库模式允许模型只关注相关的数据库schema信息,减少了不必要的token数量。目标列截断和示例列截断则通过限制目标列和示例列的长度,进一步减少了token使用量。具体的参数设置和损失函数选择在论文中未详细说明,属于未知信息。

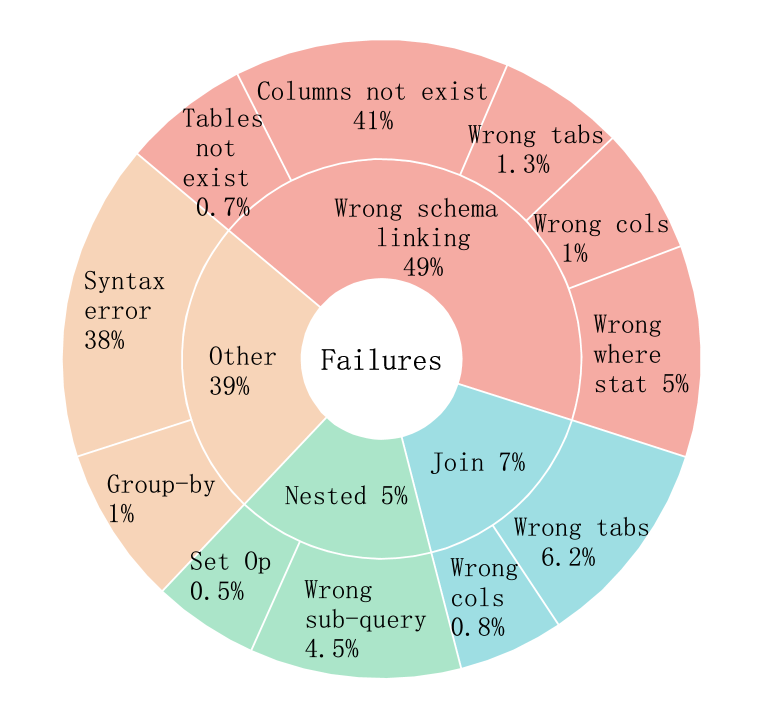

🖼️ 关键图片

📊 实验亮点

实验结果表明,Open-SQL框架显著提升了Llama2-7B和Code Llama-7B在BIRD-Dev数据集上的性能。具体来说,Llama2-7B的性能从2.54%提升到41.04%,Code Llama-7B的性能从14.54%提升到48.24%。值得注意的是,Code Llama-7B的性能甚至超越了GPT-4 (46.35%),证明了该方法的有效性。

🎯 应用场景

Open-SQL框架具有广泛的应用前景,可应用于智能客服、数据分析、商业智能等领域。通过将自然语言问题转换为SQL查询,用户可以更方便地从数据库中获取所需信息,无需具备专业的SQL知识。该研究的成果有助于降低数据分析的门槛,提高数据利用效率,并推动人工智能在数据库领域的应用。

📄 摘要(原文)

Despite the success of large language models (LLMs) in Text-to-SQL tasks, open-source LLMs encounter challenges in contextual understanding and response coherence. To tackle these issues, we present \ours, a systematic methodology tailored for Text-to-SQL with open-source LLMs. Our contributions include a comprehensive evaluation of open-source LLMs in Text-to-SQL tasks, the \openprompt strategy for effective question representation, and novel strategies for supervised fine-tuning. We explore the benefits of Chain-of-Thought in step-by-step inference and propose the \openexample method for enhanced few-shot learning. Additionally, we introduce token-efficient techniques, such as \textbf{Variable-length Open DB Schema}, \textbf{Target Column Truncation}, and \textbf{Example Column Truncation}, addressing challenges in large-scale databases. Our findings emphasize the need for further investigation into the impact of supervised fine-tuning on contextual learning capabilities. Remarkably, our method significantly improved Llama2-7B from 2.54\% to 41.04\% and Code Llama-7B from 14.54\% to 48.24\% on the BIRD-Dev dataset. Notably, the performance of Code Llama-7B surpassed GPT-4 (46.35\%) on the BIRD-Dev dataset.