Argumentative Large Language Models for Explainable and Contestable Claim Verification

作者: Gabriel Freedman, Adam Dejl, Deniz Gorur, Xiang Yin, Antonio Rago, Francesca Toni

分类: cs.CL, cs.AI

发布日期: 2024-05-03 (更新: 2025-04-18)

备注: 18 pages, 18 figures. Accepted as an oral presentation at AAAI 2025

期刊: Proceedings of the AAAI Conference on Artificial Intelligence, 39(14), 14930-14939. 2025

💡 一句话要点

提出论证型大语言模型(ArgLLMs),用于可解释和可辩驳的声明验证。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 论证推理 大语言模型 可解释性 可辩驳性 声明验证 决策支持 人工智能

📋 核心要点

- 现有大语言模型在决策中应用受限,缺乏可信解释和有效辩驳能力,难以纠正错误。

- ArgLLMs通过构建论证框架,利用形式推理支持决策,增强了LLMs的论证推理能力。

- 实验表明,ArgLLMs在声明验证任务中表现良好,并定义了新属性来评估其可辩驳性。

📝 摘要(中文)

大型语言模型(LLMs)蕴含着丰富的知识,并且能够零样本应用于各种场景,使其在决策制定方面具有潜力。然而,它们目前受到其无法提供可信解释和有效辩驳以纠正错误的能力的限制。本文旨在通过引入论证型LLMs (ArgLLMs)来弥合这些优势和劣势,ArgLLMs是一种利用论证推理增强LLMs的方法。具体而言,ArgLLMs构建论证框架,然后将其作为支持决策制定的形式推理的基础。这些论证框架和形式推理的可解释性意味着ArgLLMs做出的任何决策都可以被解释和辩驳。我们在声明验证的决策任务中,通过实验评估了ArgLLMs与最先进技术相比的性能。我们还定义了新的属性来表征可辩驳性,并根据这些属性对ArgLLMs进行正式评估。

🔬 方法详解

问题定义:论文旨在解决大语言模型在决策过程中缺乏可解释性和可辩驳性的问题。现有方法难以提供决策依据,也无法有效纠正模型错误,导致用户难以信任和使用。

核心思路:论文的核心思路是利用论证推理来增强大语言模型。通过构建论证框架,将模型的推理过程显式化,从而提高决策的可解释性。同时,论证框架也为辩驳和纠正模型错误提供了基础。

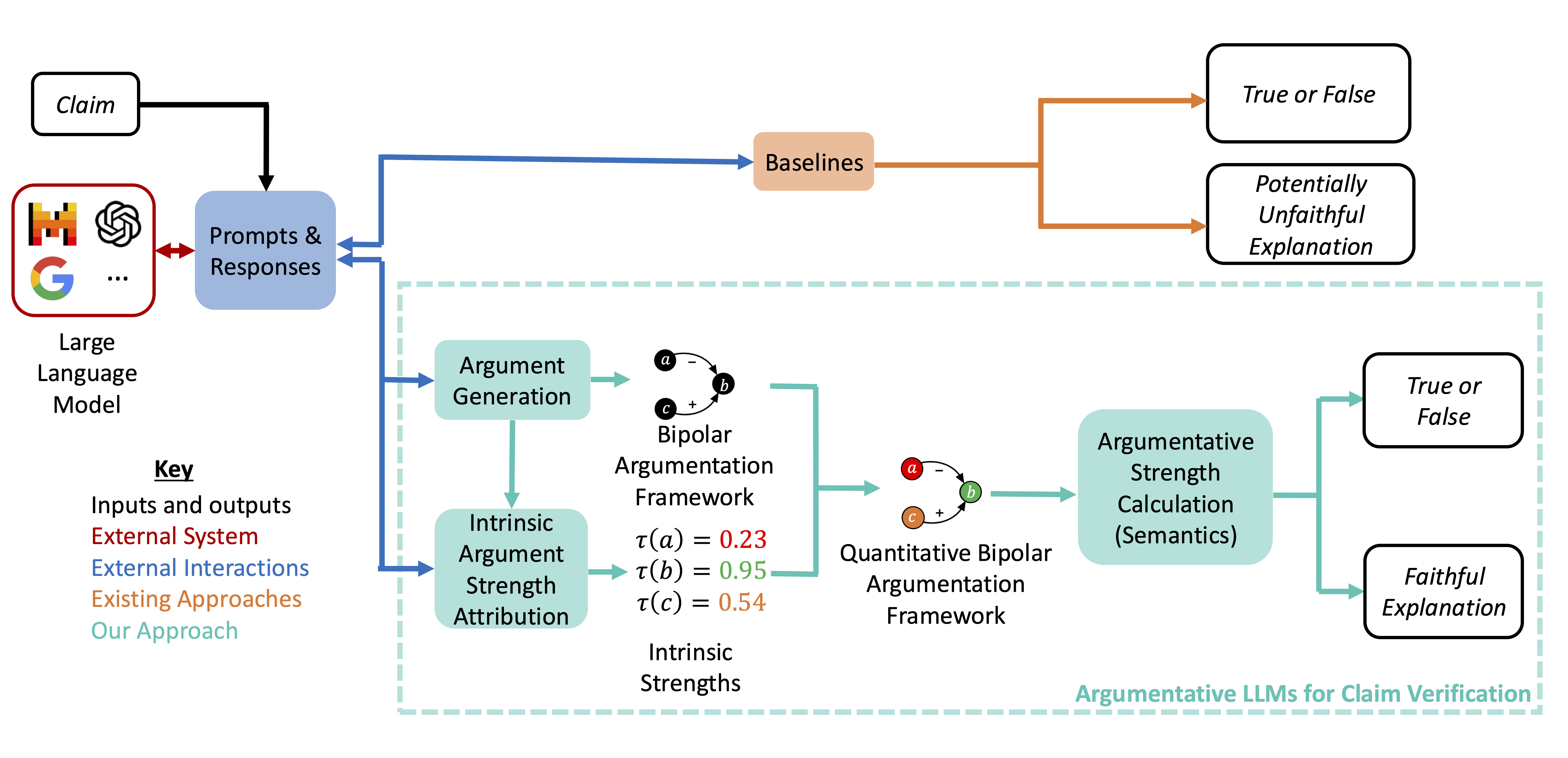

技术框架:ArgLLMs的整体框架包括以下几个主要阶段:1) 使用LLM生成与给定声明相关的论据;2) 构建论证框架,将论据及其之间的攻击关系形式化;3) 使用论证推理算法,基于论证框架评估声明的可信度;4) 提供论证框架作为决策的解释,并允许用户辩驳论据或攻击关系。

关键创新:最重要的技术创新点在于将论证推理与大语言模型相结合。与直接使用LLM进行决策相比,ArgLLMs能够提供更透明、可解释的决策过程,并支持用户参与到决策过程中。

关键设计:论文中没有详细说明关键参数设置、损失函数或网络结构等技术细节。论证框架的具体构建方法和论证推理算法的选择是关键的设计决策,但论文中没有给出具体实现细节。具体使用的LLM模型也未明确说明。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了ArgLLMs在声明验证任务中的有效性,但没有提供具体的性能数据和对比基线。论文定义了新的属性来表征可辩驳性,并对ArgLLMs进行了正式评估,但评估结果的具体数值未知。实验结果的详细数据有待进一步披露。

🎯 应用场景

该研究成果可应用于需要高度可解释性和可信度的决策场景,例如金融风险评估、医疗诊断、法律判决等。通过提供清晰的论证过程,ArgLLMs能够帮助用户理解决策依据,并对决策结果提出质疑和改进意见,从而提高决策的质量和透明度。未来,该方法有望促进人工智能在更广泛领域的应用。

📄 摘要(原文)

The profusion of knowledge encoded in large language models (LLMs) and their ability to apply this knowledge zero-shot in a range of settings makes them promising candidates for use in decision-making. However, they are currently limited by their inability to provide outputs which can be faithfully explained and effectively contested to correct mistakes. In this paper, we attempt to reconcile these strengths and weaknesses by introducing \emph{argumentative LLMs (ArgLLMs)}, a method for augmenting LLMs with argumentative reasoning. Concretely, ArgLLMs construct argumentation frameworks, which then serve as the basis for formal reasoning in support of decision-making. The interpretable nature of these argumentation frameworks and formal reasoning means that any decision made by ArgLLMs may be explained and contested. We evaluate ArgLLMs' performance experimentally in comparison with state-of-the-art techniques, in the context of the decision-making task of claim verification. We also define novel properties to characterise contestability and assess ArgLLMs formally in terms of these properties.