Aloe: A Family of Fine-tuned Open Healthcare LLMs

作者: Ashwin Kumar Gururajan, Enrique Lopez-Cuena, Jordi Bayarri-Planas, Adrian Tormos, Daniel Hinjos, Pablo Bernabeu-Perez, Anna Arias-Duart, Pablo Agustin Martin-Torres, Lucia Urcelay-Ganzabal, Marta Gonzalez-Mallo, Sergio Alvarez-Napagao, Eduard Ayguadé-Parra, Ulises Cortés Dario Garcia-Gasulla

分类: cs.CL, cs.AI

发布日期: 2024-05-03

备注: Five appendix

💡 一句话要点

提出Aloe医疗LLM家族,通过指令调优、模型融合和对齐,在医疗领域实现高性能和伦理标准。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医疗LLM 指令调优 模型对齐 开源模型 思维链 直接偏好优化 风险评估

📋 核心要点

- 现有医疗LLM在开源性和伦理对齐方面存在不足,限制了其在公共领域的广泛应用和安全性。

- Aloe系列模型通过指令调优、模型融合和策略对齐,旨在构建高性能且符合伦理规范的开源医疗LLM。

- 实验结果表明,Aloe模型在多个医疗基准测试中取得了领先的性能,并在偏差和毒性方面进行了全面评估。

📝 摘要(中文)

随着大型语言模型(LLM)在医疗领域的应用不断发展,对能够保障公共利益的、具有竞争力的开源模型的需求日益增长。鉴于极具竞争力的开源基础模型的日益普及,持续预训练的影响越来越不确定。本文探讨了指令调优、模型融合、对齐、红队测试和高级推理方案等方法在改进现有开源模型中的作用。为此,我们推出了Aloe系列,这是一组在其规模范围内极具竞争力的开源医疗LLM。Aloe模型使用最新的基础模型(Mistral、LLaMA 3)进行训练,并采用一种新的自定义数据集,该数据集结合了公共数据源,并通过合成的思维链(CoT)进行了改进。Aloe模型经过对齐阶段,成为首批使用直接偏好优化(Direct Preference Optimization)的策略对齐的开源医疗LLM之一,为医疗LLM的伦理性能树立了新标准。模型评估扩展到包括各种偏差和毒性数据集、专门的红队测试工作以及针对医疗LLM的迫切需要的风险评估。最后,为了探索当前LLM在推理方面的局限性,我们研究了几种先进的提示工程策略,以提高基准测试的性能,从而为开源医疗7B LLM带来了最先进的结果,这是前所未有的。

🔬 方法详解

问题定义:当前医疗领域对开源、高性能且伦理对齐的LLM需求迫切。现有开源模型在医疗知识的掌握、推理能力以及安全性方面存在不足,同时缺乏针对医疗场景的偏差和毒性评估。因此,需要开发一种既能提供准确医疗信息,又能避免潜在危害的开源LLM。

核心思路:本文的核心思路是通过指令调优、模型融合、对齐和红队测试等方法,充分利用现有的优秀开源基础模型(如Mistral和LLaMA 3),并结合高质量的医疗数据,打造一个高性能、安全可靠的医疗LLM。通过对齐,确保模型输出符合伦理规范,降低潜在的偏见和有害信息。

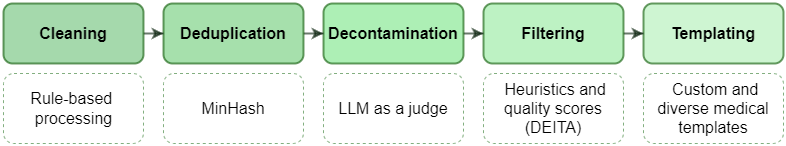

技术框架:Aloe模型的训练流程主要包括以下几个阶段:1) 数据准备:构建包含公共数据和合成CoT数据的新型医疗数据集。2) 指令调优:使用该数据集对基础模型进行指令调优,提升其在医疗领域的知识和推理能力。3) 模型对齐:采用直接偏好优化(DPO)方法,使模型输出与预定义的策略对齐,降低偏差和毒性。4) 模型评估:通过多种基准测试、偏差和毒性数据集以及红队测试,全面评估模型的性能和安全性。

关键创新:Aloe模型的主要创新点在于:1) 结合公共数据和合成CoT数据,构建了高质量的医疗指令调优数据集。2) 采用DPO方法进行策略对齐,显著降低了模型的偏差和毒性,使其更符合医疗伦理规范。3) 进行了全面的风险评估,包括红队测试和偏差/毒性分析,确保模型的安全可靠性。

关键设计:在数据准备阶段,使用了合成的CoT数据来增强模型的推理能力。在模型对齐阶段,采用了DPO方法,并设计了合适的奖励函数,以引导模型生成符合伦理规范的输出。在模型评估阶段,使用了多种基准测试、偏差和毒性数据集,并进行了人工红队测试,以全面评估模型的性能和安全性。

🖼️ 关键图片

📊 实验亮点

Aloe模型在多个医疗基准测试中取得了领先的性能,例如在MedQA上的准确率超过了其他同等规模的开源模型。通过DPO对齐,模型在偏差和毒性方面得到了显著改善,降低了生成有害信息的风险。红队测试也验证了模型的安全性和可靠性。

🎯 应用场景

Aloe模型可应用于医疗咨询、辅助诊断、医学教育等领域。它能够为医生提供决策支持,帮助患者获取可靠的医疗信息,并促进医学知识的传播。作为一个开源模型,Aloe可以被广泛使用和改进,从而推动医疗人工智能的发展。

📄 摘要(原文)

As the capabilities of Large Language Models (LLMs) in healthcare and medicine continue to advance, there is a growing need for competitive open-source models that can safeguard public interest. With the increasing availability of highly competitive open base models, the impact of continued pre-training is increasingly uncertain. In this work, we explore the role of instruct tuning, model merging, alignment, red teaming and advanced inference schemes, as means to improve current open models. To that end, we introduce the Aloe family, a set of open medical LLMs highly competitive within its scale range. Aloe models are trained on the current best base models (Mistral, LLaMA 3), using a new custom dataset which combines public data sources improved with synthetic Chain of Thought (CoT). Aloe models undergo an alignment phase, becoming one of the first few policy-aligned open healthcare LLM using Direct Preference Optimization, setting a new standard for ethical performance in healthcare LLMs. Model evaluation expands to include various bias and toxicity datasets, a dedicated red teaming effort, and a much-needed risk assessment for healthcare LLMs. Finally, to explore the limits of current LLMs in inference, we study several advanced prompt engineering strategies to boost performance across benchmarks, yielding state-of-the-art results for open healthcare 7B LLMs, unprecedented at this scale.