Is Bigger Edit Batch Size Always Better? -- An Empirical Study on Model Editing with Llama-3

作者: Junsang Yoon, Akshat Gupta, Gopala Anumanchipalli

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-05-01

💡 一句话要点

研究表明:针对Llama-3的模型编辑中,增大编辑批量大小可能适得其反

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型编辑 批量大小 Llama-3 顺序编辑 批量编辑 知识更新 大型语言模型

📋 核心要点

- 现有模型编辑方法倾向于追求更大的编辑批量大小,但其有效性缺乏充分验证,可能存在性能瓶颈。

- 论文通过对比顺序编辑、批量编辑和混合编辑策略,探究了不同编辑批量大小对Llama-3模型编辑性能的影响。

- 实验结果表明,增大编辑批量大小可能导致模型性能下降,强调了顺序编辑在模型编辑中的重要性。

📝 摘要(中文)

本研究针对最新的大型语言模型Llama-3进行了有针对性的模型编辑分析。我们探索了流行的模型编辑技术——ROME、MEMIT和EMMET的有效性,这些技术专为精确的层干预而设计。我们通过评估确定了用于目标编辑的最有效层,该评估涵盖了三种不同的策略,最多可进行4096次编辑:顺序编辑、批量编辑以及我们称之为顺序-批量编辑的混合方法。我们的研究结果表明,对于相同数量的编辑,增加编辑批量大小可能比顺序使用较小的编辑批量更显著地降低模型性能。因此,我们认为顺序模型编辑是扩展模型编辑方法的重要组成部分,未来的研究应侧重于结合批量编辑和顺序编辑的方法。这一观察结果表明,当前推动更大编辑批量大小的模型编辑方法可能存在潜在的局限性,我们希望它能为未来优化批量大小和模型编辑性能的研究铺平道路。

🔬 方法详解

问题定义:现有模型编辑方法,如ROME、MEMIT和EMMET,通常追求更大的编辑批量大小以提高效率。然而,直接增大编辑批量是否总能带来更好的编辑效果,以及是否存在性能瓶颈,尚不明确。本研究旨在探究编辑批量大小对模型编辑性能的影响,尤其是在最新的大型语言模型Llama-3上的表现。

核心思路:论文的核心思路是通过对比不同编辑策略(顺序编辑、批量编辑和顺序-批量编辑)下,模型编辑的性能表现,来评估编辑批量大小的影响。顺序编辑使用较小的批量,逐步更新模型;批量编辑则一次性应用所有编辑;顺序-批量编辑则结合了两者的优点。通过比较这三种策略,可以更清晰地了解编辑批量大小对模型编辑效果的影响。

技术框架:整体框架包括三个主要步骤:1) 选择模型编辑技术(ROME、MEMIT、EMMET);2) 设计三种编辑策略(顺序编辑、批量编辑、顺序-批量编辑);3) 在Llama-3上进行实验,评估不同策略下的编辑性能。评估指标包括编辑的准确性、一致性和泛化能力。

关键创新:本研究的关键创新在于对编辑批量大小与模型编辑性能之间的关系进行了深入的实证分析,并发现增大编辑批量大小可能适得其反。这一发现挑战了当前模型编辑领域追求更大批量大小的趋势,并强调了顺序编辑的重要性。

关键设计:实验中,作者使用了三种流行的模型编辑技术(ROME、MEMIT、EMMET),并针对Llama-3的特定层进行了编辑。编辑数量高达4096个,涵盖了多种不同的编辑目标。为了公平比较,所有策略都使用了相同的编辑目标和评估指标。顺序-批量编辑策略的具体实现方式(例如,批量大小的选择)以及损失函数的具体形式,论文中未明确说明,属于未知信息。

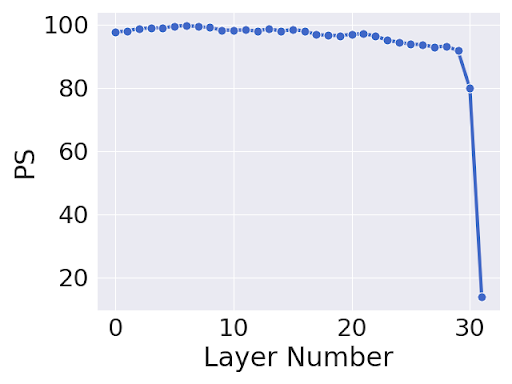

🖼️ 关键图片

📊 实验亮点

实验结果表明,对于相同数量的编辑,增加编辑批量大小可能比顺序使用较小的编辑批量更显著地降低模型性能。这一发现挑战了当前模型编辑领域追求更大批量大小的趋势,并强调了顺序编辑在模型编辑中的重要性。具体的性能下降幅度以及不同编辑策略之间的显著性差异,论文中未提供详细数据,属于未知信息。

🎯 应用场景

该研究成果可应用于提升大型语言模型的知识更新和修正能力,例如修复模型中的错误信息、添加新的知识或调整模型的行为。通过优化编辑批量大小,可以更有效地对模型进行个性化定制,使其更好地适应特定任务和应用场景。未来的研究可以探索更智能的批量大小选择策略,以进一步提高模型编辑的效率和准确性。

📄 摘要(原文)

This study presents a targeted model editing analysis focused on the latest large language model, Llama-3. We explore the efficacy of popular model editing techniques - ROME, MEMIT, and EMMET, which are designed for precise layer interventions. We identify the most effective layers for targeted edits through an evaluation that encompasses up to 4096 edits across three distinct strategies: sequential editing, batch editing, and a hybrid approach we call as sequential-batch editing. Our findings indicate that increasing edit batch-sizes may degrade model performance more significantly than using smaller edit batches sequentially for equal number of edits. With this, we argue that sequential model editing is an important component for scaling model editing methods and future research should focus on methods that combine both batched and sequential editing. This observation suggests a potential limitation in current model editing methods which push towards bigger edit batch sizes, and we hope it paves way for future investigations into optimizing batch sizes and model editing performance.