Are Models Biased on Text without Gender-related Language?

作者: Catarina G Belém, Preethi Seshadri, Yasaman Razeghi, Sameer Singh

分类: cs.CL, cs.AI, cs.CV, cs.CY, cs.LG

发布日期: 2024-05-01

备注: In International Conference on Learning Representations 2024

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出UnStereoEval框架,揭示语言模型在非刻板文本中仍存在的性别偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 性别偏见 语言模型 公平性评估 非刻板文本 UnStereoEval

📋 核心要点

- 现有性别偏见研究主要关注训练数据中的性别相关性导致的刻板印象强化,忽略了非刻板场景下的潜在偏见。

- 论文提出UnStereoEval (USE) 框架,通过句子级分数来评估句子中词-性别关联的程度,从而生成无刻板印象的评估基准。

- 实验结果表明,即使在非刻板文本中,主流语言模型仍然存在显著的性别偏见,公平性仅为9%-41%。

📝 摘要(中文)

本文研究了大型语言模型在非刻板场景下的性别偏见问题。现有研究表明,模型会因训练数据中的性别相关性而强化刻板印象。本文关注的是训练数据影响不明确的偏见,并提出了UnStereoEval (USE) 框架,用于在无刻板印象的场景中调查性别偏见。USE定义了一个基于预训练数据统计的句子级分数,以确定句子是否包含最小的词-性别关联。通过USE,本文自动生成了不含任何性别相关语言的基准,并重新利用了现有的性别偏见基准(Winobias和Winogender)进行非刻板评估。实验结果表明,所有28个测试模型都表现出较低的公平性,仅在9%-41%的无刻板印象句子中表现出公平行为,这表明偏见并非仅源于性别相关词语的存在。这些结果引发了关于模型偏见来源的重要问题,并强调了进行更系统和全面的偏见评估的必要性。本文发布了完整的数据集和代码。

🔬 方法详解

问题定义:现有研究主要关注语言模型因训练数据中的性别相关性而产生的刻板印象偏见,忽略了在不包含明显性别相关词汇的文本中,模型是否仍然存在偏见。现有方法难以有效评估和消除这种非刻板印象偏见。

核心思路:论文的核心思路是构建一个能够自动识别和生成不包含明显性别相关词汇的文本的评估框架,从而可以在一个更加“干净”的环境下评估语言模型的性别偏见。通过分析模型在这些文本上的表现,可以更清晰地揭示模型内部潜在的偏见来源。

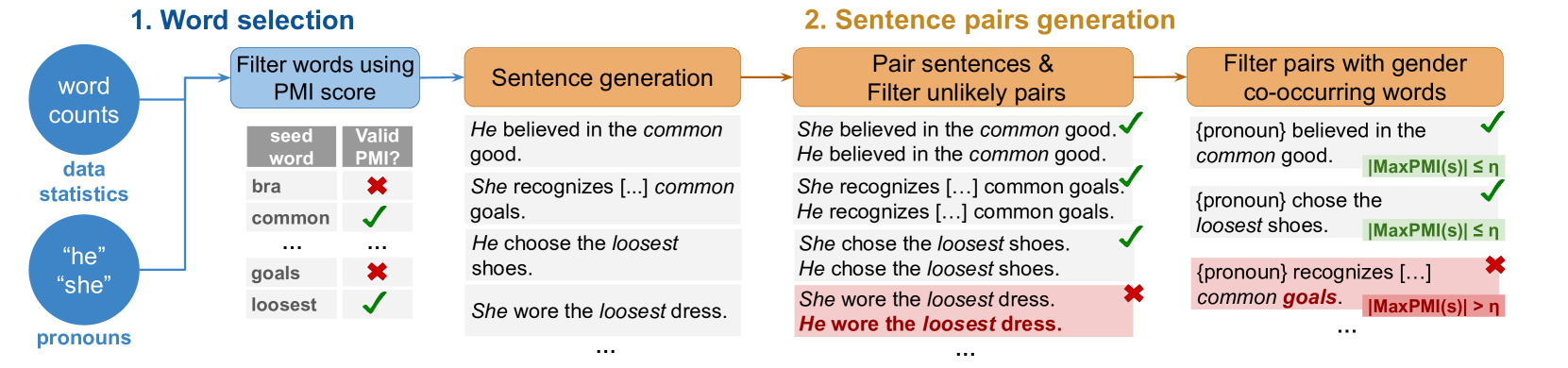

技术框架:整体框架主要包含以下几个阶段:1) 定义句子级分数:基于预训练数据统计,计算句子中词-性别关联的程度。2) 自动生成基准:利用句子级分数,自动生成不含任何性别相关语言的评估基准UnStereoEval (USE)。3) 重用现有基准:利用句子级分数,重新利用现有的性别偏见基准(Winobias和Winogender)进行非刻板评估。4) 模型评估:在生成的和重用的基准上评估各种语言模型的公平性。

关键创新:最重要的技术创新点在于提出了UnStereoEval (USE) 框架,该框架能够自动生成和评估不包含明显性别相关词汇的文本,从而可以在一个更加“干净”的环境下评估语言模型的性别偏见。与现有方法相比,USE能够更有效地揭示模型内部潜在的偏见来源。

关键设计:USE框架的关键设计在于句子级分数的计算方法。该分数基于预训练数据统计,用于衡量句子中词-性别关联的程度。具体的计算方法(论文中未明确说明,未知)需要能够有效区分包含明显性别相关词汇的句子和不包含这些词汇的句子。此外,如何利用该分数自动生成高质量的评估基准也是一个关键的设计问题。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使在不包含明显性别相关词汇的文本中,主流语言模型仍然存在显著的性别偏见。在28个测试模型中,公平性仅为9%-41%。这表明,语言模型的性别偏见并非仅仅源于训练数据中的性别相关词汇,而是可能存在更深层次的原因。

🎯 应用场景

该研究成果可应用于开发更公平、更公正的自然语言处理系统。通过使用UnStereoEval框架,可以系统地评估和改进语言模型,减少其在各种应用场景中(如文本生成、机器翻译、情感分析等)产生的性别偏见,从而提升用户体验,避免歧视和不公平现象。

📄 摘要(原文)

Gender bias research has been pivotal in revealing undesirable behaviors in large language models, exposing serious gender stereotypes associated with occupations, and emotions. A key observation in prior work is that models reinforce stereotypes as a consequence of the gendered correlations that are present in the training data. In this paper, we focus on bias where the effect from training data is unclear, and instead address the question: Do language models still exhibit gender bias in non-stereotypical settings? To do so, we introduce UnStereoEval (USE), a novel framework tailored for investigating gender bias in stereotype-free scenarios. USE defines a sentence-level score based on pretraining data statistics to determine if the sentence contain minimal word-gender associations. To systematically benchmark the fairness of popular language models in stereotype-free scenarios, we utilize USE to automatically generate benchmarks without any gender-related language. By leveraging USE's sentence-level score, we also repurpose prior gender bias benchmarks (Winobias and Winogender) for non-stereotypical evaluation. Surprisingly, we find low fairness across all 28 tested models. Concretely, models demonstrate fair behavior in only 9%-41% of stereotype-free sentences, suggesting that bias does not solely stem from the presence of gender-related words. These results raise important questions about where underlying model biases come from and highlight the need for more systematic and comprehensive bias evaluation. We release the full dataset and code at https://ucinlp.github.io/unstereo-eval.