Is Temperature the Creativity Parameter of Large Language Models?

作者: Max Peeperkorn, Tom Kouwenhoven, Dan Brown, Anna Jordanous

分类: cs.CL, cs.AI

发布日期: 2024-05-01

备注: To be published in the Proceedings of the 15th International Conference on Computational Creativity (ICCC'24), 8 pages, 2 figures, 2 tables

💡 一句话要点

研究表明温度参数与大语言模型创造力的相关性弱,并非直接的“创造力参数”。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 创造力 温度参数 叙事生成 新颖性 连贯性 文本生成 实证分析

📋 核心要点

- 现有方法依赖温度参数调节LLM的创造性,但缺乏充分的理论支撑。

- 本文通过实证分析,研究温度参数与叙事生成创造力的四个关键指标的相关性。

- 实验结果表明,温度参数与创造力的相关性较弱,并非直接的“创造力参数”。

📝 摘要(中文)

大型语言模型(LLM)被应用于各种创造性任务,其输出结果从优美到古怪,从模仿到抄袭不等。LLM的温度参数调节随机性,从而产生更多样化的输出;因此,它通常被认为是创造力参数。本文通过一个预先确定的固定上下文、模型和提示的叙事生成任务来研究这一说法。具体来说,我们对不同温度值的LLM输出进行了实证分析,使用了叙事生成中创造力的四个必要条件:新颖性、典型性、内聚性和连贯性。我们发现温度与新颖性弱相关,与不连贯性中等相关,但与内聚性或典型性无关。然而,温度对创造力的影响远比“创造力参数”这一说法所暗示的更为微妙和微弱;总体结果表明,随着温度升高,LLM会产生稍微新颖的输出。最后,我们讨论了允许更可控的LLM创造力的想法,而不是通过改变温度参数来依赖机会。

🔬 方法详解

问题定义:现有方法通常将LLM的温度参数视为控制创造力的主要手段,认为提高温度可以增加输出的多样性和新颖性。然而,这种方法缺乏对创造力本质的深入理解,并且没有充分的证据表明温度参数与创造力的各个方面都存在正相关关系。因此,需要更深入地研究温度参数与创造力之间的关系,并探索更可控的LLM创造力方法。

核心思路:本文的核心思路是通过实证分析,量化评估温度参数对LLM生成文本创造力的影响。具体来说,选择叙事生成任务,并使用四个关键指标(新颖性、典型性、内聚性和连贯性)来衡量创造力。通过分析不同温度值下LLM生成的文本在这些指标上的表现,来判断温度参数是否能够有效地控制创造力。

技术框架:本文的技术框架主要包括以下几个步骤:1) 确定叙事生成的固定上下文、模型和提示;2) 设置不同的温度值,并使用LLM生成多个文本样本;3) 使用预定义的指标(新颖性、典型性、内聚性和连贯性)评估每个文本样本的创造力;4) 分析不同温度值下文本样本在各个指标上的表现,并计算温度参数与这些指标之间的相关性。

关键创新:本文最重要的技术创新点在于,它采用了一种量化的方法来评估LLM生成文本的创造力。通过使用四个关键指标,可以更全面地了解温度参数对创造力各个方面的影响。此外,本文还提出了探索更可控的LLM创造力方法的想法,为未来的研究方向提供了新的思路。

关键设计:在实验设计方面,本文选择了叙事生成任务,并固定了上下文、模型和提示,以减少其他因素对结果的影响。在指标选择方面,本文选择了新颖性、典型性、内聚性和连贯性这四个关键指标,这些指标涵盖了创造力的不同方面。在相关性分析方面,本文使用了适当的统计方法来计算温度参数与各个指标之间的相关性。

🖼️ 关键图片

📊 实验亮点

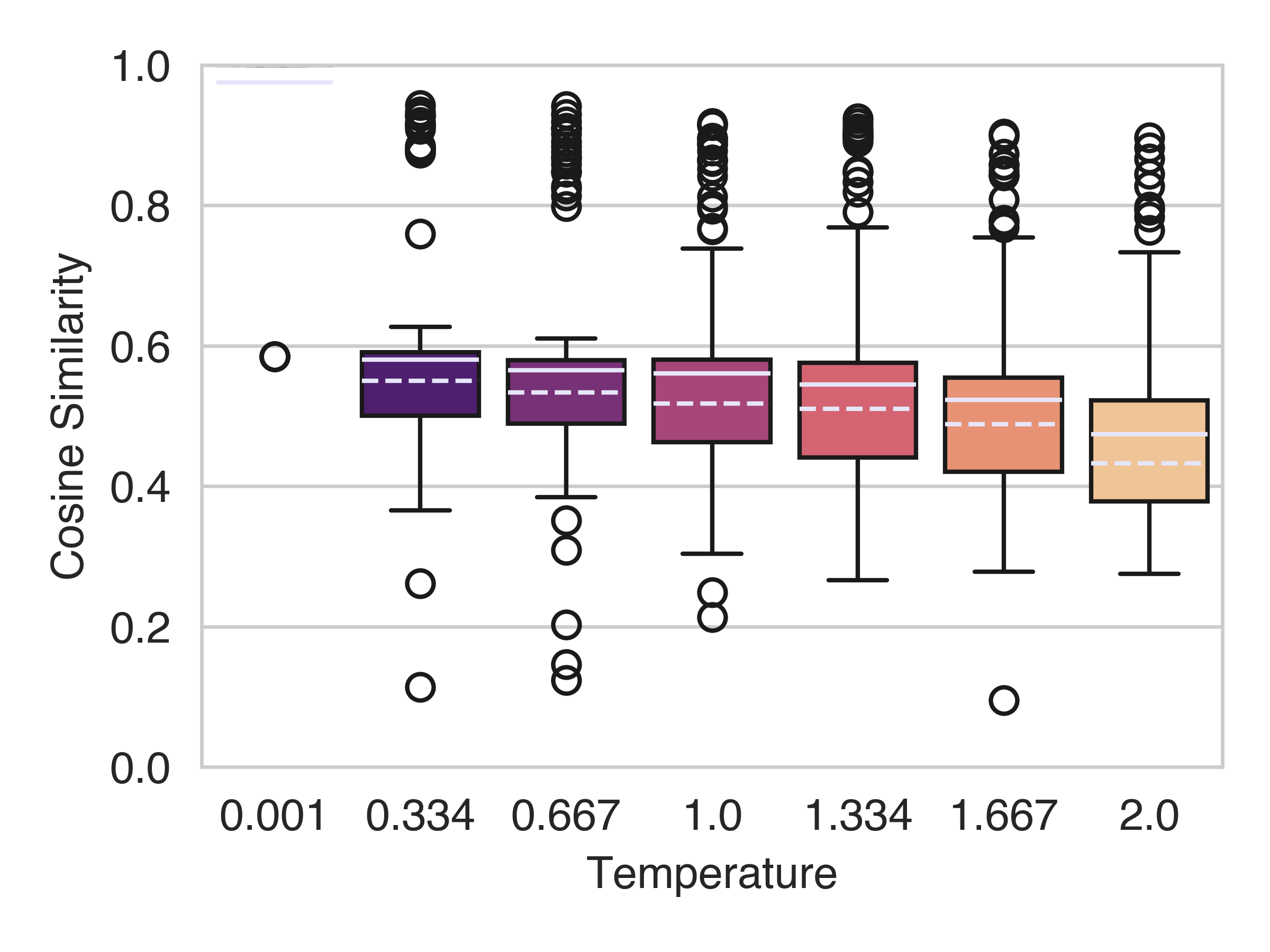

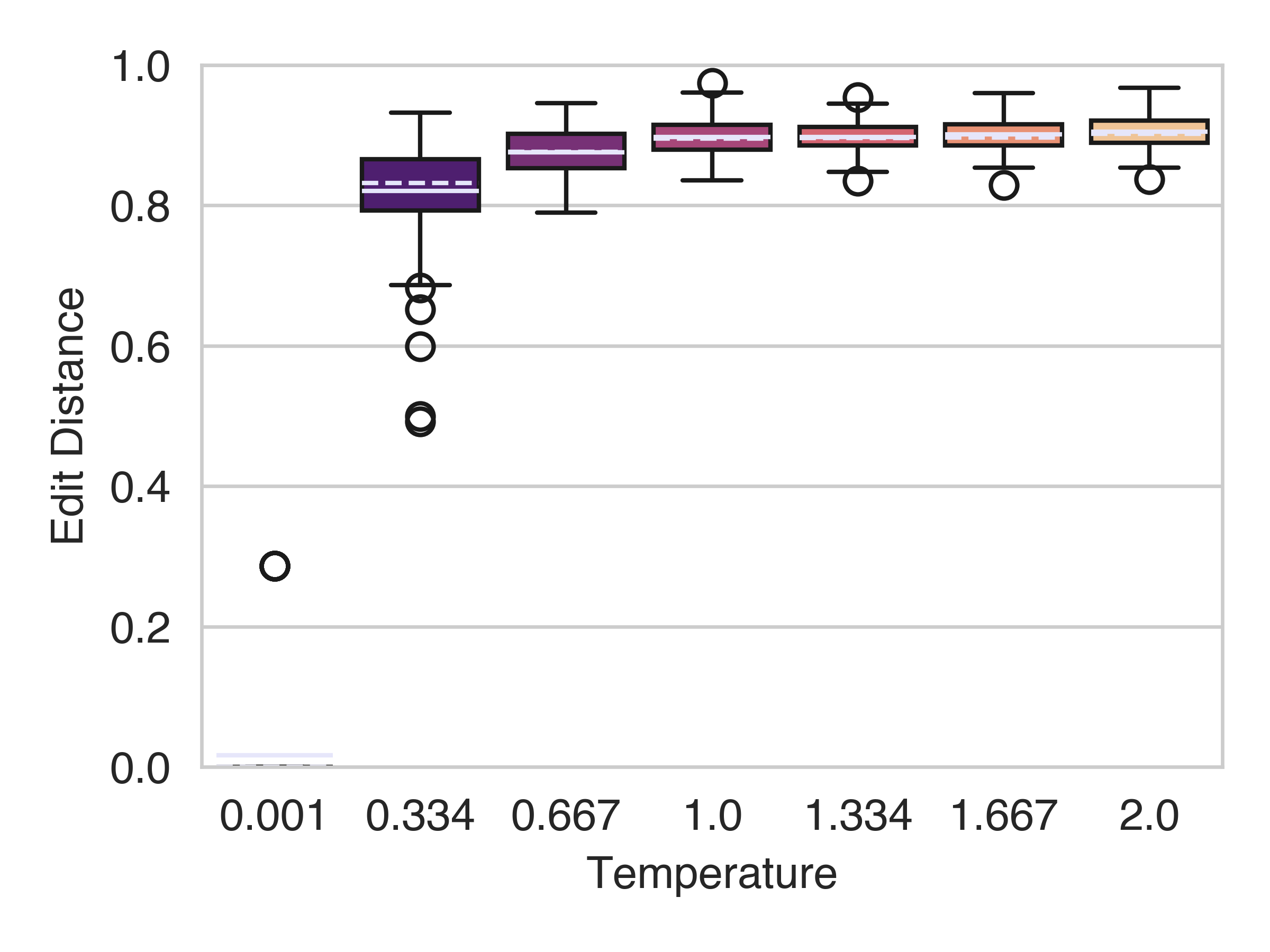

实验结果表明,温度参数与新颖性弱相关,与不连贯性中等相关,但与内聚性和典型性无关。这表明温度参数并非直接的“创造力参数”,其对创造力的影响远比想象的更为微妙。随着温度升高,LLM会产生稍微新颖的输出,但同时也可能导致文本不连贯。

🎯 应用场景

该研究成果可应用于改进LLM在创意写作、内容生成、游戏设计等领域的应用。通过更深入地理解温度参数与创造力的关系,可以开发出更有效的控制方法,从而生成更具创意和高质量的文本内容。未来的研究可以探索其他影响LLM创造力的因素,并设计更智能的创造力控制机制。

📄 摘要(原文)

Large language models (LLMs) are applied to all sorts of creative tasks, and their outputs vary from beautiful, to peculiar, to pastiche, into plain plagiarism. The temperature parameter of an LLM regulates the amount of randomness, leading to more diverse outputs; therefore, it is often claimed to be the creativity parameter. Here, we investigate this claim using a narrative generation task with a predetermined fixed context, model and prompt. Specifically, we present an empirical analysis of the LLM output for different temperature values using four necessary conditions for creativity in narrative generation: novelty, typicality, cohesion, and coherence. We find that temperature is weakly correlated with novelty, and unsurprisingly, moderately correlated with incoherence, but there is no relationship with either cohesion or typicality. However, the influence of temperature on creativity is far more nuanced and weak than suggested by the "creativity parameter" claim; overall results suggest that the LLM generates slightly more novel outputs as temperatures get higher. Finally, we discuss ideas to allow more controlled LLM creativity, rather than relying on chance via changing the temperature parameter.