An Agent-Based Framework for the Automatic Validation of Mathematical Optimization Models

作者: Alexander Zadorojniy, Segev Wasserkrug, Eitan Farchi

分类: cs.AI, cs.SE

发布日期: 2026-04-07

💡 一句话要点

提出一种基于Agent的框架,用于自动验证数学优化模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 优化模型验证 Agent技术 突变测试 大型语言模型 自动验证

📋 核心要点

- 大型语言模型生成优化模型面临验证难题,现有方法难以保证模型正确性并满足自然语言描述的要求。

- 提出基于Agent的自动验证方法,借鉴软件测试思想,通过多Agent协作生成测试用例和模型突变。

- 理论分析和实验结果表明,该方法能够有效验证优化模型,并在突变覆盖率方面表现出高质量的验证效果。

📝 摘要(中文)

近年来,使用大型语言模型(LLM)从自然语言描述生成优化模型变得越来越流行。然而,一个主要的开放性问题是如何验证生成的模型是否正确并满足自然语言描述中定义的要求。在这项工作中,我们提出了一种新颖的基于Agent的方法,用于自动验证优化模型,该方法建立并扩展了软件测试中的方法来解决优化建模问题。该方法由多个Agent组成,这些Agent最初生成问题级别的测试API,然后利用此API生成测试,最后生成特定于优化模型的突变(一种评估测试套件故障检测能力的著名软件测试技术)。在这项工作中,我们详细介绍了这种验证方法,并通过理论和实验证明了该Agent集合在称为突变覆盖的著名软件测试度量方面提供的高质量验证。

🔬 方法详解

问题定义:论文旨在解决如何自动验证由大型语言模型生成的数学优化模型的问题。现有方法缺乏有效的验证机制,难以确保生成的模型符合自然语言描述的要求,并且容易出现逻辑错误和约束冲突等问题。

核心思路:论文的核心思路是将软件测试中的Agent技术和突变测试方法应用于优化模型的验证。通过构建多个Agent,模拟不同的测试角色,自动生成测试用例和模型突变,从而全面评估模型的正确性和鲁棒性。

技术框架:该框架包含以下主要模块:1) 问题级别测试API生成Agent:负责根据优化问题的描述,自动生成用于测试的API接口。2) 测试用例生成Agent:利用生成的API,自动生成各种测试用例,覆盖不同的输入场景和边界条件。3) 模型突变Agent:对优化模型进行随机突变,例如修改目标函数系数、改变约束条件等,模拟模型中可能存在的错误。4) 验证Agent:执行测试用例,并比较突变前后的模型输出,判断模型是否通过测试。

关键创新:该方法的核心创新在于将Agent技术和突变测试方法结合起来,用于自动验证优化模型。与传统的优化模型验证方法相比,该方法能够自动生成测试用例和模型突变,大大提高了验证效率和覆盖率。此外,该方法还能够发现模型中潜在的逻辑错误和约束冲突,提高了模型的可靠性。

关键设计:论文中没有详细描述关键参数设置、损失函数或网络结构等具体技术细节。但是,Agent的设计需要考虑如何有效地生成测试用例和模型突变,以及如何评估模型的输出结果。例如,测试用例生成Agent需要根据优化问题的特点,选择合适的测试策略,例如边界值分析、等价类划分等。模型突变Agent需要设计合理的突变算子,以模拟模型中可能存在的各种错误。

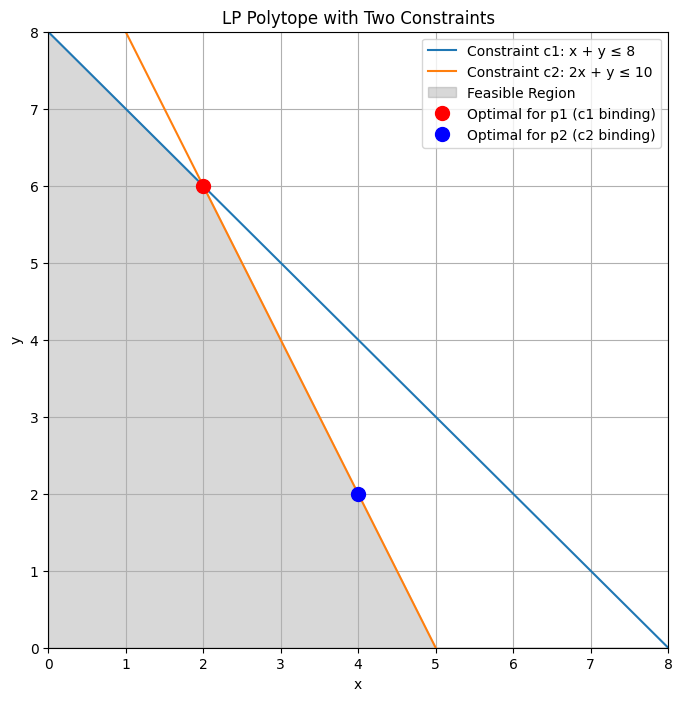

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的Agent框架的有效性。实验结果表明,该框架能够有效地检测优化模型中的错误,并在突变覆盖率方面取得了较高的水平。与传统的模型验证方法相比,该框架能够显著提高验证效率和覆盖率,为优化模型的自动验证提供了一种新的解决方案。

🎯 应用场景

该研究成果可应用于各种领域,例如供应链管理、金融建模、能源优化等,用于验证由大型语言模型自动生成的优化模型。通过自动验证,可以提高模型的可靠性和准确性,减少人工干预,加速模型开发和部署过程。未来,该方法还可以扩展到其他类型的模型验证,例如仿真模型、机器学习模型等。

📄 摘要(原文)

Recently, using Large Language Models (LLMs) to generate optimization models from natural language descriptions has became increasingly popular. However, a major open question is how to validate that the generated models are correct and satisfy the requirements defined in the natural language description. In this work, we propose a novel agent-based method for automatic validation of optimization models that builds upon and extends methods from software testing to address optimization modeling . This method consists of several agents that initially generate a problem-level testing API, then generate tests utilizing this API, and, lastly, generate mutations specific to the optimization model (a well-known software testing technique assessing the fault detection power of the test suite). In this work, we detail this validation method and show, through both theory and experiments, the high quality of validation provided by this agent ensemble in terms of the well-known software testing measure called mutation coverage.