Understanding the Use of a Large Language Model-Powered Guide to Make Virtual Reality Accessible for Blind and Low Vision People

作者: Jazmin Collins, Sharon Y Lin, Tianqi Liu, Andrea Stevenson Won, Shiri Azenkot

分类: cs.HC, cs.AI, cs.ET

发布日期: 2026-03-10

备注: 16 pages, 5 figures, 3 tables, Proceedings of the 2026 CHI Conference on Human Factors in Computing Systems (CHI '26), April 13-17, 2026, Barcelona, Spain. ACM

💡 一句话要点

利用大型语言模型为视障人士打造可交互的虚拟现实辅助工具

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 虚拟现实 可访问性 大型语言模型 视障人士 人机交互

📋 核心要点

- 现有VR环境对视障人士不友好,缺乏有效的辅助导航和信息获取手段。

- 论文提出基于大型语言模型的智能导盲系统,旨在提供自然语言交互的VR辅助体验。

- 通过用户实验,观察视障人士与导盲系统的互动模式,并为未来设计提供建议。

📝 摘要(中文)

随着社交虚拟现实(VR)越来越受欢迎,解决盲人和低视力(BLV)用户的可访问性问题变得至关重要。研究人员提出了一个AI“导盲”系统,以帮助用户导航VR并回答他们的问题,但尚未与用户进行研究。为了解决这个差距,我们开发了一个由大型语言模型(LLM)驱动的导盲系统,并在虚拟环境中与16名BLV参与者一起研究了它的使用情况,环境中包含扮演其他用户的同盟者。我们发现,当独自一人时,参与者将该导盲系统视为一种工具,但在其他人面前则将其视为同伴,给它起昵称,用它的外貌来解释它的错误,并鼓励同盟者与导盲系统互动。我们的工作进一步加深了对导盲系统作为VR可访问性通用方法的理解,并为未来的导盲系统提出了设计建议。

🔬 方法详解

问题定义:当前虚拟现实环境对盲人和低视力(BLV)用户存在严重的可访问性问题。传统的VR交互方式依赖视觉信息,使得BLV用户难以导航、理解场景和与他人互动。现有的辅助技术,如触觉反馈或语音提示,往往不够自然和灵活,无法满足BLV用户在复杂VR环境中的需求。因此,如何为BLV用户提供一种自然、直观且易于使用的VR辅助工具是一个亟待解决的问题。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大自然语言处理能力,构建一个智能导盲系统。该系统能够理解用户的语音指令,感知VR环境中的信息,并以自然语言的形式向用户提供导航、场景描述和社交互动等方面的帮助。通过将LLM与VR环境相结合,旨在创建一个更加友好和可访问的VR体验,使BLV用户能够更好地融入虚拟世界。

技术框架:该研究的技术框架主要包含以下几个模块:1) 语音输入模块:负责接收用户的语音指令,并将其转换为文本格式。2) LLM处理模块:使用大型语言模型对用户的指令进行理解和分析,提取用户的意图和需求。3) VR环境感知模块:负责感知VR环境中的信息,包括场景布局、物体位置、其他用户的状态等。4) 响应生成模块:根据用户的意图和VR环境的信息,生成自然语言形式的响应,包括导航指引、场景描述和社交建议。5) 语音输出模块:将生成的响应转换为语音,并播放给用户。

关键创新:该论文的关键创新在于将大型语言模型应用于VR可访问性领域,并探索了BLV用户与LLM驱动的导盲系统之间的互动模式。与传统的VR辅助技术相比,该方法具有以下优势:1) 自然语言交互:用户可以使用自然语言与导盲系统进行交流,无需学习特定的操作方式。2) 智能感知:导盲系统能够感知VR环境中的信息,并根据用户的需求提供个性化的帮助。3) 社交互动:导盲系统可以帮助BLV用户与其他用户进行社交互动,增强他们的参与感和归属感。

关键设计:论文中没有详细描述LLM的具体参数设置或网络结构,但强调了用户体验的重要性。研究人员通过用户实验,观察BLV用户与导盲系统的互动模式,并根据用户的反馈不断改进系统的设计。例如,他们发现用户在与其他人互动时,会将导盲系统视为一个同伴,因此他们调整了导盲系统的响应方式,使其更加友好和人性化。

🖼️ 关键图片

📊 实验亮点

该研究通过与16名BLV参与者的用户实验,发现他们在使用LLM驱动的导盲系统时,会将其视为工具或同伴,并根据不同的情境调整互动方式。研究还发现,用户会给导盲系统起昵称,并用它的外貌来解释它的错误,这表明用户对导盲系统产生了情感连接。这些发现为未来VR辅助工具的设计提供了重要的参考。

🎯 应用场景

该研究成果可应用于各种VR场景,例如教育、娱乐、社交和工作。它可以帮助视障人士更好地参与VR活动,提高他们的生活质量。未来,该技术还可以扩展到其他领域,例如智能家居、智能交通和医疗保健,为残疾人提供更加便捷和智能的服务。

📄 摘要(原文)

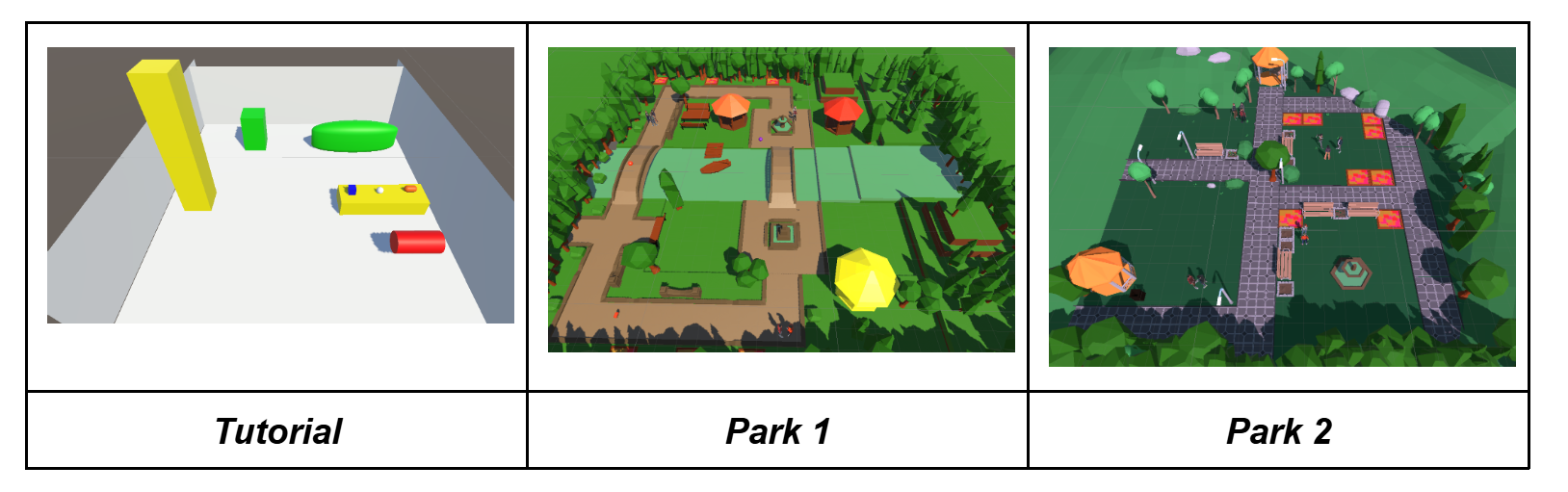

As social virtual reality (VR) grows more popular, addressing accessibility for blind and low vision (BLV) users is increasingly critical. Researchers have proposed an AI "sighted guide" to help users navigate VR and answer their questions, but it has not been studied with users. To address this gap, we developed a large language model (LLM)-powered guide and studied its use with 16 BLV participants in virtual environments with confederates posing as other users. We found that when alone, participants treated the guide as a tool, but treated it companionably around others, giving it nicknames, rationalizing its mistakes with its appearance, and encouraging confederate-guide interaction. Our work furthers understanding of guides as a versatile method for VR accessibility and presents design recommendations for future guides.