Graph Your Way to Inspiration: Integrating Co-Author Graphs with Retrieval-Augmented Generation for Large Language Model Based Scientific Idea Generation

作者: Pengzhen Xie, Huizhi Liang

分类: cs.AI, cs.CL, cs.IR

发布日期: 2026-02-28

💡 一句话要点

GYWI:融合合作者图谱与RAG,赋能大语言模型进行科学创意生成

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 科学创意生成 知识图谱 检索增强生成 大语言模型 作者网络

📋 核心要点

- 现有LLM在科学创意生成中缺乏可控的学术背景和可追溯的灵感路径,限制了其应用。

- GYWI系统结合作者知识图谱和检索增强生成,构建外部知识库,提供可控上下文和灵感来源。

- 实验结果表明,GYWI在多个指标上显著优于主流LLMs,提升了创意生成的新颖性和可靠性。

📝 摘要(中文)

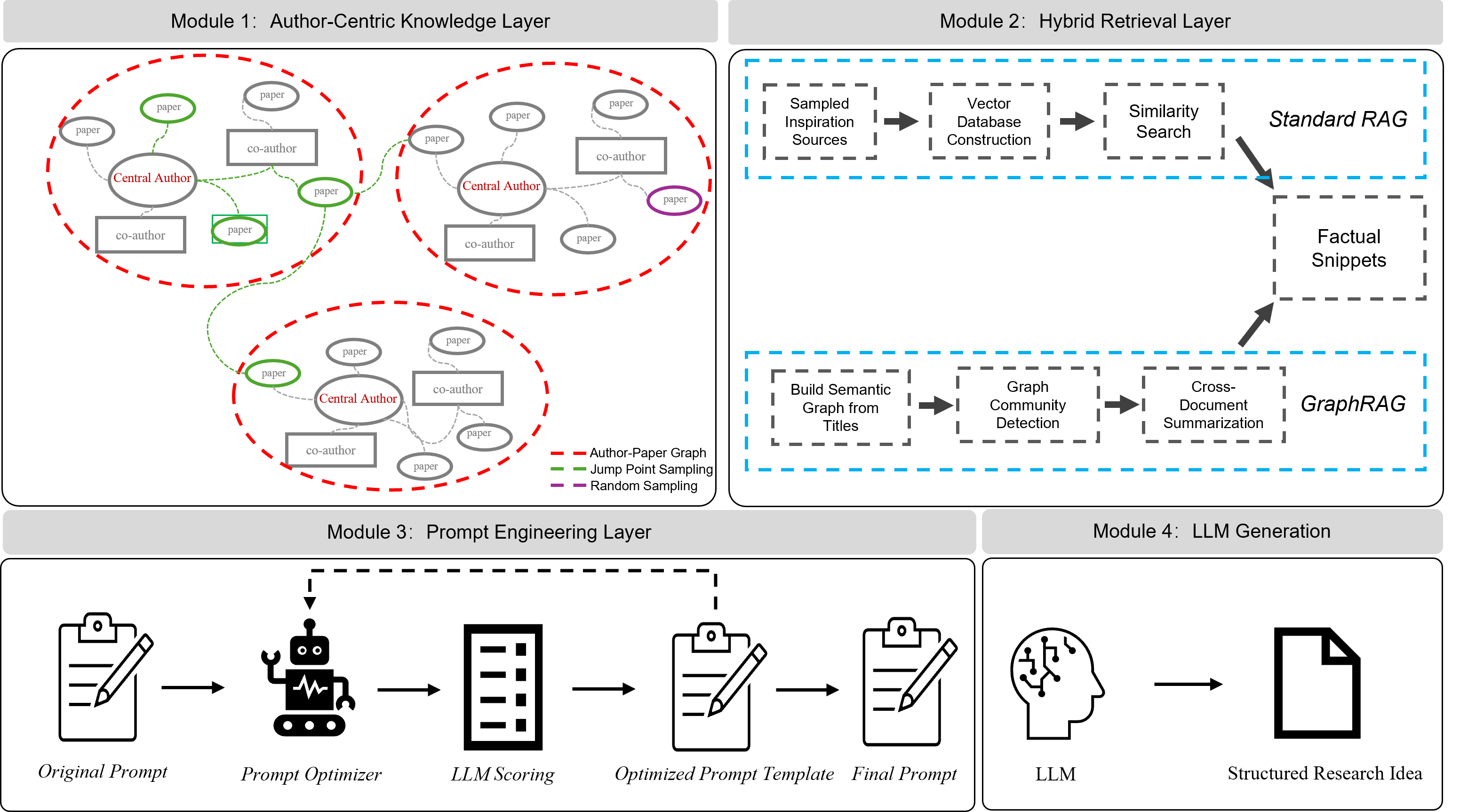

本文提出了一种名为GYWI的科学创意生成系统,旨在弥补现有大语言模型(LLMs)在科学创意生成方面缺乏可控学术背景和可追溯灵感路径的不足。GYWI结合了作者知识图谱和检索增强生成(RAG),构建外部知识库,为LLMs生成新的科学创意提供可控的上下文和灵感来源。该方法首先提出了一种以作者为中心的知识图谱构建方法和灵感来源采样算法,然后设计了一种混合检索机制,结合RAG和GraphRAG,检索具有深度和广度的知识,形成混合上下文。此外,还提出了一种结合强化学习原则的Prompt优化策略,以自动引导LLMs基于混合上下文优化结果。通过在arXiv(2018-2023)数据集上构建的评估数据集进行实验,并采用包括多项选择题、LLM评分、人工评估和语义空间可视化分析在内的综合评估方法,从新颖性、可行性、清晰度、相关性和重要性五个维度评估生成的创意。实验结果表明,GYWI在多个指标上显著优于主流LLMs,如GPT-4o、DeepSeek-V3、Qwen3-8B和Gemini 2.5。

🔬 方法详解

问题定义:现有的大语言模型在科学创意生成任务中,生成的想法往往缺乏学术背景的支撑,难以控制生成方向,并且无法追踪灵感的来源。这使得生成的想法可能不够新颖、可行或与特定研究领域相关。现有方法难以有效地利用学术知识图谱来增强LLM的生成能力。

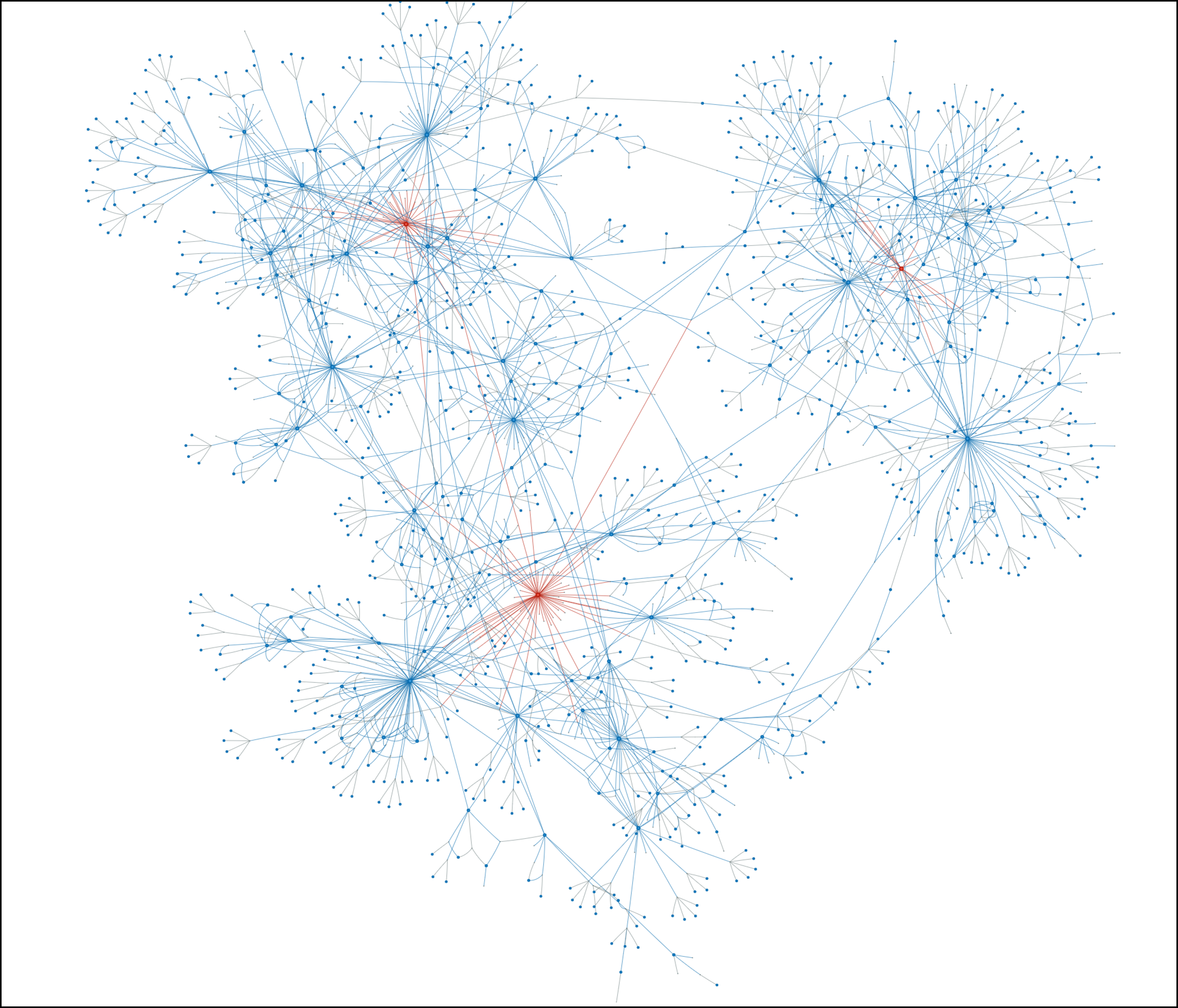

核心思路:本文的核心思路是构建一个以作者为中心的知识图谱,并结合检索增强生成(RAG)技术,为LLM提供更丰富、更可控的学术上下文。通过知识图谱,可以追踪作者之间的合作关系和研究方向,从而为LLM提供灵感来源。RAG技术则可以从知识库中检索相关信息,增强LLM的生成能力。

技术框架:GYWI系统的整体框架包括以下几个主要模块:1) 作者知识图谱构建:构建以作者为中心的知识图谱,包含作者之间的合作关系、研究方向等信息。2) 灵感来源采样:设计算法从知识图谱中采样灵感来源,为LLM提供生成方向。3) 混合检索:结合RAG和GraphRAG,从知识库中检索相关信息,形成混合上下文。4) Prompt优化:利用强化学习原则,优化Prompt,引导LLM基于混合上下文生成高质量的科学创意。

关键创新:该论文的关键创新在于:1) 提出了一种以作者为中心的知识图谱构建方法,能够有效地表示学术知识。2) 设计了一种混合检索机制,结合RAG和GraphRAG,能够检索具有深度和广度的知识。3) 提出了一种基于强化学习的Prompt优化策略,能够自动引导LLM生成高质量的科学创意。与现有方法相比,GYWI能够提供更可控的学术上下文和更可追溯的灵感来源。

关键设计:在知识图谱构建方面,使用了作者之间的合作关系和研究方向作为节点和边。在混合检索方面,RAG使用余弦相似度检索文本,GraphRAG则在知识图谱上进行图游走。在Prompt优化方面,使用了强化学习算法,以生成创意的质量作为奖励信号。具体参数设置和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GYWI在多个指标上显著优于主流LLMs,例如GPT-4o、DeepSeek-V3、Qwen3-8B和Gemini 2.5。具体而言,GYWI在创意的新颖性、可靠性和相关性等方面均取得了显著提升。例如,在人工评估中,GYWI生成创意的平均得分高于其他LLMs 10%-20%。

🎯 应用场景

该研究成果可应用于科研辅助、创新创意生成等领域。研究人员可以利用该系统快速生成新的研究思路,并追踪灵感来源,提高科研效率。此外,该系统还可以用于教育领域,帮助学生更好地理解科学知识,激发创新思维。未来,该系统有望成为科研人员和学生的得力助手,推动科学研究的进步。

📄 摘要(原文)

Large Language Models (LLMs) demonstrate potential in the field of scientific idea generation. However, the generated results often lack controllable academic context and traceable inspiration pathways. To bridge this gap, this paper proposes a scientific idea generation system called GYWI, which combines author knowledge graphs with retrieval-augmented generation (RAG) to form an external knowledge base to provide controllable context and trace of inspiration path for LLMs to generate new scientific ideas. We first propose an author-centered knowledge graph construction method and inspiration source sampling algorithms to construct external knowledge base. Then, we propose a hybrid retrieval mechanism that is composed of both RAG and GraphRAG to retrieve content with both depth and breadth knowledge. It forms a hybrid context. Thirdly, we propose a Prompt optimization strategy incorporating reinforcement learning principles to automatically guide LLMs optimizing the results based on the hybrid context. To evaluate the proposed approaches, we constructed an evaluation dataset based on arXiv (2018-2023). This paper also develops a comprehensive evaluation method including empirical automatic assessment in multiple-choice question task, LLM-based scoring, human evaluation, and semantic space visualization analysis. The generated ideas are evaluated from the following five dimensions: novelty, feasibility, clarity, relevance, and significance. We conducted experiments on different LLMs including GPT-4o, DeepSeek-V3, Qwen3-8B, and Gemini 2.5. Experimental results show that GYWI significantly outperforms mainstream LLMs in multiple metrics such as novelty, reliability, and relevance.