Compositional-ARC: Assessing Systematic Generalization in Abstract Spatial Reasoning

作者: Philipp Mondorf, Shijia Zhou, Monica Riedler, Barbara Plank

分类: cs.AI

发布日期: 2026-02-28

💡 一句话要点

提出Compositional-ARC数据集,并利用元学习提升模型在抽象空间推理中的系统泛化能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 系统泛化 抽象空间推理 元学习 Transformer 组合性 几何变换 Compositional-ARC

📋 核心要点

- 现有大型语言模型在系统泛化方面存在局限性,难以推广到新颖的组合场景,尤其是在抽象空间推理等非语言任务中。

- 论文提出将元学习方法应用于抽象空间推理,通过学习已知几何变换的组合规则,提升模型对未见过的变换组合的泛化能力。

- 实验结果表明,基于Transformer的小型模型通过元学习训练,在Compositional-ARC数据集上显著优于大型语言模型,并与ARC奖获胜模型性能相当。

📝 摘要(中文)

系统泛化是指从已知组件中理解和生成新颖组合的能力。尽管大型语言模型(LLMs)在各个领域取得了进展,但它们在推广到新颖的组合场景时常常失败,这揭示了系统泛化方面的显著局限性。关于神经网络是否具备系统泛化能力一直存在争议,最近的研究表明,为组合性设计的元学习方法可以显著增强这种能力。然而,这些见解主要局限于语言问题,它们在其他任务中的适用性仍然是一个悬而未决的问题。在本研究中,我们将组合性的元学习扩展到抽象空间推理领域。为此,我们引入了$ extit{Compositional-ARC}$——一个旨在评估模型从抽象二维对象的已知几何变换(例如,平移、旋转)系统泛化到这些变换的新颖组合(例如,平移+旋转)的能力的数据集。我们的结果表明,一个基于transformer的小型编码器-解码器模型,通过组合性的元学习进行训练,可以系统地泛化到以前未见过的变换组合。值得注意的是,尽管只有570万个参数,但该模型显著优于最先进的LLM——包括o3-mini、GPT-4o和Gemini 2.0 Flash,这些模型未能表现出类似的系统行为——并且与2024年ARC奖的获胜模型(一个通过测试时训练的80亿参数LLM)的性能相当。我们的发现强调了元学习在促进语言任务之外的系统性方面的有效性,这表明朝着更鲁棒和更具泛化性的模型发展的一个有希望的方向。

🔬 方法详解

问题定义:论文旨在解决抽象空间推理中模型系统泛化能力不足的问题。现有方法,特别是大型语言模型,在面对新颖的几何变换组合时,难以有效推理和泛化,暴露出其在组合性理解上的缺陷。这些模型通常需要大量的参数和数据才能达到一定的性能,且泛化能力有限。

核心思路:论文的核心思路是利用元学习,使模型能够学习如何从已知的几何变换中泛化到未知的变换组合。通过将问题分解为多个任务,每个任务包含不同的变换组合,模型学习在不同任务之间共享知识,从而提高泛化能力。这种方法旨在让模型学习到变换的内在逻辑和组合规则,而不是简单地记忆训练数据。

技术框架:整体框架采用编码器-解码器结构,基于Transformer模型。编码器负责将输入的抽象空间推理问题编码成向量表示,解码器则根据该向量表示生成对应的解决方案。元学习过程通过将训练数据划分为多个任务,每个任务包含不同的变换组合,模型在这些任务上进行迭代训练,学习如何快速适应新的任务。

关键创新:最重要的技术创新点在于将元学习应用于抽象空间推理任务,并设计了专门用于评估组合泛化能力的Compositional-ARC数据集。与现有方法相比,该方法能够更有效地学习变换的组合规则,从而提高模型在未见过的变换组合上的泛化能力。

关键设计:模型采用小型Transformer结构,参数量为5.7M,以提高训练效率和泛化能力。损失函数采用标准的交叉熵损失函数,用于衡量模型预测结果与真实标签之间的差异。元学习过程采用Model-Agnostic Meta-Learning (MAML) 算法,通过在多个任务上进行梯度更新,使模型能够快速适应新的任务。

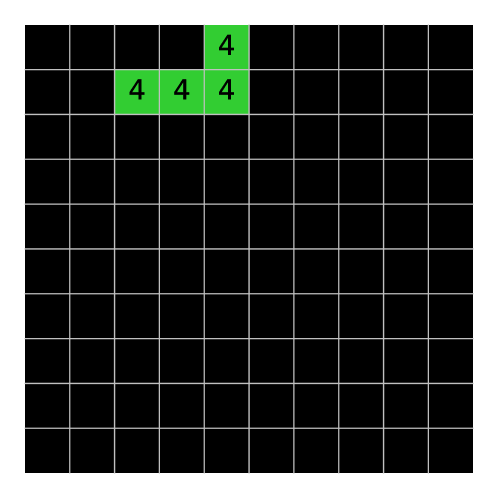

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于Transformer的小型模型(5.7M参数)通过元学习训练,在Compositional-ARC数据集上显著优于大型语言模型,包括o3-mini、GPT-4o和Gemini 2.0 Flash。该模型性能与2024年ARC奖的获胜模型(8B参数)相当,证明了元学习在提升系统泛化能力方面的有效性。

🎯 应用场景

该研究成果可应用于机器人、自动化和人工智能等领域,提升智能体在复杂环境中的推理和决策能力。例如,机器人可以利用该方法学习如何组合不同的动作来实现复杂的任务,从而提高其适应性和灵活性。此外,该方法还可以应用于图像处理、计算机视觉等领域,提升模型对图像中不同元素的组合关系的理解能力。

📄 摘要(原文)

Systematic generalization refers to the capacity to understand and generate novel combinations from known components. Despite recent progress by large language models (LLMs) across various domains, these models often fail to extend their knowledge to novel compositional scenarios, revealing notable limitations in systematic generalization. There has been an ongoing debate about whether neural networks possess the capacity for systematic generalization, with recent studies suggesting that meta-learning approaches designed for compositionality can significantly enhance this ability. However, these insights have largely been confined to linguistic problems, leaving their applicability to other tasks an open question. In this study, we extend meta-learning for compositionality to the domain of abstract spatial reasoning. To this end, we introduce $\textit{Compositional-ARC}\unicode{x2014}$a dataset designed to evaluate the capacity of models to systematically generalize from known geometric transformations (e.g., translation, rotation) of abstract two-dimensional objects to novel combinations of these transformations (e.g., translation+rotation). Our results show that a small transformer-based encoder-decoder model, trained via meta-learning for compositionality, can systematically generalize to previously unseen transformation compositions. Notably, despite having only 5.7M parameters, this model significantly outperforms state-of-the-art LLMs$\unicode{x2014}$including o3-mini, GPT-4o, and Gemini 2.0 Flash, which fail to exhibit similar systematic behavior$\unicode{x2014}$and performs on par with the winning model of the ARC prize 2024, an 8B-parameter LLM trained via test-time training. Our findings highlight the effectiveness of meta-learning in promoting systematicity beyond linguistic tasks, suggesting a promising direction toward more robust and generalizable models.