NoRD: A Data-Efficient Vision-Language-Action Model that Drives without Reasoning

作者: Ishaan Rawal, Shubh Gupta, Yihan Hu, Wei Zhan

分类: cs.AI, cs.CV

发布日期: 2026-02-24

备注: Accepted to CVPR 2026

💡 一句话要点

提出NoRD以解决数据收集与推理标注成本高的问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作 自动驾驶 数据效率 无推理 策略优化 深度学习

📋 核心要点

- 现有视觉-语言-动作模型需要大量数据和推理标注,导致训练成本高昂。

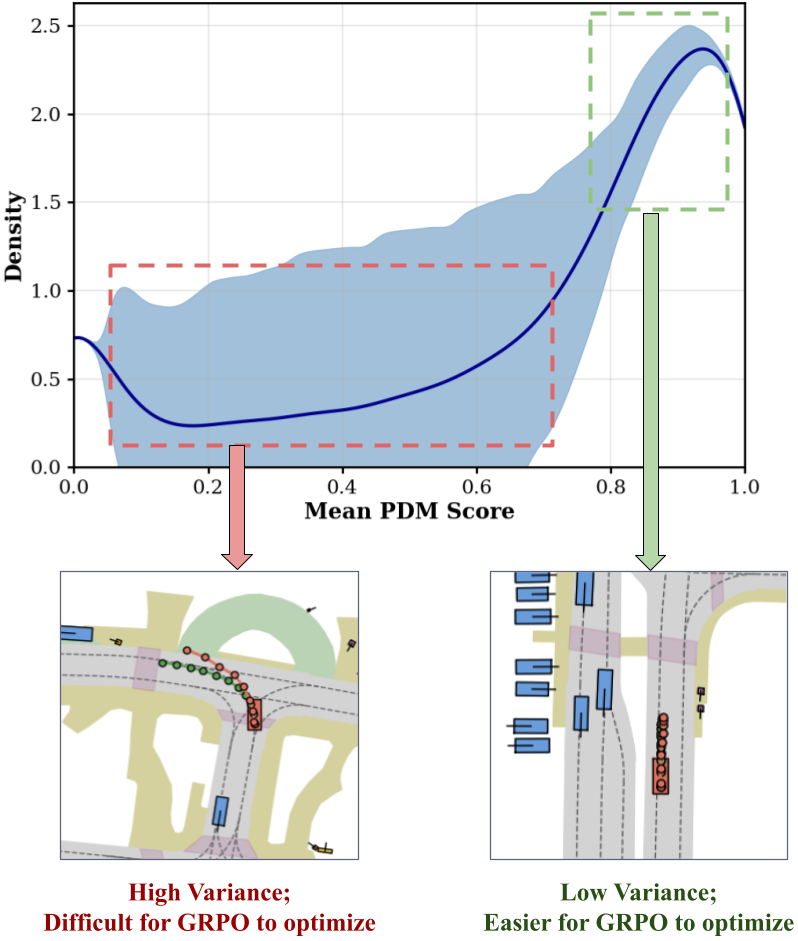

- 提出NoRD模型,利用Dr. GRPO算法解决难度偏差问题,实现高效的训练与推理。

- NoRD在Waymo和NAVSIM数据集上表现出色,使用的数据量减少至60%以下,且无推理开销。

📝 摘要(中文)

视觉-语言-动作(VLA)模型通过统一的端到端架构推动了自动驾驶的发展。然而,现有VLA面临两个昂贵的要求:大量数据集的收集和密集的推理标注。本文提出了NoRD(无推理的驾驶),在不到60%的数据和无推理标注的情况下,仍能实现与现有VLA竞争的性能,减少了3倍的token数量。我们发现标准的群体相对策略优化(GRPO)在小型无推理数据集上未能显著提升性能,主要是由于难度偏差的影响。NoRD通过引入Dr. GRPO算法来克服这一问题,从而在Waymo和NAVSIM上实现了竞争性的性能,显著提高了自动驾驶系统的效率。

🔬 方法详解

问题定义:本文旨在解决现有视觉-语言-动作模型在自动驾驶中对大量数据和推理标注的依赖,导致训练成本高和效率低的问题。

核心思路:提出NoRD模型,通过减少数据需求和推理标注,结合Dr. GRPO算法,克服难度偏差,从而提高训练效率和模型性能。

技术框架:NoRD模型采用端到端的架构,主要包括数据预处理模块、无推理训练模块和基于Dr. GRPO的策略优化模块,确保模型在小数据集上仍能有效学习。

关键创新:NoRD的核心创新在于引入Dr. GRPO算法,专门设计用于缓解难度偏差,这一设计使得模型在小型数据集上能够获得更稳定的奖励信号,显著提升了训练效果。

关键设计:在模型设计中,采用了较少的token数量(减少至3倍),并优化了损失函数以适应无推理的训练需求,确保模型在数据稀缺的情况下仍能保持竞争力。

🖼️ 关键图片

📊 实验亮点

在Waymo和NAVSIM数据集上的实验结果显示,NoRD模型在使用不到60%的数据和无推理标注的情况下,仍能实现与现有模型相当的性能,且训练效率提升了3倍,展示了其在数据效率上的显著优势。

🎯 应用场景

该研究的潜在应用领域包括自动驾驶、智能交通系统和机器人导航等。通过降低对大规模数据集和推理标注的依赖,NoRD能够加速自动驾驶技术的普及与应用,提升系统的整体效率与可靠性。

📄 摘要(原文)

Vision-Language-Action (VLA) models are advancing autonomous driving by replacing modular pipelines with unified end-to-end architectures. However, current VLAs face two expensive requirements: (1) massive dataset collection, and (2) dense reasoning annotations. In this work, we address both challenges with \modelname (\textbf{No} \textbf{R}easoning for \textbf{D}riving). Compared to existing VLAs, \modelname achieves competitive performance while being fine-tuned on $<$60\% of the data and no reasoning annotations, resulting in 3$\times$ fewer tokens. We identify that standard Group Relative Policy Optimization (GRPO) fails to yield significant improvements when applied to policies trained on such small, reasoning-free datasets. We show that this limitation stems from difficulty bias, which disproportionately penalizes reward signals from scenarios that produce high-variance rollouts within GRPO. \modelname overcomes this by incorporating Dr.~GRPO, a recent algorithm designed to mitigate difficulty bias in LLMs. As a result, \modelname achieves competitive performance on Waymo and NAVSIM with a fraction of the training data and no reasoning overhead, enabling more efficient autonomous systems.