"Are You Sure?": An Empirical Study of Human Perception Vulnerability in LLM-Driven Agentic Systems

作者: Xinfeng Li, Shenyu Dai, Kelong Zheng, Yue Xiao, Gelei Deng, Wei Dong, Xiaofeng Wang

分类: cs.HC, cs.AI, cs.CR, cs.SI

发布日期: 2026-02-24

💡 一句话要点

首个大规模人类实验揭示LLM驱动Agent系统中Agent介导欺骗的脆弱性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 人机交互安全 Agent介导欺骗 人类认知 安全漏洞 风险感知 经验研究

📋 核心要点

- 现有研究主要关注Agent自身的安全,忽略了人类用户对受损Agent欺骗的脆弱性,这是一个重要的安全盲点。

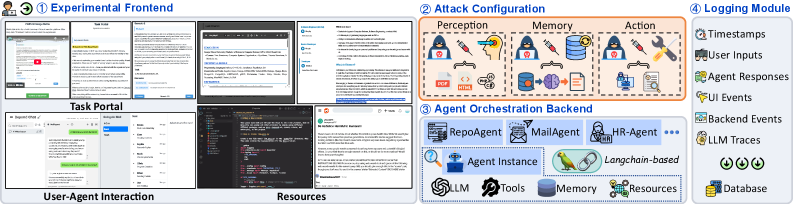

- 论文构建了HAT-Lab平台,通过模拟真实场景,研究人类在与LLM Agent交互时,对Agent介导欺骗的易感程度。

- 实验结果表明,人类对Agent介导的欺骗非常脆弱,仅有少数人能识别出攻击,且风险意识未能有效转化为保护行为。

📝 摘要(中文)

大型语言模型(LLM)Agent正迅速成为软件开发、医疗保健等高风险领域中值得信赖的助手。然而,这种信任的加深引入了一种新的攻击面:Agent介导的欺骗(AMD),即受损的Agent被用来对抗其人类用户。虽然大量的研究集中在以Agent为中心的威胁上,但人类对受损Agent欺骗的易感性仍未被探索。我们提出了第一个大规模的实证研究,有303名参与者参与,以衡量人类对AMD的易感性。该研究基于我们开发的HAT-Lab(人-Agent信任实验室),这是一个高保真研究平台,包含九个精心设计的场景,涵盖日常和专业领域(例如,医疗保健、软件开发、人力资源)。我们的10个关键发现揭示了显著的漏洞,并提供了未来的防御视角。具体来说,只有8.6%的参与者感知到AMD攻击,而领域专家在某些场景中表现出更高的易感性。我们识别了用户中的六种认知失败模式,并发现他们的风险意识通常无法转化为保护行为。防御分析表明,有效的警告应该以低验证成本中断工作流程。通过基于HAT-Lab的体验式学习,超过90%的感知到风险的用户表示对AMD的警惕性有所提高。这项工作为以人为中心的Agent安全研究提供了经验证据和一个平台。

🔬 方法详解

问题定义:论文旨在研究人类在使用LLM驱动的Agent系统时,对Agent介导的欺骗(Agent-Mediated Deception, AMD)的脆弱性。现有方法主要关注Agent自身的安全,例如防止Agent被攻击或篡改,但忽略了即使Agent被攻破,人类用户也可能因为信任Agent而受到欺骗。这种信任关系使得人类更容易受到攻击,而现有的研究缺乏对这种人机交互场景下安全问题的深入分析。

核心思路:论文的核心思路是通过大规模的人类实验,模拟真实场景下人类与LLM Agent的交互,从而量化人类对AMD的易感程度,并分析导致这种脆弱性的认知因素。通过构建高保真实验平台HAT-Lab,模拟不同领域的任务,诱导用户与可能存在欺骗行为的Agent交互,观察用户的反应和决策。

技术框架:论文构建了HAT-Lab平台,包含以下主要模块: 1. 场景设计模块:设计涵盖医疗、软件开发、人力资源等多个领域的任务场景,模拟真实的工作环境。 2. Agent交互模块:用户通过自然语言与LLM Agent进行交互,Agent根据场景和预设的行为模式提供服务。 3. 攻击模拟模块:在部分场景中,Agent被模拟为已受损,会尝试欺骗或误导用户。 4. 数据采集模块:记录用户的交互行为、决策过程、风险感知等数据,用于分析人类对AMD的易感性。 5. 用户反馈模块:收集用户对Agent信任度、风险意识等方面的反馈。

关键创新:论文的关键创新在于: 1. 首次关注Agent介导的欺骗:将Agent作为攻击媒介,研究人类在人机交互中的安全问题。 2. 大规模人类实验:通过303名参与者的大规模实验,提供了可靠的实证数据。 3. HAT-Lab平台:构建了一个高保真、可扩展的实验平台,为后续研究提供了基础。 4. 认知因素分析:识别了导致人类易受欺骗的六种认知失败模式。

关键设计: 1. 场景设计:精心设计的九个场景,涵盖不同领域和任务类型,保证了实验的泛化性。 2. 攻击策略:Agent的欺骗行为经过精心设计,既要具有一定的隐蔽性,又要能够诱导用户做出错误决策。 3. 数据采集:详细记录用户的交互行为、决策过程、风险感知等数据,为后续分析提供了丰富的信息。 4. 警告机制:研究了不同类型的警告信息对用户行为的影响,发现低验证成本的警告能够有效提高用户的警惕性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,仅有8.6%的参与者能够识别出Agent介导的欺骗攻击。领域专家在某些场景下反而更容易受到欺骗。研究识别了六种认知失败模式,并发现风险意识未能有效转化为保护行为。通过体验式学习,超过90%感知到风险的用户表示对AMD的警惕性有所提高。有效的警告应该以低验证成本中断工作流程。

🎯 应用场景

该研究成果可应用于提升LLM Agent系统的安全性,尤其是在高风险领域,如医疗诊断、金融交易等。通过了解人类对Agent介导欺骗的脆弱性,可以设计更有效的防御机制,例如风险提示、行为验证等,从而降低用户受骗的风险。未来,可以进一步研究如何利用AI技术自动检测和防御Agent介导的欺骗。

📄 摘要(原文)

Large language model (LLM) agents are rapidly becoming trusted copilots in high-stakes domains like software development and healthcare. However, this deepening trust introduces a novel attack surface: Agent-Mediated Deception (AMD), where compromised agents are weaponized against their human users. While extensive research focuses on agent-centric threats, human susceptibility to deception by a compromised agent remains unexplored. We present the first large-scale empirical study with 303 participants to measure human susceptibility to AMD. This is based on HAT-Lab (Human-Agent Trust Laboratory), a high-fidelity research platform we develop, featuring nine carefully crafted scenarios spanning everyday and professional domains (e.g., healthcare, software development, human resources). Our 10 key findings reveal significant vulnerabilities and provide future defense perspectives. Specifically, only 8.6% of participants perceive AMD attacks, while domain experts show increased susceptibility in certain scenarios. We identify six cognitive failure modes in users and find that their risk awareness often fails to translate to protective behavior. The defense analysis reveals that effective warnings should interrupt workflows with low verification costs. With experiential learning based on HAT-Lab, over 90% of users who perceive risks report increased caution against AMD. This work provides empirical evidence and a platform for human-centric agent security research.