Architecting AgentOS: From Token-Level Context to Emergent System-Level Intelligence

作者: ChengYou Li, XiaoDong Liu, XiangBao Meng, XinYu Zhao

分类: cs.AI

发布日期: 2026-02-24

备注: 16 pages,9 figures

💡 一句话要点

提出AgentOS框架,将LLM重定义为推理内核,提升系统级智能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 操作系统 智能体系统 上下文管理 认知漂移

📋 核心要点

- 现有方法在扩展LLM上下文窗口和优化prompt工程方面存在局限,缺乏微观token处理与宏观系统智能间的有效连接。

- AgentOS框架将LLM视为推理内核,通过结构化操作系统逻辑进行管理,实现深度上下文管理和认知状态的连贯性。

- 该研究通过映射经典操作系统抽象到LLM,为构建弹性、可扩展和自我进化的认知环境提供了理论基础和实践指导。

📝 摘要(中文)

大型语言模型(LLM)的范式正经历从静态推理引擎到动态自主认知系统的根本转变。当前研究主要集中在扩展上下文窗口或优化提示工程,但微观token处理和宏观系统智能之间的理论桥梁仍然不完整。本文提出了AgentOS,一个整体的概念框架,将LLM重新定义为由结构化操作系统逻辑管理的“推理内核”。该架构的核心是深度上下文管理,它将上下文窗口概念化为可寻址的语义空间,而不是被动的缓冲区。我们系统地解构了从离散序列到连贯认知状态的转变,引入了语义切片和时间对齐机制,以减轻多智能体编排中的认知漂移。通过将经典的操作系统抽象(如内存分页、中断处理和进程调度)映射到LLM原生结构,本文为构建弹性、可扩展和自我进化的认知环境提供了一个严谨的路线图。我们的分析断言,AGI发展的下一个前沿在于系统级协调的架构效率。

🔬 方法详解

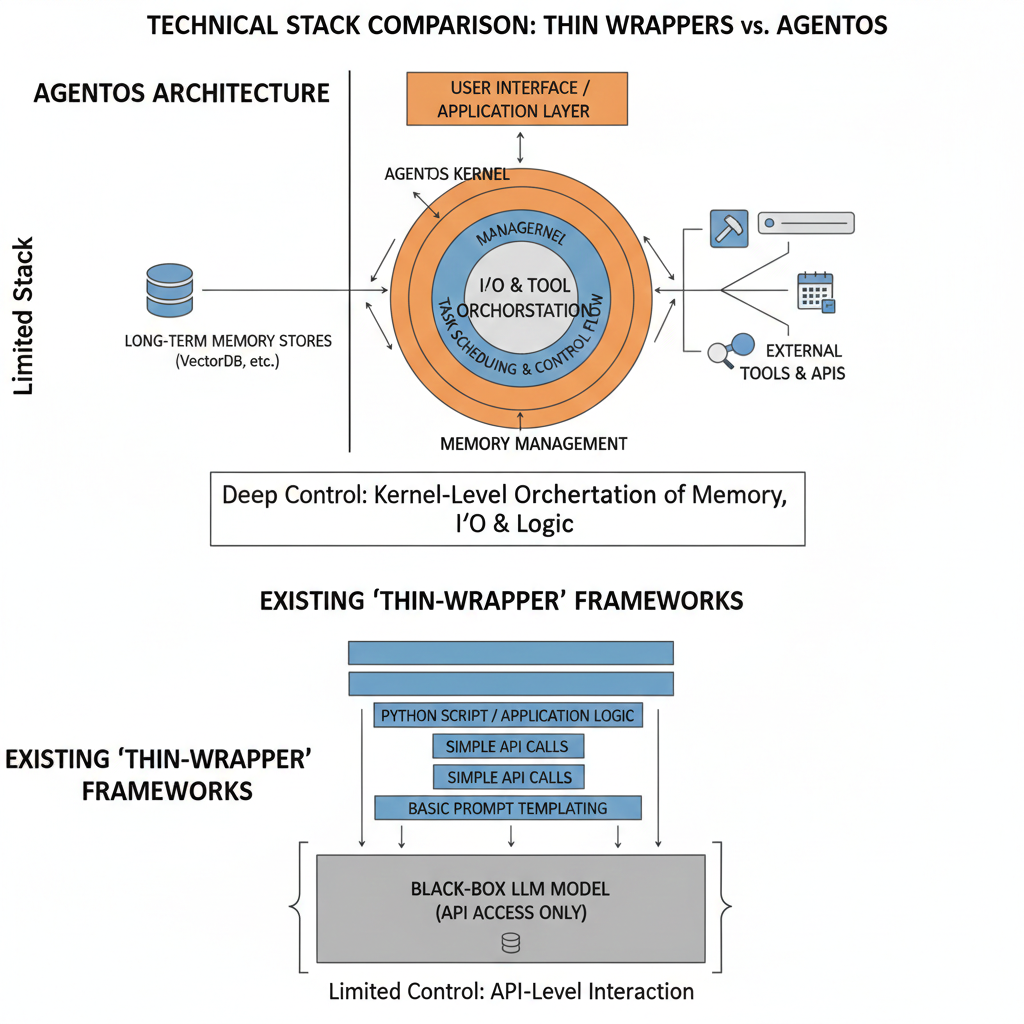

问题定义:现有的大型语言模型应用,虽然可以通过扩展上下文窗口和优化prompt工程来提升性能,但缺乏一个系统性的框架来管理和利用上下文信息,导致微观的token处理和宏观的系统智能之间存在断裂。现有的方法难以有效地处理多智能体协作中的认知漂移问题,并且缺乏对LLM资源进行有效调度和管理的能力。

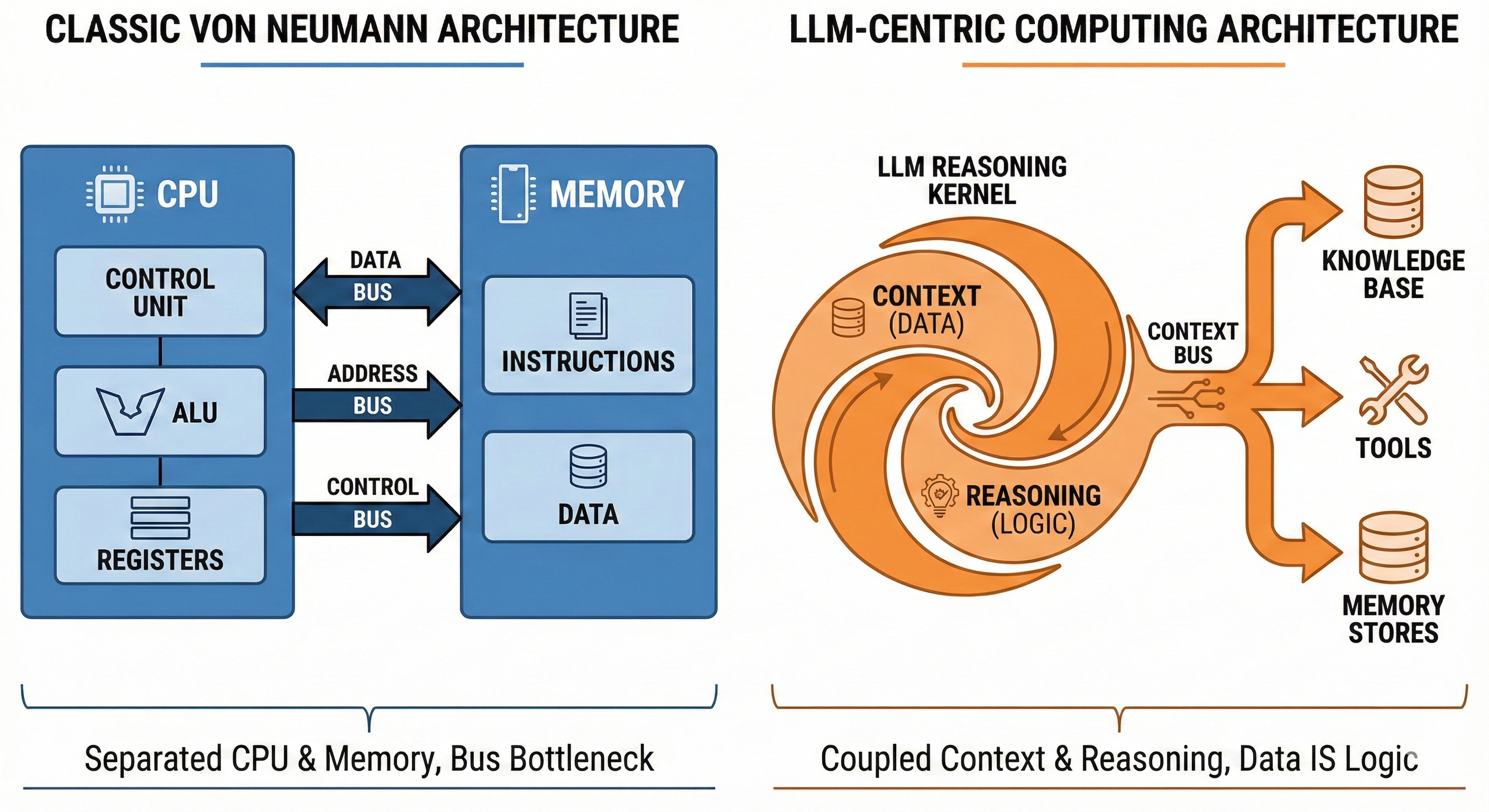

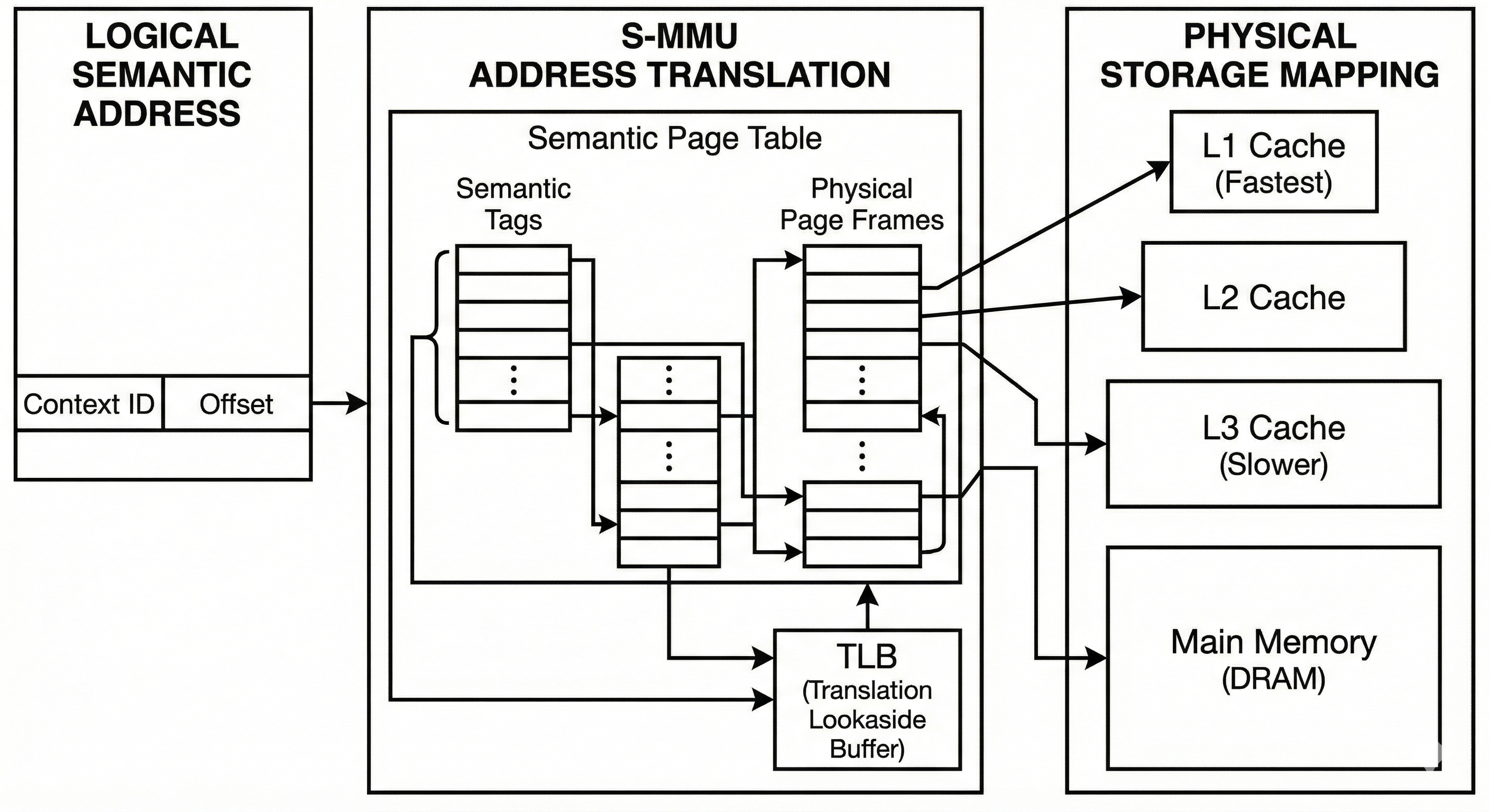

核心思路:AgentOS的核心思路是将LLM重新定义为一个“推理内核”,并借鉴操作系统的设计思想,构建一个结构化的框架来管理和利用LLM的上下文信息。通过将上下文窗口视为可寻址的语义空间,并引入语义切片和时间对齐等机制,AgentOS旨在弥合微观token处理和宏观系统智能之间的差距,并提升多智能体协作的效率和稳定性。

技术框架:AgentOS的技术框架主要包括以下几个模块:1) 推理内核:即LLM本身,负责执行推理任务。2) 深度上下文管理:负责管理和维护LLM的上下文信息,包括语义切片和时间对齐等机制。3) 操作系统逻辑:负责调度和管理LLM的资源,包括内存分页、中断处理和进程调度等。整体流程是,AgentOS接收到任务请求后,首先通过深度上下文管理模块对上下文信息进行处理,然后将处理后的上下文信息传递给推理内核进行推理,最后将推理结果返回给用户。

关键创新:AgentOS最重要的技术创新点在于将LLM视为推理内核,并借鉴操作系统的设计思想来构建一个结构化的框架。这种方法能够有效地管理和利用LLM的上下文信息,并提升多智能体协作的效率和稳定性。此外,AgentOS还引入了语义切片和时间对齐等机制,以减轻多智能体编排中的认知漂移。

关键设计:AgentOS的关键设计包括:1) 语义切片:将上下文信息划分为多个语义相关的片段,以便更好地管理和利用。2) 时间对齐:对不同智能体产生的上下文信息进行时间对齐,以保证上下文信息的一致性。3) 内存分页:将LLM的内存空间划分为多个页面,以便更好地管理和利用。4) 中断处理:当LLM发生错误或需要处理紧急任务时,通过中断机制进行处理。5) 进程调度:对LLM的进程进行调度,以保证LLM的运行效率。

🖼️ 关键图片

📊 实验亮点

论文主要提出了一个概念框架,目前缺乏具体的实验数据支持。但其核心思想,即借鉴操作系统设计理念来管理LLM,具有重要的理论意义和潜在的应用价值。该框架为未来LLM系统架构设计提供了一个新的方向。

🎯 应用场景

AgentOS框架具有广泛的应用前景,可应用于智能客服、自动化流程、多智能体协作等领域。通过提升LLM的系统级智能,AgentOS能够帮助构建更智能、更高效的AI系统,从而在各个行业中创造更大的价值。未来,AgentOS有望成为AGI发展的重要基石。

📄 摘要(原文)

The paradigm of Large Language Models is undergoing a fundamental transition from static inference engines to dynamic autonomous cognitive systems.While current research primarily focuses on scaling context windows or optimizing prompt engineering the theoretical bridge between micro scale token processing and macro scale systemic intelligence remains fragmented.This paper proposes AgentOS,a holistic conceptual framework that redefines the LLM as a "Reasoning Kernel" governed by structured operating system logic.Central to this architecture is Deep Context Management which conceptualizes the context window as an Addressable Semantic Space rather than a passive buffer.We systematically deconstruct the transition from discrete sequences to coherent cognitive states introducing mechanisms for Semantic Slicing and Temporal Alignment to mitigate cognitive drift in multi-agent orchestration.By mapping classical OS abstractions such as memory paging interrupt handling and process scheduling onto LLM native constructs, this review provides a rigorous roadmap for architecting resilient scalable and self-evolving cognitive environments.Our analysis asserts that the next frontier of AGI development lies in the architectural efficiency of system-level coordination.