HELP: HyperNode Expansion and Logical Path-Guided Evidence Localization for Accurate and Efficient GraphRAG

作者: Yuqi Huang, Ning Liao, Kai Yang, Anning Hu, Shengchao Hu, Xiaoxing Wang, Junchi Yan

分类: cs.AI

发布日期: 2026-02-24

💡 一句话要点

提出HELP框架,通过超节点扩展和逻辑路径引导,提升GraphRAG的准确性和效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GraphRAG 知识图谱 检索增强生成 多跳推理 超节点 证据定位 大型语言模型

📋 核心要点

- 现有RAG方法忽略了多跳推理所需的结构依赖,而基于图的RAG方法面临效率和准确性的权衡。

- HELP框架通过超节点扩展捕获复杂结构依赖,并利用逻辑路径引导实现高效的证据定位。

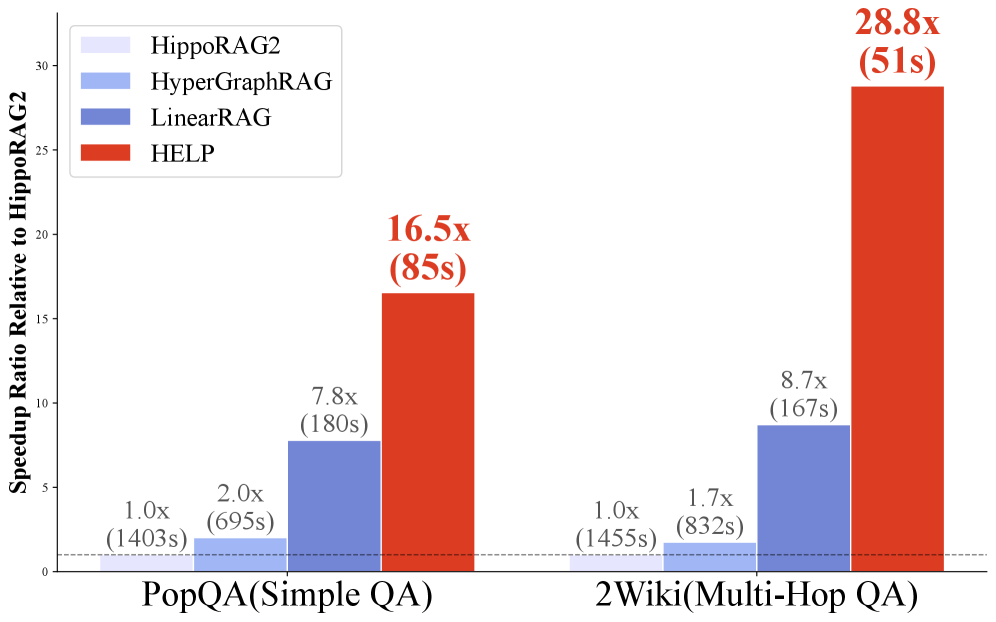

- 实验结果表明,HELP在多个问答基准测试中表现出色,并显著提升了检索速度。

📝 摘要(中文)

大型语言模型(LLMs)常常受限于固有的知识边界和幻觉问题,这限制了它们在知识密集型任务中的可靠性。检索增强生成(RAG)虽然可以缓解这些问题,但它经常忽略对于多跳推理至关重要的结构性相互依赖关系。基于图的RAG方法试图弥合这一差距,但由于代价高昂的图遍历和LLM生成摘要中的语义噪声等挑战,它们通常面临准确性和效率之间的权衡。在本文中,我们提出了用于GraphRAG的超节点扩展和逻辑路径引导证据定位策略(HELP),这是一个旨在通过两个核心策略平衡准确性和实际效率的新颖框架:1) 超节点扩展,它迭代地将知识三元组链接成连贯的推理路径,抽象为超节点,以捕获复杂的结构依赖关系并确保检索准确性;2) 逻辑路径引导的证据定位,它利用预先计算的图-文本相关性将这些路径直接映射到语料库,从而实现卓越的效率。HELP避免了昂贵的随机游走和语义失真,在保持知识完整性的同时,大大降低了检索延迟。大量的实验表明,HELP在多个简单和多跳问答基准测试中实现了具有竞争力的性能,并且比领先的基于图的RAG基线快达28.8倍。

🔬 方法详解

问题定义:现有基于图的RAG方法在处理多跳推理时,面临着图遍历成本高昂和LLM生成摘要引入语义噪声的问题。这些问题导致了准确性和效率之间的trade-off,限制了它们在实际应用中的可行性。论文旨在解决如何在保证准确性的前提下,提升GraphRAG的效率,使其能够更好地处理复杂的多跳推理任务。

核心思路:论文的核心思路是利用超节点来抽象复杂的推理路径,并通过预计算的图-文本相关性来引导证据定位。超节点能够捕获知识图谱中的结构依赖关系,避免了随机游走带来的效率问题。逻辑路径引导则利用预先计算的图-文本相关性,将推理路径直接映射到语料库,从而避免了LLM生成摘要带来的语义失真。

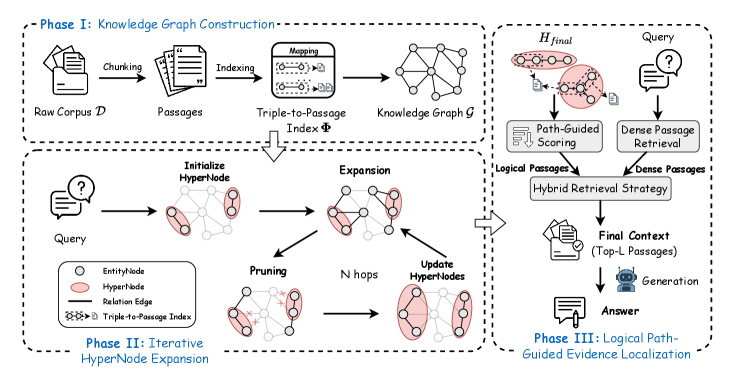

技术框架:HELP框架包含两个主要模块:超节点扩展和逻辑路径引导的证据定位。首先,超节点扩展模块迭代地将知识三元组链接成连贯的推理路径,并将这些路径抽象为超节点。然后,逻辑路径引导的证据定位模块利用预先计算的图-文本相关性,将这些超节点映射到语料库中的相关文本片段。最后,将检索到的文本片段输入LLM,生成最终答案。

关键创新:HELP框架的关键创新在于超节点扩展和逻辑路径引导的结合。超节点扩展能够有效地捕获知识图谱中的结构依赖关系,而逻辑路径引导则能够避免LLM生成摘要带来的语义失真,并显著提升检索效率。与现有方法相比,HELP框架能够在保证准确性的前提下,大幅提升GraphRAG的效率。

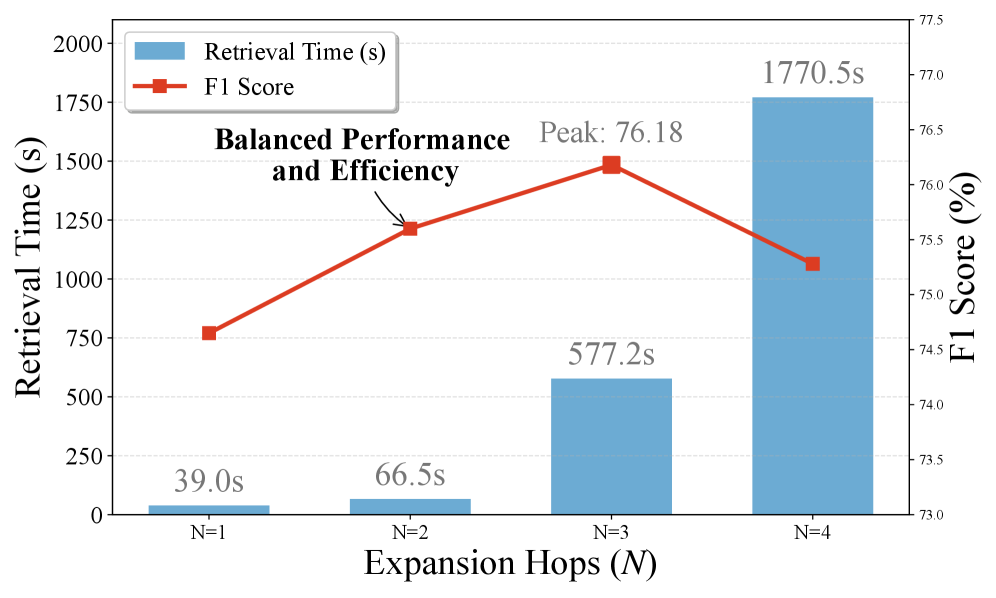

关键设计:超节点扩展模块采用迭代的方式构建超节点,每次迭代都会将与当前超节点相关的知识三元组添加到超节点中。逻辑路径引导模块使用预先计算的图-文本相关性矩阵,该矩阵记录了知识图谱中的每个节点与语料库中的每个文本片段之间的相关性。在检索过程中,该模块会根据超节点中的节点,从相关性矩阵中选择最相关的文本片段。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HELP框架在多个简单和多跳问答基准测试中取得了具有竞争力的性能。与领先的基于图的RAG基线相比,HELP框架实现了高达28.8倍的加速。这些结果证明了HELP框架在提升GraphRAG准确性和效率方面的有效性。

🎯 应用场景

HELP框架可应用于各种需要多跳推理的知识密集型任务,例如问答系统、智能助手、医学诊断和金融分析等。通过提升GraphRAG的准确性和效率,HELP能够帮助用户更有效地利用知识图谱中的信息,从而做出更明智的决策。该研究的未来影响在于推动知识图谱在实际应用中的普及,并促进人工智能技术的发展。

📄 摘要(原文)

Large Language Models (LLMs) often struggle with inherent knowledge boundaries and hallucinations, limiting their reliability in knowledge-intensive tasks. While Retrieval-Augmented Generation (RAG) mitigates these issues, it frequently overlooks structural interdependencies essential for multi-hop reasoning. Graph-based RAG approaches attempt to bridge this gap, yet they typically face trade-offs between accuracy and efficiency due to challenges such as costly graph traversals and semantic noise in LLM-generated summaries. In this paper, we propose HyperNode Expansion and Logical Path-Guided Evidence Localization strategies for GraphRAG (HELP), a novel framework designed to balance accuracy with practical efficiency through two core strategies: 1) HyperNode Expansion, which iteratively chains knowledge triplets into coherent reasoning paths abstracted as HyperNodes to capture complex structural dependencies and ensure retrieval accuracy; and 2) Logical Path-Guided Evidence Localization, which leverages precomputed graph-text correlations to map these paths directly to the corpus for superior efficiency. HELP avoids expensive random walks and semantic distortion, preserving knowledge integrity while drastically reducing retrieval latency. Extensive experiments demonstrate that HELP achieves competitive performance across multiple simple and multi-hop QA benchmarks and up to a 28.8$\times$ speedup over leading Graph-based RAG baselines.