AdapTools: Adaptive Tool-based Indirect Prompt Injection Attacks on Agentic LLMs

作者: Che Wang, Jiaming Zhang, Ziqi Zhang, Zijie Wang, Yinghui Wang, Jianbo Gao, Tao Wei, Zhong Chen, Wei Yang Bryan Lim

分类: cs.CR, cs.AI

发布日期: 2026-02-24

备注: 11 pages

💡 一句话要点

AdapTools:针对Agentic LLM的自适应工具型间接提示注入攻击

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 间接提示注入 Agentic LLM 自适应攻击 安全评估 对抗策略 攻击增强 模型安全 LLM安全

📋 核心要点

- 现有间接提示注入攻击方法依赖静态模式,难以有效攻击快速演进的AI Agent。

- AdapTools通过自适应选择攻击工具和生成攻击提示,提升攻击的隐蔽性和成功率。

- 实验表明AdapTools显著提高了攻击成功率,且能有效对抗现有防御机制。

📝 摘要(中文)

本文提出AdapTools,一种新颖的自适应间接提示注入(IPI)攻击框架,旨在解决基于大型语言模型(LLM)的Agent在集成外部数据服务(如模型上下文协议MCP)后产生的安全漏洞。现有攻击方法依赖于静态模式,且在简单语言模型上进行评估,无法应对快速发展的现代AI Agent。AdapTools通过选择更隐蔽的攻击工具并生成自适应攻击提示来构建严格的安全评估环境。该方法包含两个关键组件:自适应攻击策略构建,为提示优化开发可迁移的对抗策略;攻击增强,识别能够绕过任务相关性防御的隐蔽工具。实验结果表明,AdapTools的攻击成功率提高了2.13倍,同时系统效用降低了1.78倍。该框架即使面对最先进的防御机制也能保持有效性。该方法加深了对IPI攻击的理解,并为未来的研究提供了有用的参考。

🔬 方法详解

问题定义:论文旨在解决Agentic LLM中,由于集成外部工具和服务而引入的间接提示注入(IPI)攻击问题。现有IPI攻击方法主要依赖于预定义的静态模式,无法有效应对Agentic LLM的快速演进和复杂防御机制,导致攻击成功率低,且容易被检测和防御。

核心思路:AdapTools的核心思路是构建一个自适应的攻击框架,该框架能够根据目标Agentic LLM的特性和防御机制,动态地选择合适的攻击工具,并生成定制化的攻击提示。通过这种自适应的方式,AdapTools能够提高攻击的隐蔽性和成功率,同时降低被检测的风险。

技术框架:AdapTools框架包含两个主要模块:(1) 自适应攻击策略构建:该模块负责开发可迁移的对抗策略,用于优化攻击提示,使其更具欺骗性。(2) 攻击增强:该模块负责识别能够绕过任务相关性防御的隐蔽工具,从而提高攻击的成功率。整体流程是,首先利用自适应攻击策略构建模块生成初始攻击提示,然后利用攻击增强模块选择合适的攻击工具,最后将攻击提示和攻击工具结合起来,对目标Agentic LLM进行攻击。

关键创新:AdapTools的关键创新在于其自适应性。与传统的静态攻击方法不同,AdapTools能够根据目标Agentic LLM的特性和防御机制,动态地调整攻击策略和选择攻击工具。这种自适应性使得AdapTools能够更有效地绕过防御机制,提高攻击的成功率。

关键设计:自适应攻击策略构建模块使用强化学习来学习最优的对抗策略,奖励函数的设计考虑了攻击成功率和提示的隐蔽性。攻击增强模块则通过分析不同工具的特性和Agentic LLM的防御机制,选择最适合当前场景的攻击工具。具体而言,可能涉及到对工具的调用方式、参数设置等进行优化,以提高攻击的隐蔽性和有效性。

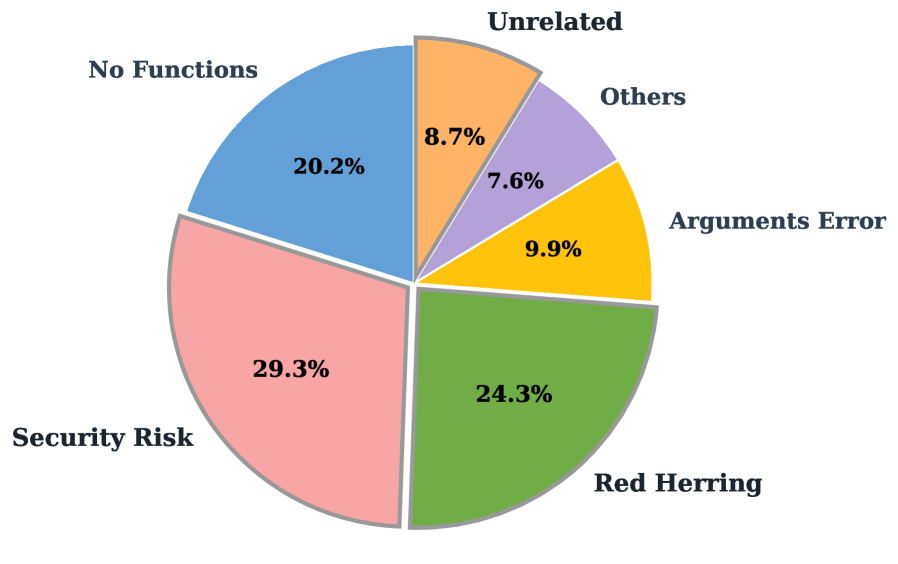

🖼️ 关键图片

📊 实验亮点

实验结果表明,AdapTools在攻击成功率方面比现有方法提高了2.13倍,同时系统效用降低了1.78倍。更重要的是,AdapTools即使面对最先进的防御机制也能保持其有效性,证明了其强大的攻击能力和适应性。这些结果表明AdapTools是一种有效的IPI攻击框架,能够显著提高攻击成功率并绕过现有防御机制。

🎯 应用场景

AdapTools的研究成果可应用于评估和提升Agentic LLM的安全性,帮助开发者发现和修复潜在的安全漏洞。该框架还可用于构建更强大的防御机制,以保护Agentic LLM免受IPI攻击。此外,该研究为未来开发更安全、更可靠的AI Agent提供了有价值的参考。

📄 摘要(原文)

The integration of external data services (e.g., Model Context Protocol, MCP) has made large language model-based agents increasingly powerful for complex task execution. However, this advancement introduces critical security vulnerabilities, particularly indirect prompt injection (IPI) attacks. Existing attack methods are limited by their reliance on static patterns and evaluation on simple language models, failing to address the fast-evolving nature of modern AI agents. We introduce AdapTools, a novel adaptive IPI attack framework that selects stealthier attack tools and generates adaptive attack prompts to create a rigorous security evaluation environment. Our approach comprises two key components: (1) Adaptive Attack Strategy Construction, which develops transferable adversarial strategies for prompt optimization, and (2) Attack Enhancement, which identifies stealthy tools capable of circumventing task-relevance defenses. Comprehensive experimental evaluation shows that AdapTools achieves a 2.13 times improvement in attack success rate while degrading system utility by a factor of 1.78. Notably, the framework maintains its effectiveness even against state-of-the-art defense mechanisms. Our method advances the understanding of IPI attacks and provides a useful reference for future research.