Recursive Belief Vision Language Model

作者: Vaidehi Bagaria, Bijo Sebastian, Nirav Patel

分类: cs.AI

发布日期: 2026-02-24

💡 一句话要点

提出RB-VLA,通过置信度建模解决VLA模型在长时程操作中的部分可观测性问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 长时程操作 部分可观测性 置信度建模 状态表示 机器人操作 扩散策略

📋 核心要点

- 现有VLA模型在长时程操作中面临部分可观测性挑战,缺乏有效的状态表示和推理能力,导致任务失败和高延迟。

- RB-VLA通过引入置信度模块,维护紧凑的潜在状态,编码任务历史和动态,实现阶段感知的控制,提升了鲁棒性。

- 实验表明,RB-VLA在长时程任务中显著优于现有VLA模型,成功率提升明显,并降低了推理延迟和内存占用。

📝 摘要(中文)

现有的视觉-语言-动作(VLA)模型在部分可观测性下的长时程操作中表现不佳。现有方法通常是观察驱动的,依赖于短上下文窗口或重复查询视觉-语言模型(VLM),导致任务进度丢失、感知混淆下的动作重复以及高推理延迟。语义推理并非长时程操作的主要瓶颈。VLA模型缺乏持久的、动作条件化的状态表示,且时间与物理推理能力有限,不适用于多阶段控制。本文提出了RB-VLA,一种以置信度为中心的架构,通过自监督世界模型目标进行训练,维护一个紧凑的潜在状态,编码任务相关的历史、动态和对象交互。VLM仅被查询一次以获得高层意图,而置信度跟踪任务进度,并在部分可观测性下实现具有因果关系的、阶段感知的控制,无需存储原始观察或随时间扩展内存。置信度和意图共同调节扩散策略,实现鲁棒的闭环执行。RB-VLA在长时程基准测试中优于先前的VLA模型,在多阶段拾取放置和堆叠任务中的成功率分别比π0高52.5%和37.5%。相对于基线,推理延迟降低高达5倍,并消除了现有VLA中观察到的跨时间步的内存增长。消融实验表明,置信度模块是性能的主要驱动因素,将成功率从32.5%提高到77.5%。这些结果证明了基于置信度的状态表示对于长时程VLA策略的有效性。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在长时程操作任务中,尤其是在部分可观测的环境下,表现不佳。它们通常依赖于短期的视觉输入和频繁的VLM查询,导致任务进度丢失、动作重复以及推理延迟高等问题。核心痛点在于缺乏对任务状态的有效建模,无法进行长时间的推理和规划。

核心思路:RB-VLA的核心思路是引入一个置信度模块(Belief Module),用于维护一个紧凑的、动作条件化的潜在状态表示。这个状态表示能够编码任务相关的历史信息、环境动态以及对象之间的交互关系。通过置信度模块,模型可以跟踪任务的进度,并在部分可观测的情况下进行因果推理和阶段感知的控制。

技术框架:RB-VLA的整体架构包含以下几个主要模块:1) 视觉-语言模型(VLM):用于接收高层意图的查询,提供任务规范。2) 置信度模块(Belief Module):维护一个潜在状态,编码任务相关的历史和动态。3) 扩散策略(Diffusion Policy):基于置信度和意图,生成动作序列,实现闭环控制。整个流程是,首先使用VLM获取任务意图,然后置信度模块根据历史信息和当前观测更新状态,最后扩散策略根据状态和意图生成动作。

关键创新:RB-VLA的关键创新在于引入了置信度模块,用于维护一个持久的、动作条件化的状态表示。与现有方法相比,RB-VLA不需要存储原始的视觉观测,也不需要频繁地查询VLM,从而降低了计算复杂度和内存占用。此外,置信度模块能够进行因果推理和阶段感知的控制,提高了模型在长时程任务中的鲁棒性。

关键设计:置信度模块的具体实现细节未知,但可以推测其可能采用循环神经网络(RNN)或Transformer等结构,用于处理时间序列数据。损失函数可能包含自监督世界模型目标,例如预测未来的状态或奖励。扩散策略可能采用条件扩散模型,以置信度和意图作为条件,生成动作序列。具体的参数设置和网络结构等细节需要在论文中进一步查找。

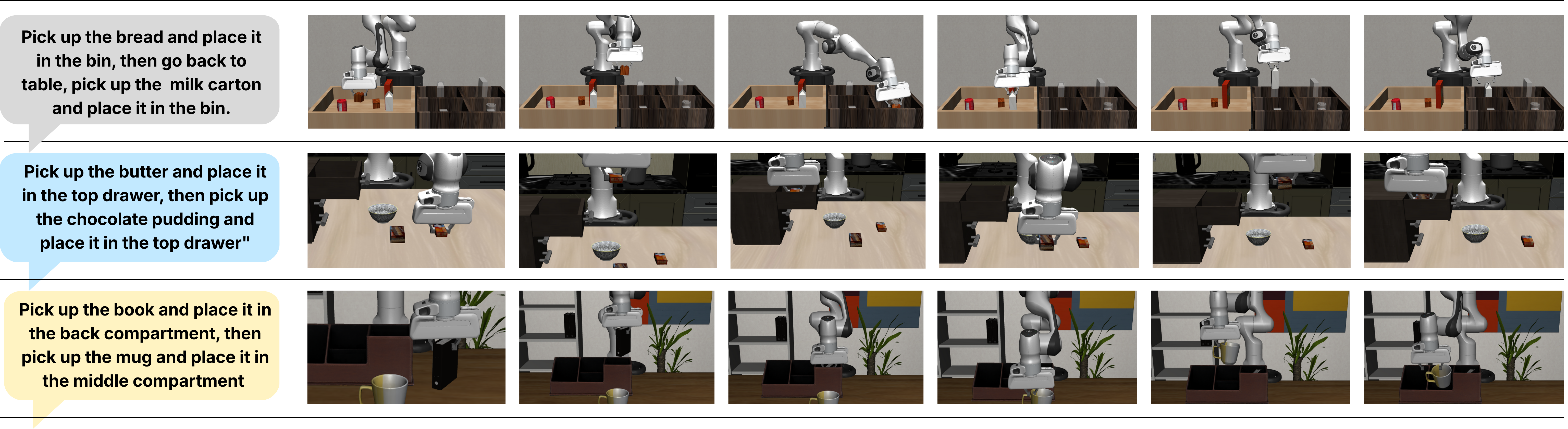

🖼️ 关键图片

📊 实验亮点

RB-VLA在长时程基准测试中表现出色,在多阶段拾取放置任务和堆叠任务中的成功率分别比π0高52.5%和37.5%。此外,RB-VLA的推理延迟降低高达5倍,并消除了现有VLA中观察到的跨时间步的内存增长。消融实验表明,置信度模块是性能的主要驱动因素,将成功率从32.5%提高到77.5%。

🎯 应用场景

RB-VLA具有广泛的应用前景,例如机器人操作、自动驾驶、智能家居等领域。它可以用于解决复杂环境下的长时程任务,例如装配、导航、清洁等。通过提高机器人的自主性和鲁棒性,RB-VLA可以降低人工干预的需求,提高工作效率,并拓展机器人的应用范围。

📄 摘要(原文)

Current vision-language-action (VLA) models struggle with long-horizon manipulation under partial observability. Most existing approaches remain observation-driven, relying on short context windows or repeated queries to vision-language models (VLMs). This leads to loss of task progress, action repetition under perceptual aliasing, and high inference latency. Semantic reasoning alone is not the primary bottleneck in long-horizon manipulation. Instead, VLAs lack persistent, action-conditioned state representations and exhibit limited temporal and physical reasoning, making them ill-suited for multi-stage control. This paper introduces RB-VLA, a belief-centric architecture trained with self-supervised world-model objectives that maintains a compact latent state encoding task-relevant history, dynamics, and object interactions. Queried once for high-level intent, the VLM provides task specification, while the belief tracks task progress and enables phase-aware, causally grounded control under partial observability without storing raw observations or scaling memory with time. The belief and intent jointly condition a diffusion policy for robust closed-loop execution. RB-VLA outperforms prior VLAs on long-horizon benchmarks, achieving 52.5% and 37.5% higher success on multi-stage pick-and-place and stacking tasks, respectively, compared to π0. It also reduces inference latency by up to 5x relative to baselines and eliminates memory growth across timesteps observed in existing VLAs. Ablations show that the belief module is the primary driver of performance, increasing success rates from 32.5% to 77.5%. These results demonstrate the effectiveness of belief-based state representations for long-horizon VLA policies.