Inner Speech as Behavior Guides: Steerable Imitation of Diverse Behaviors for Human-AI coordination

作者: Rakshit Trivedi, Kartik Sharma, David C Parkes

分类: cs.AI, cs.CL, cs.LG

发布日期: 2026-02-24

备注: Spotlight paper at NeurIPS 2025

💡 一句话要点

MIMIC:利用内部语言指导,实现人机协作中行为的多样性模仿与可控引导

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人机协作 模仿学习 内部语言 行为引导 视觉-语言模型

📋 核心要点

- 现有模仿学习方法难以捕捉人类行为的多样性和非马尔可夫性,并且缺乏推理时行为引导能力。

- MIMIC框架借鉴人类认知过程,利用语言作为行为意图的内部表示,实现行为的精细引导。

- 实验表明,MIMIC显著提高了行为多样性和对人类演示的保真度,同时实现了细致的行为引导。

📝 摘要(中文)

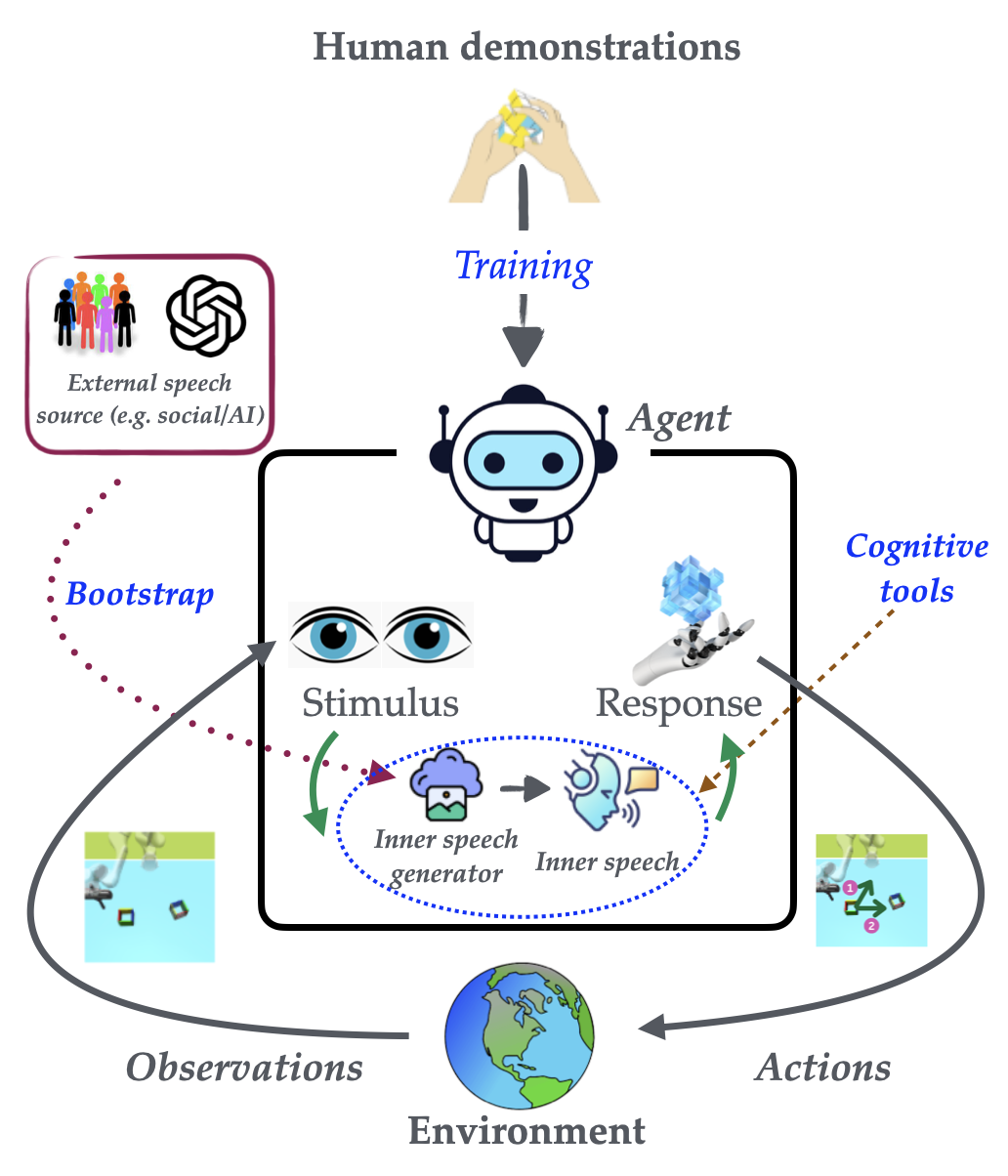

为了实现有效的人机协作,人工智能体需要能够展现和响应类人行为,并适应不断变化的环境。模仿学习已成为构建此类智能体的重要方法,通过训练智能体模仿人类行为。然而,现有方法难以捕捉人类行为的内在多样性和非马尔可夫性,并且缺乏在推理时引导行为的能力。受人类认知过程理论的启发,即内部语言在执行前指导动作选择,我们提出了MIMIC(建模模仿和控制的内在动机)框架,该框架使用语言作为行为意图的内部表示。MIMIC创新性地利用视觉-语言模型作为语言支架,训练一个条件变分自编码器,使其能够从观察中生成内部语言。然后,基于扩散的行为克隆策略根据当前观察和生成的内部语言选择动作。MIMIC通过根据特定行为的语言调节智能体,从而在推理时实现对行为的精细引导,而无需在额外的演示上进行训练。在机器人操作任务和人机协作游戏中进行的实验表明,MIMIC显著提高了行为的多样性和对人类演示的保真度,同时实现了细致的行为引导。我们开源了代码,并提供了预训练的MIMIC智能体和定性演示。

🔬 方法详解

问题定义:论文旨在解决人机协作中,人工智能体难以模仿人类行为的多样性,以及缺乏在推理阶段对智能体行为进行有效引导的问题。现有模仿学习方法通常难以捕捉人类行为的内在复杂性和非马尔可夫特性,导致智能体的行为不够自然和灵活。此外,现有方法通常缺乏在推理时根据特定需求调整智能体行为的能力,限制了人机协作的效率和效果。

核心思路:论文的核心思路是借鉴人类认知过程中的“内部语言”概念,将语言作为行为意图的内部表示。通过让智能体学习生成和理解这种内部语言,可以更好地捕捉人类行为的内在动机和目标,从而实现更自然、多样和可控的行为模仿。这种方法允许在推理时通过调节内部语言来引导智能体的行为,而无需额外的训练数据。

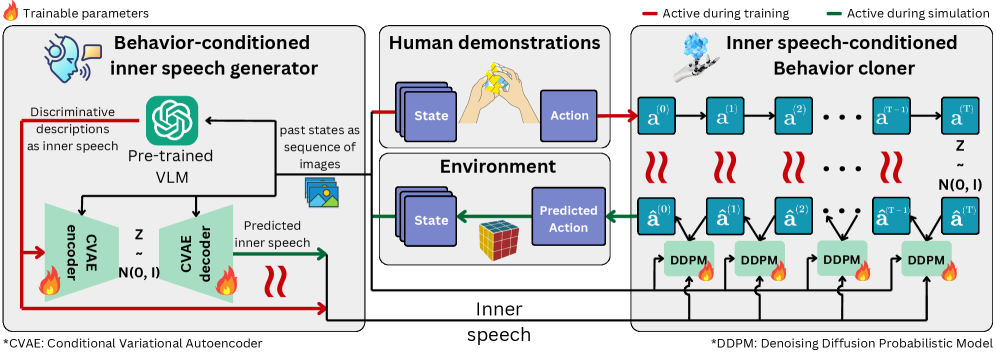

技术框架:MIMIC框架主要包含以下几个模块:1) 视觉-语言模型:用于将视觉观察转化为语言描述,作为内部语言的先验知识。2) 条件变分自编码器(CVAE):用于学习从视觉观察到内部语言的映射关系,并生成具有多样性的内部语言表示。3) 基于扩散的行为克隆策略:用于根据当前观察和生成的内部语言选择动作,实现行为的模仿和控制。整体流程是,首先利用视觉-语言模型对环境进行理解,然后通过CVAE生成内部语言,最后基于扩散模型的策略根据内部语言和环境信息选择动作。

关键创新:MIMIC的关键创新在于将语言作为行为意图的内部表示,并利用视觉-语言模型和条件变分自编码器来学习和生成这种内部语言。与传统的模仿学习方法相比,MIMIC能够更好地捕捉人类行为的内在动机和目标,从而实现更自然、多样和可控的行为模仿。此外,MIMIC还创新性地使用了基于扩散模型的行为克隆策略,进一步提高了行为的生成质量和多样性。

关键设计:在CVAE的设计中,使用了KL散度作为正则化项,鼓励生成的内部语言与先验分布(视觉-语言模型的输出)接近,从而保证了内部语言的语义一致性。在基于扩散模型的行为克隆策略中,使用了噪声预测网络来学习从噪声到动作的映射关系,并通过迭代去噪过程生成最终的动作。损失函数包括行为克隆损失和内部语言的重构损失,用于保证行为的保真度和内部语言的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MIMIC在机器人操作任务和人机协作游戏中显著提高了行为的多样性和对人类演示的保真度。例如,在机器人操作任务中,MIMIC能够生成比现有方法更多样化的抓取姿势和运动轨迹。在人机协作游戏中,MIMIC能够更好地理解人类的意图,并做出更合适的反应,从而提高了协作效率。此外,MIMIC还能够在推理时通过调节内部语言来引导智能体的行为,而无需额外的训练数据。

🎯 应用场景

MIMIC框架具有广泛的应用前景,例如机器人操作、自动驾驶、游戏AI和虚拟助手等领域。通过MIMIC,可以训练出能够模仿人类行为并与人类进行自然交互的智能体,从而提高人机协作的效率和效果。此外,MIMIC还可以用于生成具有多样性和创造性的行为,例如在游戏中创造更智能、更逼真的NPC角色。未来,MIMIC有望成为构建通用人工智能的重要组成部分。

📄 摘要(原文)

Effective human-AI coordination requires artificial agents capable of exhibiting and responding to human-like behaviors while adapting to changing contexts. Imitation learning has emerged as one of the prominent approaches to build such agents by training them to mimic human-demonstrated behaviors. However, current methods struggle to capture the inherent diversity and non-Markovian nature of human behavior and lack the ability to steer behavior at inference time. Drawing inspiration from the theory of human cognitive processes, where inner speech guides action selection before execution, we propose MIMIC (Modeling Inner Motivations for Imitation and Control), a framework that uses language as an internal representation of behavioral intent. MIMIC employs the novel use of vision-language models as linguistic scaffolding to train a conditional variational autoencoder capable of generating inner speech from observations. A diffusion-based behavior cloning policy then selects actions conditioned on current observations and the generated inner speech. MIMIC enables fine-grained steering of behavior at inference time by conditioning the agent on behavior-specific speech. Experiments across robotic manipulation tasks and human-AI collaboration games demonstrate that MIMIC significantly enhances both behavior diversity and fidelity to human demonstrations while enabling nuanced behavioral steering without training on additional demonstrations. We open source our code and provide pre-trained MIMIC agents and qualitative demos at: https://mimic-research.github.io.