Hybrid LLM-Embedded Dialogue Agents for Learner Reflection: Designing Responsive and Theory-Driven Interactions

作者: Paras Sharma, YuePing Sha, Janet Shufor Bih Epse Fofang, Brayden Yan, Jess A. Turner, Nicole Balay, Hubert O. Asare, Angela E. B. Stewart, Erin Walker

分类: cs.HC, cs.AI

发布日期: 2026-02-24

💡 一句话要点

提出混合LLM嵌入式对话Agent,用于支持学习者反思,设计响应式和理论驱动的交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM 对话系统 学习者反思 混合系统 自我调节学习 教育技术 人机交互

📋 核心要点

- 现有对话系统在支持学习者反思时,基于规则的方法缺乏灵活性,难以适应学习者参与度的变化。

- 该论文提出了一种混合对话系统,将LLM的上下文感知能力与基于规则的理论框架相结合,以提升反思效果。

- 实验结果表明,该混合系统能够促进更丰富的反思,但也存在重复性和提示不一致的问题,影响了参与度。

📝 摘要(中文)

对话系统长期以来被用于支持学习者的反思。基于理论的、基于规则的设计提供了结构化的支架,但通常难以应对参与度的变化。相比之下,大型语言模型(LLM)可以生成上下文敏感的响应,但缺乏对学习互动应如何构建的数十年研究的指导,引发了对其与教学理论一致性的质疑。本文提出了一种混合对话系统,该系统将LLM的响应性嵌入到符合理论的、基于规则的框架中,以支持文化响应型机器人夏令营中学习者的反思。基于规则的结构将对话建立在自我调节学习理论的基础上,而LLM决定何时以及如何提示更深层次的反思,从而响应不断变化的对话上下文。我们分析了对话中的主题,以探索我们的混合系统如何塑造学习者的反思。我们的研究结果表明,LLM嵌入式对话支持了学习者对目标和活动更丰富的反思,但也引入了由于重复性和提示不一致而导致的挑战,从而降低了参与度。

🔬 方法详解

问题定义:现有对话系统在支持学习者反思时面临挑战。基于规则的系统虽然结构化,但缺乏灵活性,难以适应学习者参与度的变化。而直接使用大型语言模型(LLM)虽然可以生成上下文相关的回复,但缺乏教学理论指导,可能无法有效促进学习者的深度反思。因此,需要一种既能提供结构化引导,又能根据上下文进行灵活调整的对话系统。

核心思路:该论文的核心思路是将LLM的上下文感知能力嵌入到基于规则的框架中,构建一个混合对话系统。基于规则的框架提供结构化的对话流程,确保对话符合自我调节学习理论等教学原则。LLM则负责在适当的时机,根据对话的上下文,生成更具个性化和深度的反思提示,从而提升学习者的反思质量。

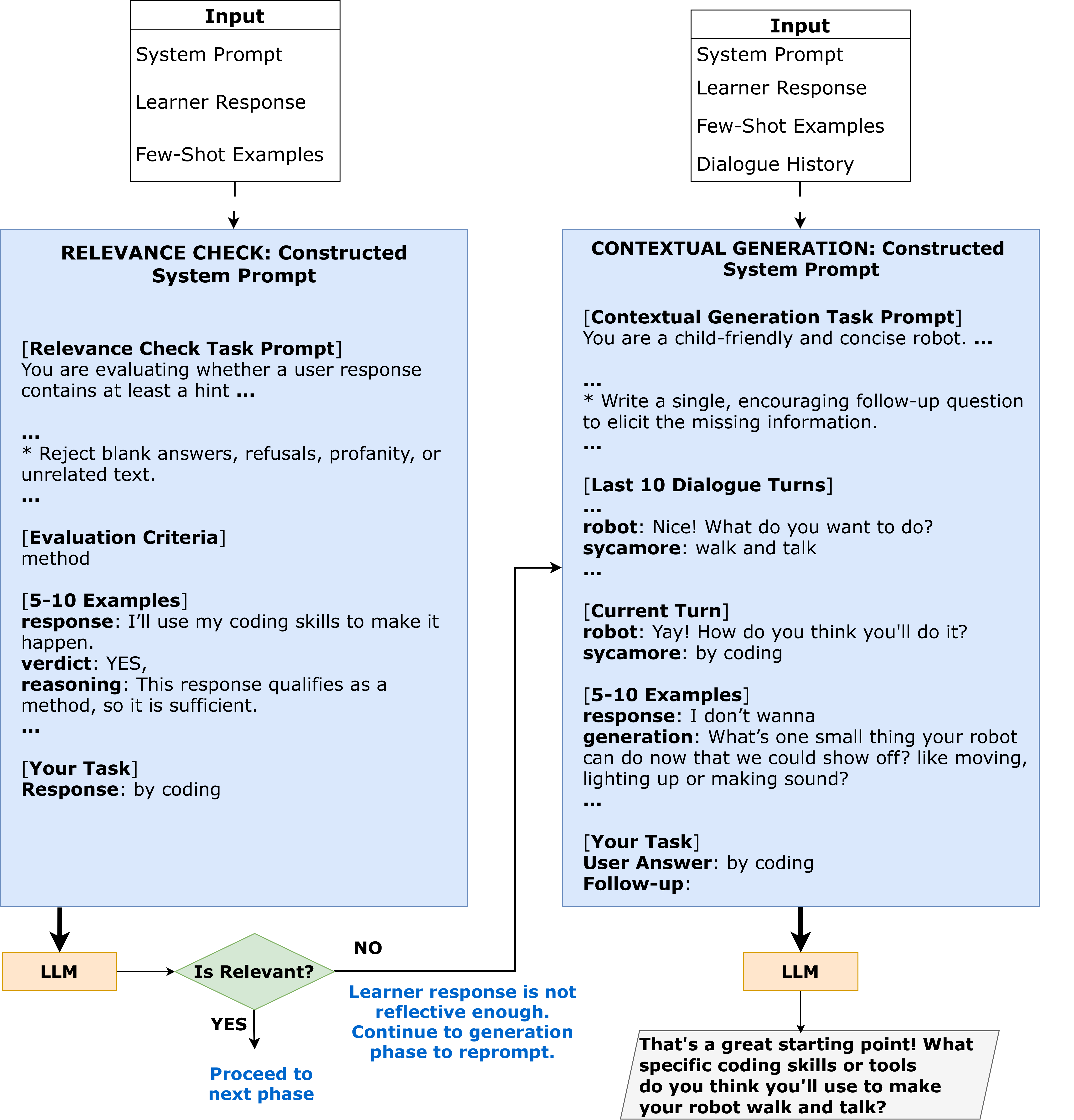

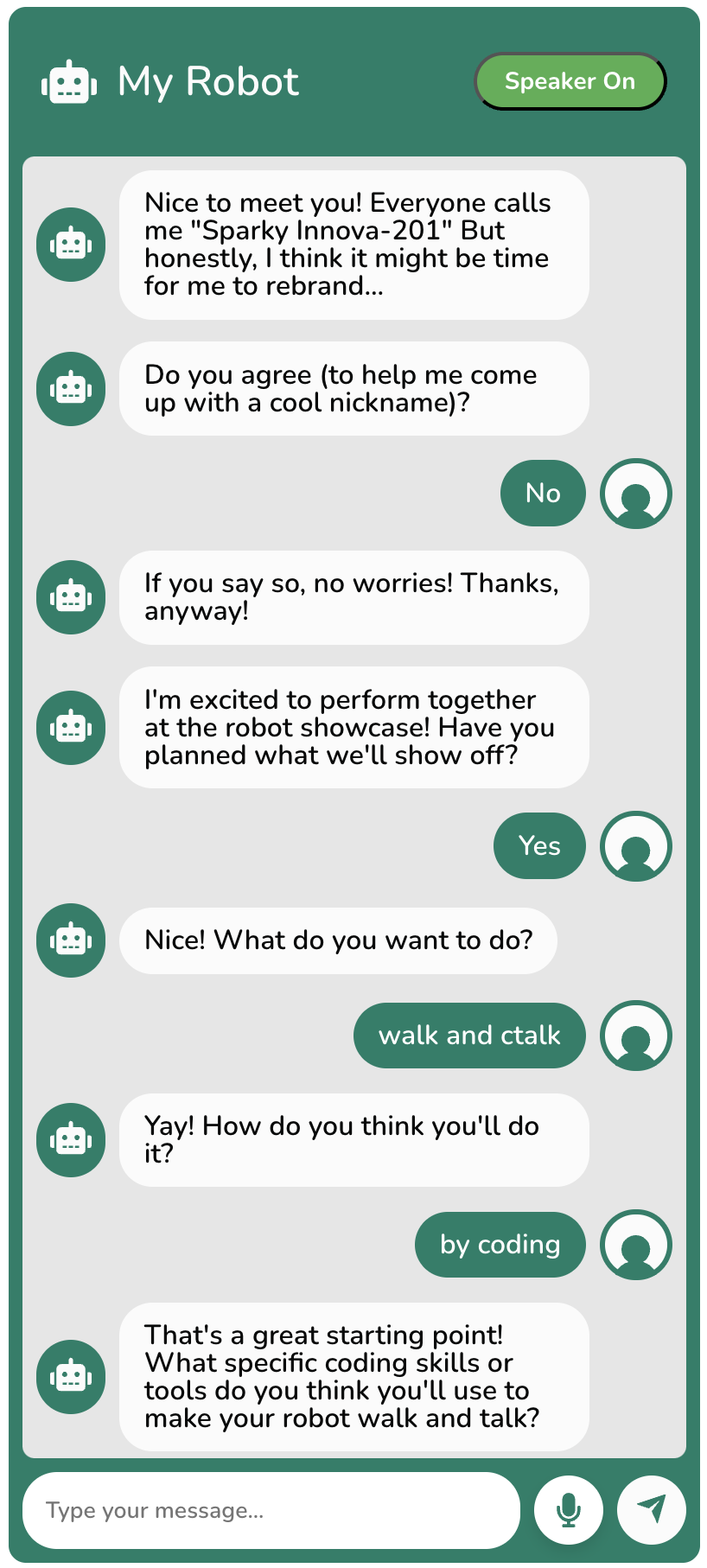

技术框架:该混合对话系统包含两个主要模块:基于规则的对话管理器和LLM驱动的提示生成器。对话首先由基于规则的对话管理器引导,该管理器根据预定义的规则和学习者的输入,确定对话的下一步走向。当需要更深入的反思时,对话管理器会调用LLM驱动的提示生成器。提示生成器接收当前的对话上下文作为输入,生成一个针对性的反思提示,并将其呈现给学习者。学习者的回复会被反馈给对话管理器,用于更新对话状态,并决定下一步的对话流程。

关键创新:该论文的关键创新在于将LLM的上下文感知能力与基于规则的教学框架相结合。这种混合方法既能保证对话的结构化和理论一致性,又能利用LLM的灵活性和生成能力,从而更好地支持学习者的反思。与完全基于规则的系统相比,该混合系统能够生成更具个性化和深度的提示。与直接使用LLM的系统相比,该混合系统能够更好地控制对话的方向,确保对话符合教学目标。

关键设计:该论文中,基于规则的对话管理器使用状态机来实现,每个状态对应对话的一个阶段或一个特定的问题。LLM驱动的提示生成器使用预训练的语言模型,并使用少量样本进行微调,以生成符合教学目标的提示。具体使用的LLM模型和微调方法在论文中可能有所描述,但摘要中未提及。关键参数可能包括LLM的温度系数(控制生成文本的随机性)和提示的长度。

🖼️ 关键图片

📊 实验亮点

该研究表明,LLM嵌入式对话系统能够支持学习者对目标和活动进行更丰富的反思。然而,实验也揭示了该系统存在的一些问题,例如重复性和提示不一致,这些问题可能会降低学习者的参与度。未来的研究需要解决这些问题,以进一步提升混合对话系统的性能和用户体验。具体的性能数据和对比基线在摘要中未提及,需要在论文正文中查找。

🎯 应用场景

该研究成果可应用于各种教育场景,例如在线学习平台、智能辅导系统和虚拟学习环境。通过将LLM嵌入到结构化的教学框架中,可以为学习者提供更个性化和有效的反思支持,促进深度学习和自我调节能力的提升。此外,该方法还可以扩展到其他领域,例如心理咨询和职业规划,为用户提供定制化的指导和建议。

📄 摘要(原文)

Dialogue systems have long supported learner reflections, with theoretically grounded, rule-based designs offering structured scaffolding but often struggling to respond to shifts in engagement. Large Language Models (LLMs), in contrast, can generate context-sensitive responses but are not informed by decades of research on how learning interactions should be structured, raising questions about their alignment with pedagogical theories. This paper presents a hybrid dialogue system that embeds LLM responsiveness within a theory-aligned, rule-based framework to support learner reflections in a culturally responsive robotics summer camp. The rule-based structure grounds dialogue in self-regulated learning theory, while the LLM decides when and how to prompt deeper reflections, responding to evolving conversation context. We analyze themes across dialogues to explore how our hybrid system shaped learner reflections. Our findings indicate that LLM-embedded dialogues supported richer learner reflections on goals and activities, but also introduced challenges due to repetitiveness and misalignment in prompts, reducing engagement.