AdaEvolve: Adaptive LLM Driven Zeroth-Order Optimization

作者: Mert Cemri, Shubham Agrawal, Akshat Gupta, Shu Liu, Audrey Cheng, Qiuyang Mang, Ashwin Naren, Lutfi Eren Erdogan, Koushik Sen, Matei Zaharia, Alex Dimakis, Ion Stoica

分类: cs.NE, cs.AI, cs.CL

发布日期: 2026-02-23

💡 一句话要点

AdaEvolve:自适应LLM驱动的零阶优化框架,提升进化搜索效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM驱动优化 进化搜索 自适应优化 零阶优化 程序生成 bandit算法 元学习

📋 核心要点

- 现有基于LLM的进化搜索方法采用静态调度策略,无法适应搜索过程中的动态变化。

- AdaEvolve通过分层自适应优化,动态调整资源分配,提高搜索效率。

- 实验结果表明,AdaEvolve在多个开放式优化问题上显著优于现有方法。

📝 摘要(中文)

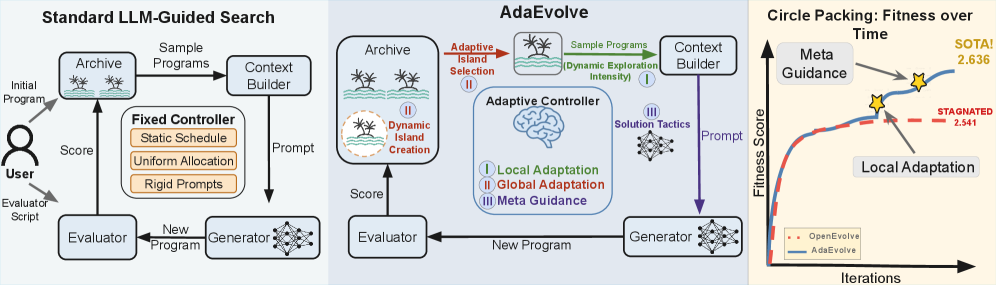

自动化程序生成范式正从一次性生成转向推理时搜索,其中大型语言模型(LLM)充当进化循环中的语义变异算子。然而,现有系统采用静态调度,无法适应搜索过程的非平稳动态特性,导致计算资源浪费。AdaEvolve框架将LLM驱动的进化过程重新定义为分层自适应优化问题。它使用“累积改进信号”来统一三个层面的决策:局部自适应,动态调节解候选群体内的探索强度;全局自适应,通过基于bandit的调度在不同解候选群体间分配全局资源预算;元指导,基于先前生成的解及其改进,在进展停滞时生成新的解策略。实验表明,AdaEvolve在包括组合优化、系统优化和算法设计等185个不同的开放式优化问题上,始终优于开源基线。

🔬 方法详解

问题定义:论文旨在解决基于LLM的进化搜索中,由于静态调度策略导致的资源浪费问题。现有方法无法根据搜索过程的动态变化自适应地分配计算资源,导致有潜力的解未被充分探索,而停滞的解却消耗了大量资源。

核心思路:AdaEvolve的核心思路是将LLM驱动的进化搜索过程建模为一个分层自适应优化问题。通过监控搜索过程中的“累积改进信号”,动态地调整资源分配策略,从而更有效地利用计算资源,加速搜索过程。

技术框架:AdaEvolve框架包含三个主要模块:1) 局部自适应:动态调整解候选群体内的探索强度,鼓励对有潜力的解进行更深入的探索。2) 全局自适应:通过bandit算法在不同的解候选群体之间分配全局资源预算,将更多资源分配给进展更快的群体。3) 元指导:当搜索进展停滞时,基于先前生成的解及其改进情况,利用LLM生成新的解策略,以跳出局部最优。

关键创新:AdaEvolve的关键创新在于其分层自适应优化框架,能够根据搜索过程的动态变化,自适应地调整资源分配策略。与现有方法相比,AdaEvolve能够更有效地利用计算资源,加速搜索过程,并提高最终解的质量。

关键设计:AdaEvolve使用“累积改进信号”作为关键的反馈指标,用于指导局部自适应、全局自适应和元指导三个模块的决策。具体而言,局部自适应模块可能使用一个基于改进信号的温度参数来控制LLM生成变异的强度;全局自适应模块使用bandit算法,根据每个解候选群体的累积改进信号来分配资源;元指导模块则利用改进信号来筛选有用的解,并将其作为prompt输入LLM,以生成新的解策略。

🖼️ 关键图片

📊 实验亮点

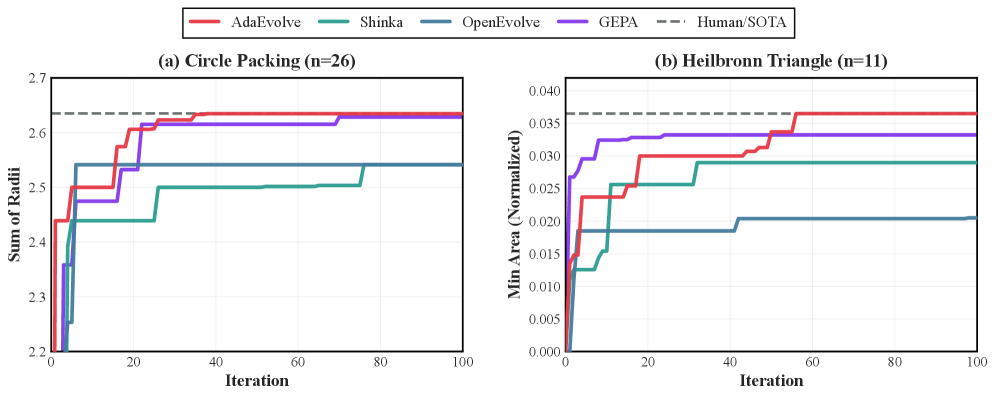

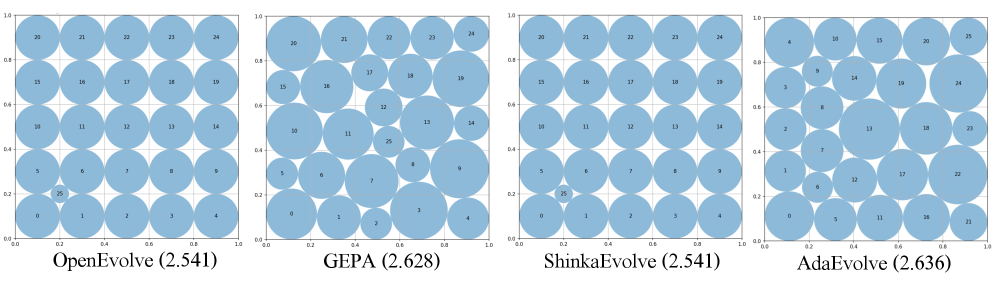

实验结果表明,AdaEvolve在185个不同的开放式优化问题上,始终优于开源基线。具体性能提升数据未知,但摘要强调了“consistently outperforms”这一结果,表明AdaEvolve具有较强的鲁棒性和泛化能力。实验涵盖了组合优化、系统优化和算法设计等多个领域,证明了AdaEvolve的广泛适用性。

🎯 应用场景

AdaEvolve可应用于各种需要优化的问题,例如组合优化、系统优化、算法设计等。该框架能够提高自动化程序生成的效率和质量,降低计算成本,并有望在软件工程、人工智能等领域发挥重要作用。未来,可以探索将AdaEvolve应用于更复杂的优化问题,并与其他优化算法相结合,以进一步提高性能。

📄 摘要(原文)

The paradigm of automated program generation is shifting from one-shot generation to inference-time search, where Large Language Models (LLMs) function as semantic mutation operators within evolutionary loops. While effective, these systems are currently governed by static schedules that fail to account for the non-stationary dynamics of the search process. This rigidity results in substantial computational waste, as resources are indiscriminately allocated to stagnating populations while promising frontiers remain under-exploited. We introduce AdaEvolve, a framework that reformulates LLM-driven evolution as a hierarchical adaptive optimization problem. AdaEvolve uses an "accumulated improvement signal" to unify decisions across three levels: Local Adaptation, which dynamically modulates the exploration intensity within a population of solution candidates; Global Adaptation, which routes the global resource budget via bandit-based scheduling across different solution candidate populations; and Meta-Guidance which generates novel solution tactics based on the previously generated solutions and their corresponding improvements when the progress stalls. We demonstrate that AdaEvolve consistently outperforms the open-sourced baselines across 185 different open-ended optimization problems including combinatorial, systems optimization and algorithm design problems.