DReX: An Explainable Deep Learning-based Multimodal Recommendation Framework

作者: Adamya Shyam, Venkateswara Rao Kagita, Bharti Rana, Vikas Kumar

分类: cs.IR, cs.AI

发布日期: 2026-02-23

💡 一句话要点

DReX:一种基于深度学习的可解释多模态推荐框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态推荐 深度学习 可解释性 门控循环单元 用户建模 物品建模 增量学习

📋 核心要点

- 现有推荐系统在处理多模态数据时,常面临模态孤立、数据不完整和用户-物品表示不对齐等问题,导致推荐效果受限。

- DReX框架通过门控循环单元增量式地融合多模态交互特征,同时建模细粒度交互和全局偏好,提升用户和物品表示的对齐。

- 实验表明,DReX在多个真实数据集上优于现有方法,并能生成可解释的用户和物品关键词配置文件,增强推荐的可解释性。

📝 摘要(中文)

多模态推荐系统利用用户交互、内容特征和上下文信息等多种数据源,以解决冷启动和数据稀疏等挑战。然而,现有方法通常存在一个或多个关键限制:孤立地处理不同模态、训练期间需要每个交互的完整多模态数据,或者独立学习用户和物品表示。这些因素导致复杂性增加以及用户和物品嵌入之间潜在的错位。为了应对这些挑战,我们提出了DReX,一个统一的多模态推荐框架,它通过利用来自多模态反馈的交互级特征来增量地细化用户和物品表示。我们的模型采用门控循环单元来选择性地将这些细粒度特征集成到全局表示中。这种增量更新机制提供了三个关键优势:(1)同时建模细微的交互细节和更广泛的偏好模式,(2)消除了单独的用户和物品特征提取过程的需要,从而增强了它们学习到的表示的对齐,以及(3)对变化或缺失的模态具有内在的鲁棒性。我们在包含评论和评分作为交互模态的三个真实世界数据集上评估了所提出方法的性能。通过将评论文本视为一种模态,我们的方法自动为用户和物品生成可解释的关键词配置文件,这些配置文件通过可解释的偏好指标来补充推荐过程。实验结果表明,我们的方法在所有评估的数据集上都优于最先进的方法。

🔬 方法详解

问题定义:现有方法在处理多模态推荐时,通常孤立地处理不同模态的数据,需要完整的模态数据进行训练,并且独立学习用户和物品的表示。这些限制导致模型无法充分利用多模态信息,增加了模型的复杂性,并可能导致用户和物品表示之间的不对齐,从而影响推荐性能。

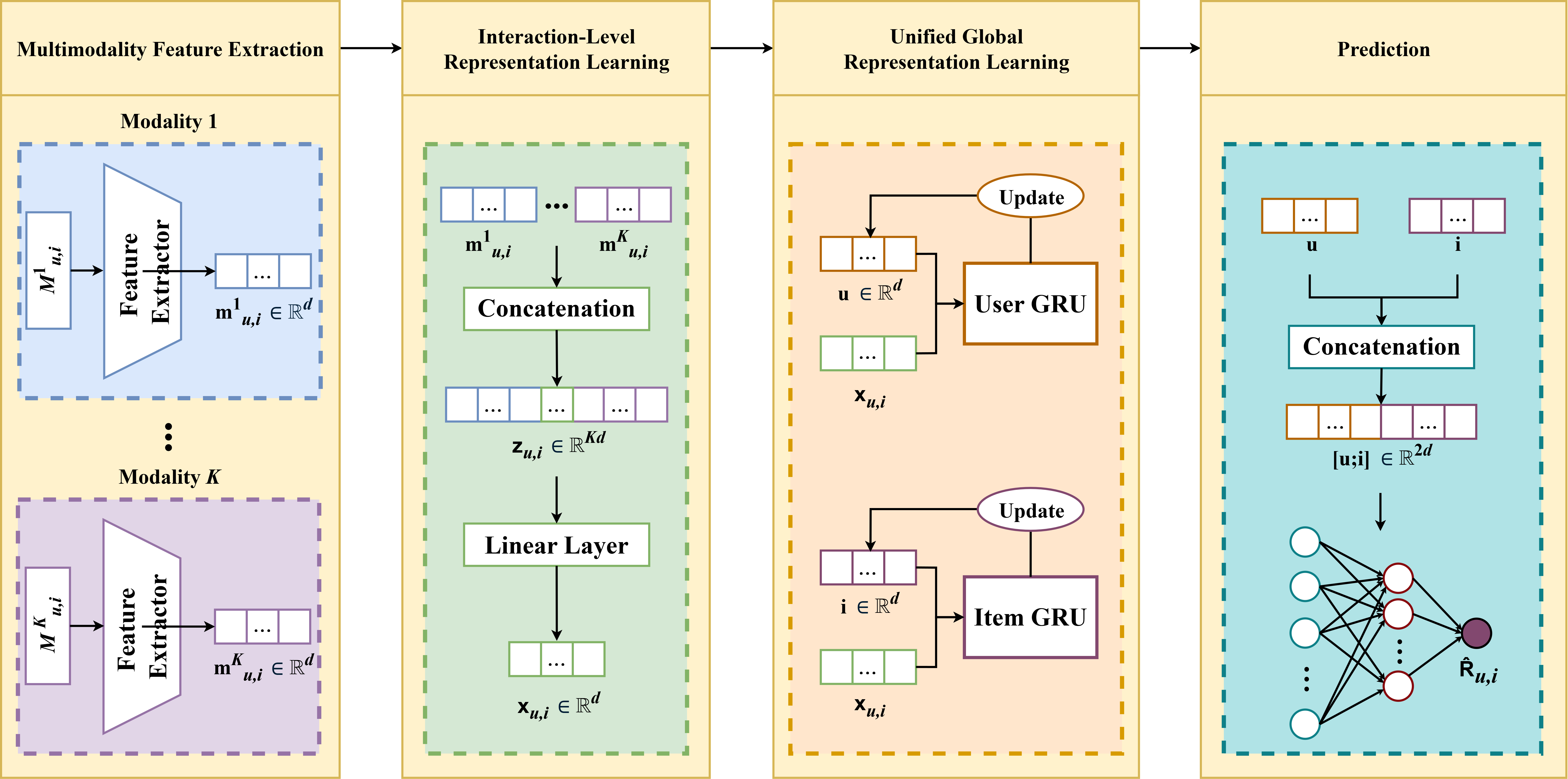

核心思路:DReX的核心思路是通过增量式地融合多模态交互特征来细化用户和物品的表示。模型利用门控循环单元(GRU)选择性地将细粒度的交互特征集成到全局表示中,从而同时建模细微的交互细节和更广泛的偏好模式。这种增量更新机制能够更好地对齐用户和物品的表示,并提高模型对缺失模态的鲁棒性。

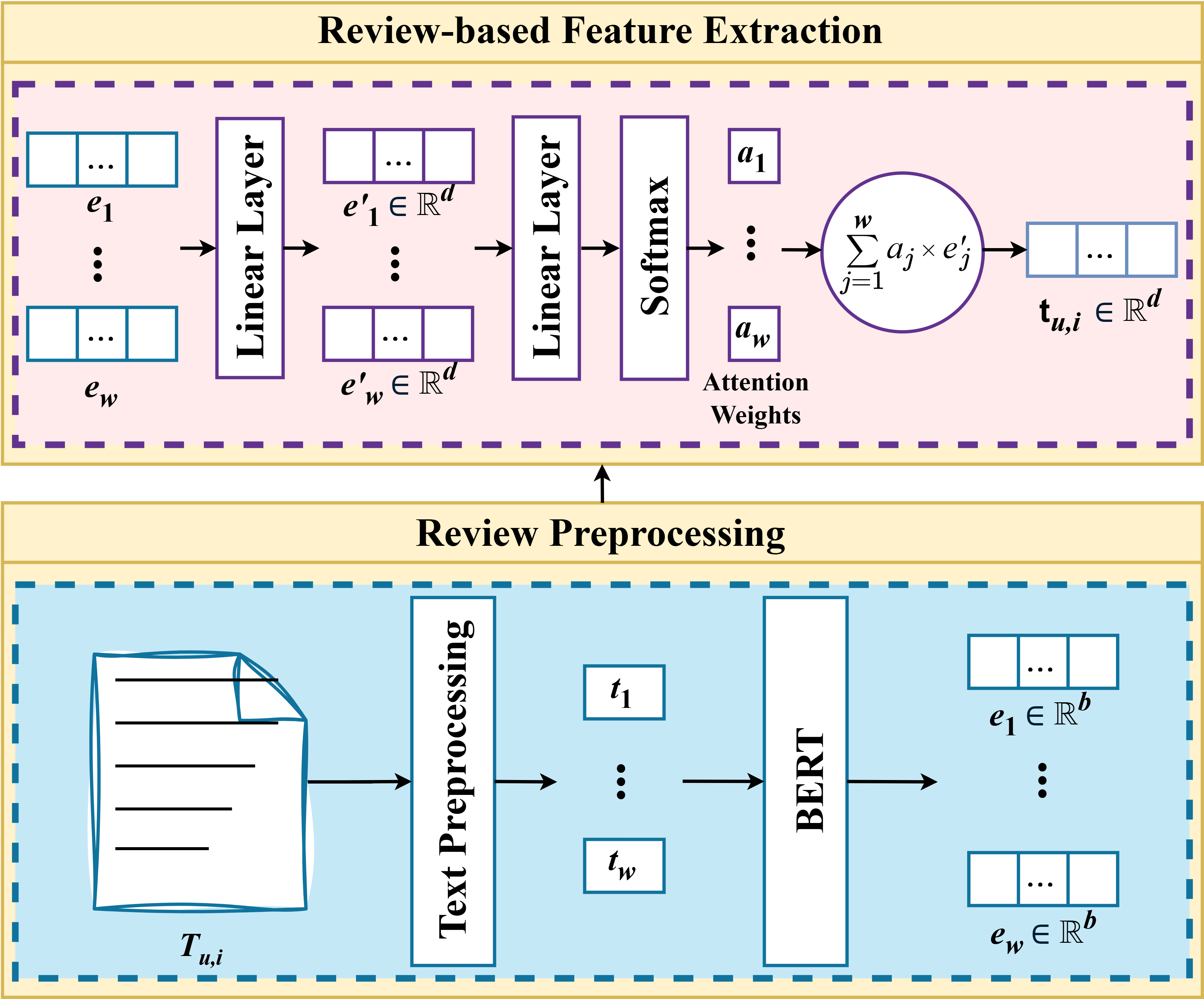

技术框架:DReX框架主要包含以下几个模块:1) 多模态数据输入模块,用于接收用户交互、内容特征和上下文信息等多种模态的数据;2) 特征提取模块,用于提取不同模态的特征表示;3) 门控循环单元(GRU),用于增量式地融合交互特征,更新用户和物品的表示;4) 推荐模块,基于学习到的用户和物品表示进行推荐;5) 可解释性模块,用于生成用户和物品的关键词配置文件,提供可解释的推荐理由。

关键创新:DReX的关键创新在于其增量式融合多模态交互特征的机制。与现有方法相比,DReX不需要单独提取用户和物品的特征,而是通过交互级别的特征更新来学习用户和物品的表示,从而更好地对齐用户和物品的表示,并提高模型对缺失模态的鲁棒性。此外,DReX还能够自动生成可解释的用户和物品关键词配置文件,增强推荐的可解释性。

关键设计:DReX使用门控循环单元(GRU)作为核心的特征融合模块。GRU能够有效地捕捉序列数据中的依赖关系,并选择性地更新隐藏状态。模型使用交叉熵损失函数来优化推荐结果,并采用负采样技术来加速训练过程。此外,模型还设计了一个可解释性模块,通过分析用户和物品的交互历史,提取关键词,并生成可解释的配置文件。

🖼️ 关键图片

📊 实验亮点

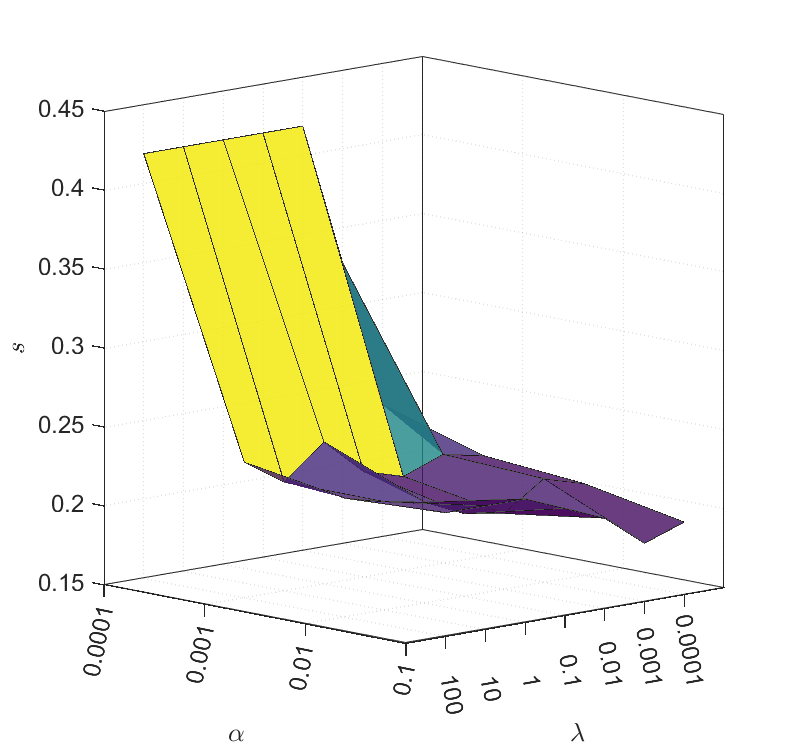

DReX在三个真实数据集上进行了评估,实验结果表明,DReX在所有数据集上都优于最先进的方法。通过将评论文本作为一种模态,DReX能够自动生成可解释的用户和物品关键词配置文件,为推荐过程提供可解释的偏好指标。具体性能提升数据未知,但论文强调了DReX在多个数据集上超越了现有技术。

🎯 应用场景

DReX可应用于电商、社交媒体、在线教育等多个领域,提升推荐系统的准确性和可解释性。例如,在电商领域,DReX可以结合用户的购买历史、商品描述和用户评论等多模态信息,为用户推荐更符合其偏好的商品,并提供可解释的推荐理由,从而提高用户的购买意愿和满意度。该研究有助于构建更智能、更个性化的推荐系统。

📄 摘要(原文)

Multimodal recommender systems leverage diverse data sources, such as user interactions, content features, and contextual information, to address challenges like cold-start and data sparsity. However, existing methods often suffer from one or more key limitations: processing different modalities in isolation, requiring complete multimodal data for each interaction during training, or independent learning of user and item representations. These factors contribute to increased complexity and potential misalignment between user and item embeddings. To address these challenges, we propose DReX, a unified multimodal recommendation framework that incrementally refines user and item representations by leveraging interaction-level features from multimodal feedback. Our model employs gated recurrent units to selectively integrate these fine-grained features into global representations. This incremental update mechanism provides three key advantages: (1) simultaneous modeling of both nuanced interaction details and broader preference patterns, (2) eliminates the need for separate user and item feature extraction processes, leading to enhanced alignment in their learned representation, and (3) inherent robustness to varying or missing modalities. We evaluate the performance of the proposed approach on three real-world datasets containing reviews and ratings as interaction modalities. By considering review text as a modality, our approach automatically generates interpretable keyword profiles for both users and items, which supplement the recommendation process with interpretable preference indicators. Experiment results demonstrate that our approach outperforms state-of-the-art methods across all evaluated datasets.