Agentic AI as a Cybersecurity Attack Surface: Threats, Exploits, and Defenses in Runtime Supply Chains

作者: Xiaochong Jiang, Shiqi Yang, Wenting Yang, Yichen Liu, Cheng Ji

分类: cs.CR, cs.AI

发布日期: 2026-02-23

备注: 9 Pages, 3 figures

💡 一句话要点

针对Agentic AI运行时供应链的攻击面研究:威胁、利用与防御

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic AI 运行时安全 供应链攻击 零信任架构 病毒Agent循环

📋 核心要点

- 现有Agentic AI系统面临运行时安全挑战,攻击面从静态代码转向动态推理过程,易受恶意数据和工具链的攻击。

- 论文提出统一的运行时框架,系统性地分析了数据和工具供应链中的威胁,并识别了新型的病毒Agent循环攻击模式。

- 论文倡导零信任运行时架构,通过密码学溯源来约束工具执行,将上下文视为不可信的控制流,从而增强系统安全性。

📝 摘要(中文)

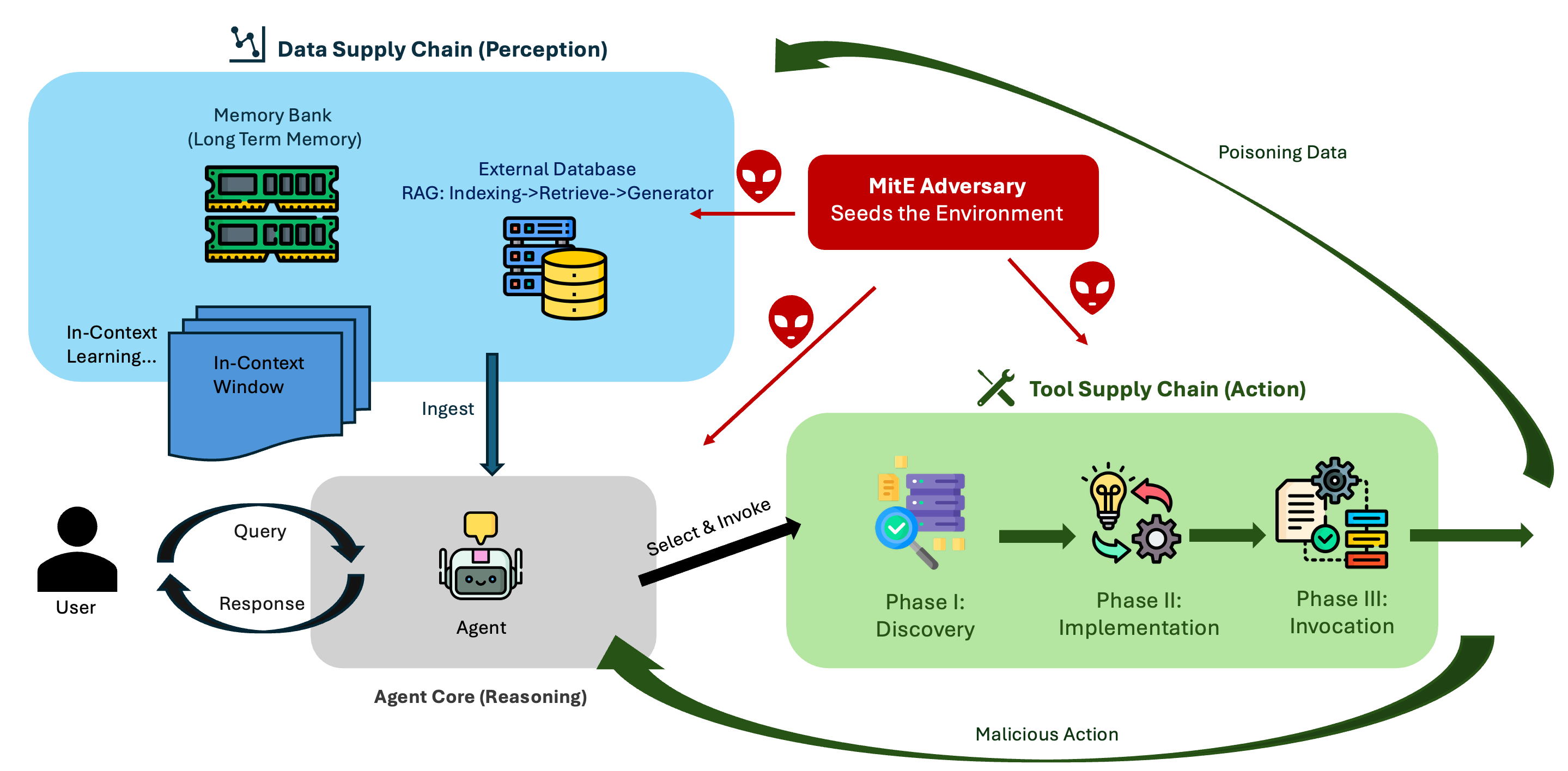

基于大型语言模型(LLMs)的Agentic系统超越了文本生成,能够自主检索信息和调用工具。这种运行时执行模型将攻击面从构建时工件转移到推理时依赖项,使Agent暴露于通过不可信数据和概率性能力解析进行的操纵。虽然先前的工作主要集中在模型层面的漏洞,但由循环和相互依赖的运行时行为产生的安全风险仍然分散。本文在一个统一的运行时框架内系统化了这些风险,将威胁分为数据供应链攻击(瞬态上下文注入和持久性内存中毒)和工具供应链攻击(发现、实现和调用)。此外,我们还识别了病毒Agent循环,其中Agent充当自我传播生成蠕虫的向量,而无需利用代码级缺陷。最后,我们提倡一种零信任运行时架构,该架构将上下文视为不可信的控制流,并通过密码学溯源而非语义推理来约束工具执行。

🔬 方法详解

问题定义:现有Agentic AI系统,特别是那些依赖LLM的系统,在运行时面临新的安全威胁。传统的安全措施主要关注构建时的漏洞,而忽略了运行时环境中的数据和工具依赖关系。攻击者可以通过注入恶意数据或篡改工具链来操纵Agent的行为,导致信息泄露、服务中断等问题。现有的研究对这些运行时风险的理解仍然是分散的,缺乏一个统一的框架来分析和解决这些问题。

核心思路:本文的核心思路是将Agentic AI系统的运行时环境视为一个供应链,包括数据供应链和工具供应链。通过分析这两个供应链中的潜在攻击点,可以系统地识别和缓解运行时安全风险。此外,论文还强调了零信任原则的重要性,即不信任任何输入数据或工具,而是通过密码学溯源等手段来验证其可信度。

技术框架:论文提出了一个统一的运行时框架,用于分析Agentic AI系统的安全风险。该框架包括以下几个主要模块:1) 数据供应链分析模块,用于识别和分析数据注入攻击的风险;2) 工具供应链分析模块,用于识别和分析工具篡改和恶意工具调用的风险;3) 病毒Agent循环检测模块,用于检测和防止Agent之间的恶意传播;4) 零信任运行时架构,用于通过密码学溯源来约束工具执行。

关键创新:论文的关键创新在于:1) 系统地分析了Agentic AI系统的运行时攻击面,并提出了一个统一的框架来理解和解决这些安全风险;2) 识别了一种新型的攻击模式,即病毒Agent循环,其中Agent充当自我传播生成蠕虫的向量;3) 提出了零信任运行时架构,通过密码学溯源来增强系统的安全性。与现有方法相比,本文更加关注运行时环境中的安全问题,并提供了一种更加全面的解决方案。

关键设计:论文提出的零信任运行时架构的关键设计包括:1) 将所有输入数据视为不可信的控制流;2) 使用密码学溯源来验证工具的可信度;3) 实施严格的访问控制策略,限制Agent对工具的访问权限;4) 监控Agent的行为,及时发现和阻止恶意活动。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细描述,属于未来研究的方向。

🖼️ 关键图片

📊 实验亮点

论文识别了病毒Agent循环这一新型攻击模式,展示了Agentic AI系统在运行时面临的潜在风险。提出的零信任运行时架构为防御这些攻击提供了一种有效的解决方案。具体的性能数据和对比基线在论文中未明确给出,但该架构的设计理念和方法具有重要的理论和实践意义。

🎯 应用场景

该研究成果可应用于各种基于Agentic AI的系统,例如智能助手、自动化流程、安全分析等。通过增强运行时安全性,可以有效防止恶意攻击,保护用户数据和系统资源。未来,该研究可以进一步扩展到更复杂的Agentic系统,例如多Agent系统和联邦学习系统,为这些系统的安全部署提供保障。

📄 摘要(原文)

Agentic systems built on large language models (LLMs) extend beyond text generation to autonomously retrieve information and invoke tools. This runtime execution model shifts the attack surface from build-time artifacts to inference-time dependencies, exposing agents to manipulation through untrusted data and probabilistic capability resolution. While prior work has focused on model-level vulnerabilities, security risks emerging from cyclic and interdependent runtime behavior remain fragmented. We systematize these risks within a unified runtime framework, categorizing threats into data supply chain attacks (transient context injection and persistent memory poisoning) and tool supply chain attacks (discovery, implementation, and invocation). We further identify the Viral Agent Loop, in which agents act as vectors for self-propagating generative worms without exploiting code-level flaws. Finally, we advocate a Zero-Trust Runtime Architecture that treats context as untrusted control flow and constrains tool execution through cryptographic provenance rather than semantic inference.