Characterizing MARL for Energy Control: A Multi-KPI Benchmark on the CityLearn Environment

作者: Aymen Khouja, Imen Jendoubi, Oumayma Mahjoub, Oussama Mahfoudhi, Claude Formanek, Siddarth Singh, Ruan De Kock

分类: cs.AI, cs.LG, cs.MA

发布日期: 2026-02-22

💡 一句话要点

提出基于CityLearn环境的多KPI基准测试,评估MARL在城市能源控制中的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 城市能源管理 CityLearn 关键绩效指标 分散训练 集中训练

📋 核心要点

- 城市能源系统优化面临多决策单元协调难题,传统方法难以扩展。

- 利用多智能体强化学习(MARL)解决城市能源管理问题,关注算法的可扩展性和协调性。

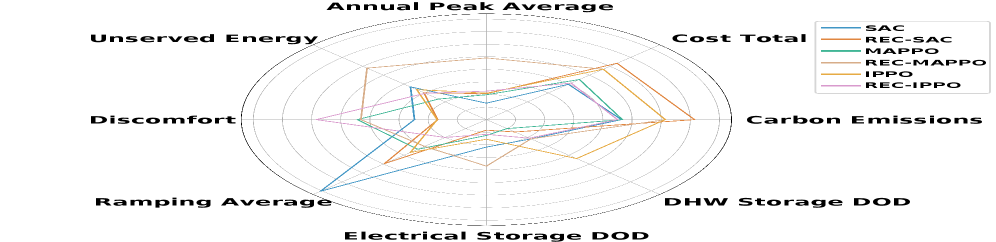

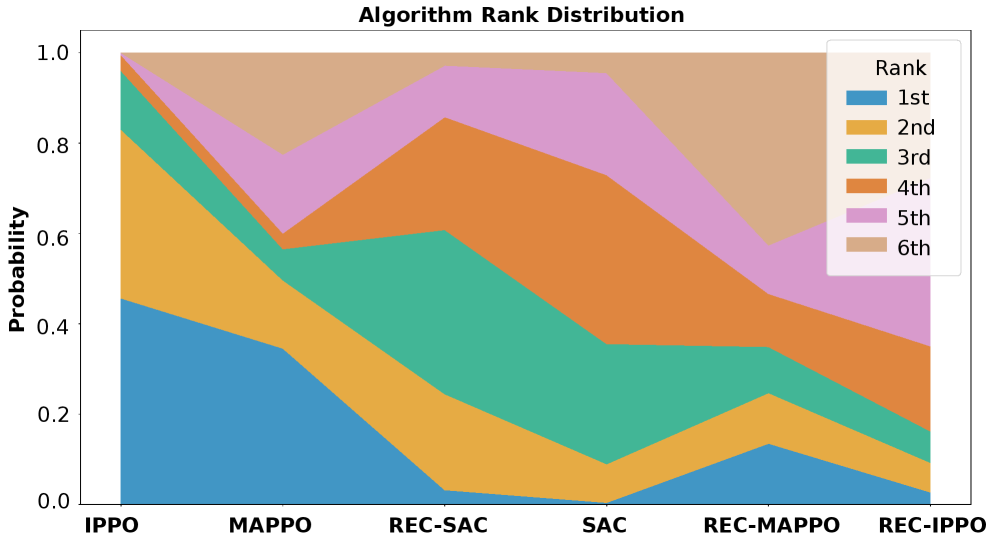

- 在CityLearn环境上进行基准测试,评估PPO和SAC等算法,并提出新的KPI指标。

📝 摘要(中文)

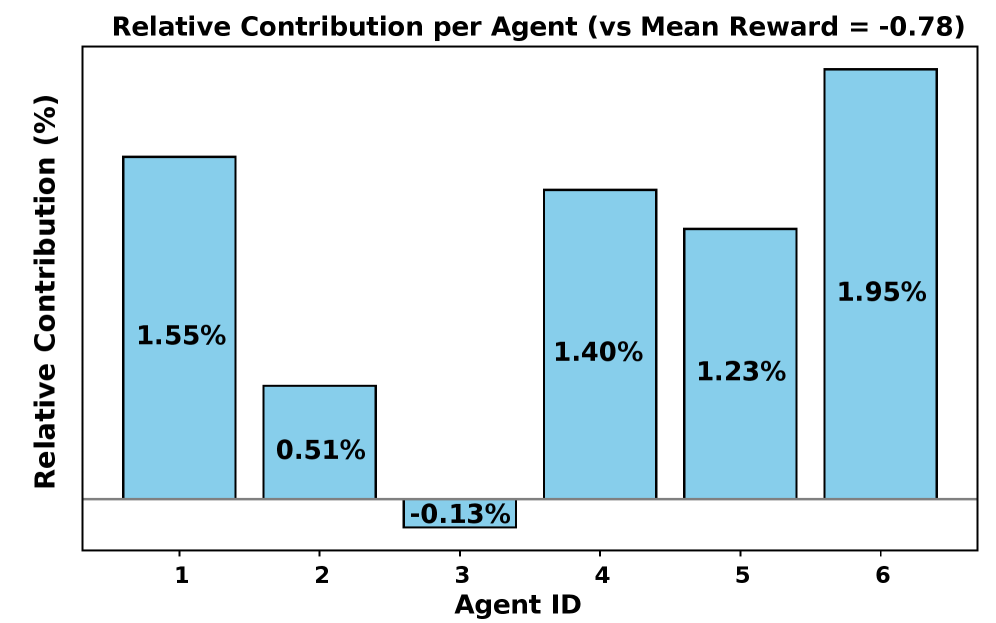

城市能源系统的优化对于可持续和有弹性的智慧城市至关重要,而智慧城市正变得越来越复杂,包含多个决策单元。多智能体强化学习(MARL)是解决可扩展性和协调问题的有前景的方案。本文针对能源管理任务,提出了对MARL算法进行全面可靠的基准测试的迫切需求。以CityLearn作为案例研究环境,因为它真实地模拟了城市能源系统,整合了多个存储系统,并利用了可再生能源。通过这样做,我们的工作为评估设定了新的标准,进行跨多个关键绩效指标(KPI)的比较研究。这种方法揭示了各种算法的关键优势和劣势,超越了传统的KPI平均,后者通常掩盖了关键的见解。我们的实验利用了广泛接受的基线,如近端策略优化(PPO)和软演员评论家(SAC),并涵盖了不同的训练方案,包括分散训练与分散执行(DTDE)和集中训练与分散执行(CTDE)方法以及不同的神经网络架构。我们的工作还提出了新的KPI,以应对现实世界的实施挑战,例如单个建筑物的贡献和电池存储寿命。我们的研究结果表明,DTDE在平均和最坏情况下的性能始终优于CTDE。此外,时间依赖性学习改善了对内存依赖性KPI(如斜坡和电池使用)的控制,从而有助于更可持续的电池运行。结果还揭示了对智能体或资源移除的鲁棒性,突出了学习策略的弹性和分散性。

🔬 方法详解

问题定义:城市能源系统优化面临多决策单元协调难题,现有方法在可扩展性和协调性方面存在不足。传统的KPI平均方法掩盖了关键的性能细节,无法全面评估算法的优劣。此外,现实世界的实施挑战,如单个建筑物的贡献和电池存储寿命,也缺乏有效的评估指标。

核心思路:利用多智能体强化学习(MARL)解决城市能源管理问题,通过分散式决策实现可扩展性和协调性。通过在CityLearn环境中进行基准测试,全面评估不同MARL算法在多个关键绩效指标(KPI)上的表现,从而揭示算法的优势和劣势。同时,提出新的KPI指标,以应对现实世界的实施挑战。

技术框架:该研究使用CityLearn环境作为案例研究平台,该环境真实地模拟了城市能源系统,包括多个存储系统和可再生能源。研究采用了两种主要的训练方案:分散训练与分散执行(DTDE)和集中训练与分散执行(CTDE)。实验中使用了广泛接受的基线算法,如近端策略优化(PPO)和软演员评论家(SAC),并探索了不同的神经网络架构。

关键创新:该研究的关键创新在于提出了新的KPI指标,以应对现实世界的实施挑战,例如单个建筑物的贡献和电池存储寿命。此外,该研究还通过比较DTDE和CTDE等不同的训练方案,揭示了不同MARL算法在城市能源管理中的性能差异。

关键设计:研究中使用了PPO和SAC等经典的强化学习算法,并针对城市能源管理问题进行了调整。具体的技术细节包括:神经网络的结构设计、奖励函数的设计、以及针对不同KPI的优化策略。此外,研究还考虑了时间依赖性学习,以改善对内存依赖性KPI(如斜坡和电池使用)的控制。

🖼️ 关键图片

📊 实验亮点

实验结果表明,分散训练与分散执行(DTDE)在平均和最坏情况下的性能始终优于集中训练与分散执行(CTDE)。时间依赖性学习改善了对内存依赖性KPI(如斜坡和电池使用)的控制,从而有助于更可持续的电池运行。此外,实验还验证了学习策略对智能体或资源移除的鲁棒性,突出了其弹性和分散性。

🎯 应用场景

该研究成果可应用于智慧城市能源管理系统的设计与优化,提升城市能源利用效率,降低能源消耗,提高能源系统的可持续性和鲁棒性。通过MARL算法的部署,可以实现城市能源系统的智能化控制和优化,为构建绿色、低碳的智慧城市提供技术支撑。

📄 摘要(原文)

The optimization of urban energy systems is crucial for the advancement of sustainable and resilient smart cities, which are becoming increasingly complex with multiple decision-making units. To address scalability and coordination concerns, Multi-Agent Reinforcement Learning (MARL) is a promising solution. This paper addresses the imperative need for comprehensive and reliable benchmarking of MARL algorithms on energy management tasks. CityLearn is used as a case study environment because it realistically simulates urban energy systems, incorporates multiple storage systems, and utilizes renewable energy sources. By doing so, our work sets a new standard for evaluation, conducting a comparative study across multiple key performance indicators (KPIs). This approach illuminates the key strengths and weaknesses of various algorithms, moving beyond traditional KPI averaging which often masks critical insights. Our experiments utilize widely accepted baselines such as Proximal Policy Optimization (PPO) and Soft Actor Critic (SAC), and encompass diverse training schemes including Decentralized Training with Decentralized Execution (DTDE) and Centralized Training with Decentralized Execution (CTDE) approaches and different neural network architectures. Our work also proposes novel KPIs that tackle real world implementation challenges such as individual building contribution and battery storage lifetime. Our findings show that DTDE consistently outperforms CTDE in both average and worst-case performance. Additionally, temporal dependency learning improved control on memory dependent KPIs such as ramping and battery usage, contributing to more sustainable battery operation. Results also reveal robustness to agent or resource removal, highlighting both the resilience and decentralizability of the learned policies.