MagicAgent: Towards Generalized Agent Planning

作者: Xuhui Ren, Shaokang Dong, Chen Yang, Qing Gao, Yunbin Zhao, Yongsheng Liu, Xinwei Geng, Xiang Li, Demei Yan, Yanqing Li, Chenhao Huang, Dingwei Zhu, Junjie Ye, Boxuan Yue, Yingnan Fu, Mengzhe Lv, Zezeng Feng, Boshen Zhou, Bocheng Wang, Xuanjing Huang, Yu-Gang Jiang, Tao Gui, Qi Zhang, Yunke Zhang

分类: cs.AI, cs.HC

发布日期: 2026-02-22

💡 一句话要点

MagicAgent:面向通用智能体规划的基础模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 智能体规划 通用智能体 大型语言模型 合成数据 多目标强化学习

📋 核心要点

- 现有智能体规划模型缺乏通用性,主要受限于高质量交互数据的匮乏和异构任务间的冲突。

- MagicAgent通过合成数据框架生成多样化任务轨迹,并采用两阶段训练缓解任务冲突,提升泛化能力。

- 实验表明,MagicAgent在多个基准测试中显著优于现有模型,甚至超越了部分闭源模型。

📝 摘要(中文)

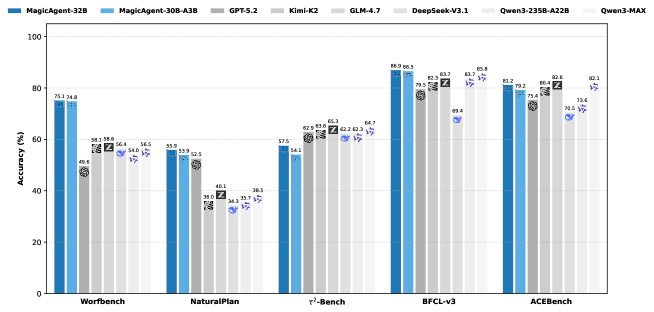

大型语言模型(LLMs)已从被动文本处理器发展为自主智能体,规划成为现代智能的核心组成部分。然而,实现通用规划仍然具有挑战性,这不仅是因为高质量交互数据的稀缺,还因为异构规划任务之间存在固有的冲突。这些挑战导致模型擅长孤立的任务,但难以泛化。现有的多任务训练方法也受到梯度干扰的影响。本文提出了MagicAgent,一系列专为通用智能体规划而设计的基础模型。我们引入了一个轻量级且可扩展的合成数据框架,该框架可以生成跨多种规划任务的高质量轨迹,包括分层任务分解、工具增强规划、多约束调度、程序逻辑编排和长时程工具执行。为了缓解训练冲突,我们提出了一种两阶段训练范式,包括监督微调,然后是对静态数据集和动态环境进行多目标强化学习。实验结果表明,MagicAgent-32B和MagicAgent-30B-A3B表现出色,在Worfbench上的准确率为75.1%,在NaturalPlan上的准确率为55.9%,在τ^2-Bench上的准确率为57.5%,在BFCL-v3上的准确率为86.9%,在ACEBench上的准确率为81.2%,并且在我们内部的MagicEval基准测试中也取得了出色的结果。这些结果大大优于现有的100B以下模型,甚至超过了领先的闭源模型。

🔬 方法详解

问题定义:现有智能体规划模型在面对多样化、复杂的任务时,泛化能力不足。主要痛点在于缺乏足够的高质量训练数据,以及不同规划任务之间存在冲突,导致模型难以同时优化多个目标。

核心思路:MagicAgent的核心思路是利用合成数据生成框架来扩充训练数据,并采用两阶段训练策略来缓解任务冲突。通过合成数据,可以覆盖更广泛的任务类型和场景,提高模型的泛化能力。两阶段训练则可以先通过监督学习学习任务的基本知识,再通过强化学习优化多目标性能。

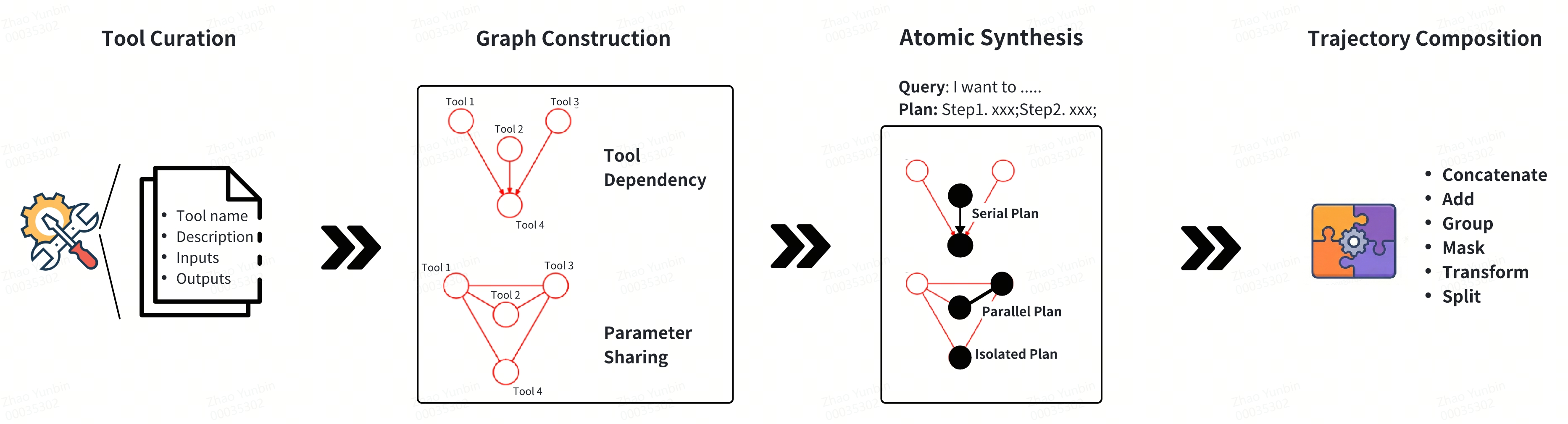

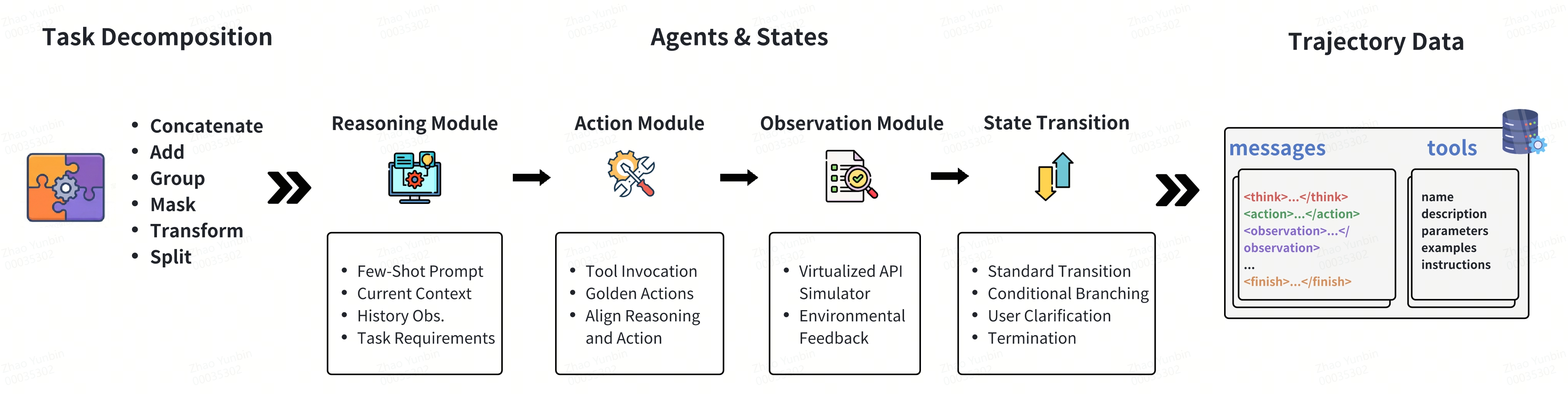

技术框架:MagicAgent的整体框架包括两个主要部分:合成数据生成框架和两阶段训练范式。合成数据生成框架负责生成包含分层任务分解、工具增强规划等多种任务类型的数据。两阶段训练范式首先使用监督学习在合成数据上进行微调,然后使用多目标强化学习在静态数据集和动态环境中进行优化。

关键创新:MagicAgent的关键创新在于其轻量级且可扩展的合成数据框架和两阶段训练范式。合成数据框架能够高效地生成高质量的训练数据,而两阶段训练范式能够有效地缓解任务冲突,提高模型的泛化能力。与现有方法相比,MagicAgent更注重数据的多样性和训练的稳定性。

关键设计:合成数据框架的设计考虑了多种规划任务的特点,包括分层任务分解、工具增强规划、多约束调度、程序逻辑编排和长时程工具执行。两阶段训练范式中,监督学习阶段使用交叉熵损失函数,强化学习阶段使用多目标奖励函数,并采用合适的强化学习算法(具体算法未知)进行优化。具体的参数设置和网络结构细节未在摘要中提及。

🖼️ 关键图片

📊 实验亮点

MagicAgent-32B和MagicAgent-30B-A3B在多个基准测试中取得了显著的性能提升。例如,在Worfbench上的准确率达到75.1%,在NaturalPlan上的准确率达到55.9%,在τ^2-Bench上的准确率为57.5%,在BFCL-v3上的准确率为86.9%,在ACEBench上的准确率为81.2%。这些结果不仅优于现有的100B以下模型,甚至超过了领先的闭源模型。

🎯 应用场景

MagicAgent具有广泛的应用前景,可应用于机器人控制、自动化流程设计、智能助手等领域。通过提供更强大的通用规划能力,MagicAgent可以帮助智能体更好地理解和执行复杂任务,提高工作效率和智能化水平。未来,该研究有望推动智能体技术在各行各业的普及和应用。

📄 摘要(原文)

The evolution of Large Language Models (LLMs) from passive text processors to autonomous agents has established planning as a core component of modern intelligence. However, achieving generalized planning remains elusive, not only by the scarcity of high-quality interaction data but also by inherent conflicts across heterogeneous planning tasks. These challenges result in models that excel at isolated tasks yet struggle to generalize, while existing multi-task training attempts suffer from gradient interference. In this paper, we present \textbf{MagicAgent}, a series of foundation models specifically designed for generalized agent planning. We introduce a lightweight and scalable synthetic data framework that generates high-quality trajectories across diverse planning tasks, including hierarchical task decomposition, tool-augmented planning, multi-constraint scheduling, procedural logic orchestration, and long-horizon tool execution. To mitigate training conflicts, we propose a two-stage training paradigm comprising supervised fine-tuning followed by multi-objective reinforcement learning over both static datasets and dynamic environments. Empirical results demonstrate that MagicAgent-32B and MagicAgent-30B-A3B deliver superior performance, achieving accuracies of $75.1\%$ on Worfbench, $55.9\%$ on NaturalPlan, $57.5\%$ on $τ^2$-Bench, $86.9\%$ on BFCL-v3, and $81.2\%$ on ACEBench, as well as strong results on our in-house MagicEval benchmarks. These results substantially outperform existing sub-100B models and even surpass leading closed-source models.